这段代码片段展示了使用 PyTorch 进行模型训练的常见步骤。

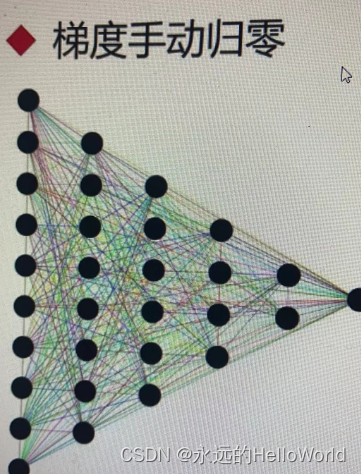

optimizer.zero_grad()

loss_sum.backward()

optimizer.step()

在这个代码片段中,假设你已经定义了一个模型,并且有一个损失函数 loss,以及一个优化器 optimizer。

下面是这段代码的解释:

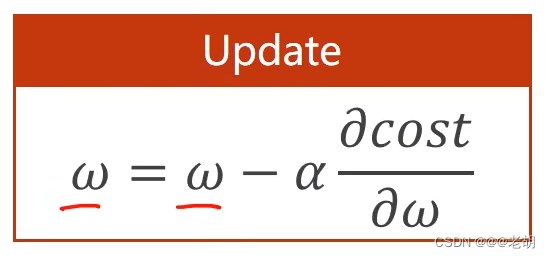

optimizer.zero_grad(): 这一步用于清除之前计算的梯度。在每次迭代之前,需要将梯度归零,以避免梯度累积影响下一次迭代的计算。loss_sum.backward(): 这一步用于计算损失函数关于模型参数的梯度。通过调用backward()方法,PyTorch 会自动计算梯度,并将梯度值存储在每个参数的.grad属性中。optimizer.step(): 这一步用于更新模型的参数。优化器根据计算得到的梯度值和设定的优化算法(如随机梯度下降)来更新模型参数。调用step()方法可以更新模型的参数值,使其朝着最优方向移动。

通过这三个步骤的循环迭代,可以逐渐优化模型的参数,使其在训练数据上逐渐拟合目标。

请注意,这只是一个简单的示例,实际上的训练过程可能会包含更多的步骤和逻辑,例如数据加载、批量处理、学习率调整等。但是,上述代码片段展示了训练中的核心步骤。