pytorch loss及其梯度

- 开发

- 17

-

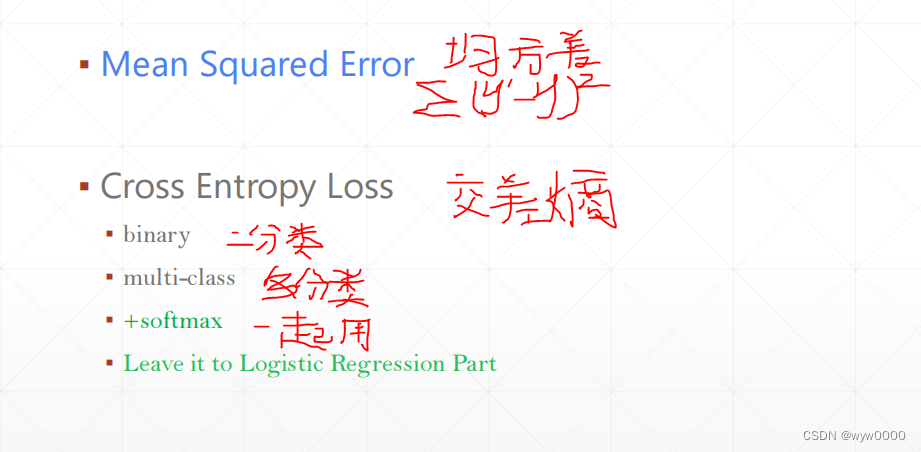

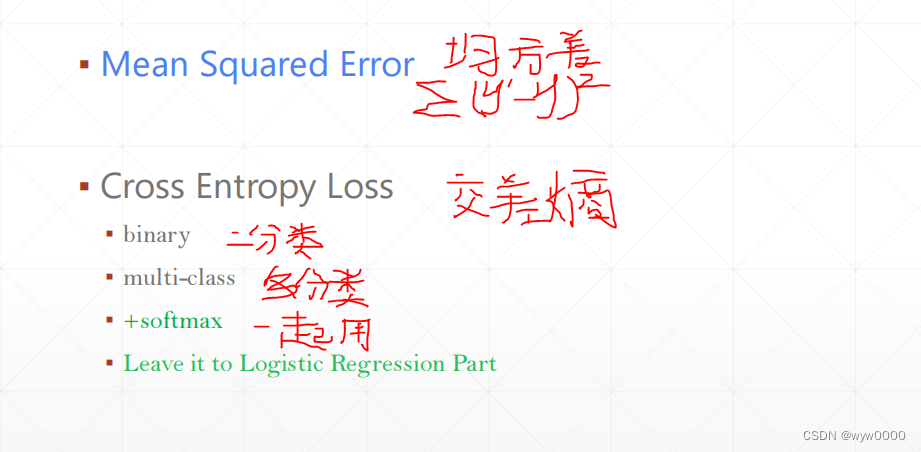

1.loss的种类

常见两种一种是均方差,一种是交叉熵

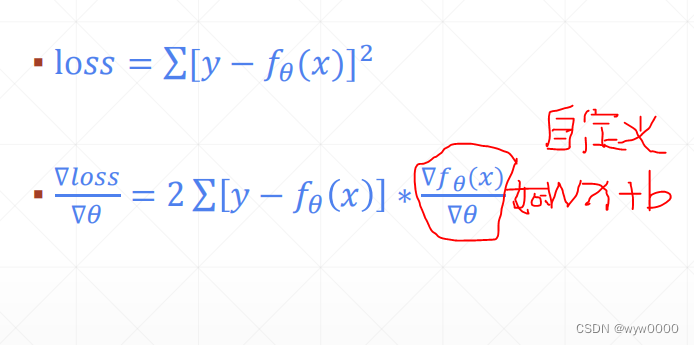

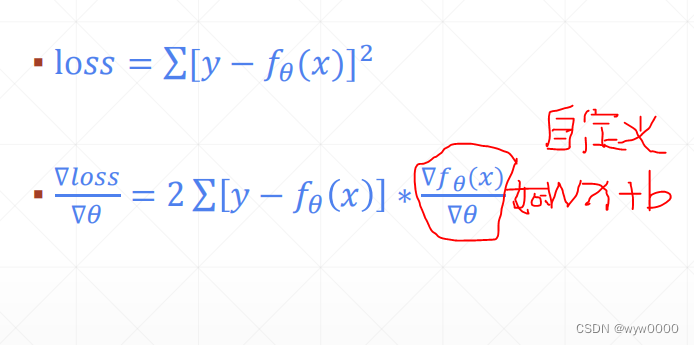

1.1 MSE

1.2 MSE推导

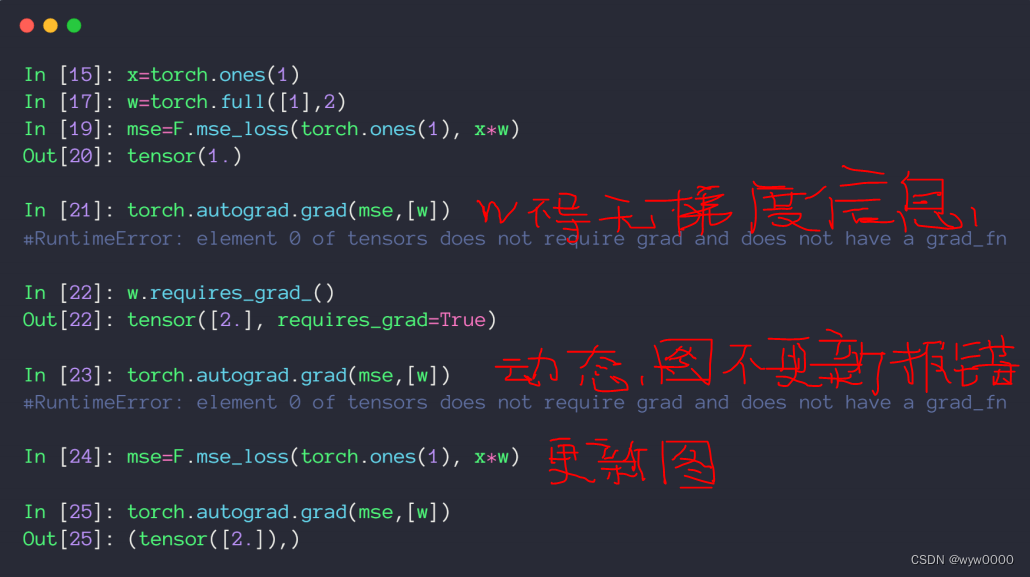

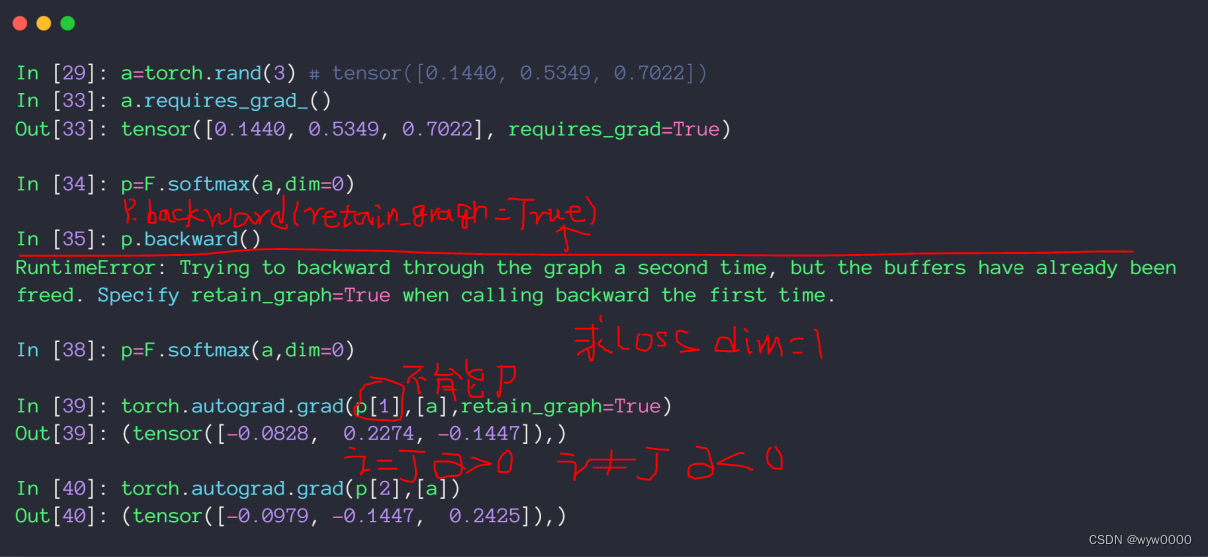

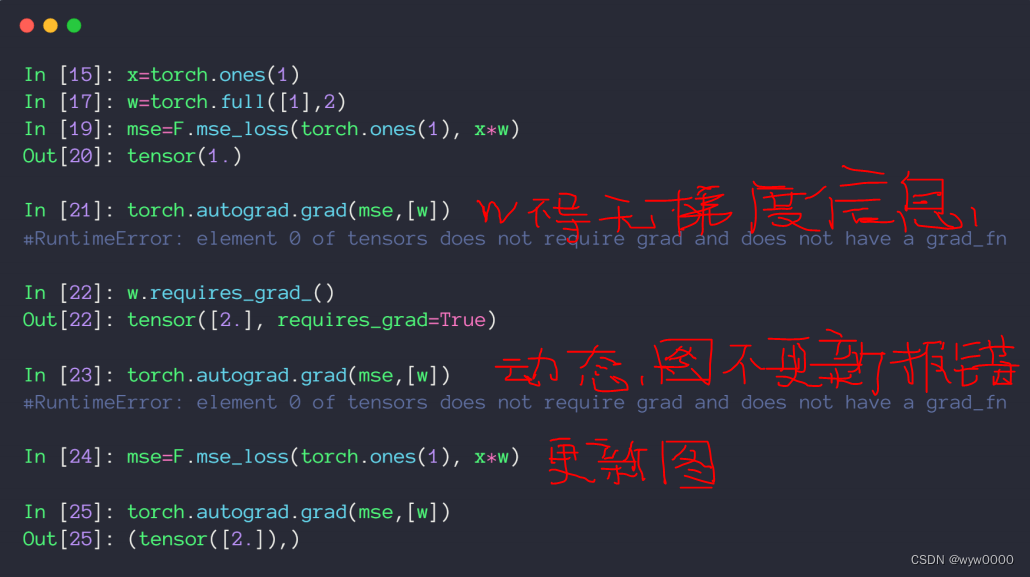

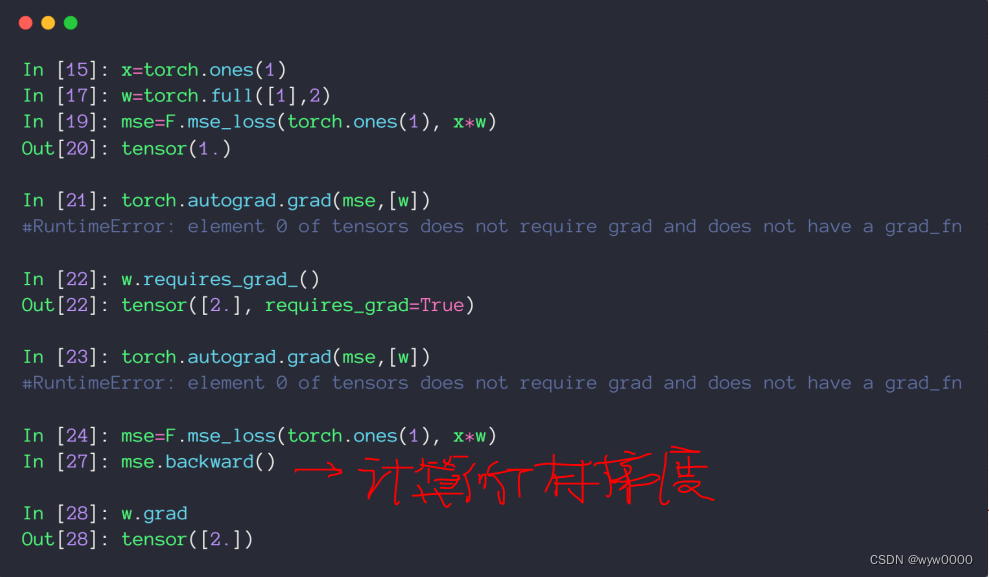

1.3 autograd.grad

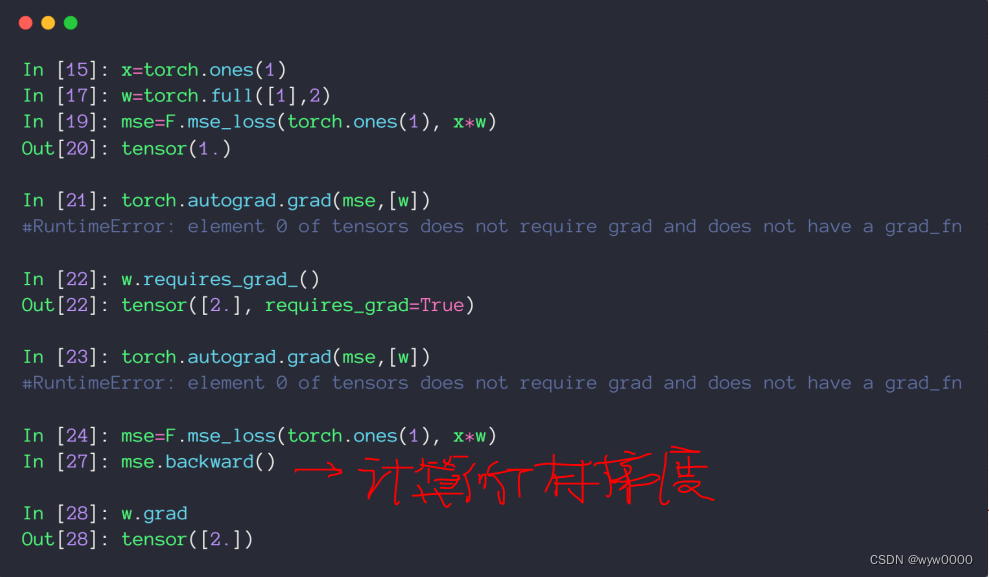

1.4 loss.backward

注意:autograd.grad直接返回梯度,而backward梯度保存再w.grad中

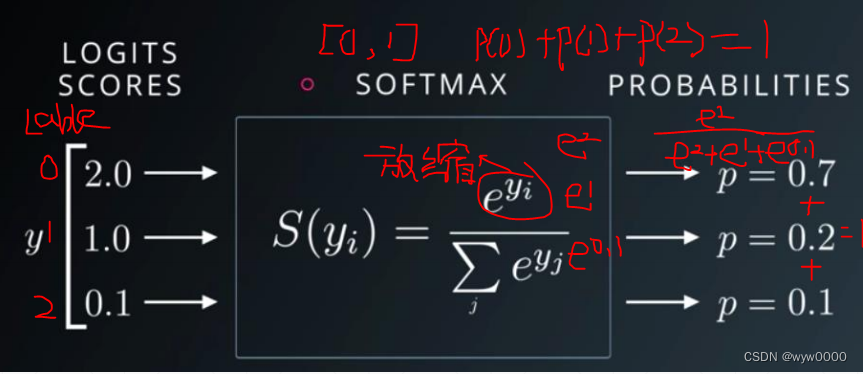

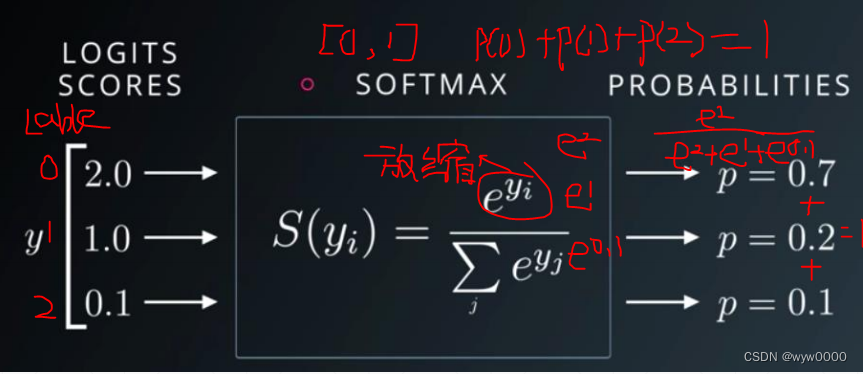

2. Softmax

softmax函数范围是[0,1]所有分类概率和等于1,softmax的特性是使概率大的更大,概率小的更小。

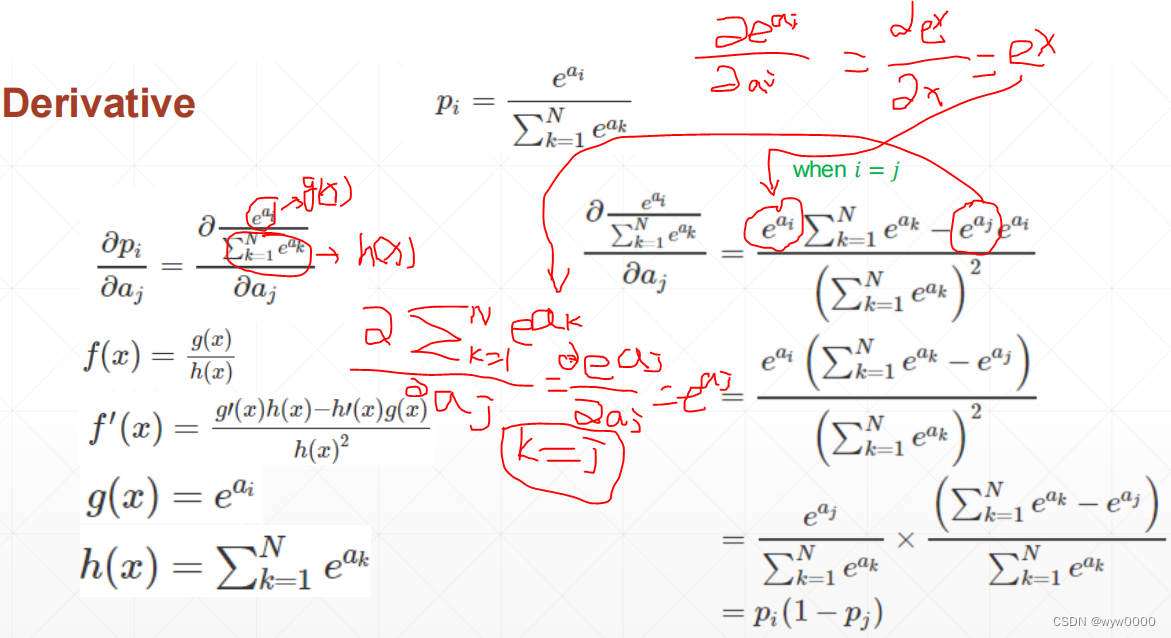

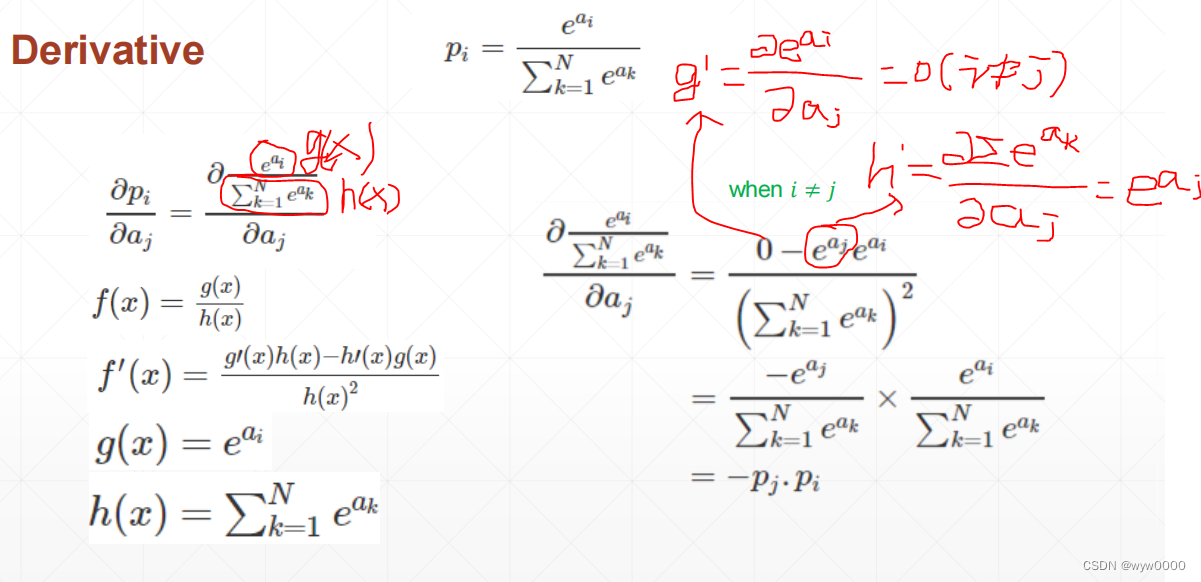

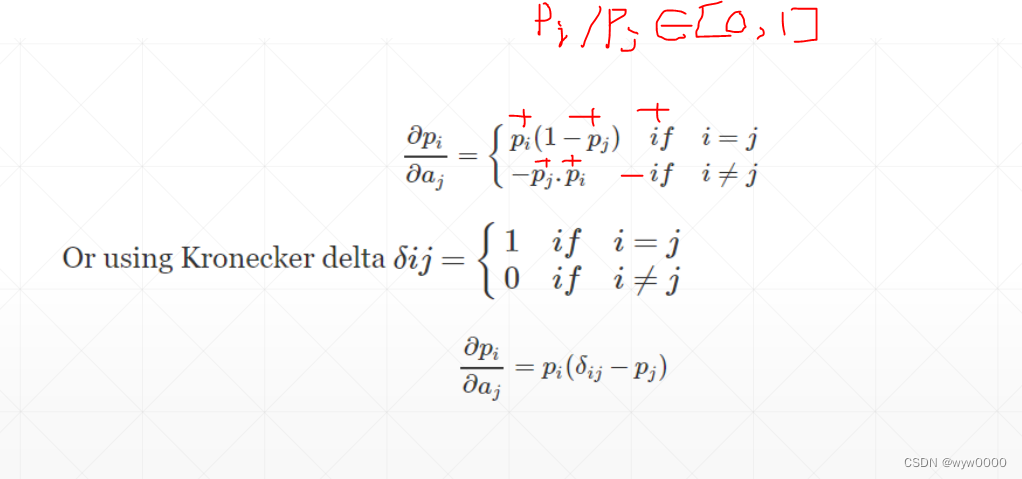

2.1 softmax推导

原文地址:https://blog.csdn.net/wyw0000/article/details/136668978

本文来自互联网用户投稿,该文观点仅代表作者本人,不代表本站立场。

本站仅提供信息存储空间服务,不拥有所有权,不承担相关法律责任。

如若转载,请注明出处:https://www.suanlizi.com/kf/1768888440881025024.html

如若内容造成侵权/违法违规/事实不符,请联系《酸梨子》网邮箱:1419361763@qq.com进行投诉反馈,一经查实,立即删除!