AI学习指南机器学习篇-使用逻辑回归进行多类别分类

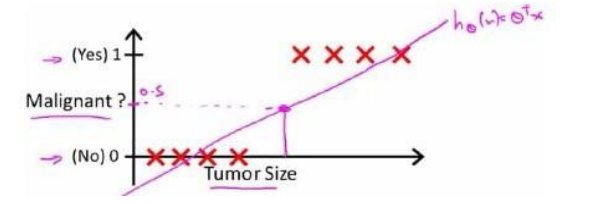

在机器学习领域,逻辑回归是一种常用的分类方法,通常用于处理二分类问题。但是,在实际应用中,我们经常会遇到多类别分类的问题,因此需要将逻辑回归扩展到多类别分类的情况。本篇博客将详细探讨逻辑回归在多类别分类问题中的应用,特别是通过一对多(One-vs-Rest)方法来实现多类别分类。

什么是多类别分类

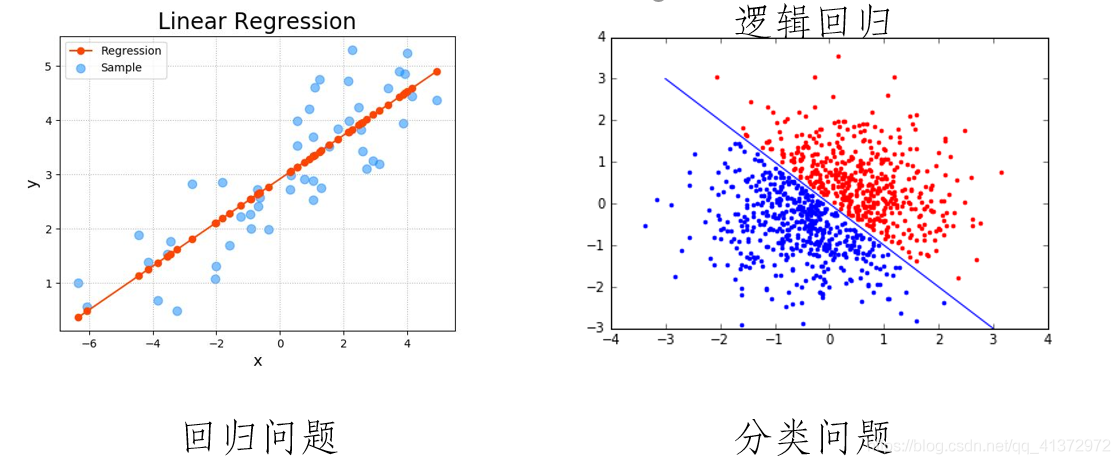

在机器学习中,分类问题可以分为二分类和多分类两种。二分类问题是指将样本分为两个类别,比如判断一封邮件是垃圾邮件还是正常邮件;而多分类问题则是指将样本分为多个类别,比如手写数字识别中的0~9共10个类别。在本篇博客中,我们将重点讨论多类别分类问题。

逻辑回归在多类别分类中的应用

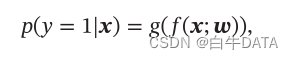

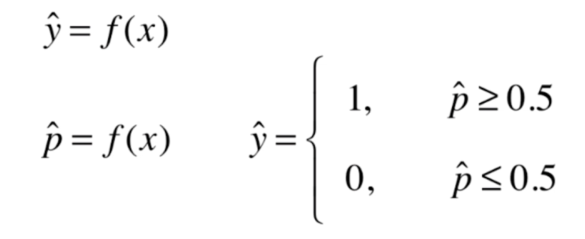

逻辑回归是一种广泛应用于二分类问题的线性模型,其原理是根据输入特征的加权和来预测样本属于某一类别的概率。在多类别分类问题中,我们可以通过一对多(One-vs-Rest)方法来扩展逻辑回归模型,实现对多个类别的分类。

一对多(One-vs-Rest)方法

一对多方法是指将多类别分类问题拆分为多个二分类子问题,每个子问题对应一个类别。具体来说,对于K个类别的多分类问题,我们需要训练K个逻辑回归模型,第i个模型将类别i作为正例,而将其余K-1个类别作为负例。当我们得到所有K个模型的预测结果后,就可以根据概率大小来确定样本最可能属于哪个类别。

示例

为了更好地理解一对多方法,我们以一个手写数字识别的例子来进行说明。假设我们有一个手写数字数据集,其中包含0~9共10个类别,我们的目标是训练一个逻辑回归模型来实现对这10个类别的识别。

首先,我们将数据集拆分为10个子数据集,每个子数据集对应一个类别。然后,我们分别训练10个逻辑回归模型,每个模型将对应的类别作为正例,其余9个类别作为负例。当我们对一个新的手写数字样本进行分类时,我们可以将该样本输入到这10个模型中,得到10个类别的概率预测值,最终选择概率最大的类别作为该样本的预测类别。

总结

通过本篇博客的学习,我们了解了逻辑回归在多类别分类问题中的应用,特别是通过一对多方法来实现多类别分类。同时,我们也通过实际示例对一对多方法进行了详细说明,希望读者能够对多类别分类问题有更深入的理解。在实际应用中,读者可以根据具体情况选择合适的多类别分类方法,并结合逻辑回归模型进行建模和预测。希望本篇博客能够帮助读者更好地应用逻辑回归模型解决多类别分类问题。

希望这篇博客对大家有所帮助,也希望大家在学习和实践中能够不断积累经验,提升自己在机器学习领域的能力。感谢大家的阅读!