基于 MindSpore 实现 BERT 对话情绪识别

BERT基本介绍

- 全称:Bidirectional Encoder Representations from Transformers,即变换器的双向编码器表征量。

- 开发者:Google,发布于2018年末。

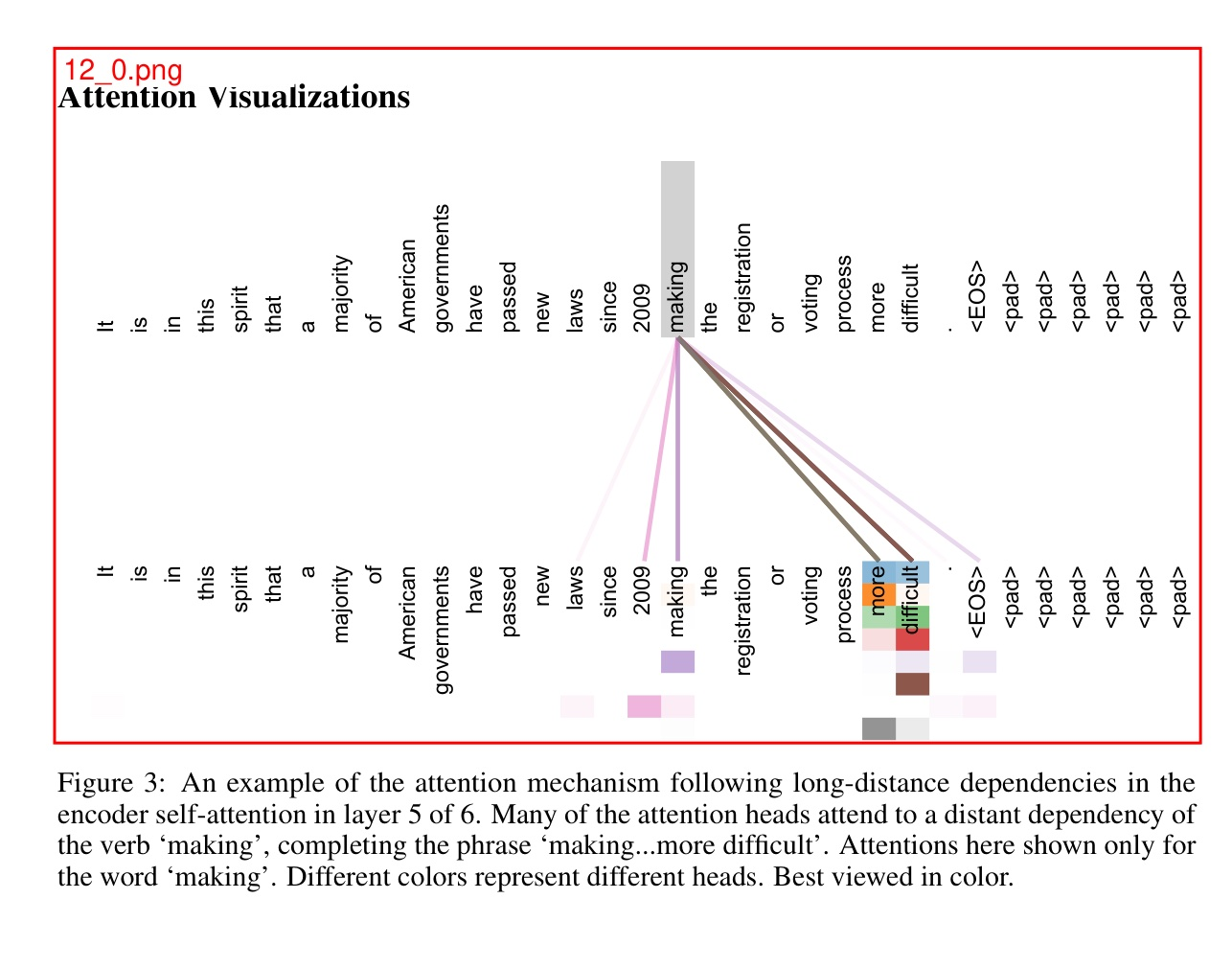

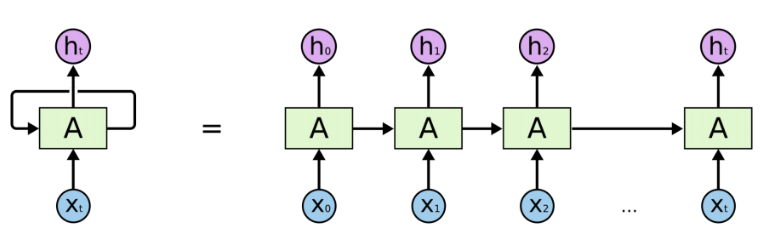

- 核心结构:基于Transformer的Encoder,采用双向训练机制,充分利用上下文信息。

- 应用范围:广泛应用于问答系统、命名实体识别、自然语言推理和文本分类等多种NLP任务。

BERT的训练方法

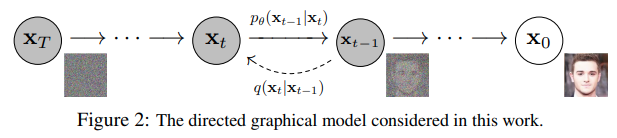

- Masked Language Model (MLM):对15%的单词进行随机Masking。具体操作为:80%的时间使用"[MASK]"替代,10%替换为随机单词,10%保持不变。

- Next Sentence Prediction (NSP):训练BERT理解两个句子之间的逻辑关系。方法是给定两个句子,预测第二个句子是否为第一个句子的逻辑后续。

BERT的架构和预训练

- 模型版本:基础版BERT-BASE包含12层Transformer,而BERT-LARGE包含24层。

- 预训练结果:存储了Embedding表和Transformer层的权重,这些预训练的参数极大地促进了模型在下游任务上的性能。

Fine-tuning BERT

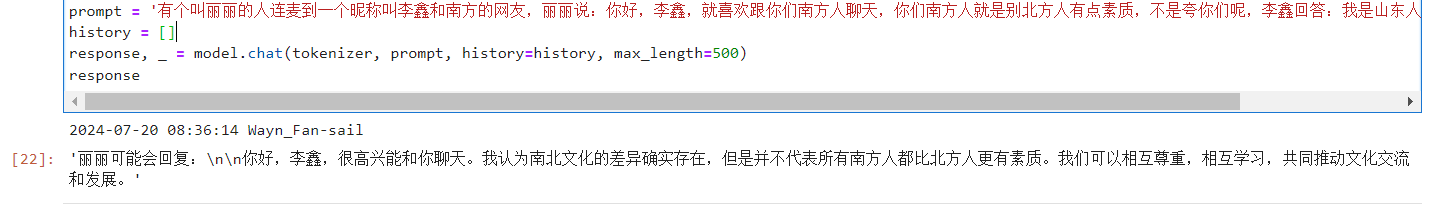

- 使用预训练的BERT模型进行微调,以适应特定的下游任务,如文本分类、情感分析等。

对话情绪识别的应用

- 目标:识别对话文本中的情绪状态,如积极、消极或中性。

- 重要性:在聊天、客服等场景中尤为重要,有助于改善用户交互体验,分析服务质量,降低人工审核成本。

总体而言,BERT不仅因其深入挖掘文本双向上下文信息的能力而被广泛使用,还因其在多种复杂NLP任务中展示的卓越性能而受到推崇。在对话情绪识别这一具体应用中,BERT能够有效地从复杂的对话数据中识别并分类人类情绪,提供深度的情绪分析工具。

![赛蓝企业管理系统GetExcellTemperature接口SQL注入漏洞复现 [附POC]](https://i-blog.csdnimg.cn/direct/77781be74d434297ad6ab02d1619dc1c.png)