目录

1.概述

1.1.定义

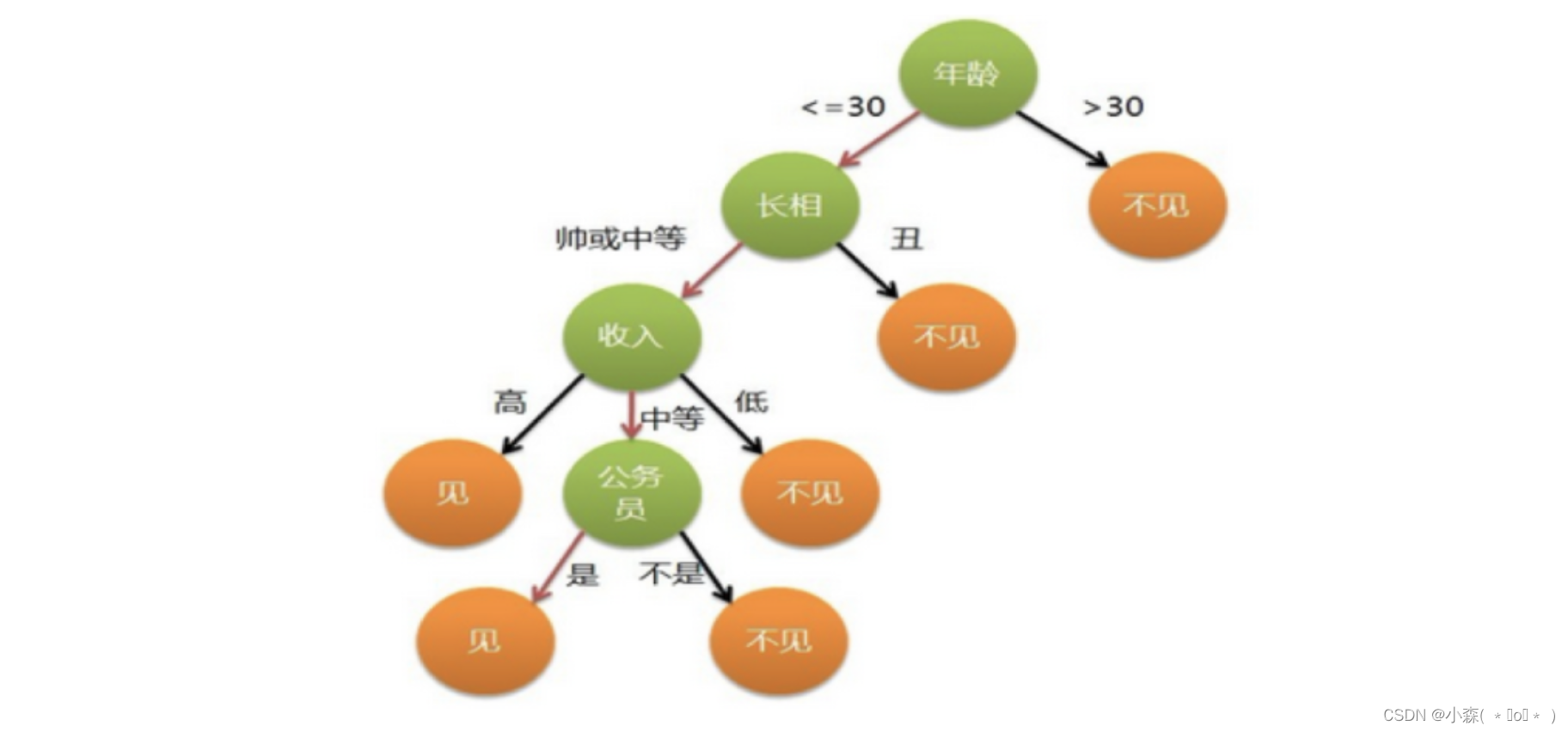

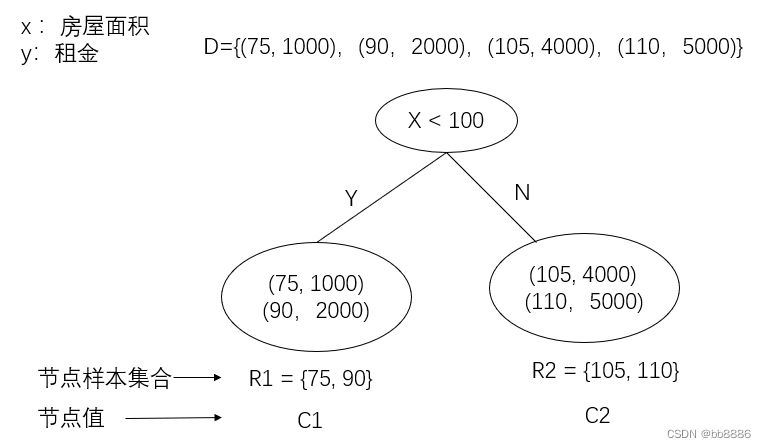

决策树算法是一种常用的机器学习方法,可以应用于分类和回归任务。通过递归地将数据集划分为更小的子集,从而形成一棵树状的结构模型。每个内部节点代表一个特征的判断,每个分支代表这个特征的某个取值或范围,每个叶节点则表示预测结果。

1.2.起源

决策树算法最早由计算机科学家和统计学家在20世纪60年代提出。最著名的是Ross Quinlan在1986年提出的ID3(Iterative Dichotomiser 3)算法,之后Quinlan又在1993年提出了C4.5算法,这些都是经典的决策树生成方法。决策树的发展受到社会科学中的决策分析的启发,并逐渐在各种需要分类和预测的场景中得到应用。

1.3.作用

- 分类:用于将数据划分为不同的类别,例如垃圾邮件过滤。

- 回归:用于预测连续型数值,例如房屋价格预测。

- 特征选择:帮助确定哪些特征对于预测最重要。

- 数据预处理:可以用于缺失值填补、特征工程等。

2.优缺点

2.1.优点

1. 简单直观:决策树易于理解和解释,尤其是对于非专业人员。

2. 不需要大量的数据预处理:除了特征工程外,不要求特征标准化。

3. 能处理数值和分类特征:适应性较强。

4. 非线性关系:能够有效处理复杂的非线性关系。

2.2.缺点

1. 容易过拟合:特别是当树的深度很大时。

2. 偏向于选择具有多层级别的特征:可能导致不公平的结果。

3. 对噪声敏感:数据中的噪声会显著影响树的结构。

4. 不稳定:微小的数据变化可能导致完全不同的树结构。

3.原理

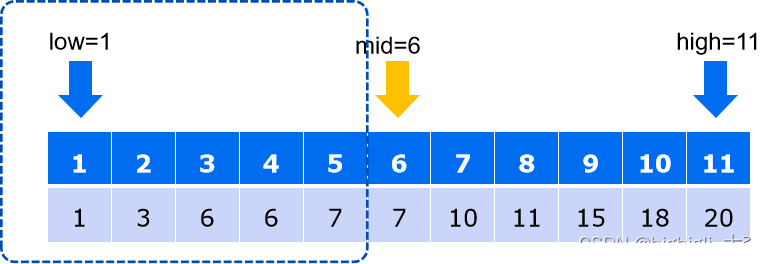

决策树的构建通过以下几个主要步骤:

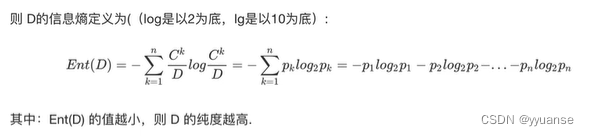

1. 选择最佳特征:根据某种分裂标准(如信息增益、基尼系数等)选择每次分裂的最佳特征。

2. 构建节点:将当前数据集分割成多个子集。

3. 递归构建:对每个子集重复上述步骤,形成子节点。

4. 终止条件:直到所有数据被完美分开或到达合理的停止条件(如树的最大深度)。

4.应用场景

1. 医疗诊断:通过病人特征预测疾病类型。

2. 客户细分:根据客户行为和属性进行市场细分。

3. 信贷风险评估:判断借款人的违约风险。

4. 销售预测:预测商品的销售量。

5. 学生成绩预测:根据学业表现预测未来成绩。

6. 推荐系统:根据用户行为推荐商品或服务。

7. 流失率预测:预测某个时间段内用户是否会流失。

8. 图片分类:识别图片中的物体。

9. 在线广告点击预测:预测用户是否会点击某个广告。

10. 基因表达数据分析:区分不同基因状态。

5.案例

1. 银行信贷评估:

银行使用决策树模型根据客户的信用历史、收入水平等特征来评估放贷风险。通过训练数据,树模型可以自动决定哪些特征对违约情况有重要影响,进而对新客户给出相应的贷款建议。

2. 突发公共卫生事件应急指挥:

在突发公共卫生事件中,如旱灾或疫情暴发,政府部门可以利用决策树模型,根据历史数据和当前信息,快速制定应急措施,提早发现潜在高危区域并及时进行干预。

3. 电子商务网站推荐系统:

电商平台运用决策树算法,对用户行为数据(如浏览记录、购买记录、点击喜好)进行分析,推荐更符合用户需求的商品,从而提高用户体验和销售转换率。

6.代码示例

下面是一个在Jupyter Notebook中使用Python和Scikit-Learn库来创建和训练决策树模型的示例。使用一个经典的机器学习数据集iris。

首先,确保你已经安装了Scikit-Learn库。如果还没安装,你可以运行以下命令来安装它:

pip install scikit-learn6.1. 导入必要的库

import numpy as np

import pandas as pd

from sklearn import datasets

from sklearn.model_selection import train_test_split

from sklearn.tree import DecisionTreeClassifier

from sklearn.metrics import accuracy_score, classification_report, confusion_matrix

import matplotlib.pyplot as plt

from sklearn.tree import plot_tree6.2. 加载iris数据集

# 加载iris数据集

iris = datasets.load_iris()

X = iris.data

y = iris.target6.3. 分割训练集和测试集

X_train, X_test, y_train, y_test = train_test_split(X, y, test_size=0.3, random_state=42)6.4. 创建和训练决策树模型

clf = DecisionTreeClassifier(random_state=42)

clf.fit(X_train, y_train)6.5. 使用模型进行预测

y_pred = clf.predict(X_test)6.6. 评估模型性能

print("Accuracy:", accuracy_score(y_test, y_pred))

print("\nClassification Report:\n", classification_report(y_test, y_pred))

print("\nConfusion Matrix:\n", confusion_matrix(y_test, y_pred))6.7. 可视化决策树

plt.figure(figsize=(20,10))

plot_tree(clf, filled=True, feature_names=iris.feature_names, class_names=iris.target_names)

plt.show()以上就是在Jupyter Notebook中创建和训练一个决策树模型的基本步骤。运行这些代码块会加载iris数据集,分割数据,训练决策树模型并进行预测和评估。最后,决策树还可以通过可视化函数进行展示。

7.总结

决策树算法是一种强大且灵活的机器学习工具,能够处理分类和回归问题。其优势包括简单易懂、不需要大量预处理且能处理多种特征类型,但也有适度的缺点,如容易过拟合和对噪声敏感。适当使用正则化方法(如剪枝)、交叉验证和增加数据样本量可以缓解这些问题。在众多行业中,决策树以其直观性和有效性得到了广泛应用。

![[AI资讯·0618] 快手AI模型“可灵“在质量优于Sora,OpenAI和谷歌发布新技术推动AI视频推理发展,Gemini1.5Pro在该榜单中表现突出](https://img-blog.csdnimg.cn/img_convert/9143cf514b6c67e6f0cbc8369bbe3d09.jpeg)

![日本新入管法通过:2027年起实施[育成就劳]制度,新制度更适合外国劳工在日本工作和生活!](https://img-blog.csdnimg.cn/direct/3a80b05d92a84563adb187e68f674545.png)