目录

主要概念

客户端负载均衡的定义与重要性

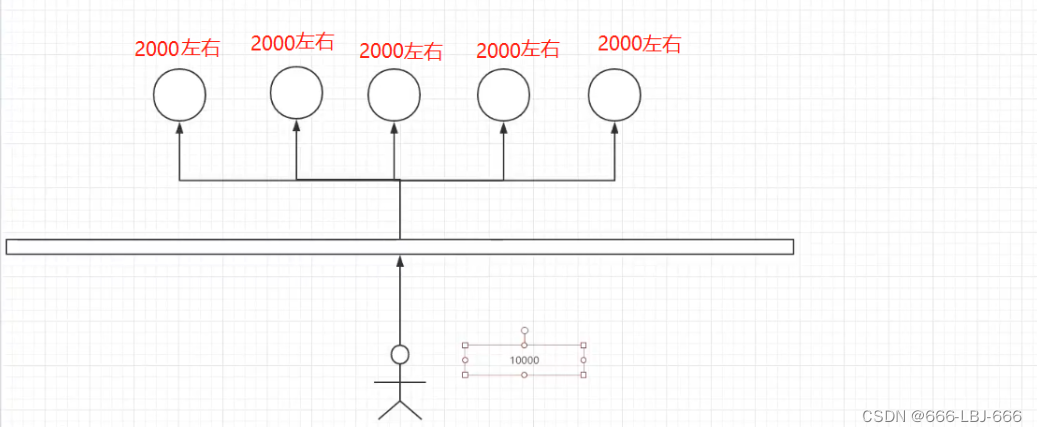

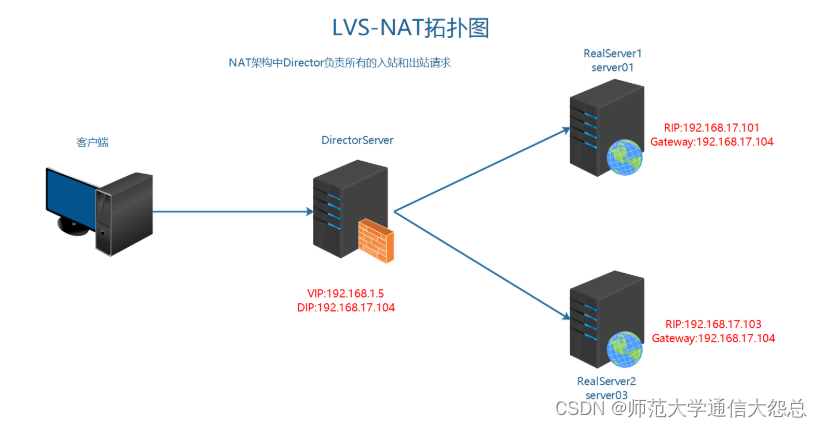

客户端负载均衡(Client-Side Load Balancing)是指将负载均衡的逻辑从服务器端转移到客户端,使得客户端在发送请求之前决定将请求发送到哪个服务实例。这种模式相较于传统的服务器端负载均衡有许多优点,例如减少网络开销、避免单点故障等。

在传统的服务器端负载均衡模式下,所有的请求都先发送到一个负载均衡器,由它来决定将请求转发到哪个服务实例。这种方法的缺点是负载均衡器本身可能成为单点故障,且在高并发场景下容易成为系统瓶颈。而客户端负载均衡将负载均衡的决策权下放到每个客户端,从而分散了负载,提高了系统的灵活性和可靠性。

历史背景

在早期的单体架构中,负载均衡主要依赖于硬件设备或者基于DNS的方式。这些方法在处理简单的流量分发时较为有效,但随着微服务架构的普及,服务之间的内部调用变得更加频繁,传统的集中式负载均衡器逐渐暴露出其局限性。例如,硬件负载均衡器价格昂贵且难以扩展,基于DNS的负载均衡则存在缓存一致性问题。为了克服这些挑战,客户端负载均衡逐渐成为主流选择。

技术细节

客户端负载均衡的实现方式

工作原理

客户端负载均衡器在客户端应用程序中运行,并从服务注册中心获取所有可用服务实例的列表。每个客户端在发送请求时,根据预定义的负载均衡策略(如轮询、随机、最少连接等)选择一个服务实例,将请求发送到该实例。

例如,在使用Netflix Ribbon的情况下,Ribbon从Eureka服务注册中心获取服务实例列表,然后根据配置的负载均衡策略决定请求的路由。

常见的客户端负载均衡策略

- 轮询均衡(Round Robin):将请求依次分配给每个服务实例,适用于服务实例性能相似的情况。这种策略实现简单,能够在大多数场景下提供较为均衡的负载分配。

- 随机均衡(Random):将请求随机分配给服务实例,在请求量足够大的情况下能够实现较均衡的分布。随机均衡策略通过简单的随机算法实现,适用于服务实例性能差异不大的情况。

- 最少连接数均衡(Least Connection):将请求分配给当前处理连接数最少的服务实例,适用于长时间处理请求的服务。这种策略能够动态调整负载分配,确保每个服务实例的负载尽可能均衡。

- 权重均衡(Weighted Round Robin/Weighted Random):根据服务实例的性能分配权重,权重越高,分配到的请求越多。通过配置不同的权重,可以在性能不均衡的服务实例之间实现合理的负载分配。

实际应用

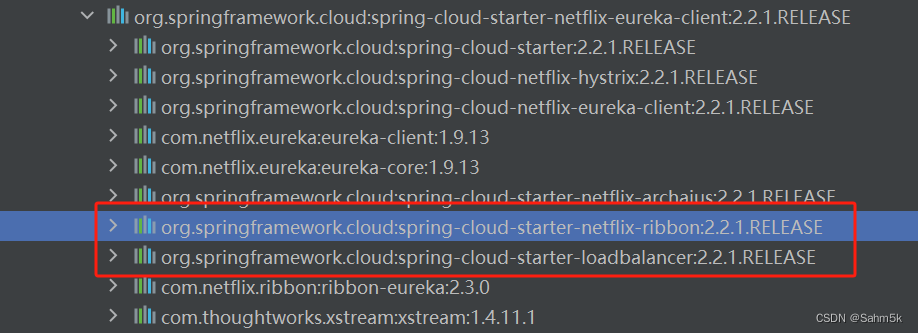

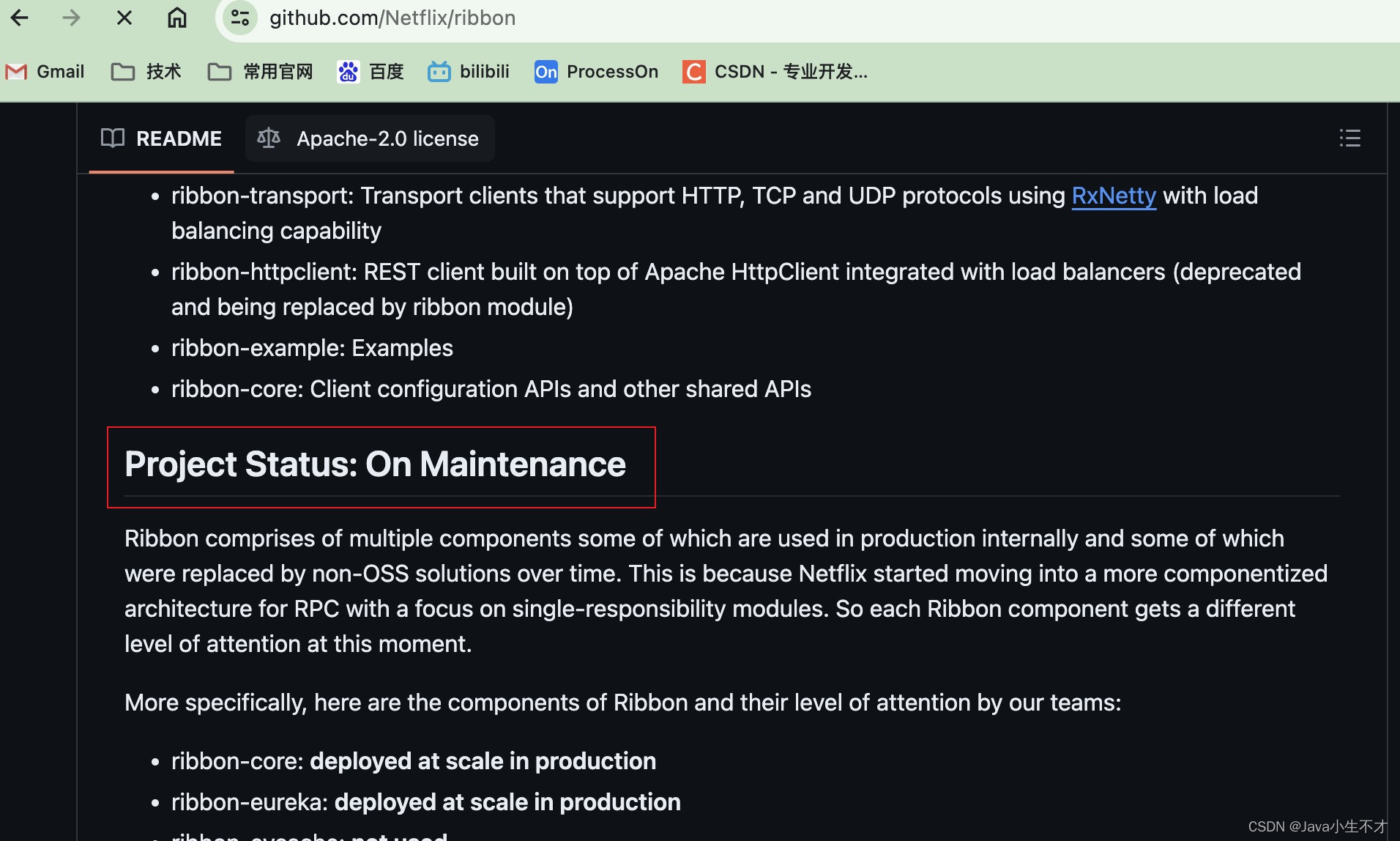

Netflix Ribbon

Netflix Ribbon是一个客户端负载均衡库,与Netflix Eureka无缝集成。Ribbon支持多种负载均衡策略,能够根据服务实例的健康状况动态调整负载分配。

- 优点:与Eureka集成良好,配置灵活,支持多种负载均衡策略。

- 缺点:需要客户端维护服务实例列表,增加了客户端的复杂性。在高并发场景下,Ribbon的性能可能受到限制。

Spring Cloud LoadBalancer

Spring Cloud LoadBalancer是Spring Cloud生态系统的一部分,提供了简单易用的客户端负载均衡功能。它支持多种负载均衡策略,能够与Spring Cloud的其他组件无缝集成。

- 优点:与Spring Cloud生态系统集成良好,使用简单,能够与其他Spring组件协同工作。

- 缺点:性能在某些极端高并发场景下可能有限,配置选项相对较少。

服务网格(Service Mesh)

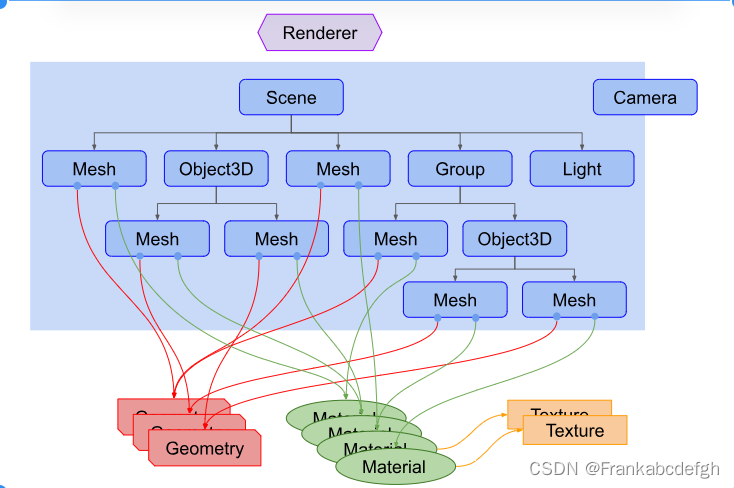

服务网格通过代理模式实现客户端负载均衡,不依赖于客户端应用程序自身的负载均衡逻辑。服务网格中的每个服务实例都有一个独立的代理(如Envoy),由代理负责处理所有的服务发现和负载均衡逻辑。

- 优点:语言无关,适用于多种编程语言的微服务应用。代理独立运行,不会因为负载均衡器的故障影响服务实例的稳定性。

- 缺点:引入了额外的代理层,增加了系统的复杂性和资源消耗。需要配置和维护代理组件,增加了运维成本。

代理负载均衡器

工作原理

代理负载均衡器运行在与服务实例相同的节点上,但作为一个独立的进程。它接收客户端的请求,并根据负载均衡策略将请求转发到适当的服务实例。代理负载均衡器可以与服务实例共享同一个网络名称空间,从而实现高效的本地通信。

优点

- 语言无关:代理负载均衡器不受编程语言的限制,可以支持多种语言的微服务应用。

- 独立性:代理负载均衡器与服务实例独立运行,不会因为负载均衡器的故障影响服务实例的稳定性。

实际应用

- Istio:作为一个开源的服务网格框架,Istio通过Envoy代理来管理服务间的流量和通信,提供了全面的负载均衡、服务发现和流量管理功能。

- Linkerd:另一个流行的服务网格框架,提供类似的功能,通过独立的代理层实现客户端负载均衡。

地域与区域

主要概念

地域与区域(Region and Zone)是云计算中的两个基本概念,也是分布式系统和微服务架构中的重要元素。在分布式系统中,合理使用地域和区域能够显著提高系统的可用性、可靠性和性能。

- 地域(Region):地域指的是地理上的大范围区域,例如华北、华东、华南等。一个地域通常包含多个数据中心。

- 区域(Zone):区域是地域内的一个独立的物理位置,具有独立的电力和网络设施。区域之间通过高速内网连接,可以实现低延迟的数据交换。

地域与区域的作用

在大型分布式系统中,地域和区域的概念用于优化系统的地理分布,从而达到以下目的:

- 提高可用性:通过在多个区域甚至多个地域部署服务,当某个区域或地域发生故障时,其他区域或地域的服务可以继续工作,确保系统的高可用性。

- 降低延迟:将服务部署在靠近用户的区域,减少物理距离带来的网络延迟,提高用户的访问速度。

- 容灾备份:利用多个地域和区域进行数据备份和容灾,在一个区域或地域发生灾难性故障时,其他区域或地域的数据可以作为备份恢复,确保数据的安全性和系统的连续性。

历史背景

地域和区域的概念最早由云计算先驱亚马逊AWS提出,并被广泛应用于云计算服务中。随着云计算的普及,地域和区域的概念逐渐渗透到分布式系统和微服务架构中,成为现代大型系统设计中的重要考虑因素。

技术细节

Region(地域)

地域是地理上的大范围区域,例如华北、华东、华南等。面向全球或全国的大型系统通常会将服务集群部署在多个不同的地域,以缩短用户与服务器之间的物理距离,从而提升响应速度。

- 特点:不同地域之间没有内网连接,所有流量只能通过公众互联网连接。因此,集群内部流量通常不会跨地域传输,服务发现和负载均衡器默认不支持跨地域的服务发现和负载均衡。

- 应用场景:面向全国或全球用户的系统需要在多个地域部署,以减少网络延迟,提升用户体验。例如,一个面向全球用户的电商平台可以在亚洲、美洲、欧洲等地域部署数据中心,为各地用户提供低延迟的访问服务。

Zone(区域)

区域是地域内的一个独立的物理位置,具有独立的电力和网络设施。区域之间通过高速内网连接,可以实现低延迟的数据交换。

- 特点:同一个地域内的区域之间通过内网连接,流量不占用公网带宽,因此区域是微服务集群内流量能够触及的最大范围。

- 应用场景:为了实现高可用性和低延迟,系统可以将服务实例部署在同一个地域的多个区域内。当一个区域发生故障时,其他区域的服务实例可以继续工作,确保系统的可用性。同时,内部流量在区域间传输时不会受到公网带宽的限制,能够保证低延迟的数据交换。

多区域部署的优势

高可用性

为了提高系统的高可用性,可以将服务部署在多个区域中。当某个区域发生故障(如电力中断、骨干网络中断)时,其他区域的服务可以继续运行,从而确保系统的整体可用性。

- 异地容灾:通过在不同区域之间进行数据备份,实现异地容灾。当一个区域发生灾难性故障时,其他区域的数据可以用来恢复,确保数据的安全性和系统的连续性。

- 异地双活:在多个区域内同时运行服务实例,实现异地双活。这样,即使一个区域发生故障,其他区域的服务也能继续处理请求,提供无缝的用户体验。

低延迟

为了降低网络延迟,可以将系统的所有服务都部署在同一个区域中。尽管内网连接不受限于公网带宽,但机房之间的专线容量有限,难以与机房内部的交换机相比,延时也受物理距离和网络跳点数量等因素影响。因此,将服务部署在同一区域内能够显著减少延迟,提高系统性能。

- 时间敏感应用:对于对时间有高要求的应用(如金融交易系统、网络游戏服务器等),低延迟是至关重要的。将这些应用的服务实例部署在同一区域内,可以最大限度地减少网络延迟,提高用户体验。

进一步细分区域

在一些场景中,即使是同一个区域内的机房,也可能存在不同的子网络。因此,部分微服务框架提供了Group、Sub-zone等参数进行进一步的细分控制。这些参数的意思通常是加权或优先访问同一个子区域的服务,但如果子区域中没有合适的服务实例,则仍然会访问到区域中的其他服务。

- 应用场景:将服务发现的区域设置与Kubernetes的标签、选择器配合,实现内部服务请求其他服务时,优先使用同一个节点中提供的服务进行应答,以降低真实的网络消耗。通过这种方式,可以优化虚拟化基础设施流量,提高系统的性能和可靠性。

实际应用

云计算中的地域与区域

在云计算中,地域和区域是基础设施设计的基本单元。例如,亚马逊AWS、谷歌云平台和微软Azure等云服务提供商都使用地域和区域来组织其数据中心和服务。

- 亚马逊AWS:AWS将其全球数据中心划分为多个地域(Region),每个地域内又包含多个可用区(Availability Zone)。每个可用区是一个或多个数据中心的集合,具有独立的电力和网络设施。

- 谷歌云平台:谷歌云平台(GCP)也采用类似的设计,将数据中心分布在多个地域和区域内。GCP的每个地域包含多个区域,区域之间通过高速内网连接,实现低延迟的数据交换。

- 微软Azure:微软Azure的全球基础设施同样划分为多个地域和区域,每个地域包含多个数据中心和可用区,通过内网实现高效的数据传输和服务交付。

自建数据中心中的地域与区域

对于一些中小型的微服务系统,尤其是非互联网的企业信息系统,很多没有使用云计算设施,而是部署在某个专有机房内部。这种情况下,仍然可以借鉴云计算中的地域和区域概念,优化系统的设计和部署。

- 应用场景:将服务发现的区域设置与Kubernetes的标签、选择器配合,实现内部服务请求其他服务时,优先使用同一个节点中提供的服务进行应答,以降低真实的网络消耗。通过这种方式,可以在自建数据中心中实现高效的资源利用和流量优化。

结论

地域和区域是分布式系统设计中的关键概念,通过合理利用地域和区域,可以显著提高系统的可用性、可靠性和性能。在实际应用中,可以根据系统需求和业务场景,选择适合的地域和区域策略,优化系统的地理分布,确保系统的高效运行和用户体验。无论是基于云计算平台还是自建数据中心,地域和区域的合理配置都是构建可靠的大型分布式系统的重要步骤。

常见问题及解决方案

资源消耗:客户端负载均衡器与服务实例共享资源,可能导致资源竞争问题。

- 解决方案:合理配置资源限制,优化负载均衡算法,减少不必要的资源开销。通过监控和调整资源使用情况,确保负载均衡器和服务实例之间的资源分配合理。

网络安全:内部网络安全和信任关系复杂,容易受到攻击。

- 解决方案:通过网络隔离、访问控制和安全审计等措施,加强内部网络的安全性。采用加密通信和身份验证机制,保护数据传输的安全。

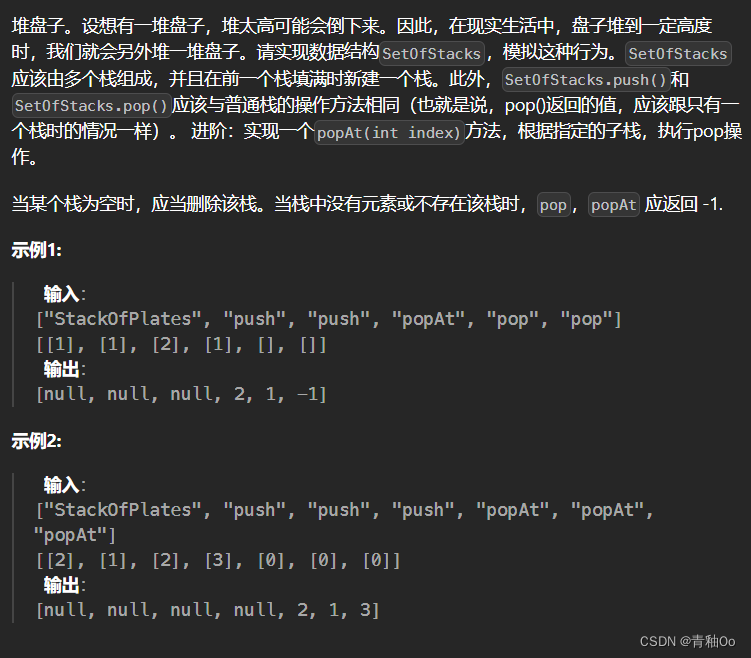

服务实例动态管理:客户端负载均衡器需要持续跟踪服务实例的健康状态,以实现动态负载均衡。

- 解决方案:使用高效的健康检查机制和服务注册中心,减少轮询服务注册中心的频率,优化健康检查策略。结合负载均衡策略动态调整请求路由,确保服务实例的高可用性和可靠性。

结论

客户端负载均衡是分布式系统中的一种重要技术,通过将负载均衡逻辑集成到客户端,提高了系统的灵活性和可靠性。不同的客户端负载均衡框架各有优缺点,选择适合的框架需要根据具体需求进行权衡。代理负载均衡器作为客户端负载均衡的一种变体,提供了更高的灵活性和独立性,适用于多种编程语言的微服务应用。总之,客户端负载均衡的有效实现对于构建可靠的大型分布式系统至关重要。