回归问题初探:神经元模型解析

回归问题是机器学习中的一种基础且重要的问题,它关注的是预测连续数值型输出。在深度学习领域,回归问题通常通过神经元模型来解决。本文将深入探讨神经元模型的数学原理、优化方法以及在回归问题中的应用。

一、引言

在人工智能领域,尤其是深度学习中,神经元模型作为构建复杂神经网络的基础,起着至关重要的作用。通过模拟人脑神经元的工作机制,我们可以构建出能够学习和模拟复杂函数的数学模型。回归问题作为神经元模型的一个重要应用,其目标是预测一个连续值,如房价、股价等。

二、神经元模型的数学原理

2.1 单输入神经元模型

单输入神经元模型是最简单的神经元模型,它通过一个线性变换和一个非线性激活函数来预测输出。数学表达式如下:

[ w^T w + b ]

其中,( w ) 是输入权重,( b ) 是偏置项,( w^T ) 表示 ( w ) 的转置。

2.2 多输入神经元模型

多输入神经元模型可以处理更复杂的数据,它通过多个输入和相应的权重以及偏置项来计算输出:

[ y = w_1 x_1 + w_2 x_2 + … + w_n x_n + b ]

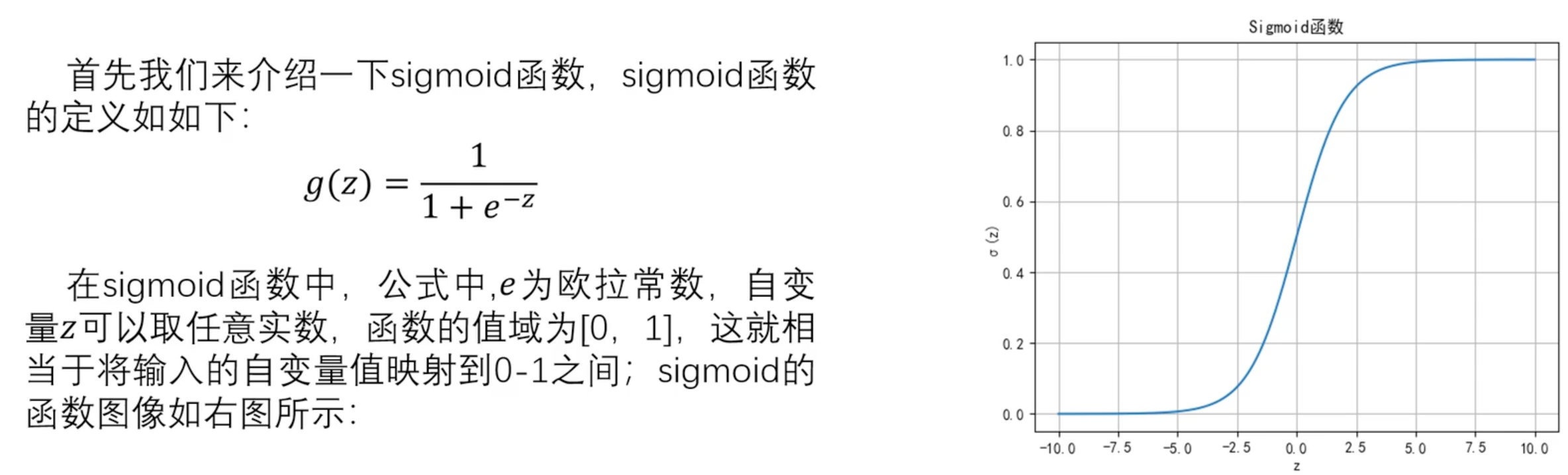

2.3 激活函数

激活函数是神经元模型中的关键部分,它引入了非线性,使得模型能够学习和模拟更加复杂的函数。常见的激活函数包括Sigmoid、ReLU等。

三、优化方法

3.1 梯度下降法

梯度下降法是优化神经元模型参数最常用的方法。通过计算损失函数关于模型参数的梯度,并更新参数来最小化损失函数。

3.2 损失函数

均方误差(MSE)是回归问题中最常用的损失函数,定义为:

[ MSE = \frac{1}{n} \sum_{i=1}^{n} (y_i - \hat{y}_i)^2 ]

其中,( y_i ) 是真实值,( \hat{y}_i ) 是预测值。

四、线性模型实战

4.1 数据采样

在实战中,我们首先需要从真实模型中采样数据,以便于训练我们的神经元模型。

# 假设真实模型为 w*x + b + epsilon

w_true = 1.477

b_true = 0.089

# 采样数据点

def sample_data(n_samples):

X = np.random.uniform(-10, 10, n_samples)

Y = w_true * X + b_true + np.random.normal(0, 0.1, n_samples)

return X, Y

4.2 模型搭建

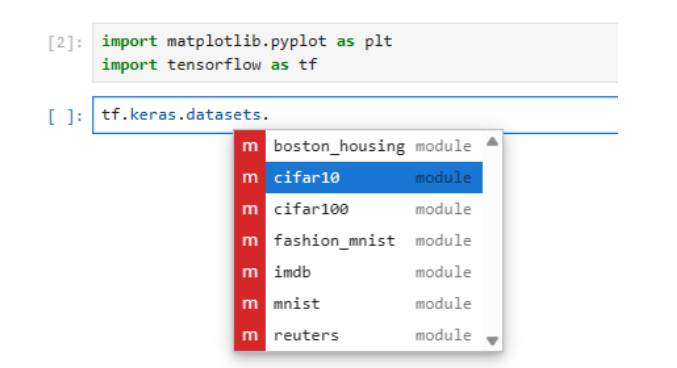

接着,我们需要搭建我们的神经元模型。在TensorFlow中,这可以通过几行代码轻松完成。

import tensorflow as tf

# 初始化参数

w_init = tf.random.normal([n_inputs, n_outputs])

b_init = tf.random.normal([n_outputs])

# 定义模型

def neuron_model(X, w, b):

return tf.matmul(X, w) + b

4.3 损失函数与优化器

我们定义MSE作为损失函数,并使用梯度下降法作为优化器。

# 定义损失函数

def mse_loss(y_true, y_pred):

return tf.reduce_mean(tf.square(y_true - y_pred))

# 定义优化器

optimizer = tf.optimizers.SGD(learning_rate=0.01)

4.4 训练模型

最后,我们通过迭代训练来更新模型参数。

# 训练模型

for epoch in range(n_epochs):

# 清空梯度

optimizer.zero_grad()

# 前向传播

with tf.GradientTape() as tape:

predictions = neuron_model(X, w_init, b_init)

loss = mse_loss(Y, predictions)

# 反向传播

gradients = tape.gradient(loss, [w_init, b_init])

# 更新参数

optimizer.apply_gradients(zip(gradients, [w_init, b_init]))

# 打印损失

if epoch % 100 == 0:

print(f"Epoch {epoch}, Loss: {loss.numpy()}")

五、非线性模型

线性模型在很多情况下是不够的,我们需要非线性模型来捕捉更复杂的数据关系。通过引入激活函数,我们的神经元模型可以扩展到非线性模型。

5.1 激活函数的选择

ReLU、Sigmoid和Tanh是几种常见的激活函数,它们各自有不同的特点和适用场景。

5.2 非线性模型的搭建

在TensorFlow中,我们可以通过添加激活函数层来构建非线性模型。

# 定义带有激活函数的神经元模型

def neuron_model_with_activation(X, w, b, activation):

return activation(tf.matmul(X, w) + b)

六、过拟合与欠拟合

在模型训练过程中,我们可能会遇到过拟合或欠拟合的问题。过拟合意味着模型在训练集上表现很好,但在未知数据上表现差;欠拟合则是模型无法捕捉数据的基本规律。

6.1 正则化技术

为了解决过拟合问题,我们可以使用L1或L2正则化技术。

6.2 Dropout技术

Dropout是另一种常用的防止过拟合的技术,它在训练过程中随机丢弃一部分神经元。

七、模型评估

在模型训练完成后,我们需要对模型进行评估,以确保其泛化能力。

7.1 性能指标

常用的性能指标包括准确率、召回率、F1分数等。

7.2 交叉验证

交叉验证是一种评估模型泛化能力的方法,将数据集分成多份并进行多次训练和验证。

八、参考文献

在本文的编写过程中,以下参考文献提供了宝贵的信息和理论支持:

- LeCun, Y., Bottou, L., Bengio, Y., & Haffner, P. (1998). Gradient-based learning applied to document recognition. Proceedings of the IEEE, 86(11), 2278-2324.

- 尼克. (2017). 人工智能简史. 图灵教育.