参考:

https://ollama.com/download/linux

https://doc.fastai.site/docs/intro/

https://blog.csdn.net/m0_71142057/article/details/136738997

https://doc.fastgpt.run/docs/development/custom-models/m3e/

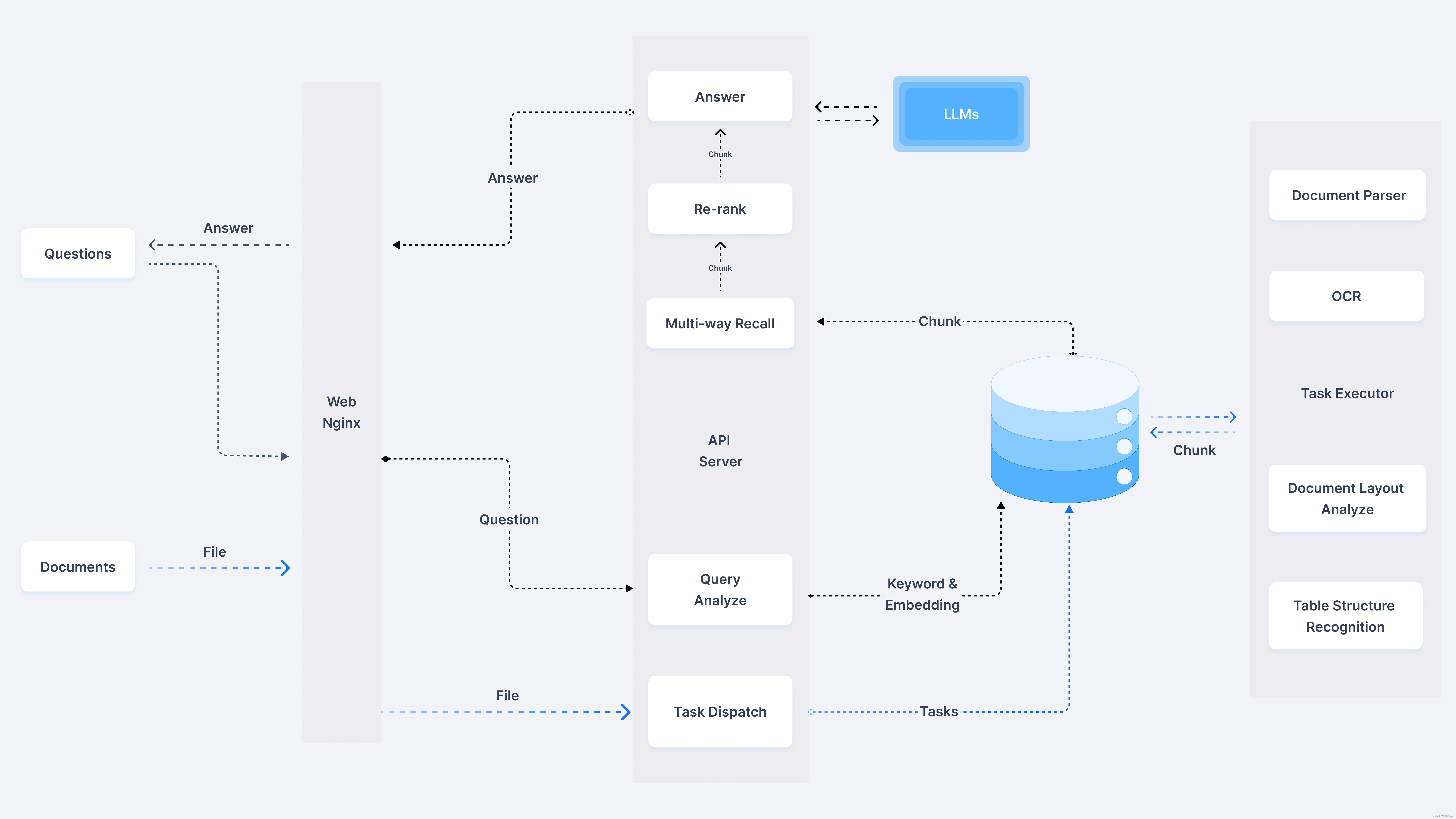

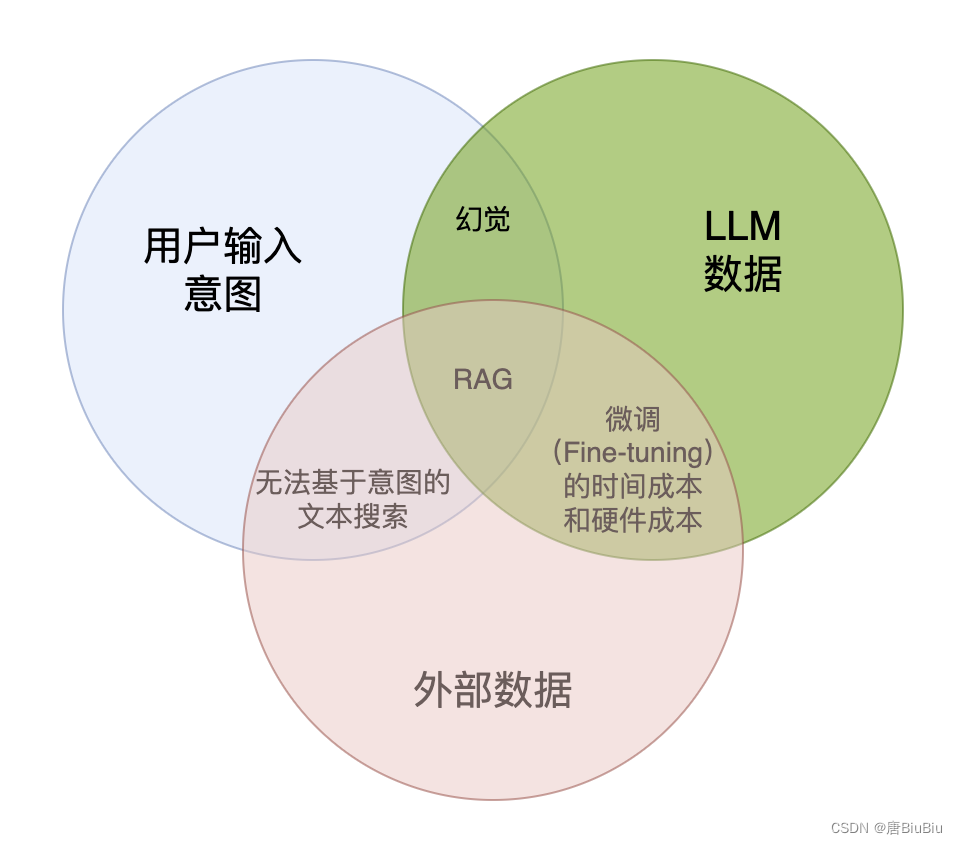

Ollama作为后端大模型加载运行

FastGPT作为前端页面聊天集成RAG框架

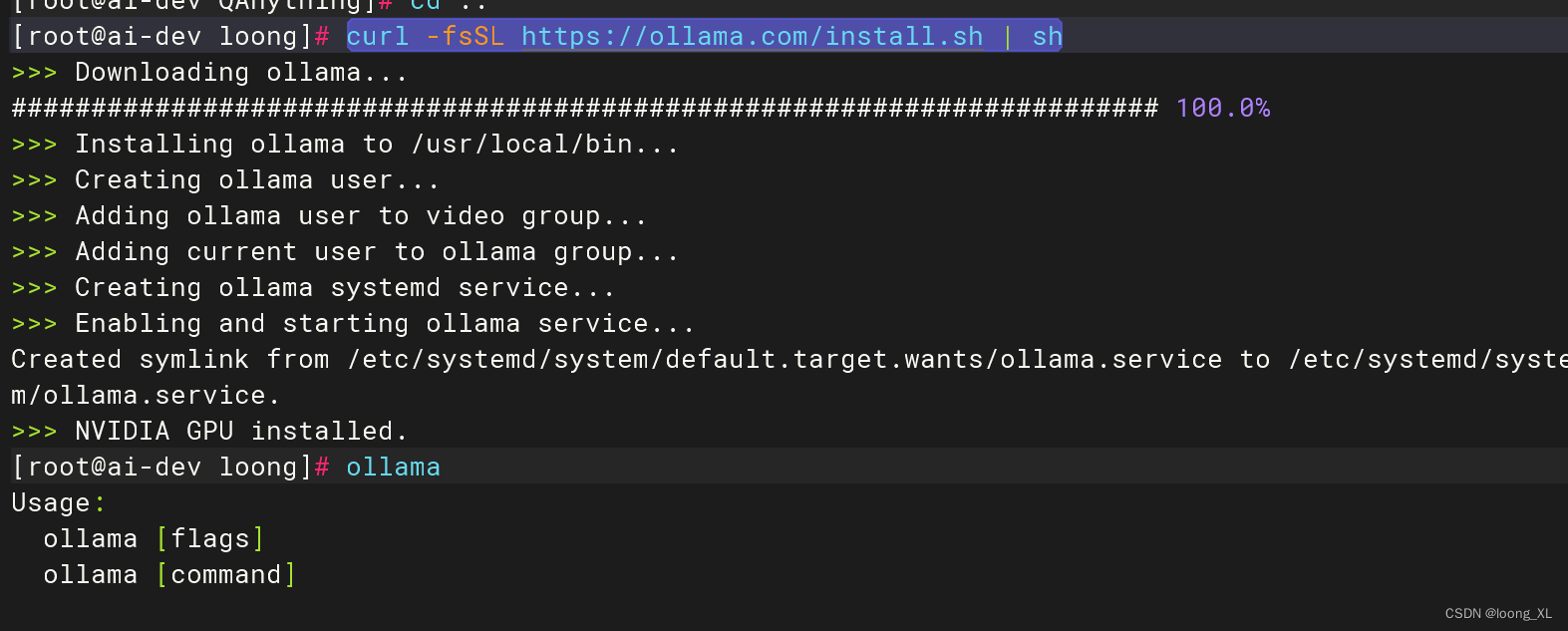

1、Ollama linux运行

ollama linux安装:

curl -fsSL https://ollama.com/install.sh | sh

ollama服务启动停止

sudo systemctl status ollama # check the status of the service

sudo systemctl stop ollama # kill

sudo systemctl start ollama # restart

远程访问需要服务器提前设置