在深度学习训练中,num_workers是一个常见的参数,特别是在使用数据加载器(如PyTorch的DataLoader)时。num_workers指定了用于数据加载的子进程数量。这个参数对于提高数据加载的效率和加速训练过程至关重要。

num_workers的作用:

并行数据加载:当设置

num_workers大于0时,数据加载器将创建指定数量的子进程,用于并行读取数据。这意味着,而不是让训练过程等待数据被顺序加载(这会在CPU和GPU之间造成空闲时间),多个工作器可以同时准备数据批次,大大减少了等待时间。提高GPU利用率:通过减少数据加载的时间,

num_workers有助于更好地利用GPU。当GPU训练模型时,可以同时有数据在后台被准备,从而尽可能地保持GPU忙碌,避免GPU等待CPU加载和预处理数据。适应系统资源:

num_workers的最佳值取决于具体的系统配置(如CPU核心数量、内存大小)和数据集的特性。设置得太低可能无法充分利用系统资源,设置得太高可能会导致资源争夺,导致效率降低。通常,实践中需要根据具体情况进行调整。

注意事项:

内存使用:增加

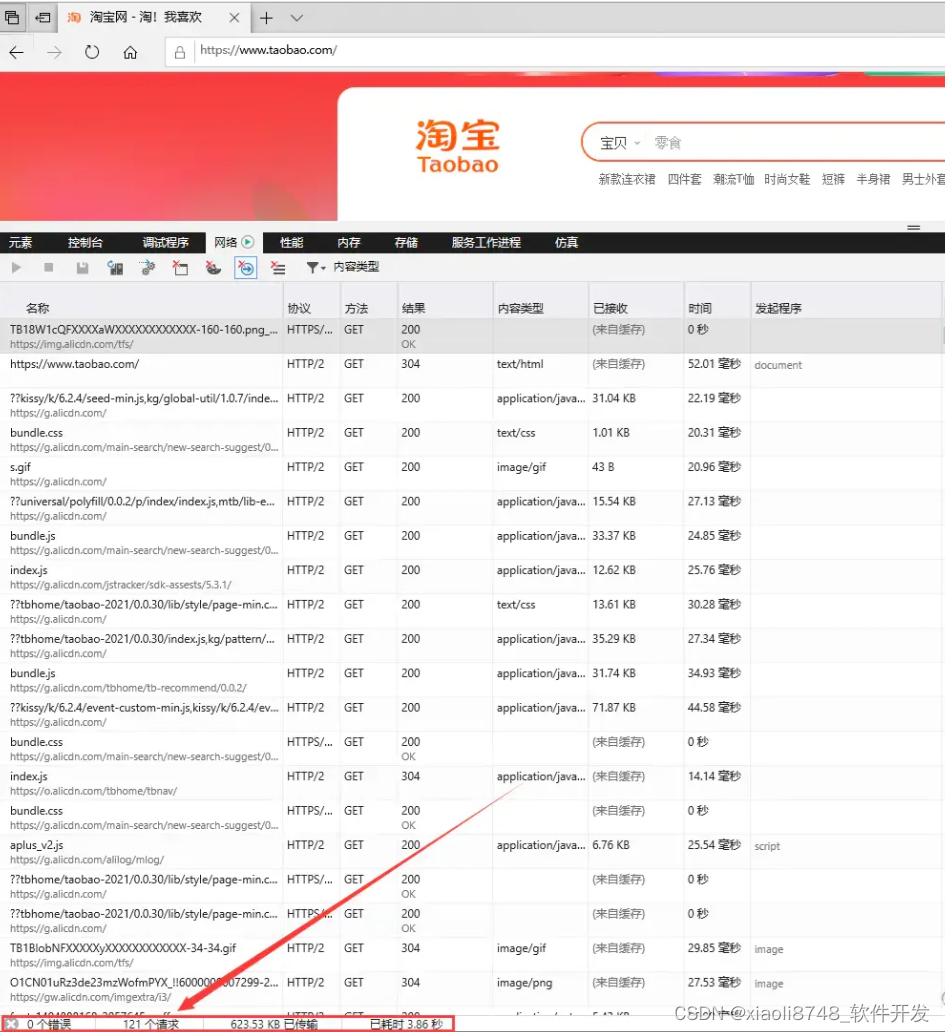

num_workers将增加内存使用量,因为每个工作进程都需要占用一定的内存来存储数据。如果内存有限,设置过高的num_workers可能会导致内存溢出。I/O限制:如果数据存储在硬盘驱动器(HDD)而非固态硬盘(SSD)上,或者使用的是网络文件系统,I/O速度可能成为瓶颈。在这种情况下,增加

num_workers可能不会带来预期的加速效果。

综上所述,num_workers是一个重要的性能调优参数,在深度学习训练中合理设置它可以显著提高数据加载的速度和训练效率。理想的num_workers值需要根据实际的硬件配置和数据集进行实验和调整。