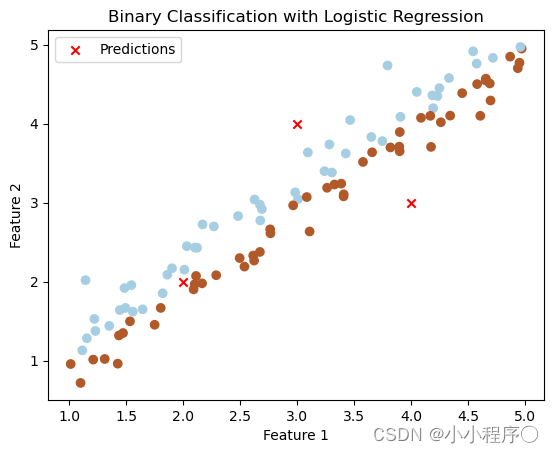

逻辑回归是一种用于解决分类问题的统计学习方法,它基于概率理论,将输入特征与输出类别之间的关系建模为一个概率分布。逻辑回归模型可以用不同的方法来表示,其中包括:

1. **基本逻辑回归模型**:最简单的逻辑回归模型假设输出是由输入特征的线性组合经过一个sigmoid函数(也称为逻辑函数)转换得到的,常见的形式如下:

\[ P(y=1 | \mathbf{x}) = \frac{1}{1 + e^{-\mathbf{w}^T\mathbf{x} - b}} \]

2. **多项式逻辑回归**:当特征之间的关系不是线性的时候,可以考虑使用多项式逻辑回归,通过引入高阶项来拟合数据。

3. **正则化逻辑回归**:为了防止过拟合,可以在逻辑回归模型中引入正则化项,常见的有L1正则化和L2正则化,得到的模型分别称为L1逻辑回归和L2逻辑回归。

4. **多分类逻辑回归**:逻辑回归最初是用于二分类问题的,但是可以通过一对多(one-vs-rest)或者多对多(many-vs-many)的策略来解决多分类问题。

5. **逻辑回归树**:逻辑回归树是一种结合了决策树和逻辑回归的方法,它通过构建决策树来对输入数据进行分段,然后在每个叶节点上应用逻辑回归模型。

6. **贝叶斯逻辑回归**:贝叶斯逻辑回归将贝叶斯思想引入逻辑回归模型中,通过对参数引入先验分布来进行参数估计。

以上是逻辑回归模型的一些常见形式,根据具体的问题和数据特点,可以选择合适的模型来建模和预测。

不同类型的逻辑回归模型在应用场景上有所差异,下面是它们各自的主要使用场景:

1. **基本逻辑回归模型**:

- 适用于二分类问题,特征与输出之间的关系近似为线性关系时效果较好。

- 例如:垃圾邮件分类、疾病诊断等。

2. **多项式逻辑回归**:

- 适用于特征之间存在高阶关系时,能够更好地拟合非线性数据。

- 例如:图像分类、自然语言处理中的情感分析等。

3. **正则化逻辑回归**:

- 适用于数据特征较多、容易过拟合的情况,通过加入正则化项可以提高模型的泛化能力。

- 当数据量较小或者特征之间存在共线性时,也可以考虑使用正则化逻辑回归。

- 例如:金融风控中的信用评分模型、文本分类等。

4. **多分类逻辑回归**:

- 适用于多分类问题,可以通过一对多或多对多的策略来解决。

- 例如:手写数字识别、文本分类等。

5. **逻辑回归树**:

- 适用于数据具有明显分段特点的情况,能够更好地捕捉数据的非线性关系。

- 例如:客户流失预测、信用评分模型等。

6. **贝叶斯逻辑回归**:

- 适用于需要考虑参数的先验分布情况,以及需要进行参数估计的情况。

- 例如:医学诊断、金融风险评估等。

根据数据的特点、问题的要求以及模型的复杂度等因素,可以选择适合的逻辑回归模型来建立分类模型。