机器学习——LightGBM算法

摘要: LightGBM是一种高效的梯度提升框架,它在处理大规模数据时表现出色,并且具有较快的训练速度和较低的内存消耗。本文将介绍LightGBM算法的原理、特点以及与传统GBDT算法的区别,并使用Python对其进行实现和应用。

1. LightGBM简介

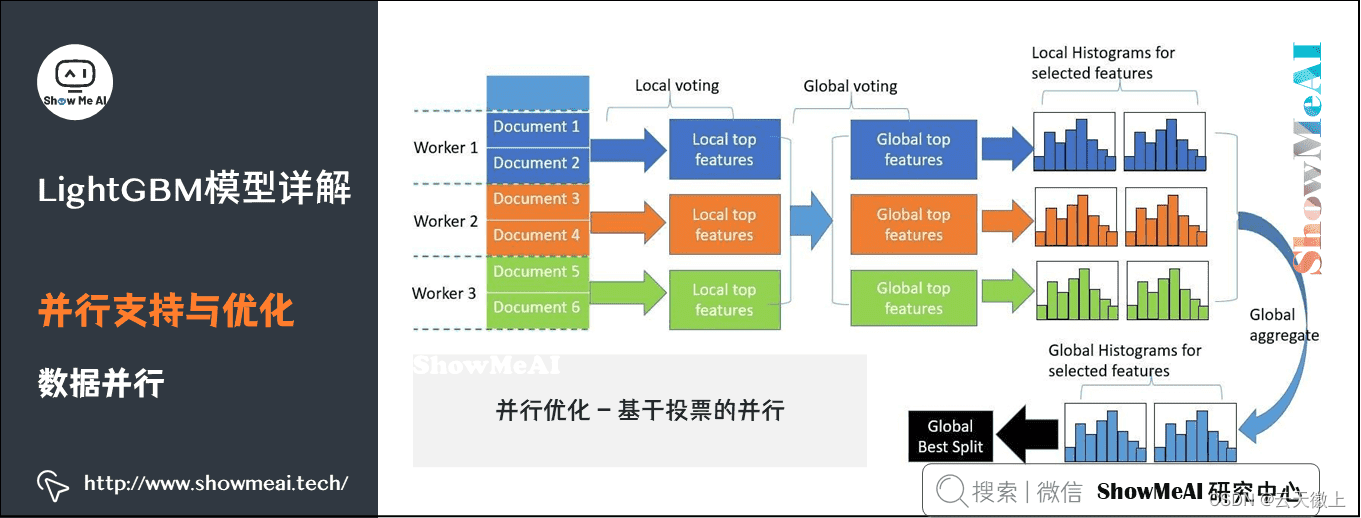

LightGBM是一种基于梯度提升框架的机器学习算法,由微软团队开发。相比于传统的梯度提升决策树(GBDT)算法,LightGBM具有更高的训练效率和更低的内存消耗,尤其适用于大规模数据集。

2. LightGBM的特点

2.1 直方图算法

LightGBM采用直方图算法来优化决策树的构建过程。直方图算法将数据按照特征的直方图进行分桶,然后在分桶上进行决策树的构建,减少了对原始数据的扫描次数,从而提高了训练速度。

2.2 互斥特征绑定

LightGBM支持互斥特征绑定,即将一组互斥的特征绑定在一起进行分桶,从而减少了特征的数量,降低了模型的复杂度,提高了泛化能力。

2.3 类别特征处理优化

在处理类别特征时,LightGBM采用了一种更高效的方法,可以直接将类别特征的取值转化为数值特征,而无需进行独热编码等处理,节省了内存空间。

2.4 梯度单边采样策略

LightGBM引入了梯度单边采样策略,即只考虑正向梯度或负向梯度,从而降低了样本采样的复杂度,提高了训练速度。

2.5 Cache命中率优化

LightGBM通过缓存命中率优化,将内存中的数据块分配到不同的线程中,并通过预先加载数据块来提高数据的访问效率,减少了内存访问的开销。

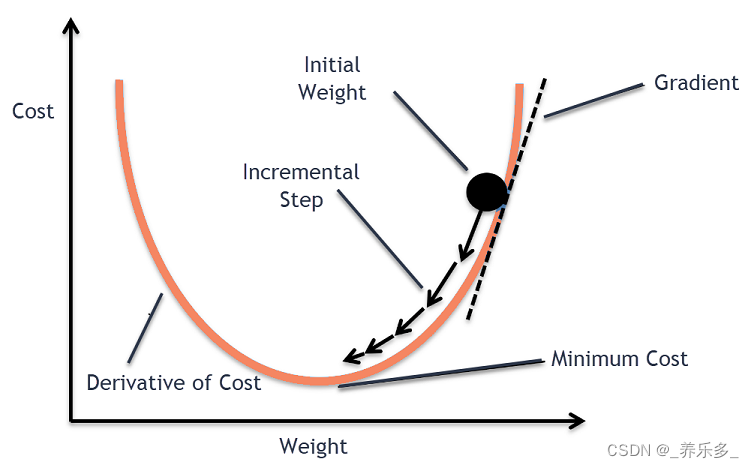

3. LightGBM算法原理

3.1 目标函数定义和求解

LightGBM的目标函数包括损失函数和正则项,通过梯度提升算法来优化目标函数,求得最优的模型参数。具体地,目标函数的定义如下:

Objective ( θ ) = ∑ i = 1 n l ( y i , y ^ i ) + ∑ k = 1 K Ω ( f k ) \text{Objective}(\theta) = \sum_{i=1}^{n} l(y_i, \hat{y}_i) + \sum_{k=1}^{K} \Omega(f_k) Objective(θ)=i=1∑nl(yi,y^i)+k=1∑KΩ(fk)

其中, l ( y i , y ^ i ) l(y_i, \hat{y}_i) l(yi,y^i)表示损失函数, Ω ( f k ) \Omega(f_k) Ω(fk)表示正则项, f k f_k fk表示第 k k k 棵树的复杂度。

3.2 结点分裂算法

LightGBM采用了基于直方图的结点分裂算法,将数据按特征的直方图进行分桶,然后通过贪心法来选择最优的分裂点,从而构建出更加准确的决策树。

3.3 缺失值处理

对于缺失值,LightGBM将其作为一种特殊的取值,可以直接参与结点分裂过程,并且不需要对缺失值进行特殊处理。

4. Python实现与应用

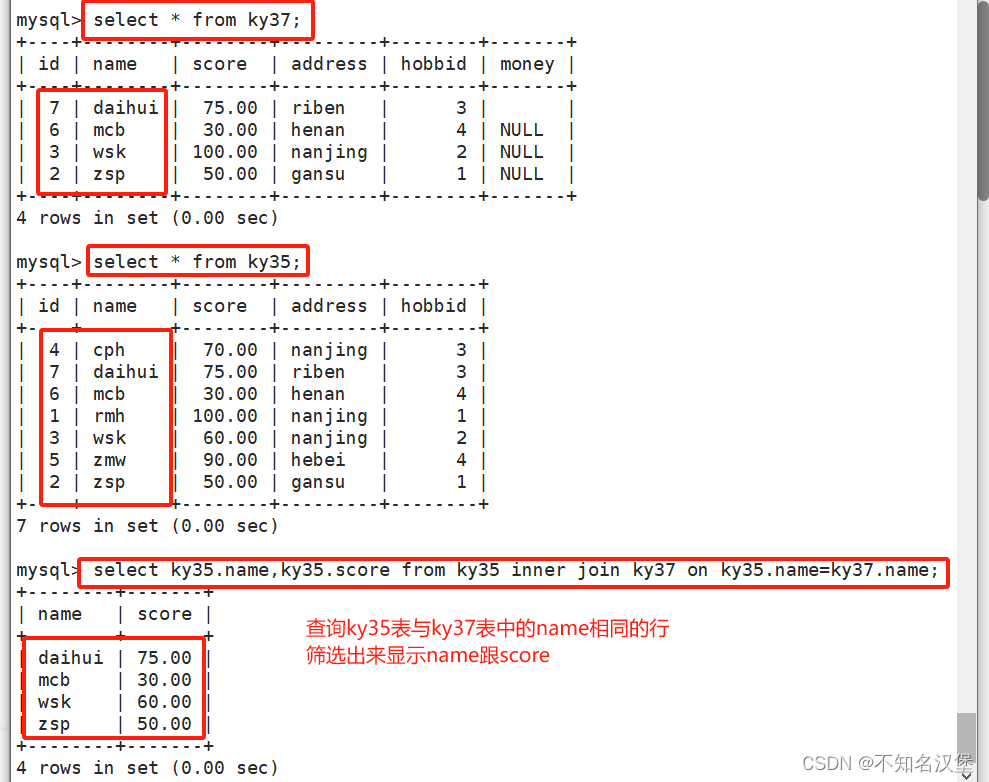

下面是使用Python对LightGBM算法进行实现和应用的示例代码:

import lightgbm as lgb

from sklearn.datasets import load_iris

from sklearn.model_selection import train_test_split

from sklearn.metrics import confusion_matrix

import seaborn as sns

import matplotlib.pyplot as plt

import numpy as np

# 加载数据集

iris = load_iris()

X, y = iris.data, iris.target

# 划分训练集和测试集

X_train, X_test, y_train, y_test = train_test_split(X, y, test_size=0.2, random_state=42)

# 构建LightGBM分类器

params = {'objective': 'multiclass', 'num_class': 3, 'random_state': 42}

train_data = lgb.Dataset(X_train, label=y_train)

test_data = lgb.Dataset(X_test, label=y_test, reference=train_data)

clf = lgb.train(params, train_data, num_boost_round=100, valid_sets=[test_data]) #, early_stopping_rounds=10

# 在测试集上进行预测

y_pred = clf.predict(X_test, num_iteration=clf.best_iteration)

y_pred = np.argmax(y_pred, axis=1)

# 计算混淆矩阵

conf_matrix = confusion_matrix(y_test, y_pred)

# 可视化混淆矩阵

plt.figure(figsize=(8, 6))

sns.heatmap(conf_matrix, annot=True, fmt='d', cmap='Blues', xticklabels=iris.target_names, yticklabels=iris.target_names)

plt.title('Confusion Matrix')

plt.xlabel('Predicted labels')

plt.ylabel('True labels')

plt.show()

使用confusion_matrix函数计算混淆矩阵,并使用seaborn库中的heatmap函数来绘制混淆矩阵的可视化图形。然后通过plt.show()将图形显示出来。

5. 总结

本文介绍了LightGBM算法的原理、特点和应用,包括直方图算法、互斥特征绑定、类别特征处理优化、梯度单边采样策略、Cache命中率优化等内容。通过Python实现了LightGBM算法,并在鸢尾花数据集上进行了模型训练和评估。LightGBM是一种高效的梯度提升框架,可以有效地处理大规模数据,是机器学习领域中的重要工具之一。