“Fleiss’s κ score” 是指由统计学家Joseph L. Fleiss提出的统计量,用于评估多名评估者对分类问题的一致性或一致程度。它通常用于评估多个评估者对相同样本进行分类的程度。Fleiss’s κ score 是一种在多个评估者之间评估分类一致性的可靠性指标。

κ(kappa)系数的一般形式用于衡量两个评价者之间的一致性。Fleiss’s κ score 的扩展版本考虑了多个评价者的情况。

Fleiss’s κ score 的计算方法基于评价者对每个样本进行的分类的比例以及预期分类的比例。这个比例的比较可以给出一个关于评价者之间一致性程度的度量。

Fleiss’s κ score 的取值范围是从-1到1,具体含义如下:

1 表示完全一致。

0 表示评估者的分类结果与随机分类没有差别。

-1 表示完全不一致。

一般来说,Fleiss’s κ score 越接近1,评估者之间的一致性就越高。

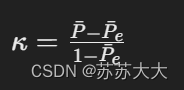

Fleiss’s κ score 的计算公式如下:

其中:

是评估者对所有样本的分类一致的比例的平均值,即所有评估者对每个样本的分类的比例的平均值。

是评估者对所有样本的分类一致的比例的平均值,即所有评估者对每个样本的分类的比例的平均值。

是评估者对所有样本分类一致的比例的期望值。它是通过计算每个分类的比例的平均值的平均值来得到的。

是评估者对所有样本分类一致的比例的期望值。它是通过计算每个分类的比例的平均值的平均值来得到的。

如果 κ 的值为1,则表示评估者的一致性完美。如果 κ 的值为0,则表示评估者的分类结果与随机分类没有差别。如果 κ 的值为-1,则表示评估者之间的分类结果完全不一致。

需要注意的是,Fleiss’s κ score 可以应用于多个评估者对多个分类的情况。

![[Diffusion Model 笔记]<span style='color:red;'>Score</span> based](https://img-blog.csdnimg.cn/direct/47c46dbc397d431a8623b806f9d3f580.png)

![[Netty实践] 请求响应同步实现](https://img-blog.csdnimg.cn/direct/8335f7cf0f5d4111a9ef0afea2f48a25.png)