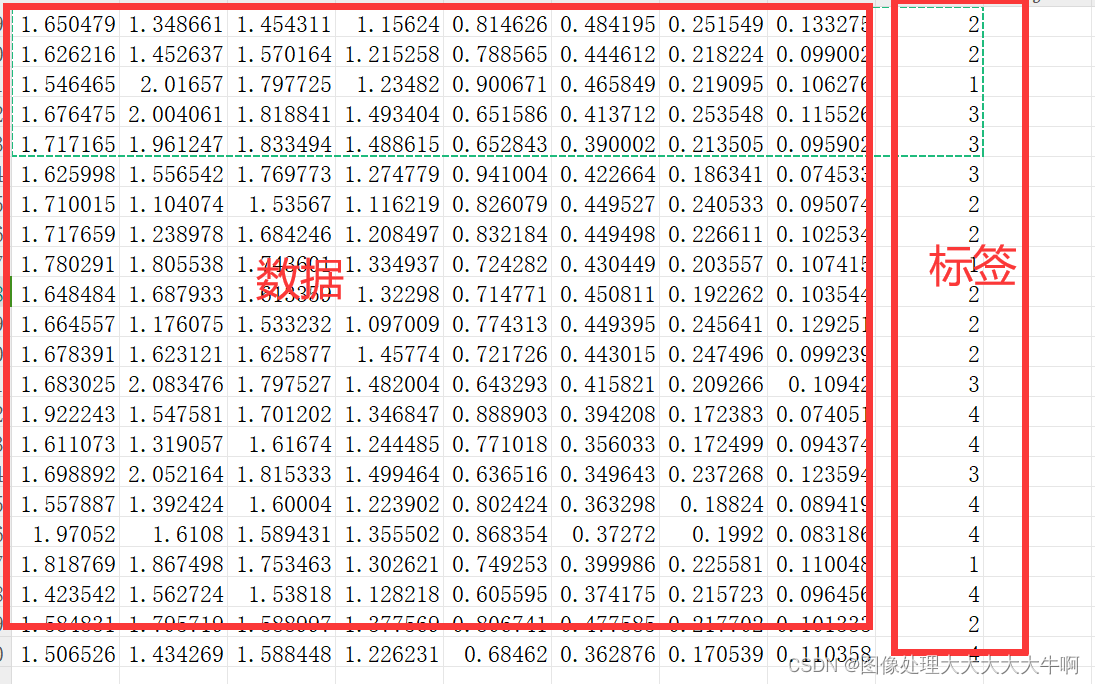

1. 基础公式

这里就是有两个 3 3 3 通道的卷积核;或者理解成有 6 6 6 个 3 × 3 3×3 3×3。

从下图中可发现:偏置数量=输出通道数;卷积核种类=输出通道数。

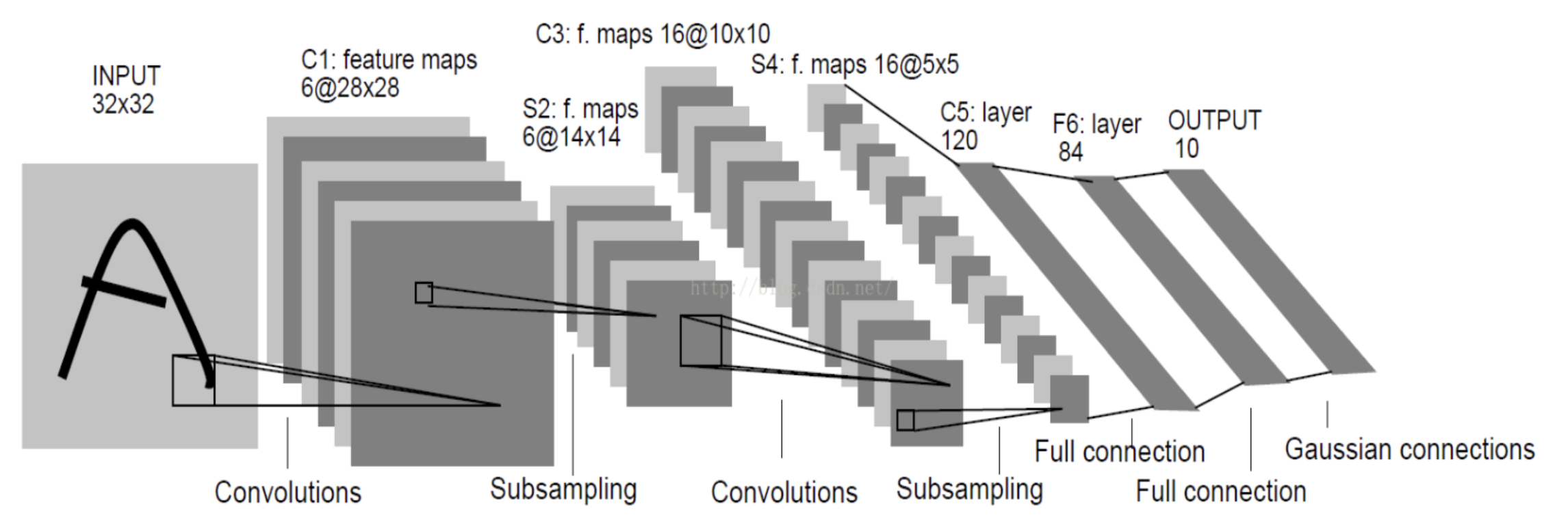

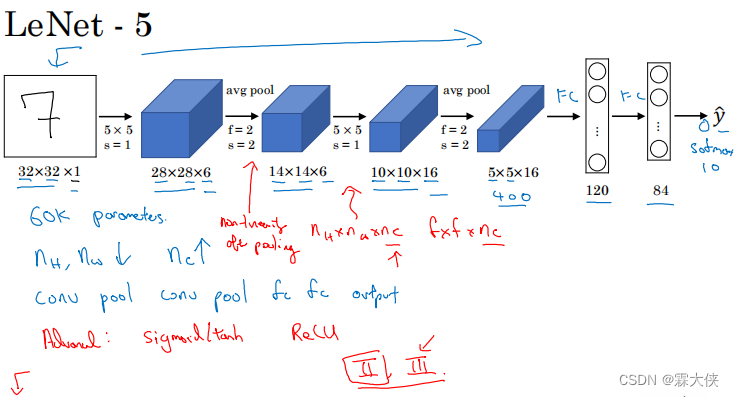

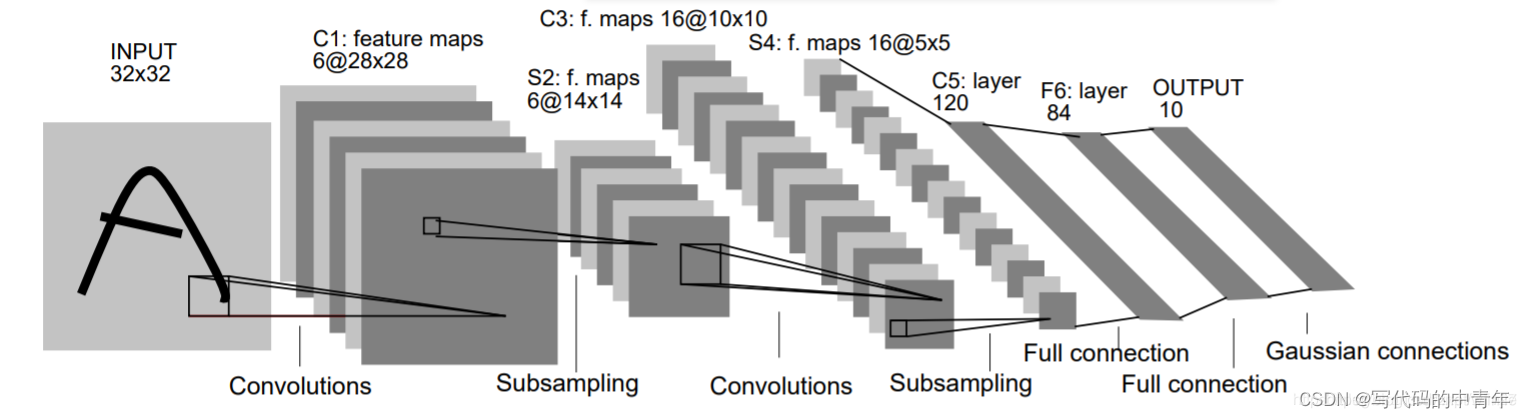

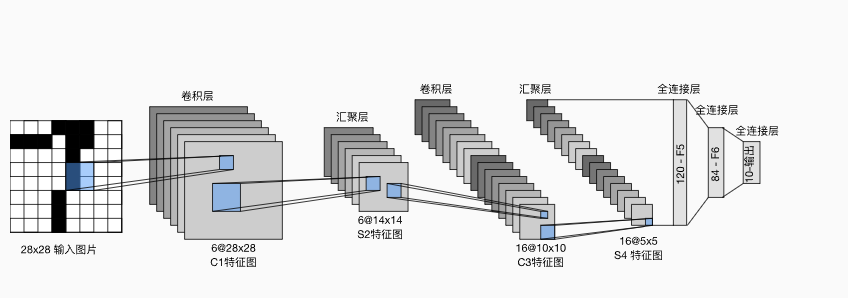

2. 以LeNet5为案例分析

2.1 架构图

2.2 C1层

输入图片大小: 32 ∗ 32 32*32 32∗32

卷积窗大小: 5 ∗ 5 5*5 5∗5

卷积窗种类: 6 6 6

输出特征图数量:6

输出特征图大小: 28 ∗ 28 28*28 28∗28

神经元数量: 4704 4704 4704, [ ( 28 ∗ 28 ) ∗ 6 ) ] [(28*28)*6)] [(28∗28)∗6)]

连接数: 12304 12304 12304, [ ( 5 ∗ 5 + 1 ) ] ∗ [ 6 ∗ ( 28 ∗ 28 ) ] [(5*5+1)]*[6*(28*28)] [(5∗5+1)]∗[6∗(28∗28)]

可训练参数: 156 156 156, [ ( 5 ∗ 5 ) ∗ ( 1 ∗ 6 ) + 6 ] [(5*5)*(1*6)+6] [(5∗5)∗(1∗6)+6]

注解:

(1) ( 32 − 5 ) + 1 = 28 (32-5)+1=28 (32−5)+1=28

(2) 一个 28 ∗ 28 28*28 28∗28 的输出特征图,上面每一个结果的得到都经过一个神经元。即一个神经元对应一个输出,与像素点个数相同。

(3) 连接数按我们老师上课讲的,就先看一次卷积,加 1 1 1 是偏置,再乘上神经元数。

(4) 可训练参数套公式就可以。

2.3 S2层

输入图片大小: ( 28 ∗ 28 ) ∗ 6 (28*28)*6 (28∗28)∗6

卷积窗大小: 2 ∗ 2 2*2 2∗2

卷积窗种类: 6 6 6

输出下采样图数量: 6 6 6

输出下采样图大小: 14 ∗ 14 14*14 14∗14

神经元数量: 1176 1176 1176, ( 14 ∗ 14 ) ∗ 6 (14*14)*6 (14∗14)∗6

连接数: 5880 5880 5880, ( 2 ∗ 2 + 1 ) ∗ [ ( 14 ∗ 14 ) ∗ 6 ] (2*2+1)*[(14*14)*6] (2∗2+1)∗[(14∗14)∗6]

可训练参数: 12 12 12, ( 6 ∗ 2 ) (6*2) (6∗2)

注解:

(1) 步长为 2 2 2。

(2) 一个池化对应两个参数。

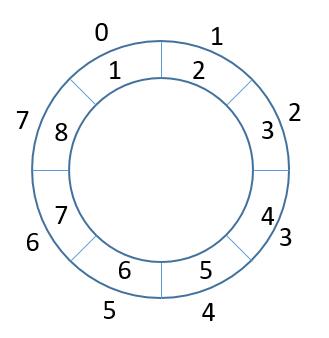

2.4 C3层

输入图片大小: ( 14 ∗ 14 ) ∗ 6 (14*14)*6 (14∗14)∗6

卷积窗大小: 5 ∗ 5 5*5 5∗5

卷积窗种类: 16 16 16

输出特征图数量: 16 16 16

输出特征图大小: 10 ∗ 10 10*10 10∗10

神经元数量: 1600 1600 1600, [ ( 10 ∗ 10 ) ∗ 16 ) ] [(10*10)*16)] [(10∗10)∗16)]

连接数: 151600 151600 151600, [ ( 60 + 16 ) ] ∗ 25 ∗ ( 10 ∗ 10 ) [(60+16)]*25*(10*10) [(60+16)]∗25∗(10∗10) (部分连接)

可训练参数: 1516 1516 1516, [ ( 60 + 16 ) ∗ 25 ] [(60+16)*25] [(60+16)∗25]

注解:

(1) ( 14 − 10 ) + 1 = 5 (14-10)+1=5 (14−10)+1=5

(2) 按照正常思维,卷积核的数量有 6 × 16 6×16 6×16 个,数量太大。这里早期设计改为了部分连接,有 60 60 60 个卷积核。

(3) 连接数的计算如下。每一个像素点的得到,都经过卷积,一个卷积核大小 5 × 5 5×5 5×5,共 60 60 60 个卷积核;一个 10 × 10 10×10 10×10 图像共用一个偏置,有 16 16 16 个图像,所以偏置数为 1 × 10 × 10 × 16 1×10×10×16 1×10×10×16。

2.5 S4层

输入图片大小: ( 10 ∗ 10 ) ∗ 16 (10*10)*16 (10∗10)∗16

卷积窗大小: 2 ∗ 2 2*2 2∗2

卷积窗种类: 16 16 16

输出下采样图数量: 16 16 16

输出下采样图大小: 5 ∗ 5 5*5 5∗5

神经元数量: 400 400 400, ( 5 ∗ 5 ) ∗ 16 (5*5)*16 (5∗5)∗16

连接数: 2000 2000 2000, ( 2 ∗ 2 + 1 ) ∗ [ ( 14 ∗ 14 ) ∗ 16 ] (2*2+1)*[(14*14)*16] (2∗2+1)∗[(14∗14)∗16]

可训练参数: 32 32 32, ( 16 ∗ 2 ) (16*2) (16∗2)

注解:步长为 2 2 2。

2.6 C5层

输入图片大小: ( 5 ∗ 5 ) ∗ 16 (5*5)*16 (5∗5)∗16

卷积窗大小: 5 ∗ 5 5*5 5∗5

卷积窗种类: 120 120 120

输出特征图数量: 120 120 120

输出特征图大小: 1 ∗ 1 1*1 1∗1

神经元数量: 120 120 120, 120 ∗ ( 1 ∗ 1 ) 120*(1*1) 120∗(1∗1)

连接数: 48120 48120 48120, [ 16 ∗ 25 + 1 ] ∗ 1 ∗ 120 ( 全连接) [16*25+1]*1*120(全连接) [16∗25+1]∗1∗120(全连接)

注解:

(1) 120 120 120 个向量或点。

(2) 每个 1 × 1 1×1 1×1 的输出与前面的 16 16 16 个卷积核都有连接, 16 16 16 个卷积求和后加一个偏置。

2.7 F6层

输入图片大小: ( 1 ∗ 1 ) ∗ 120 (1*1)*120 (1∗1)∗120

卷积窗大小: 1 ∗ 1 1*1 1∗1

卷积窗种类: 84 84 84

输出特征图数量: 84 84 84

输出特征图大小: 1 1 1

神经元数量: 84 84 84

连接数: 10164 10164 10164, ( 120 + 1 ) ∗ 84 ( 全连接 ) (120+1)*84(全连接) (120+1)∗84(全连接)

可训练参数: 10164 10164 10164, 120 ∗ 84 + 84 120*84+84 120∗84+84

2.8 OUTPUT层:

输入向量: 84 84 84

输出向量: 10 10 10