1、GlusterFS简介。

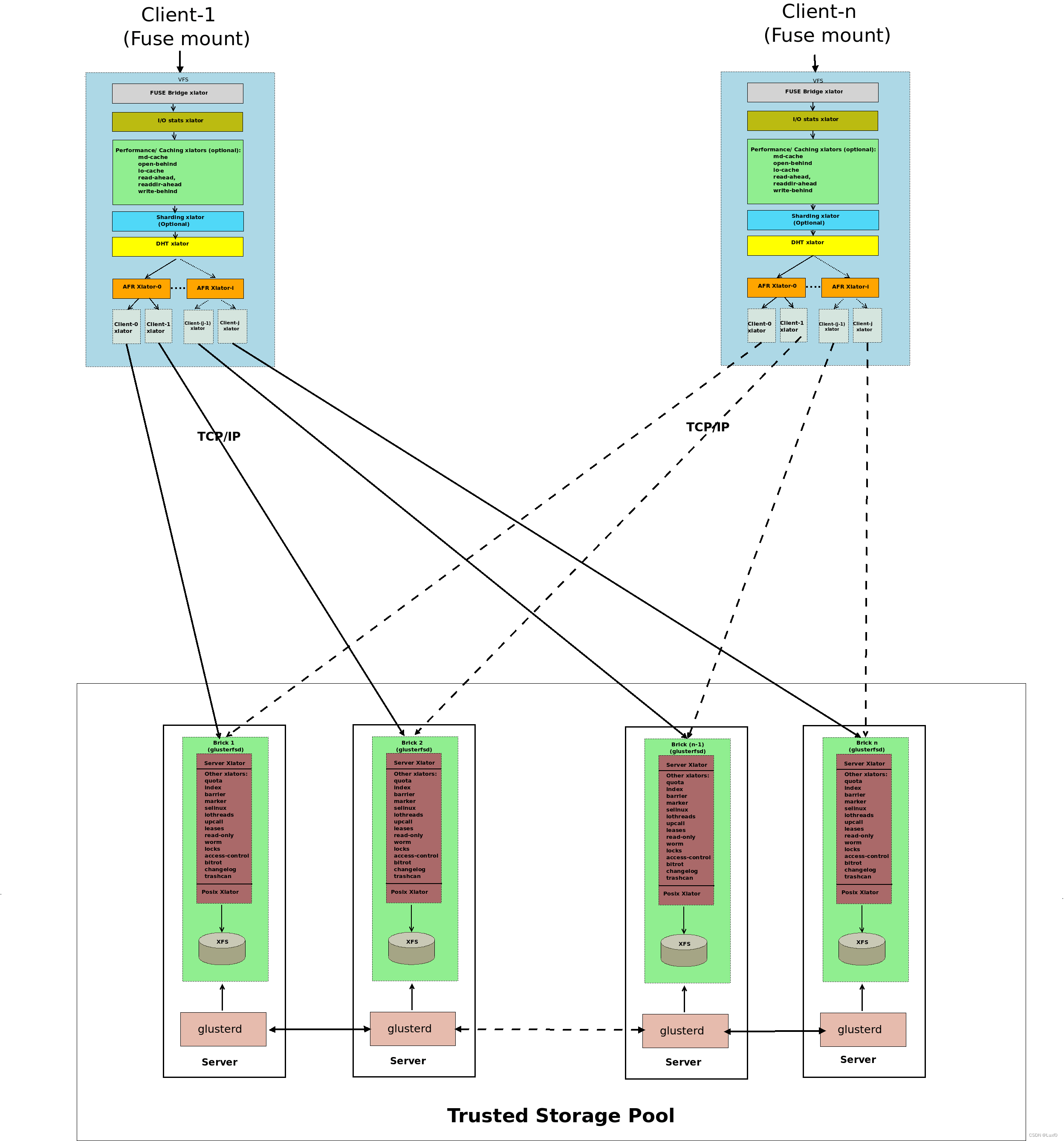

GlusterFS是一个开源的分布式文件系统,同时也是Scale-Out存储解决方案Gluster的核心,在存储数据方面具有强大的横向扩展能力,通过开展不同的节点可以支持数PB级别的存储容量。

1.2、GlusterFS的特点。

扩展性和高性能、高可用性、全局统一命名空间、弹性卷管理、基于标准协议。

1.3、GlusterFS术语。

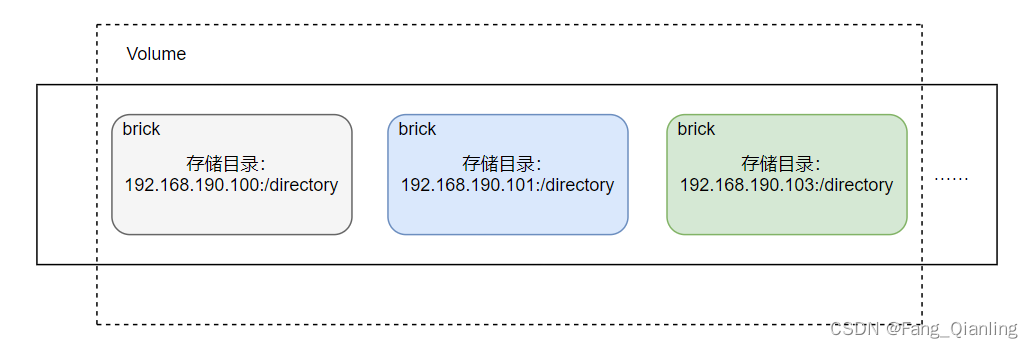

Brick(存储块):指可信主机池中由主机提供的用于物理存储的专用分区,是GlusterFS中的基本存储单元,同时也是可信存储池中服务器上对外提供的存储目录。

Volume(逻辑卷):一个逻辑卷是一组Brick的集合。

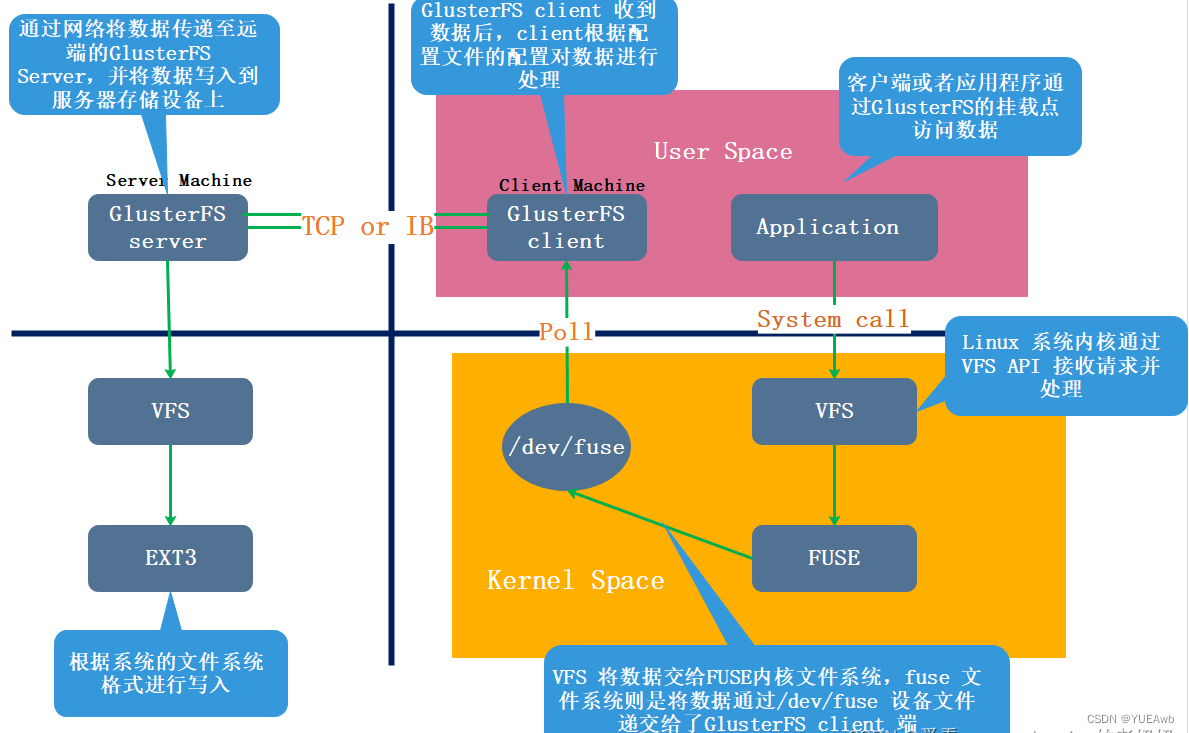

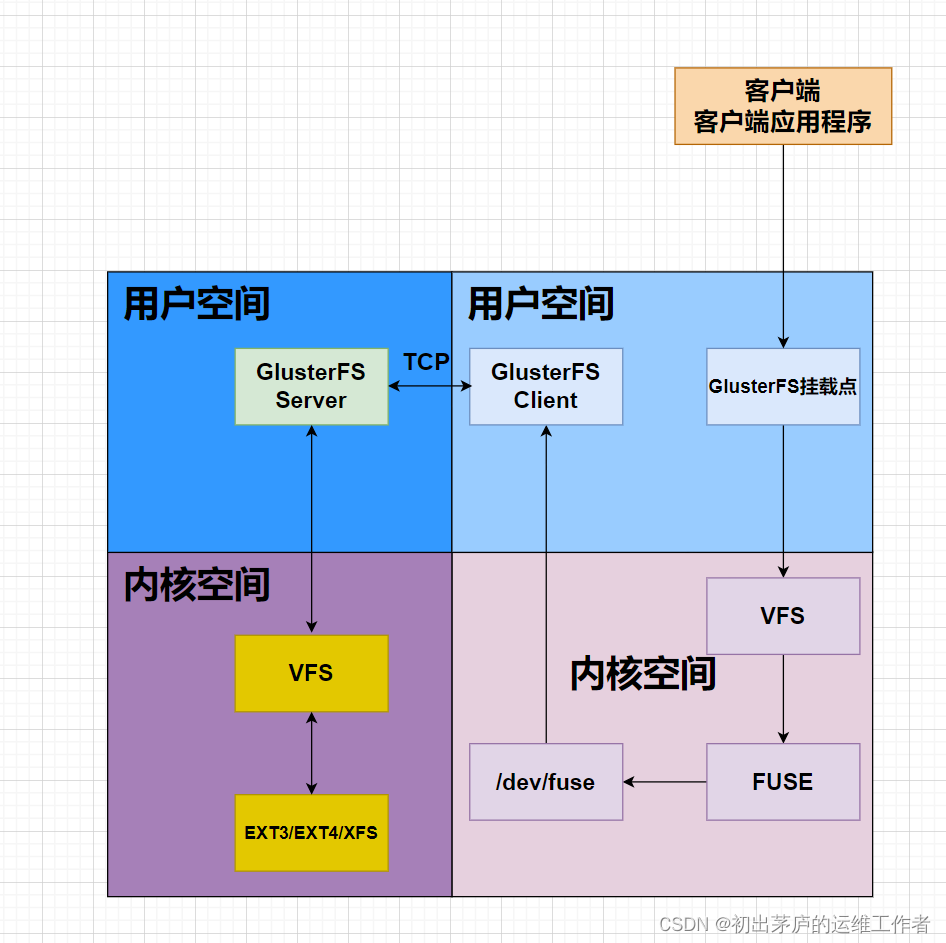

FUSE:是一个内核模块,允许用户创建自己的文件系统,无须修改内核代码。

VFS:内核空间对用户空间提供的访问磁盘的接口。

Glusterd(后台管理进程):在存储群集中的每个节点上都要运行。

1.4、GlusterFS的卷类型。

分布式卷、条带卷、复制卷、分布式条带卷、分布式复制卷、分布式条带复制卷

2、GlusterFS部署

组件包:Glusterfs、Glusterfs-server、Glusterfs-fuse、Glusterfs-rdma

设备 |

IP |

备注 |

Centos01 |

192.168.136.10 |

Node1 |

Centos02 |

192.168.136.20 |

Node2 |

Centos03 |

192.168.136.30 |

Node3 |

Centos04 |

192.168.136.40 |

Node4 |

2.1、初始化配置

( node1和node2同时进行操作 )

磁盘初始化及自动挂载

[root@node1 ~]# fdisk -l

磁盘 /dev/sdb:3221 MB, 3221225472 字节,6291456 个扇区

设备 Boot Start End Blocks Id System

/dev/sdb1 2048 6291455 3144704 83 Linux磁盘 /dev/sdc:4294 MB, 4294967296 字节,8388608 个扇区

设备 Boot Start End Blocks Id System

/dev/sdc1 2048 8388607 4193280 83 Linux磁盘 /dev/sdd:5368 MB, 5368709120 字节,10485760 个扇区

设备 Boot Start End Blocks Id System

/dev/sdd1 2048 10485759 5241856 83 Linux磁盘 /dev/sde:6442 MB, 6442450944 字节,12582912 个扇区

设备 Boot Start End Blocks Id System

/dev/sde1 2048 12582911 6290432 83 Linux格式化文件系统

[root@node1 ~]# mkfs.xfs /dev/sdb1[root@node1 ~]# mkfs.xfs /dev/sdc1

[root@node1 ~]# mkfs.xfs /dev/sdd1

[root@node1 ~]# mkfs.xfs /dev/sde1

创建挂载目录

[root@node1 ~]# mkdir /b3 /c4 /d5 /e6

分别挂载到对应目录

[root@node1 ~]# mount /dev/sdb1 /b3[root@node1 ~]# mount /dev/sdc1 /c4

[root@node1 ~]# mount /dev/sdd1 /d5

[root@node1 ~]# mount /dev/sde1 /e6

修改配置文件自动挂载

[root@node1 ~]# vim /etc/fstab

/dev/sdb1 /b3 xfs defaults 0 0

/dev/sdc1 /c4 xfs defaults 0 0

/dev/sdd1 /d5 xfs defaults 0 0

/dev/sde1 /e6 xfs defaults 0 0

( node3和node4同时进行操作 )

磁盘初始化及自动挂载

[root@node1 ~]# fdisk -l

磁盘 /dev/sdb:3221 MB, 3221225472 字节,6291456 个扇区

设备 Boot Start End Blocks Id System

/dev/sdb1 2048 6291455 3144704 83 Linux磁盘 /dev/sdc:4294 MB, 4294967296 字节,8388608 个扇区

设备 Boot Start End Blocks Id System

/dev/sdc1 2048 8388607 4193280 83 Linux磁盘 /dev/sdd:5368 MB, 5368709120 字节,10485760 个扇区

设备 Boot Start End Blocks Id System

/dev/sdd1 2048 10485759 5241856 83 Linux格式化文件系统

[root@node1 ~]# mkfs.xfs /dev/sdb1[root@node1 ~]# mkfs.xfs /dev/sdc1

[root@node1 ~]# mkfs.xfs /dev/sdd1

创建挂载目录

[root@node1 ~]# mkdir /b3 /c4 /d5

分别挂载到对应目录

[root@node1 ~]# mount /dev/sdb1 /b3[root@node1 ~]# mount /dev/sdc1 /c4

[root@node1 ~]# mount /dev/sdd1 /d5

修改配置文件自动挂载

[root@node1 ~]# vim /etc/fstab

/dev/sdb1 /b3 xfs defaults 0 0

/dev/sdc1 /c4 xfs defaults 0 0

/dev/sdd1 /d5 xfs defaults 0 0

( 仅在node1上进行操作 )

搭建本地yun安装源;安装httpd服务,将yum仓库移动到/var/www/html/目录下

[root@node1 ~]# yum -y install httpd

[root@node1 ~]# cd /var/www/html/

[root@node1 html]# ls

gfs-9[root@node1 ~]# systemctl start httpd

创建repo文件夹

[root@node1 ~]# yum -y install createrepo

[root@node1 ~]# cd /var/www/html/

[root@node1 html]# createrepo gfs-9/

修改yum配置文件

[root@node1 ~]# vim /etc/yum.repos.d/local.repo

[dvd]

name=dvd

baseurl=file:///mnt

enabled=1

gpgcheck=0[gfs]

name=gfs

baseurl=http://192.168.136.10/gfs-9

enabled=1

gpgcheck=0将本地yum配置文件复制到其他三台设备

[root@node1 ~]# scp /etc/yum.repos.d/local.repo root@192.168.136.20:/etc/yum.repos.d/local.repo[root@node1 ~]# scp /etc/yum.repos.d/local.repo root@192.168.136.30:/etc/yum.repos.d/local.repo

[root@node1 ~]# scp /etc/yum.repos.d/local.repo root@192.168.136.40:/etc/yum.repos.d/local.repo

2.2、安装GFS。

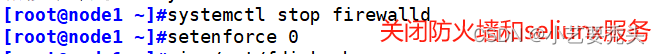

( 四台设备同时进行操作 )

配置本地主机解析

[root@node1 ~]# vim /etc/hosts

192.168.136.10 node1

192.168.136.20 node2

192.168.136.30 node3

192.168.136.40 node4[root@node1 ~]# yum -y install glusterfs glusterfs-server glusterfs-fuse glusterfs-rdma

启动GFS服务

[root@node1 ~]# systemctl start glusterd

node1添加其他节点 node2 node3 node4[root@node1 ~]# gluster peer probe node1

[root@node1 ~]# gluster peer probe node2

[root@node1 ~]# gluster peer probe node3

[root@node1 ~]# gluster peer probe node4

查看节点信息[root@node1 ~]# gluster peer status

Number of Peers: 3Hostname: node2

Uuid: f63752ca-fb3d-4d61-bffa-bdf5433776d2

State: Peer in Cluster (Disconnected)Hostname: node3

Uuid: 01d485a0-bcd2-47f8-8f1c-05caea591d3f

State: Peer in Cluster (Disconnected)Hostname: node4

Uuid: 934c5f9c-0eb8-48e1-942c-bd3eabc8b43d

State: Peer in Cluster (Disconnected)