目标

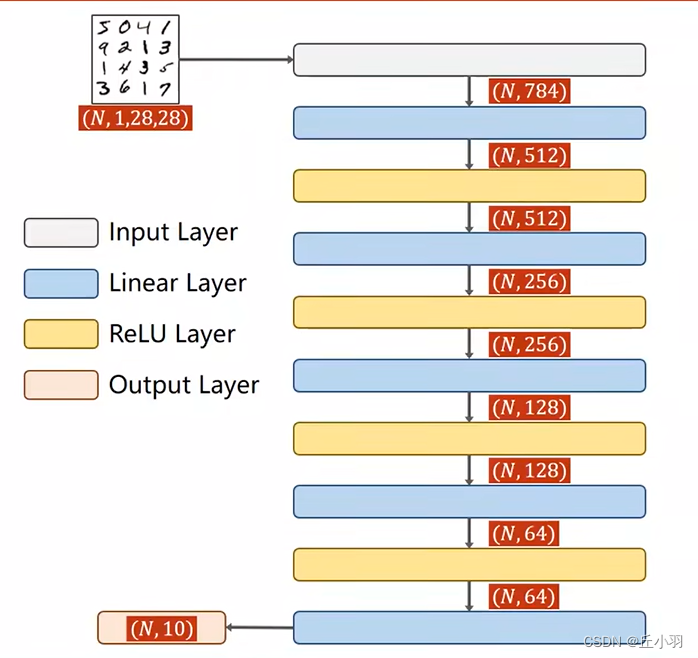

选择合适的神经网络

卷积神经网络(CNN):我们处理图片、视频一般选择CNN

循环神经网络(RNN):我们处理时序数据一般选择RNN

超参数的设置

为什么训练的模型的错误率居高不下

如何调测出最优的超参数

就是要不断循环调测

各个超参数的重要程度

调参策略

提升CNN的泛化能力

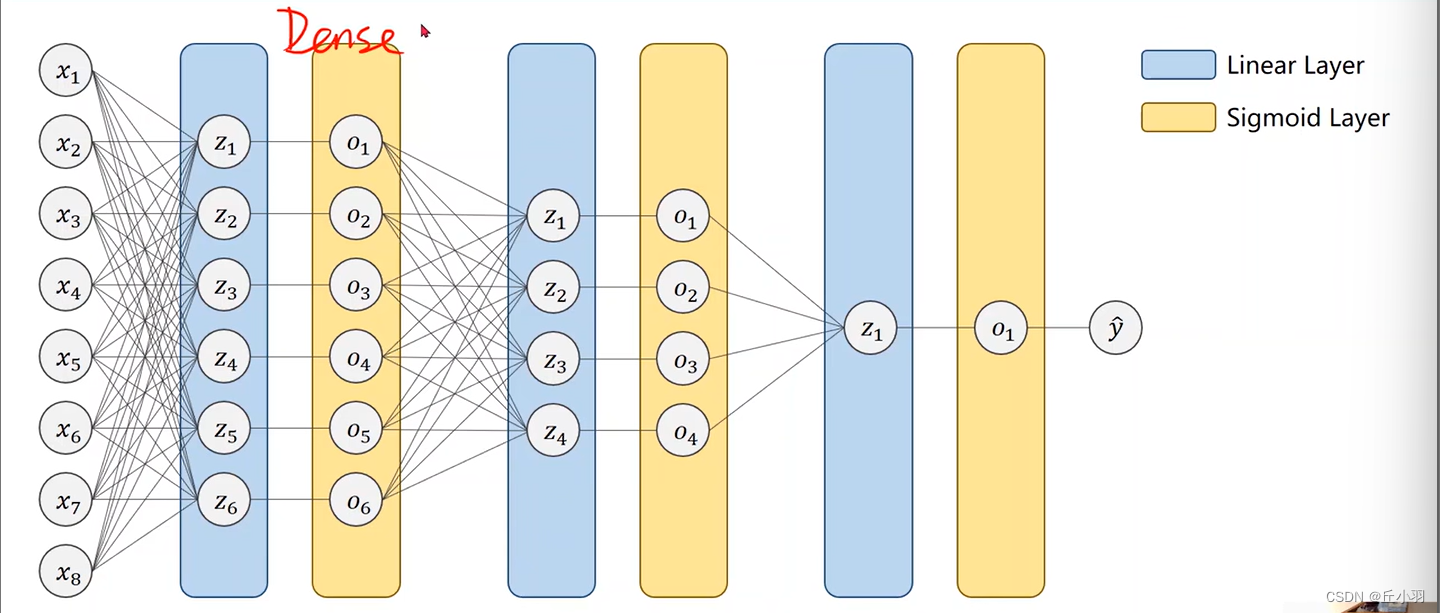

激活函数的选择

常见的激活函数包括:

sigmoid函数:将输入映射到0到1之间。

tanh函数:将输入映射到-1到1之间。

ReLU函数:修正线性单元,将负值映射为0。

Leaky ReLU:修正线性单元的改进版本,在负值时有一个小的斜率,避免ReLU的神经元死亡问题。

损失函数的选择

常见的损失函数包括但不限于:

均方误差(Mean Squared Error, MSE): 适用于回归任务,计算预测值与真实值之间的平方差。

交叉熵损失(Cross-Entropy Loss): 适用于多分类任务,衡量模型输出的概率分布与真实标签之间的差异,常见的有分类交叉熵和二元交叉熵。

对数损失(Log Loss): 也称为二元交叉熵损失,通常用于二分类问题,特别是在逻辑回归模型中。

Hinge损失: 主要用于支持向量机(SVM)中,帮助实现最大间隔分类。

Huber损失: 对异常值较为鲁棒的回归损失函数,结合了均方误差和绝对误差的优点。

自定义损失函数: 根据具体问题的特性和需求,可以设计和使用特定的损失函数。

选择合适的损失函数取决于任务的性质和数据的分布,能够最大程度地提高模型的性能和泛化能力。