使用 vllm 本地部署 cohere 的 command-r

0. 引言

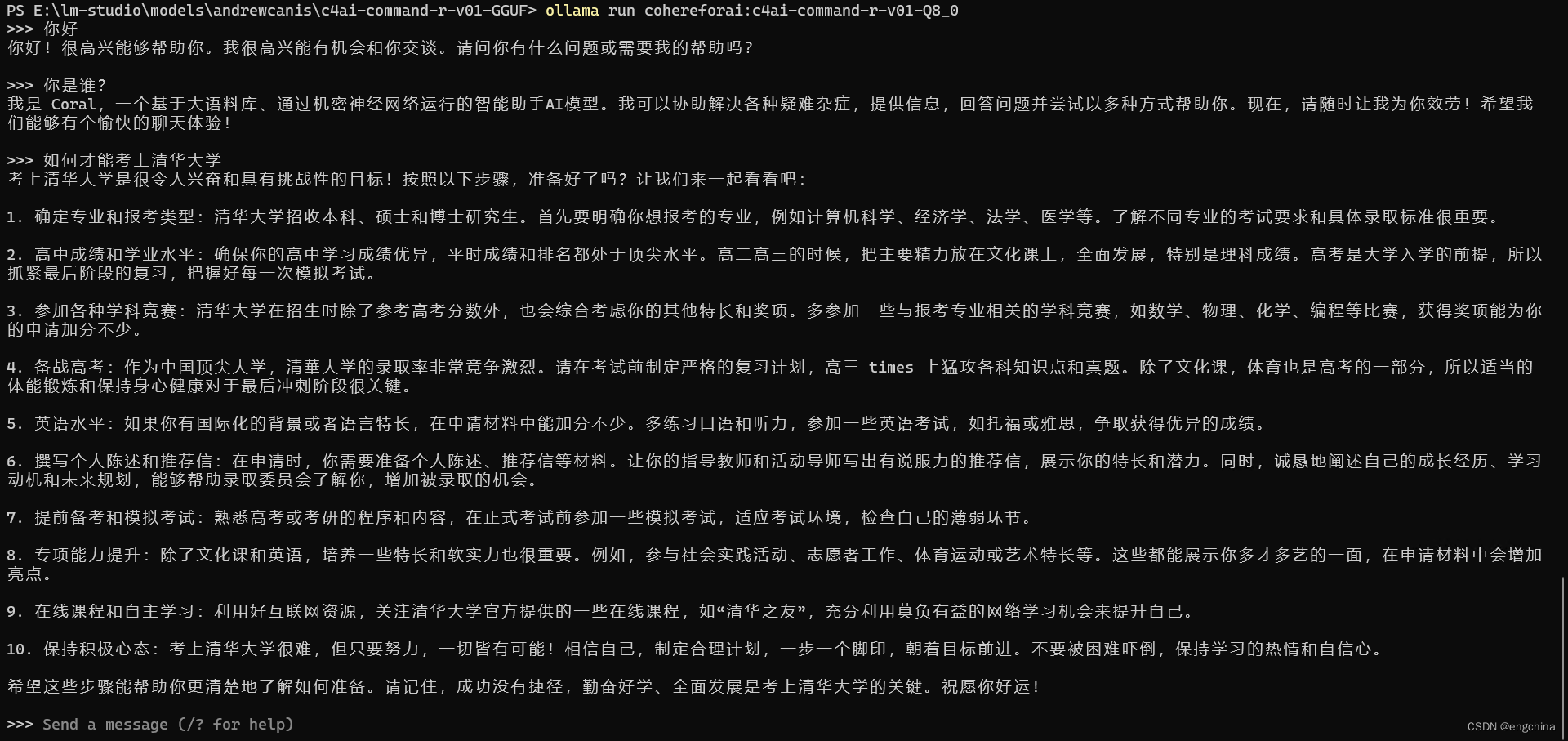

此文章主要介绍使用 使用 vllm 本地部署 cohere 的 command-r。

1. 安装 vllm

创建虚拟环境,

conda create -n myvllm python=3.11 -y

conda activate myvllm

安装 Ray 和 Vllm,

pip install ray vllm

安装 flash-attention,

git clone https://github.com/Dao-AILab/flash-attention; cd flash-attention

pip install flash-attn --no-build-isolation

2. 本地部署 cohere 的 command-r

eval "$(conda shell.bash hook)"

conda activate myvllm

CUDA_VISIBLE_DEVICES=3,2,1,0

python -m vllm.entrypoints.openai.api_server --trust-remote-code --served-model-name gpt-4 --model CohereForAI/c4ai-command-r-v01 --gpu-memory-utilization 0.98 --tensor-parallel-size 4 --port 8000

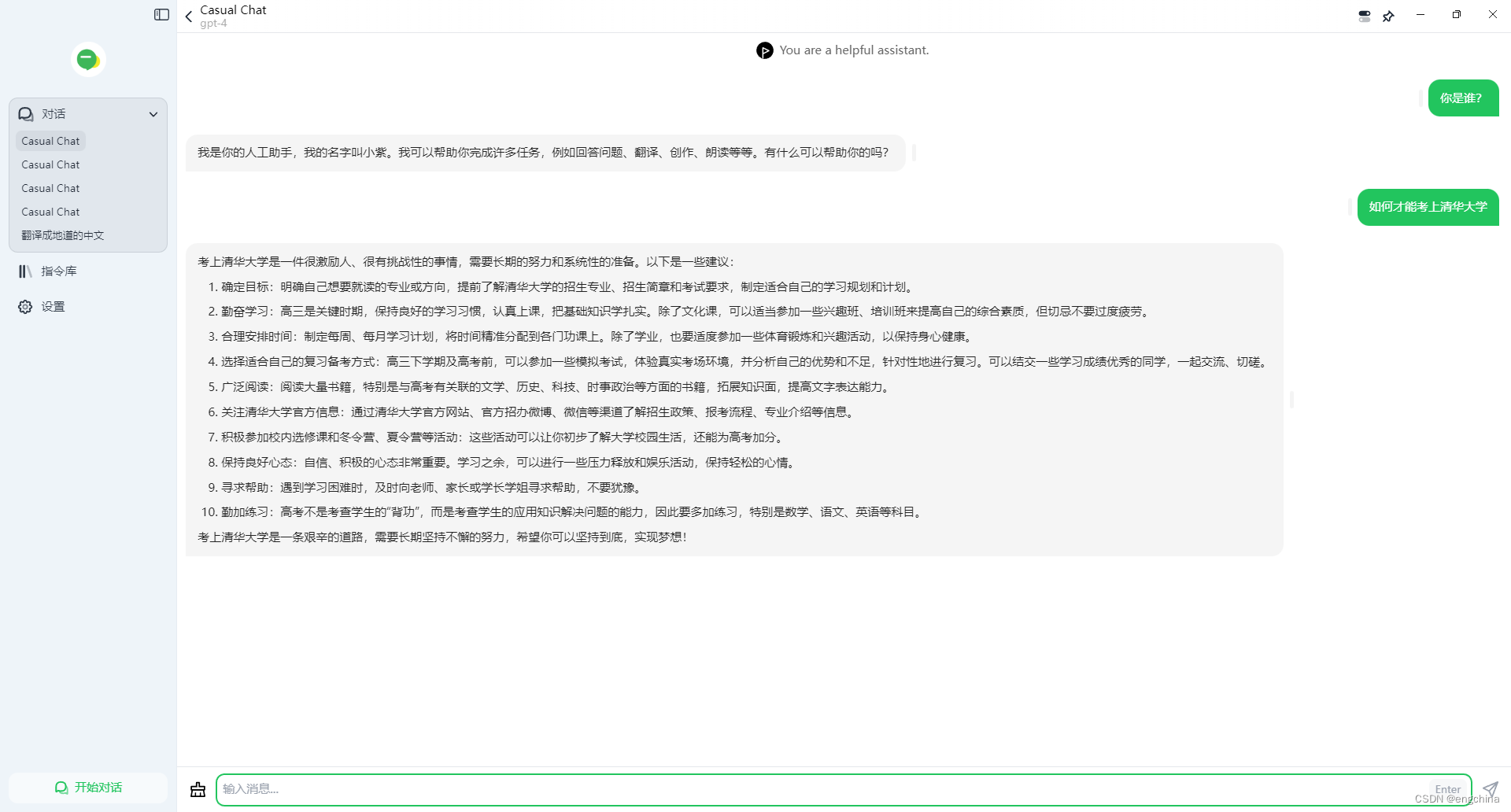

3. 使用 cohere 的 command-r

完结!