为什么深度学习都是用英伟达的显卡?

首先我们需要了解什么是CUDA?

CUDA(Compute Unified Device Architecture),是显卡厂商 NVIDIA 推出的运算平台。

CUDA就类似于编程语言,开发者和显卡通过CUDA进行交流,开发者用CUDA去操作英伟达显卡,可以给显卡发送各种各样的指令。然而,像PyTorch和Tensorflow这种深度学习的库,本质就是从上一级,调用CUDA的库,随后将我们需要处理的数据交给GPU(显卡)去处理,以此达到加快深度学习网络的训练。

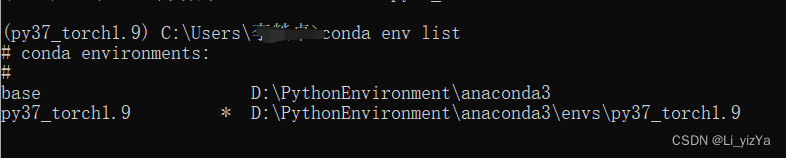

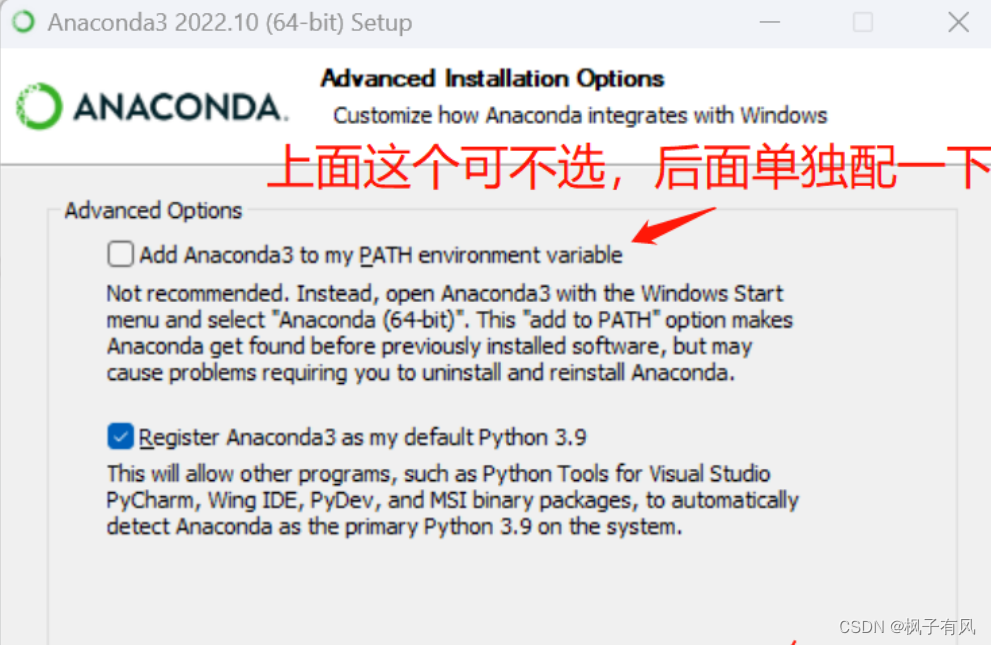

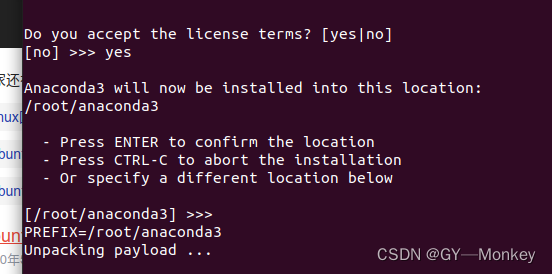

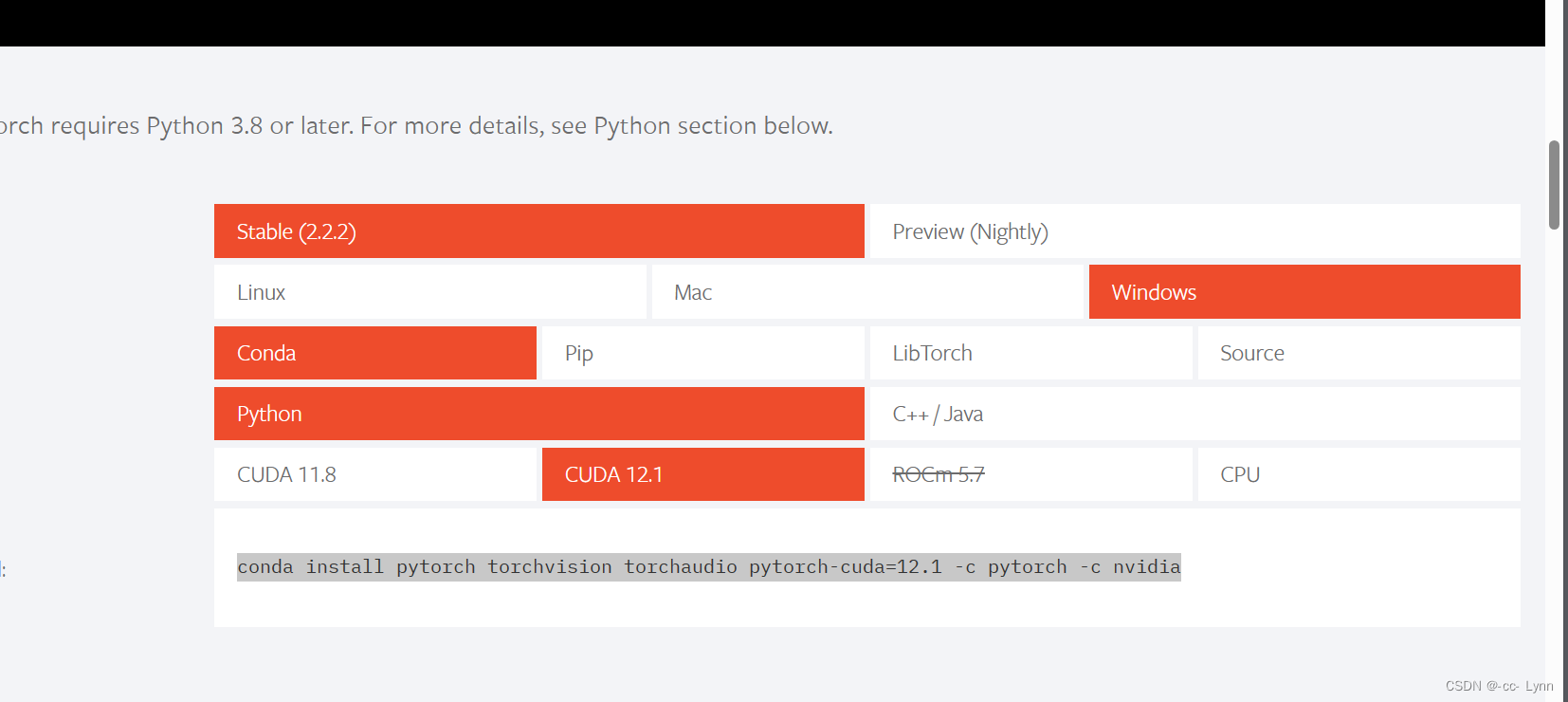

在安装好anaconda之后,开发者需要去根据python的版本、PyTorch的版本、CUDA runtime version版本、CUDA driver version版本。

其中最关键的是,CUDA runtime version 的版本要小于等于 CUDA driver version。

其中最关键的是,CUDA runtime version 的版本要小于等于 CUDA driver version。

这里CUDA runtime version是支持显卡对应的算力。

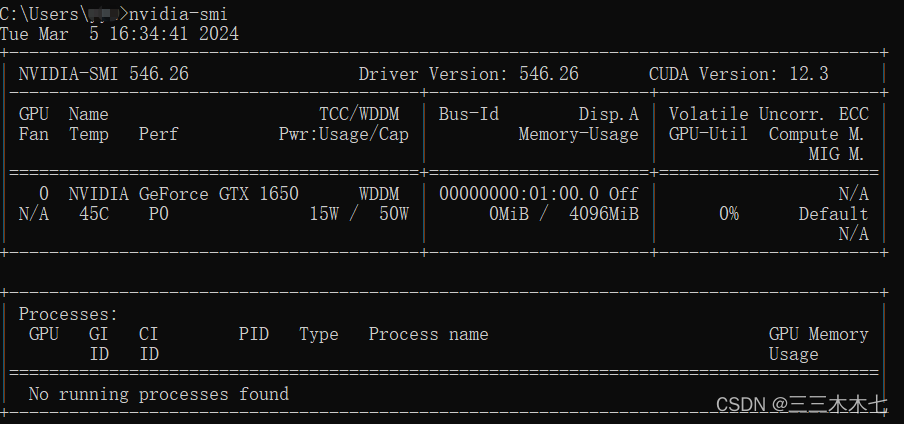

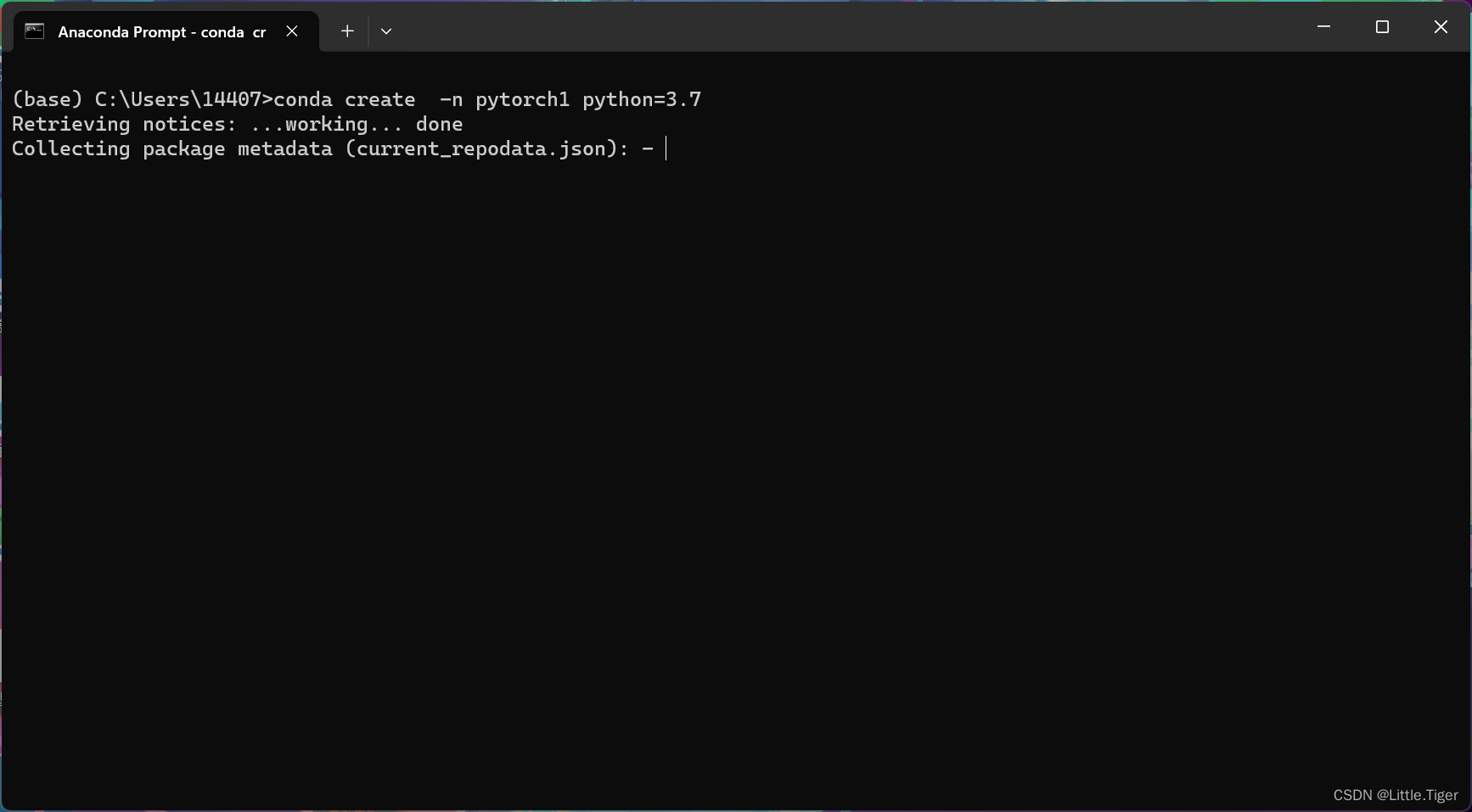

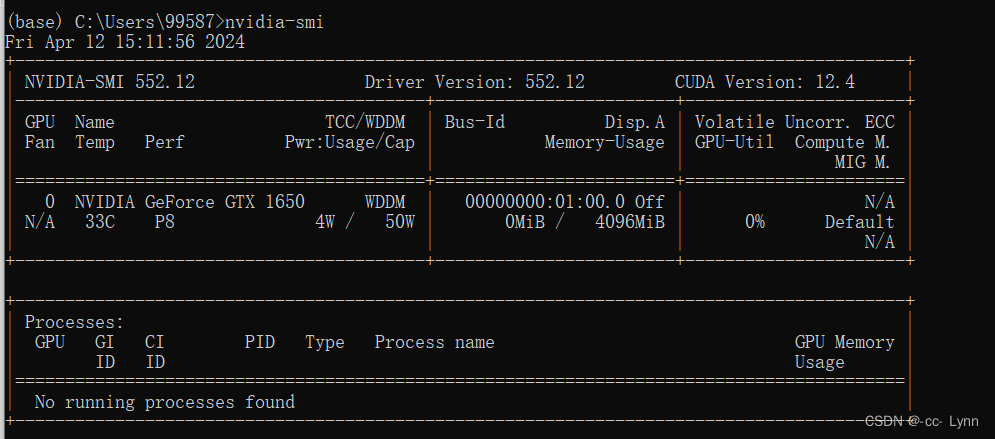

通过 anaconda 的 命令行界面输入 nVidia-smi

查找到CUDA runtime version,此处我的是12.4

查找到CUDA runtime version,此处我的是12.4

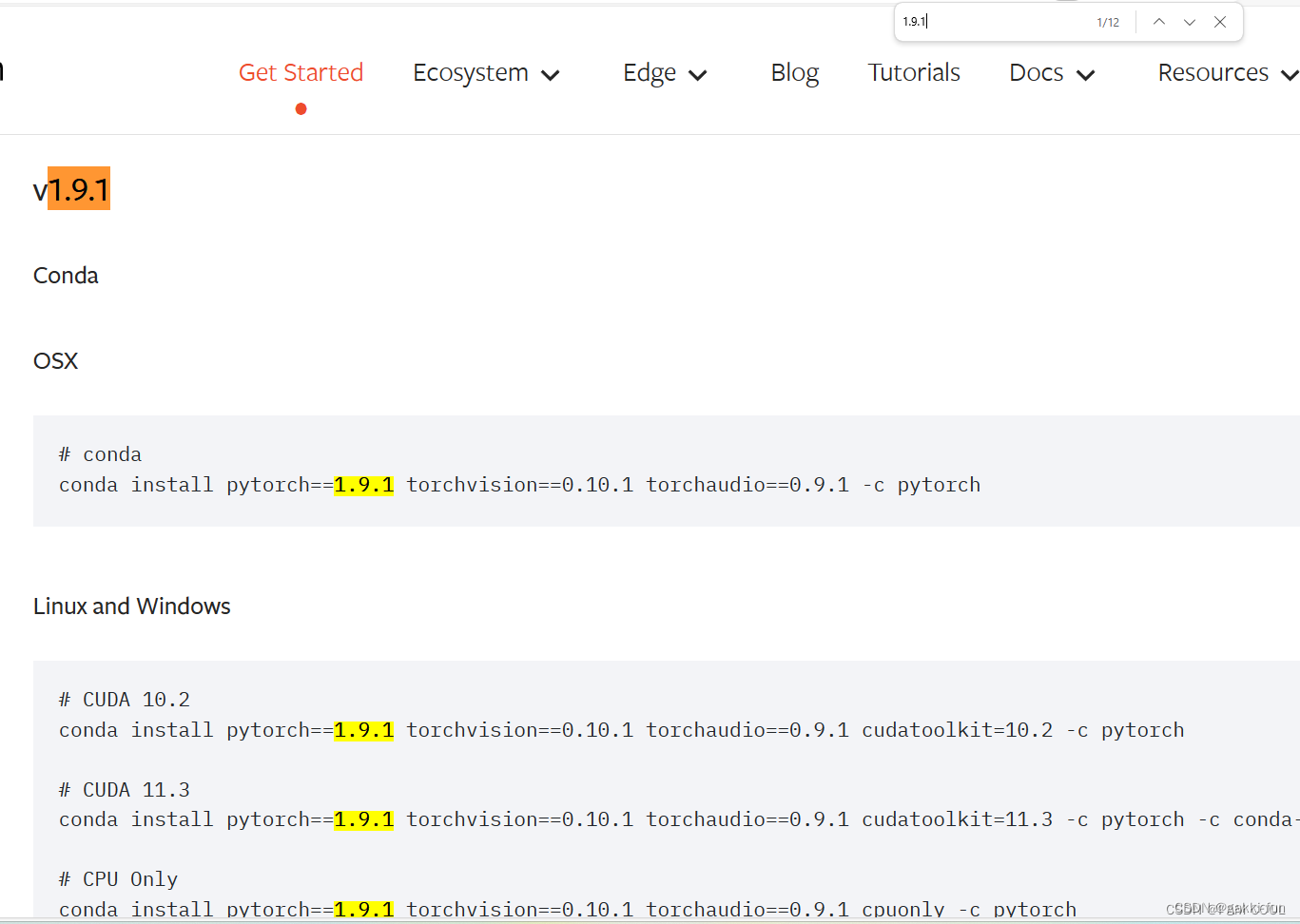

所以再去pytorch官网找小于12.4的版本。 直接下载即可

直接下载即可