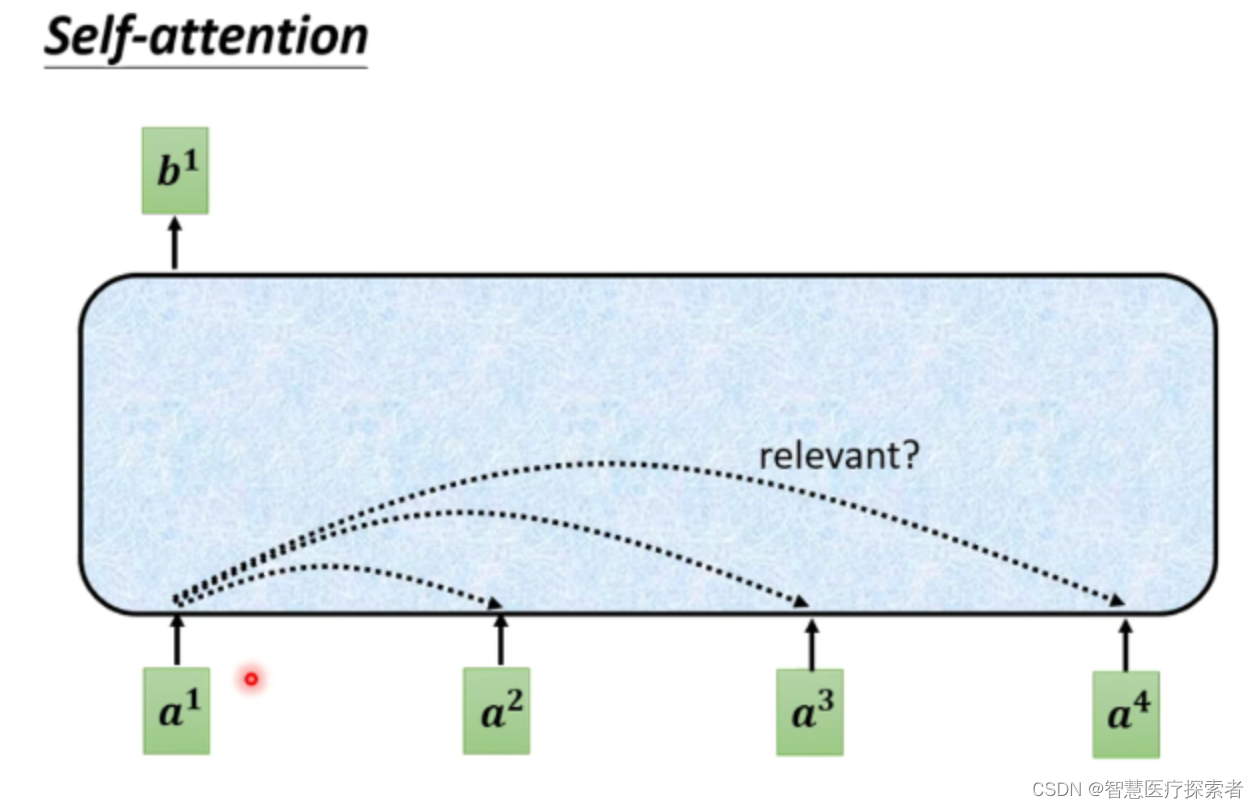

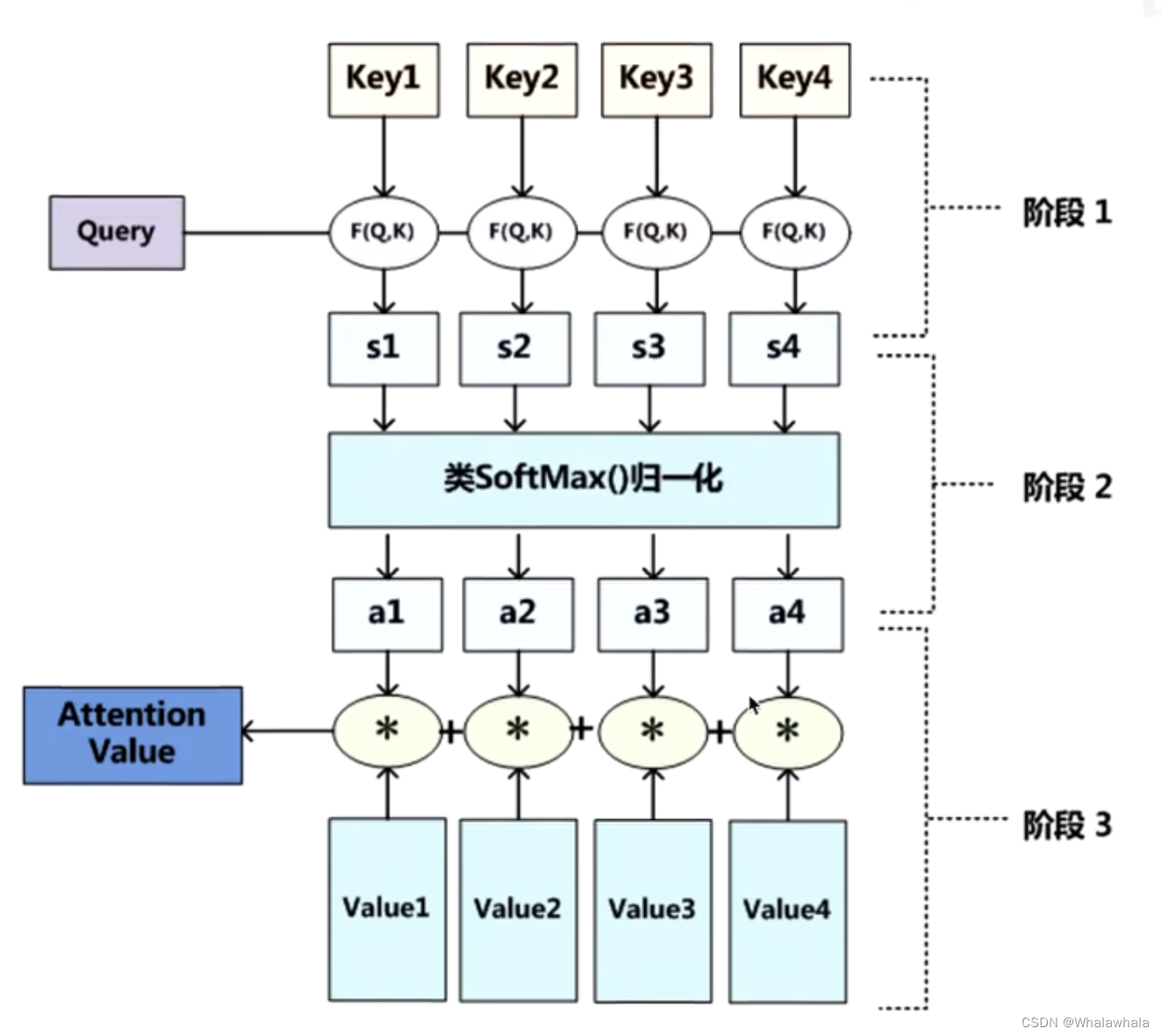

频域与注意力机制的结合是一种创新的网络设计方法,它利用频域分析来增强特征提取过程,并通过注意力机制进一步优化特征的利用效率。

这种策略有助于模型捕捉和利用信号中的关键频率成分,不仅能够提高模型的性能和精度,还能在一定程度上简化模型的设计和优化过程。

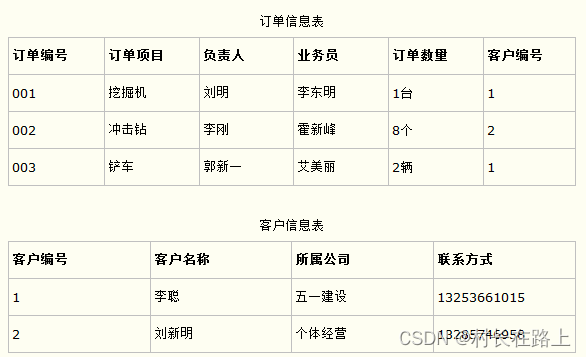

以浙大团队的FcaNet为例:

FcaNet是一种非常巧妙的通道注意力机制,从频域的角度出发,采用DCT对SE进行了扩展。这种方法简洁而高效,仅需对原有代码进行微小的改动,即能实现相较于SENet50模型1.8%的性能提升。

因此,频域与Attention的结合也是深度学习中的一个热门方向,并且由于我们以往对频域的关注较少,可挖掘的创新点很多。

本文分享频域+注意力机制9种融合创新方案,有最新的也有经典的,主要涉及自适应频域特征提取+attention、多尺度频域+attention等,方便各位获取灵感。

论文以及开源代码需要的同学看文末

SpectFormer

SpectFormer: Frequency and Attention is what you need in a Vision Transformer

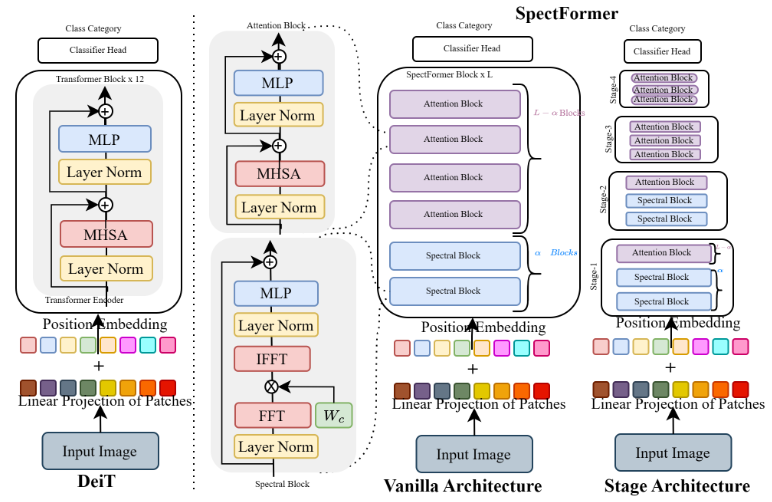

方法:之前,transformer要么使用全注意力层,要么使用谱层。Spectformer结合了这两个方面,并且表现出比全注意力层或全谱层更好的性能。作者在特定任务中提出了参数化方法,为进一步的适应性提供了可能性。

SpectFormer架构细节

创新点:

SpectFormer架构的关键思想是将图像分割成一系列的补丁,并使用线性投影层获得补丁嵌入。然后使用标准的位置编码层进行位置嵌入。SpectFormer包括一系列的谱层和注意力层的变压器块。这种架构能够捕捉图像的局部信息和语义信息。

SpectFormer架构的变体包括SpectFormer-s、SpectFormer-B和SpectFormer-L,它们使用不同的谱层,如FNet、FNO、GFNet和AFNO。这些变体能够减少参数数量并降低计算复杂度。

SpectFormer架构中使用的初始谱层后跟多头注意力层的配置比其他配置更有益处,因此提出了SpectFormer架构。

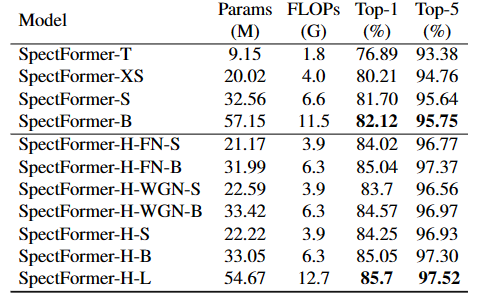

部分实验结果

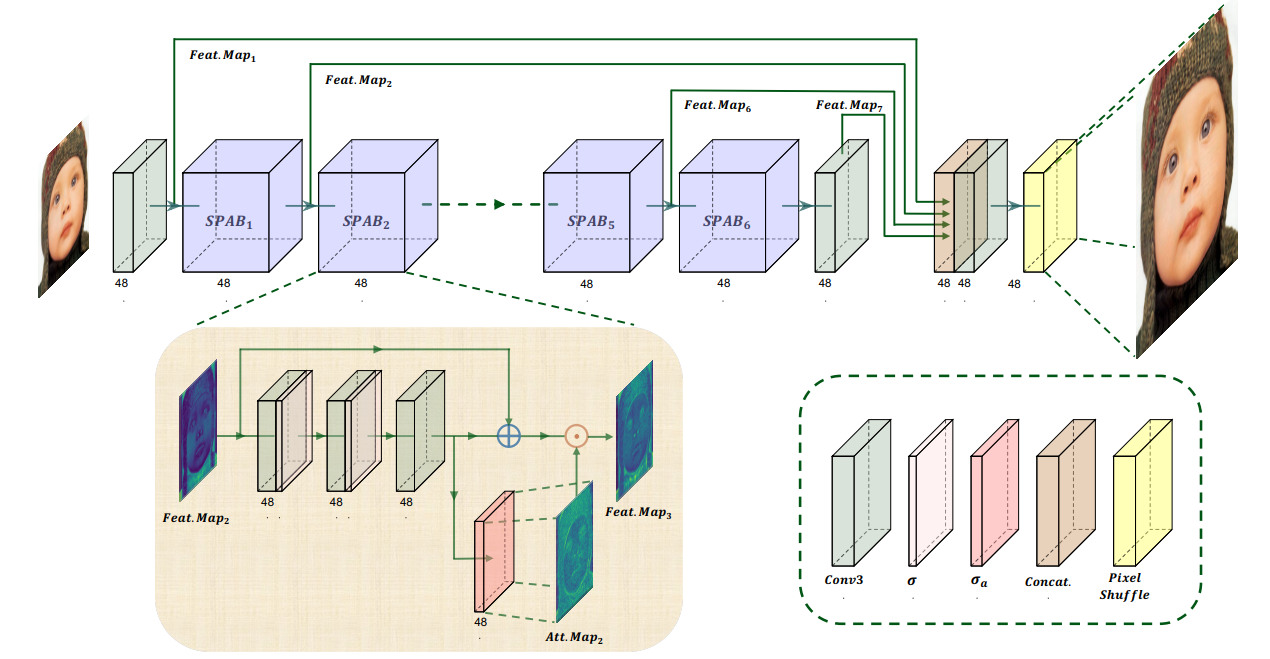

SFANet

Spatial-Frequency Attention for Image Denoising

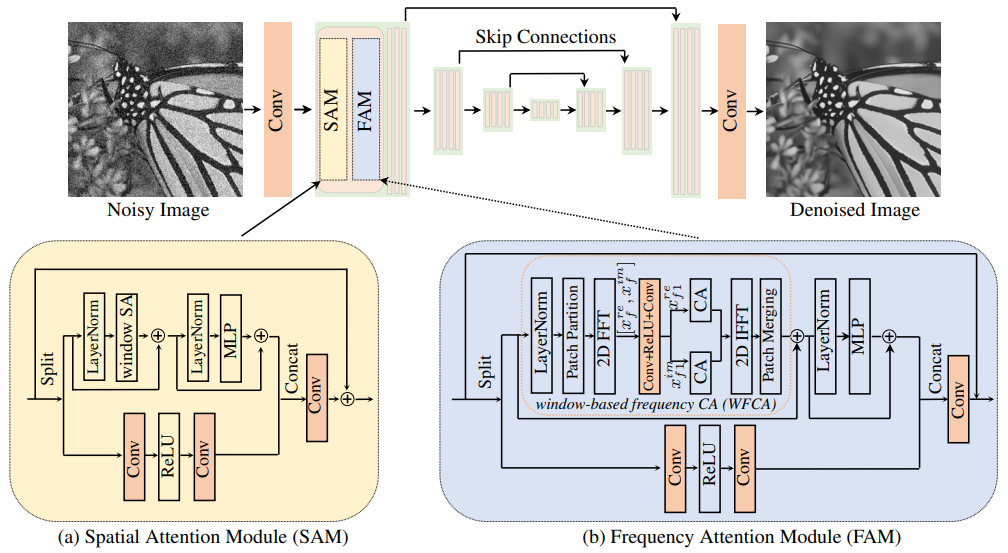

方法:论文介绍了一种用于图像去噪的空间频率注意力网络(SFANet)。作者提出了一种基于窗口的频率通道注意力(WFCA)模块,用于有效地建模图像的长程依赖性。WFCA在深频率特征域中利用通道注意力来适应性地建模深频率特征的综合幅度和相位信息。同时,在空间域中使用了扩张的自注意(SA)模块来建模长期依赖性。

SFANet说明

创新点:

提出了基于窗口的频率通道注意力(WFCA)块,用于有效地建模图像的长程依赖性。WFCA模块使用频率域中的通道注意力来提取全局依赖性,相较于传统的基于SA的块,可以建模更多全局依赖性,具有对数线性复杂度。

在SFANet中应用了窗口自注意力机制来建模空间域的长期依赖性。通过使用多尺度扩张式自注意力(MDSA)块,扩大了窗口自注意力在浅层特征上的感受野,而无需额外的计算。这样可以更好地捕捉图像的长程信息。

在频率注意力模块(FAM)中,提出了窗口化的频率通道注意力(WFCA)模块,通过设计简单而有效的窗口化策略解决了频率领域输入大小不匹配的问题,并利用频率域中的通道注意力来提高图像的恢复性能。

部分实验结果

DFANet

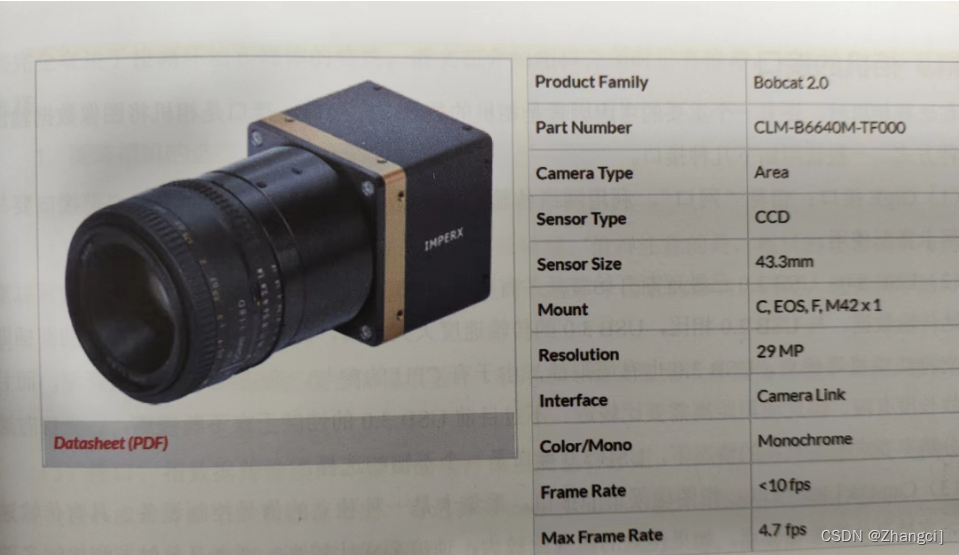

DFANet: Denoising Frequency Attention Network for Building Footprint Extraction in Very-High-Resolution Remote Sensing Images

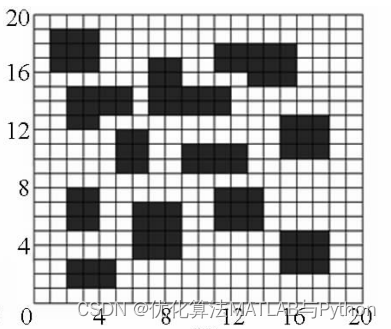

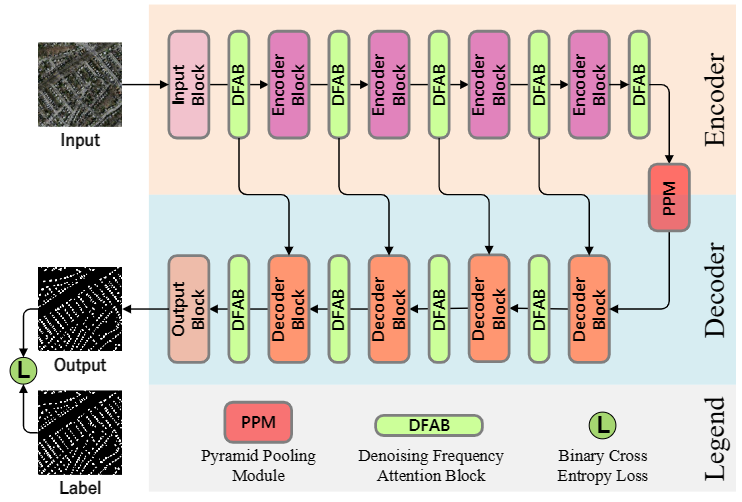

方法:论文提出了一种用于高分辨率遥感图像中建筑物轮廓提取的去噪频率注意力网络(DFANet)。DFANet包含三个部分:U形骨干网络、去噪频率注意力块(DFAB)和金字塔池化模块(PPM)。DFAB能够以较低的代价增强与建筑物相关的信息,从而改善每层特征图。为了更好地捕捉不同形状和大小的建筑物特征,引入了广泛使用的PPM来扩大DFANet的感受野。

DFANet概述

创新点:

提出了一种名为DFANet的去噪频率注意力网络,用于从高分辨率遥感图像中提取建筑物轮廓。该方法利用了频率差异,并通过注意力机制对特征图进行滤波和增强,以提高建筑物的检测性能。

引入了金字塔池化模块(PPM),用于处理不同尺度的建筑物。通过增加感受野,PPM显着提高了建筑物提取任务的性能。

部分实验结果

FEDformer

FEDformer: Frequency Enhanced Decomposed Transformer for Long-term Series Forecasting

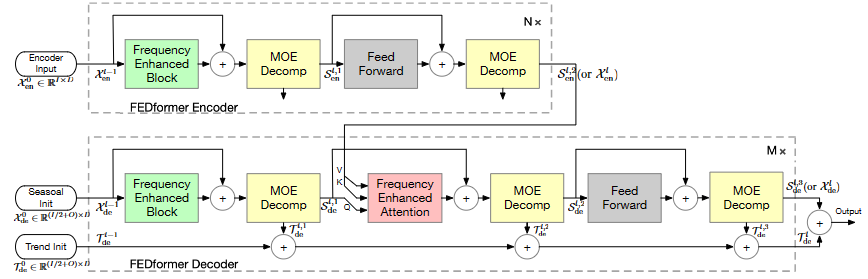

方法:论文提出了一种基于频域的时间序列压缩表示方法,并将其应用于长期时间序列预测中。与其他长期预测算法不同的是,作者使用神经网络进行频域操作。作者还提出了一种随机选择傅里叶分量的时间序列压缩表示方法,以实现Transformer的高效计算。另外,作者还介绍了基于小波变换的时间序列表示方法,并将其与傅里叶基表示方法进行了比较。

FEDformer结构

创新点:

频率增强分解Transformer(FEDformer):提出了一种结合傅里叶分析和Transformer的模型架构,用于长期时间序列预测。通过在Transformer中应用傅里叶变换,可以更好地捕捉时间序列的全局特性。该模型通过特殊设计的网络结构,将预测结果的分布与真实结果的分布接近,从而提高了预测的准确性。FEDformer在多维/一维时间序列预测问题上分别取得 14.8% 和 22.6% 的提升。

随机傅里叶模式选择策略:针对傅里叶变换中选择频率分量的问题,提出了一种随机选择模式的策略。通过理论分析和实证研究,证明了随机选择一定数量的傅里叶分量可以更好地表示时间序列,并且可以将Transformer的计算复杂度从二次降低到线性。

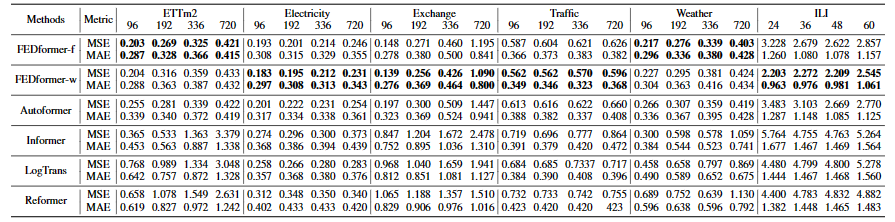

部分实验结果

关注下方《学姐带你玩AI》🚀🚀🚀

回复“频域注意力”获取全部论文+代码

码字不易,欢迎大家点赞评论收藏

![[论文阅读]Generalized <span style='color:red;'>Attention</span>——空间<span style='color:red;'>注意力</span><span style='color:red;'>机制</span>](https://img-blog.csdnimg.cn/direct/d5629a539212432a9becde3ad213c930.png)