一、注意力机制

产生背景: 大数据时代,有很多数据提供给我们。对于人来说,可以利用重要的数据,过滤掉不重要的数据。那对于模型来说(CNN、LSTM),很难决定什么重要、什么不重要,因此,注意力机制产生了。

注意力机制——把焦点聚焦在比较重要的事物上。

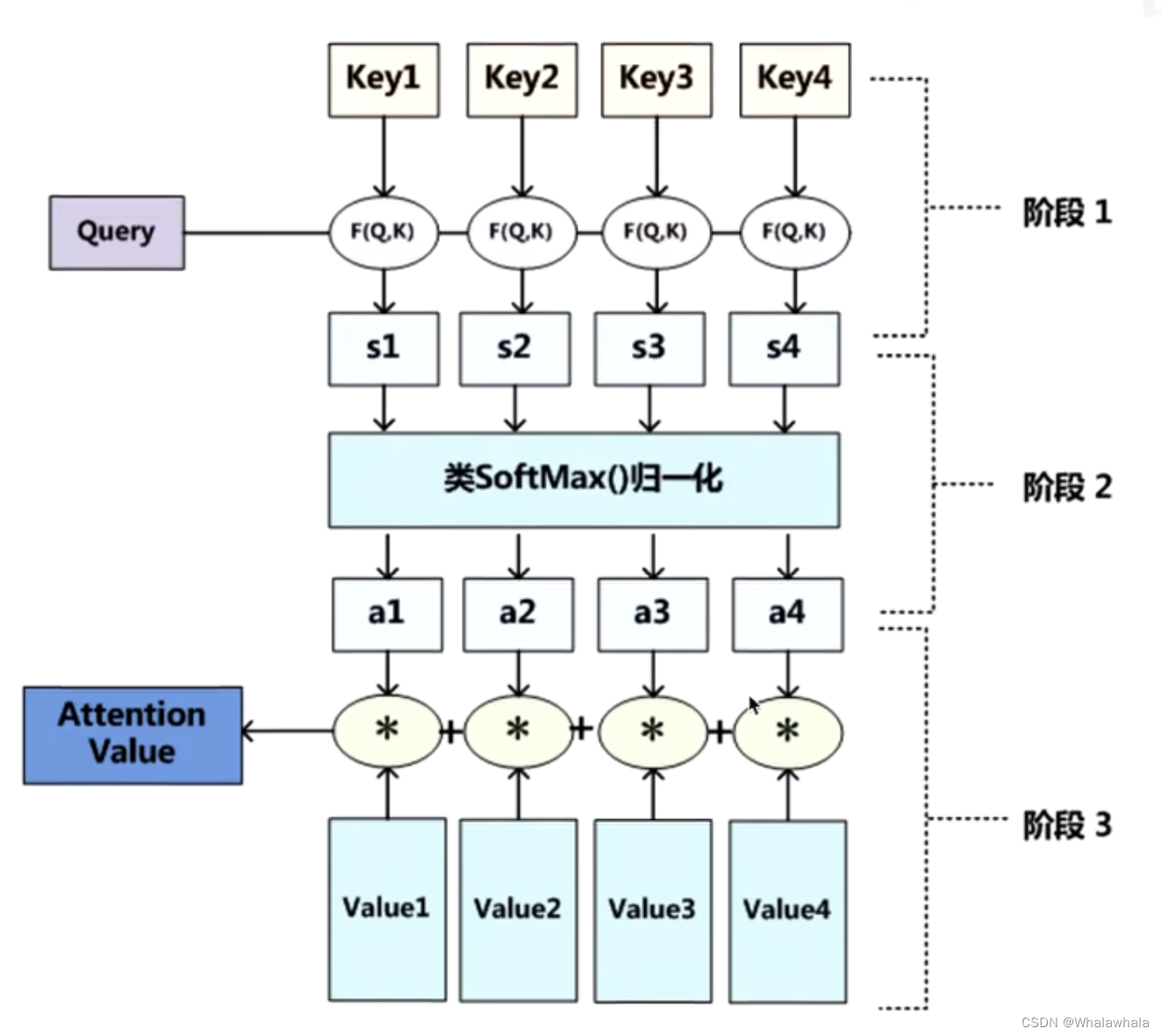

原理:

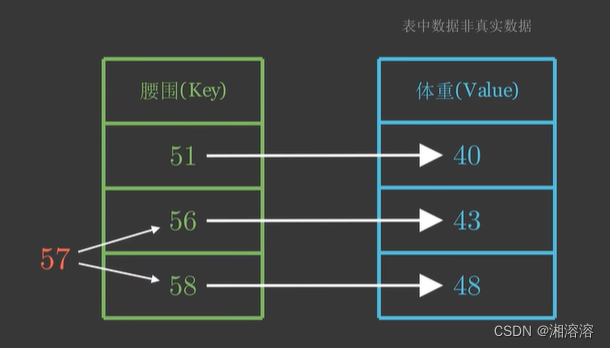

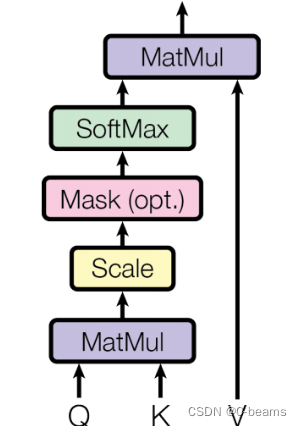

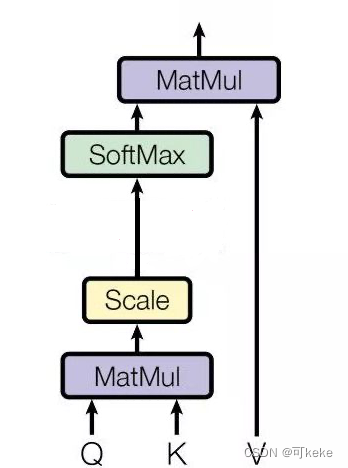

看查询对象Q和被查询对象K的相似度。

一般使用点乘的方式。点乘其实就是求内积。

Q,K = k1,k2,k3 … …

通过点乘,计算Q和K里的每一个事物的相似度,拿到Q和k1的相似值s1,Q和k2的相似值s2 。。。

做一层softmax(s1,s2,...,sn) 就可以得到概率a1,a2,…,an

(进而就可以找出哪个对Q更重要)

那么a就代表数据的权重,v是数据本身,a*v就是处理之后的数据。

注意力机制教程

注意力机制教程

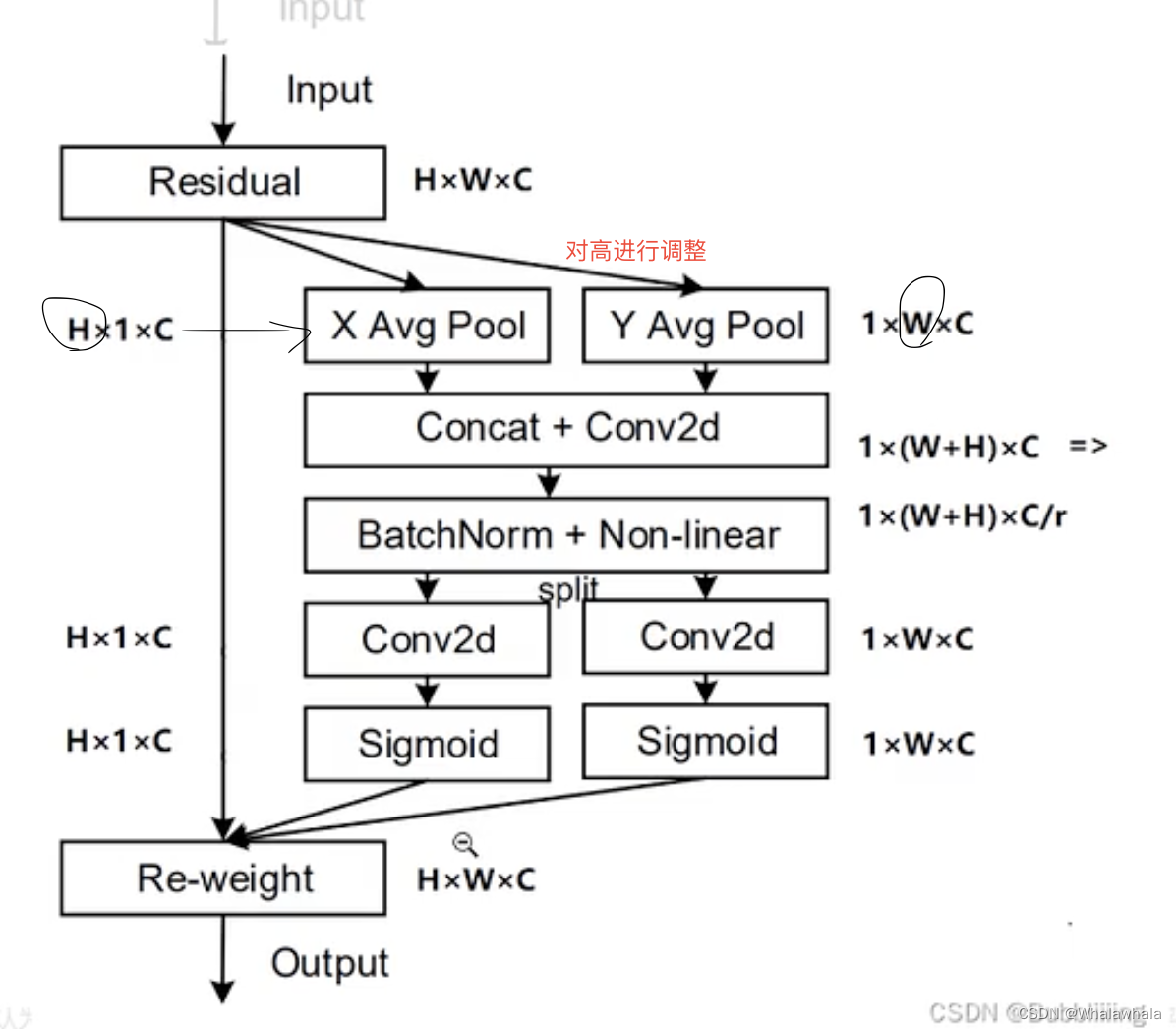

二、CA注意力机制

产生背景: 现有的注意力机制其通道的处理一般是采用全局最大池化/平均池化,这样会损失掉物体的空间信息。

优势: CA注意力机制可以把位置信息嵌入到通道注意力中。

P2 在pytorch中如何实现还没学,挖坑

P2 在pytorch中如何实现还没学,挖坑

P3 如何在网络中应用也还没学,挖坑

CA注意力机制教程