摘要:

随着人工智能技术的快速发展,大模型训练速度的提升变得尤为重要。新型训练技术的研究与实践不仅能够提高训练效率,还能降低训练成本,为人工智能技术的广泛应用奠定基础。本文将详细介绍提升大模型训练速度的新型训练技术,包括分布式训练、混合精度训练、梯度累积等,并分享实践经验,以帮助读者更好地理解和应用这些技术。

引言:

随着深度学习技术的不断发展,大模型在图像识别、自然语言处理等领域取得了显著成果。然而,大模型的训练速度却成为了制约其发展的瓶颈。为了提高训练速度,研究者们提出了许多新型训练技术。本文将重点介绍这些新型训练技术的研究与实践,以期为人工智能技术的进一步发展提供支持。

基础知识回顾:

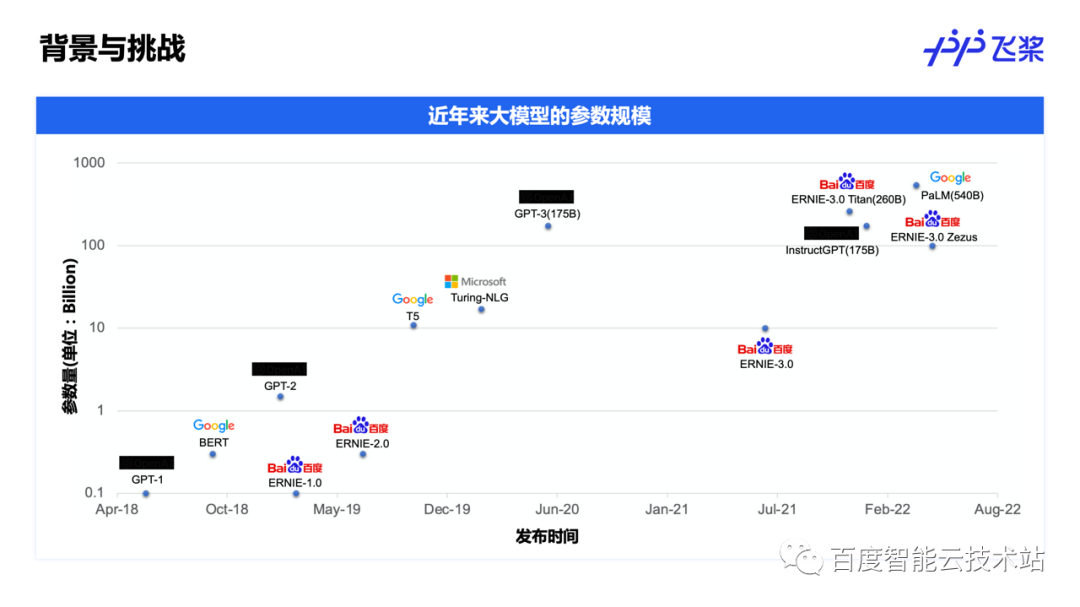

在介绍新型训练技术之前,我们先回顾一下大模型训练的基本概念。大模型通常指的是参数量较大的神经网络模型,如Transformer、BERT等。这些模型在训练过程中需要大量的计算资源和时间。现有的训练技术主要包括单机训练和分布式训练。单机训练受限于单台机器的计算能力,训练速度较慢。分布式训练通过将模型参数分布在多台机器上进行并行计算,从而提高训练速度。

核心组件:

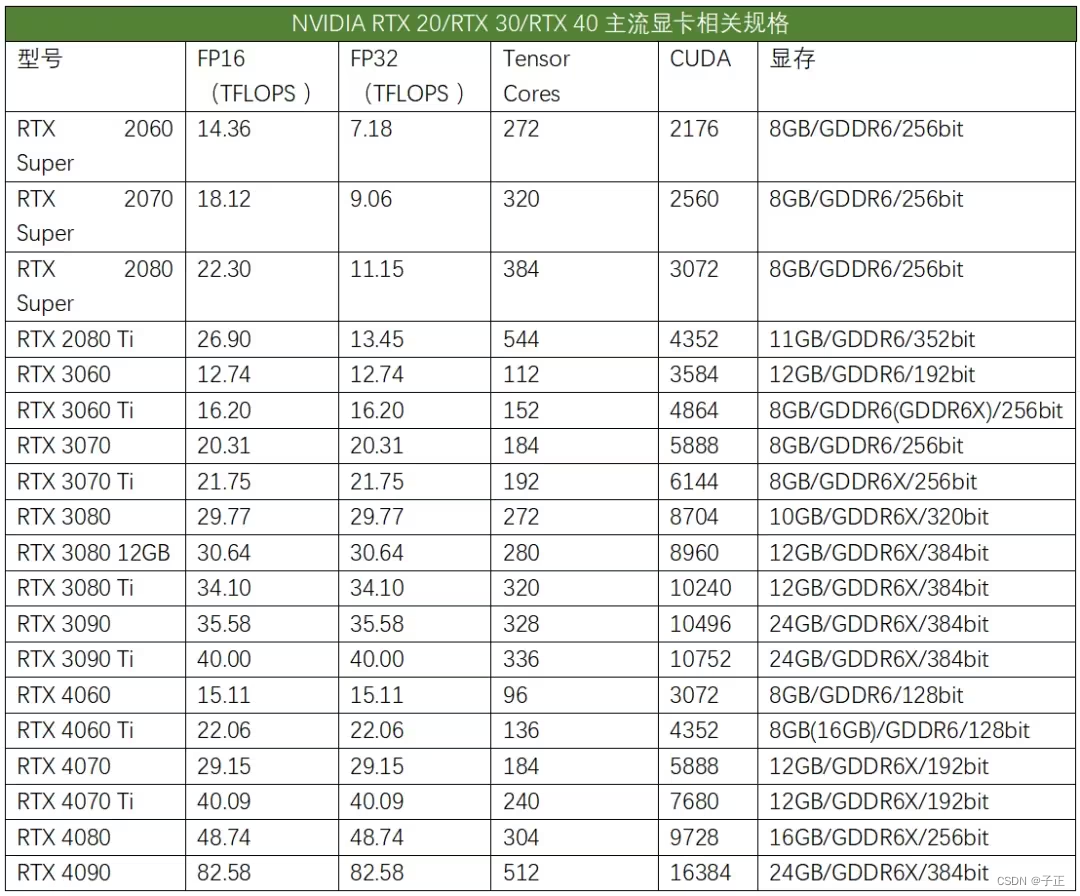

新型训练技术的核心组件主要包括分布式训练、混合精度训练和梯度累积。分布式训练通过将模型参数分布在多台机器上进行并行计算,提高训练速度。混合精度训练利用半精度浮点数进行计算,降低计算资源的需求。梯度累积通过累积多个小批量样本的梯度,减少通信次数,提高训练效率。

实现步骤:

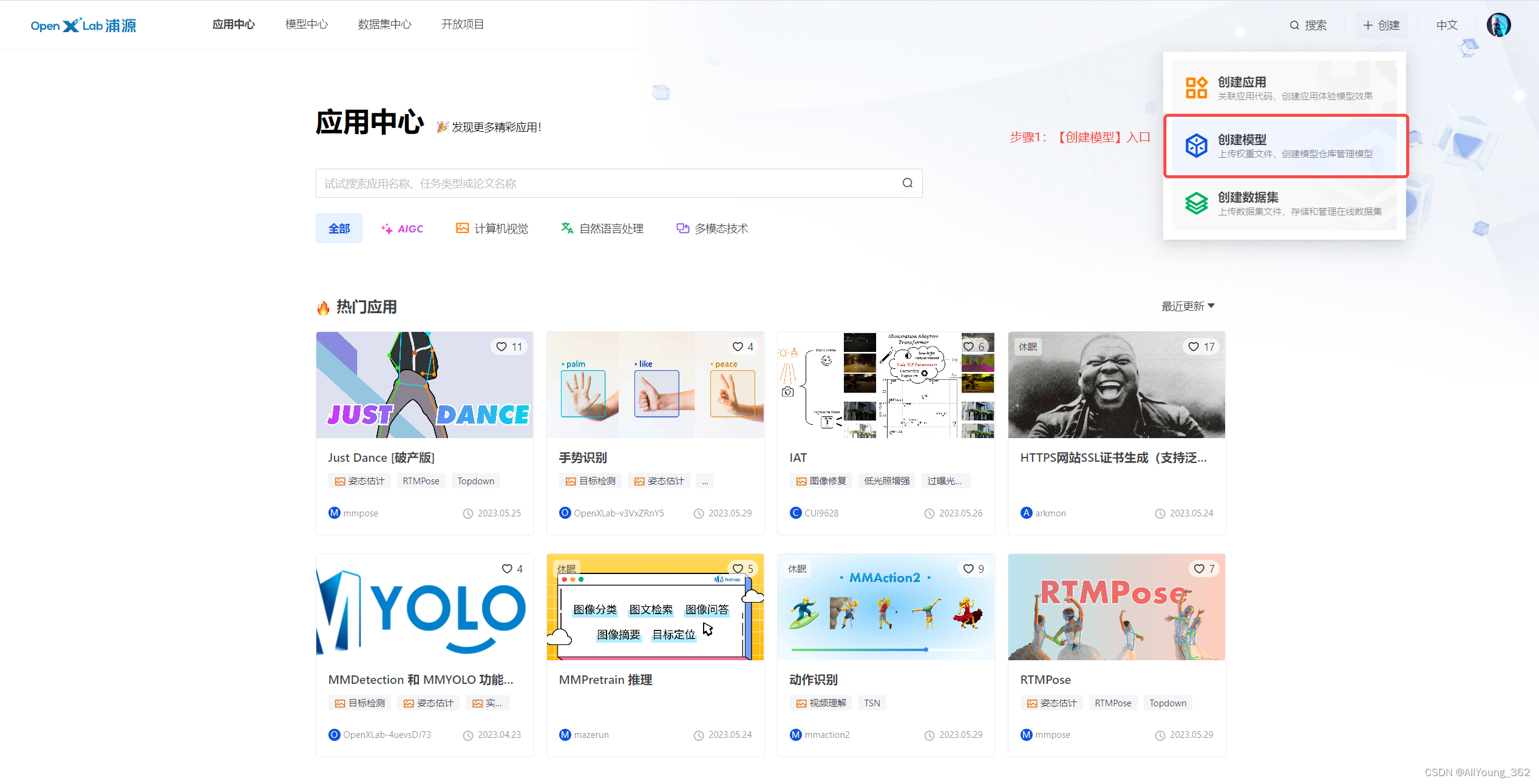

新型训练技术的实现步骤主要包括环境搭建、模型设计、训练流程等。环境搭建需要准备多台机器,并安装相应的深度学习框架。模型设计需要根据分布式训练的要求,将模型参数分布在多台机器上。训练流程包括数据预处理、模型训练、模型评估等步骤。

代码示例:

下面给出一个分布式训练的代码示例,以帮助读者更好地理解和应用。

import torch

import torch.distributed as dist

# 初始化分布式环境

dist.init_process_group(backend='nccl', init_method='env://', ...)

local_rank = torch.distributed.get_rank()

torch.cuda.set_device(local_rank)

device = torch.device("cuda", local_rank)

# 定义模型

model = MyModel().to(device)

# 定义损失函数和优化器

criterion = torch.nn.CrossEntropyLoss()

optimizer = torch.optim.SGD(model.parameters(), lr=0.001)

# 模型训练

for epoch in range(num_epochs):

for i, (inputs, targets) in enumerate(train_loader):

inputs, targets = inputs.to(device), targets.to(device)

outputs = model(inputs)

loss = criterion(outputs, targets)

# 反向传播

optimizer.zero_grad()

loss.backward()

optimizer.step()

```

# 技巧与实践:

在新型训练技术的实践中,需要注意以下几点:

1. 数据预处理:在分布式训练中,数据预处理需要在每个节点上进行,以避免数据传输的开销。

2. 2. 模型设计:模型设计需要考虑分布式训练的要求,如参数分布、梯度更新等。

3. 3. 通信优化:分布式训练中的通信开销较大,可以通过优化通信策略来提高训练效率。

# 性能优化与测试:

为了验证新型训练技术的效果,需要进行性能优化和测试。性能优化可以通过调整超参数、优化通信策略等方法来实现。测试可以通过比较不同训练技术的训练速度、模型性能等指标来进行。

# 常见问题与解答:

在新型训练技术的实践中,可能会遇到以下常见问题:

1. 模型收敛速度慢:可以通过调整学习率、优化器等方法来解决。

2. 2. 模型性能下降:可以通过增加训练数据、调整模型结构等方法来解决。

3. 3. 通信开销大:可以通过优化通信策略、减少通信次数等方法来解决。

# 结论与展望:

新型训练技术的研究与实践为大模型训练速度的提升提供了有效途径。随着技术的不断发展,未来可能会有更多高效、实用的训练技术出现,为人工智能技术的广泛应用奠定基础。

# 附录:

1. PyTorch官方文档:https://pytorch.org/docs/stable/distributed.html

2. 2. TensorFlow官方文档:https://www.tensorflow.org/guide/distributed_training

3. 3. Horovod:https://github.com/horovod/horovod

![[SWPUCTF 2021 新生赛]easy_sql SQL](https://img-blog.csdnimg.cn/direct/5f7f428869ac439588f0410837fdeb8c.png)