一.下载pyhanlp

1.打开conda使用如下语句

conda install -c conda-forge openjdk python=3.8 jpype1=0.7.0 -y

pip install pyhanlp附:提供了一个安装教程

index of /book/intro_nlp/安装包/ - 蝴蝶效应网盘 (hankcs.com)

二.安装中的特殊情况

2.(特殊情况)下载完成后打开jupyter notebook后,使用pyhanlp,产生了自动更新

三、 实验

代码

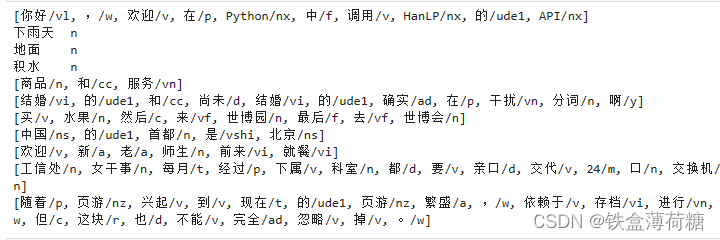

from pyhanlp import *

print(HanLP.segment('你好,欢迎在Python中调用HanLP的API'))

for term in HanLP.segment('下雨天地面积水'):

print('{}\t{}'.format(term.word, term.nature)) # 获取单词与词性

testCases = [

"商品和服务",

"结婚的和尚未结婚的确实在干扰分词啊",

"买水果然后来世博园最后去世博会",

"中国的首都是北京",

"欢迎新老师生前来就餐",

"工信处女干事每月经过下属科室都要亲口交代24口交换机等技术性器件的安装工作",

"随着页游兴起到现在的页游繁盛,依赖于存档进行逻辑判断的设计减少了,但这块也不能完全忽略掉。"]

for sentence in testCases: print(HanLP.segment(sentence)) 结果展示

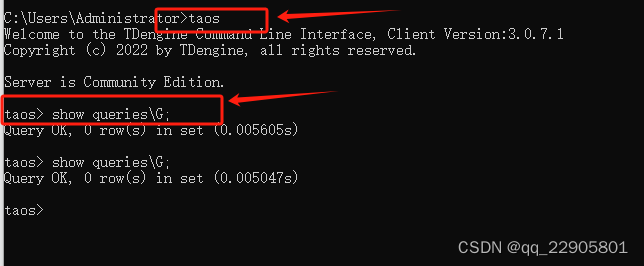

四、jieba使用方法实验

1.下载jieba

pip install jieba

2.实验代码

# encoding=utf-8

import jieba

seg_list = jieba.cut("我来到北京清华大学", cut_all=True)

print("Full Mode: " + "/ ".join(seg_list)) # 全模式

print(seg_list)

text1 = '李小福是创新办主任也是云计算方面的专家'

jieba.load_userdict('userdict.txt') # file_name为自定义词典的路径

seg_list1 = jieba.cut(text1, cut_all=False)

print("/ ".join(seg_list1)) 3.结果

![]()

![[玄机]流量特征分析-蚁剑流量分析](https://img-blog.csdnimg.cn/direct/15ebd68186f1405ab0c2e1aaa397b1a5.png)