作者:田逸(formyz)

销毁Ceph Pool的目的

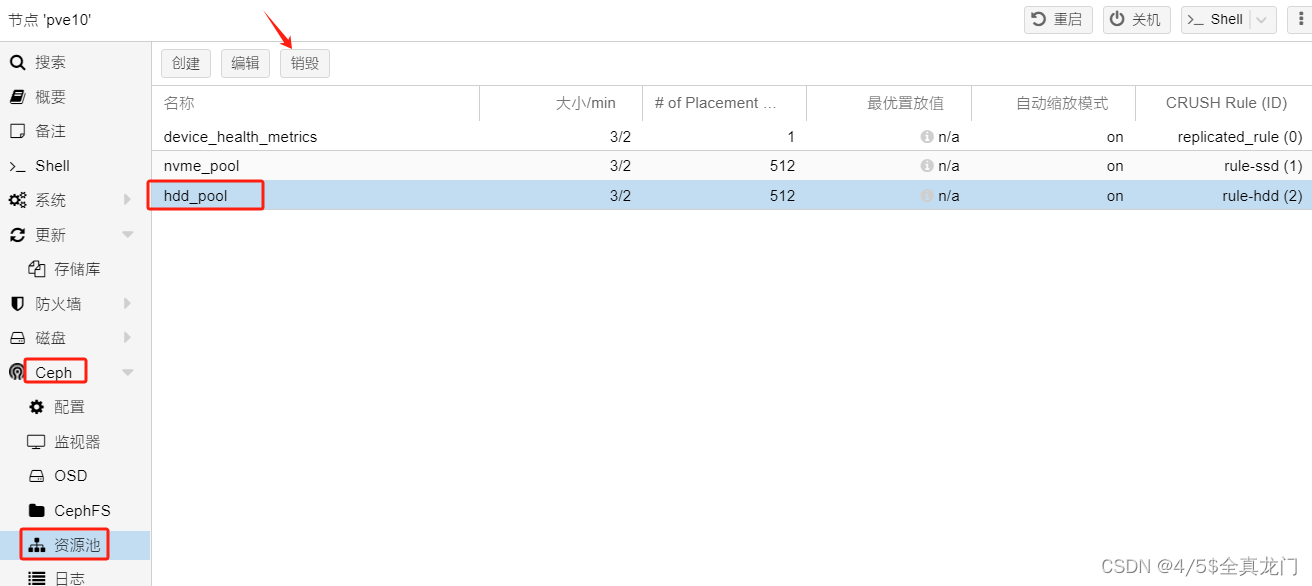

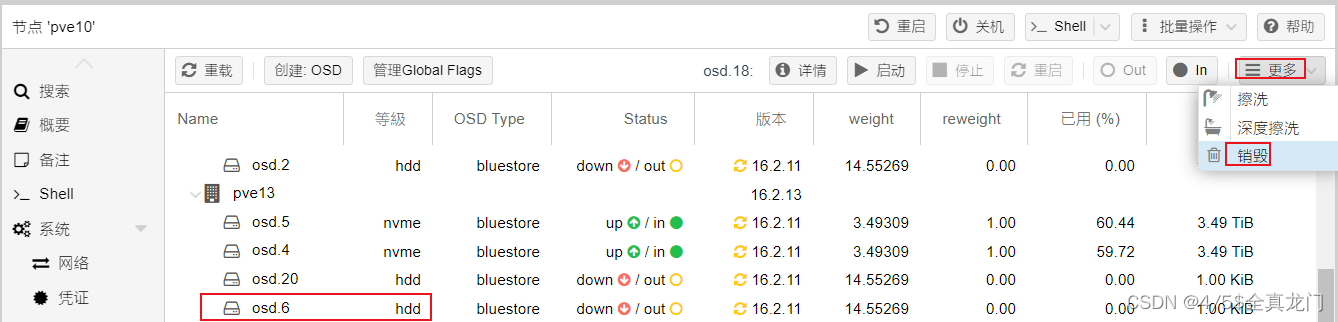

一套五节点的Proxmox VE超融合集群,当初为有效利用资源,配备了Nvme高性能磁盘和大容量的SATA机械磁盘(如图所示),高性能Nvme磁盘用于虚拟机的系统盘、数据库的数据存储盘,而大容量的机械盘则用于存储诸如图片、视频、共享数据等对性能要求不高的场景。由于机构的业务发展迅猛,收益较好(个人猜测),决策人打算将现有的机械盘全部更换成Nvme高性能磁盘,而将其另做它用。

销毁Ceph Pool的主要步骤

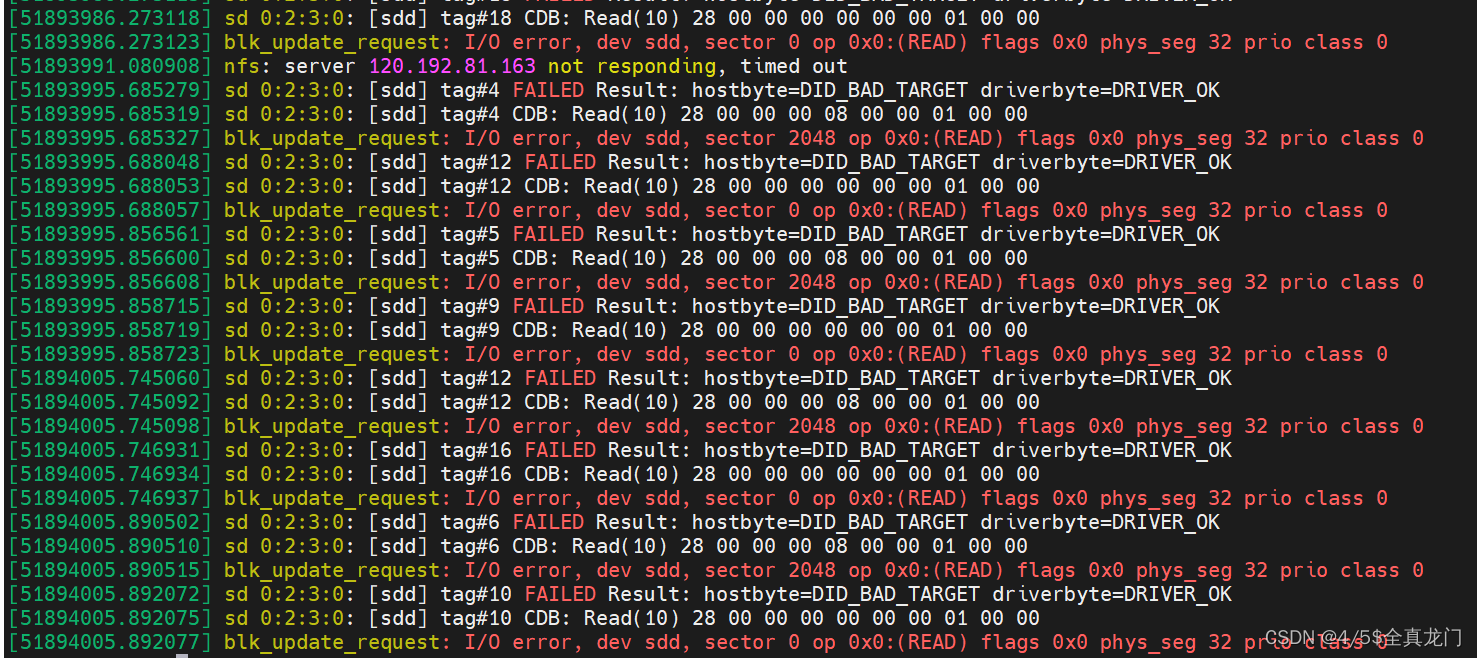

销毁Ceph Pool包括两个大的步骤:销毁Ceph Pool及Ceph OSD。如果不执行OSD的销毁,集群的服务器拔掉硬盘再运行的时候,系统会一直报错。

销毁Ceph Pool必须按照先销毁Ceph Pool ,再销毁Ceph OSD的顺序。如果顺序反了,再逐步销毁Ceph OSD的过程中,还没有被销毁的Ceph OSD会自动做数据平衡,如果销毁的Ceph OSD数量小于Ceph 集群所需要的最少值,系统报错,可能会引起其它问题,让人不安。

具体操作过程

第一步:销毁Ceph Pool

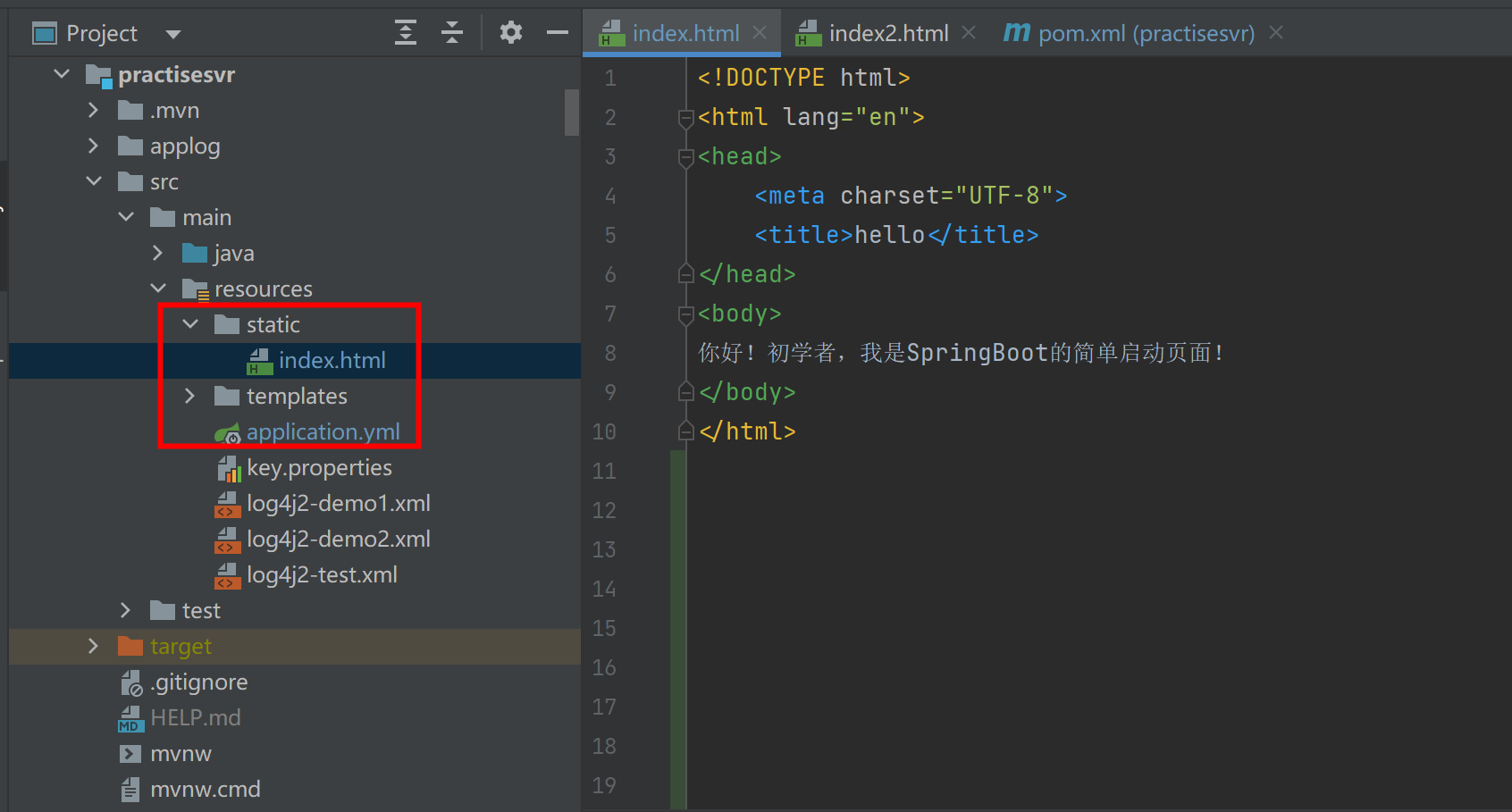

Proxmox VE 超融合集群Web管理后台,鼠标选定欲销毁的Ceph Pool项,再点击按钮“销毁”,如下图所示。

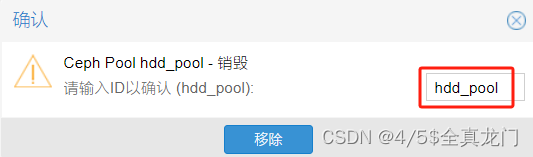

为防止误操作,系统很贴心地给出了一个确认界面,需要手动输入欲销毁的Ceph Pool,才会正式执行销毁操作,如下图所示。

注意,千万不要把默认的那个“device_health_metrics”给销毁了,因为这个再次创建就很费劲了!

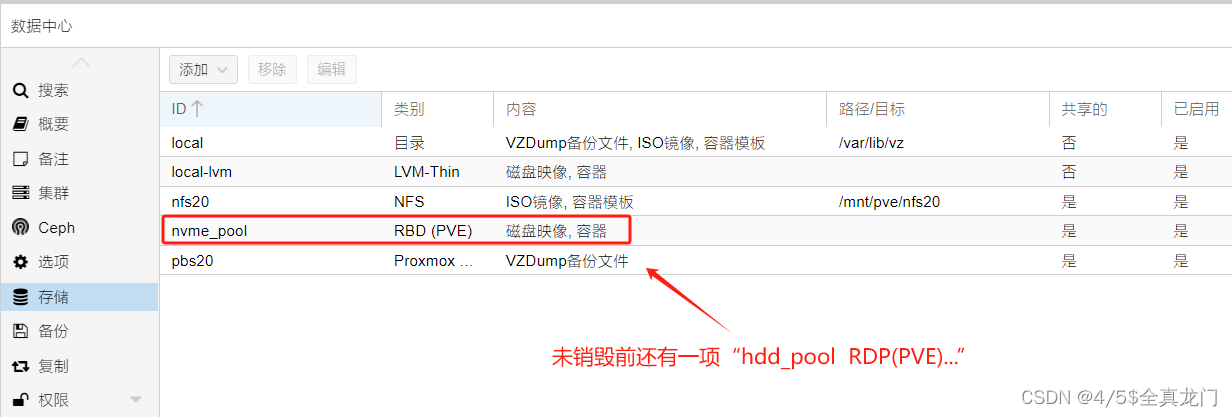

销毁掉所选定的Ceph Pool “hdd_pool”后,数据中心“存储”菜单下相对应的同名项自动消失,无需手动执行删除,如下图所示。

第二步:销毁Ceph OSD

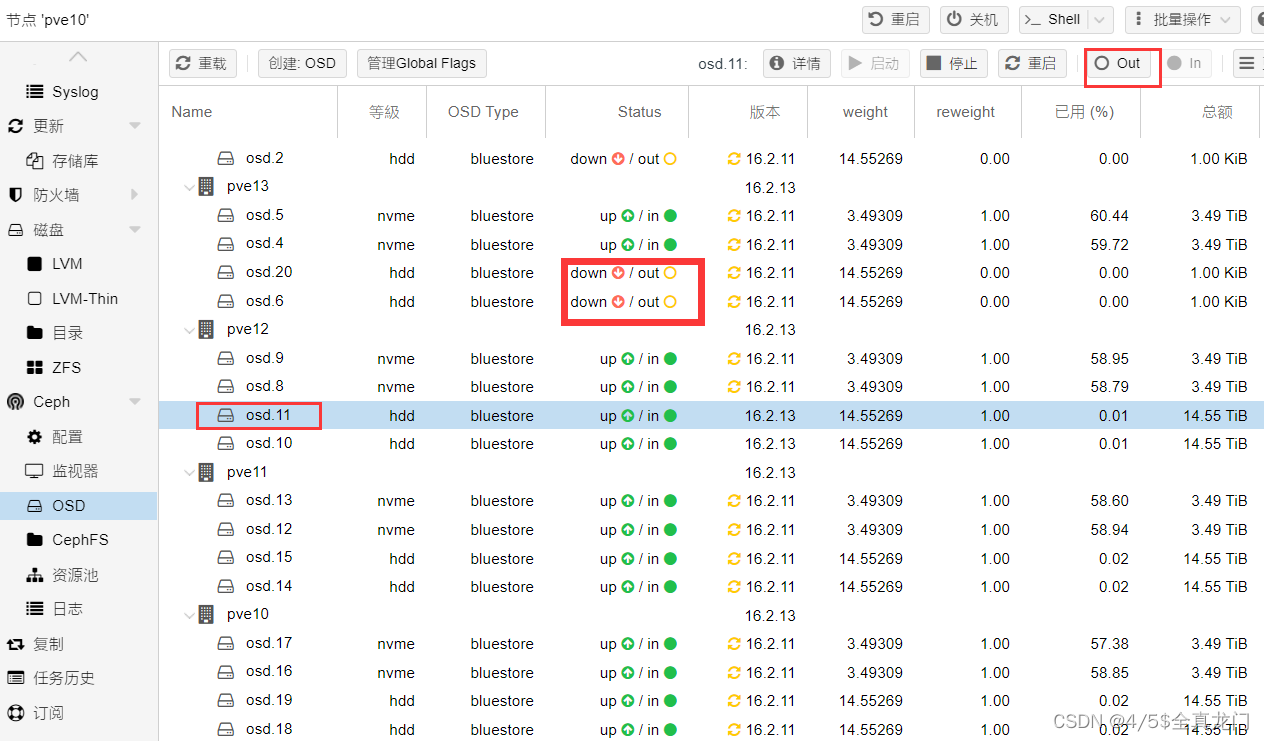

销毁Ceph OSD分三个小步骤:离线OSD磁盘、Down掉OSD磁盘和销毁OSD磁盘。

- 离线OSD。Proxmox VE 集群Web管理后台,选定欲操作的磁盘,然后点击界面右上方按钮”Out”,注意观察执行完后的状态。

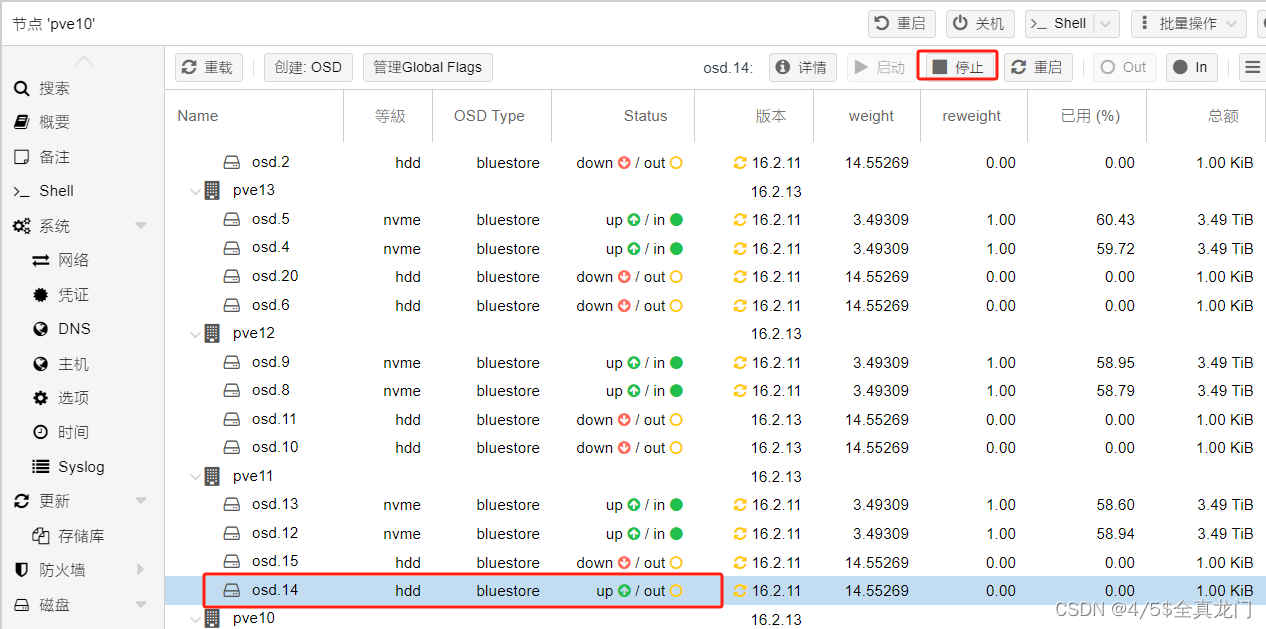

- 离线操作成功以后,再继续单击界面右上方按钮“停止”。

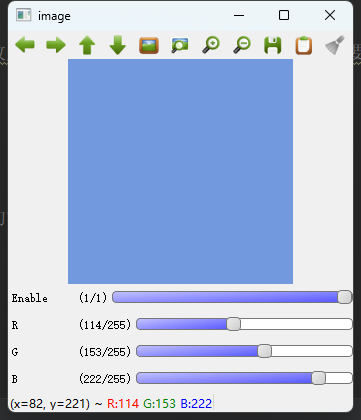

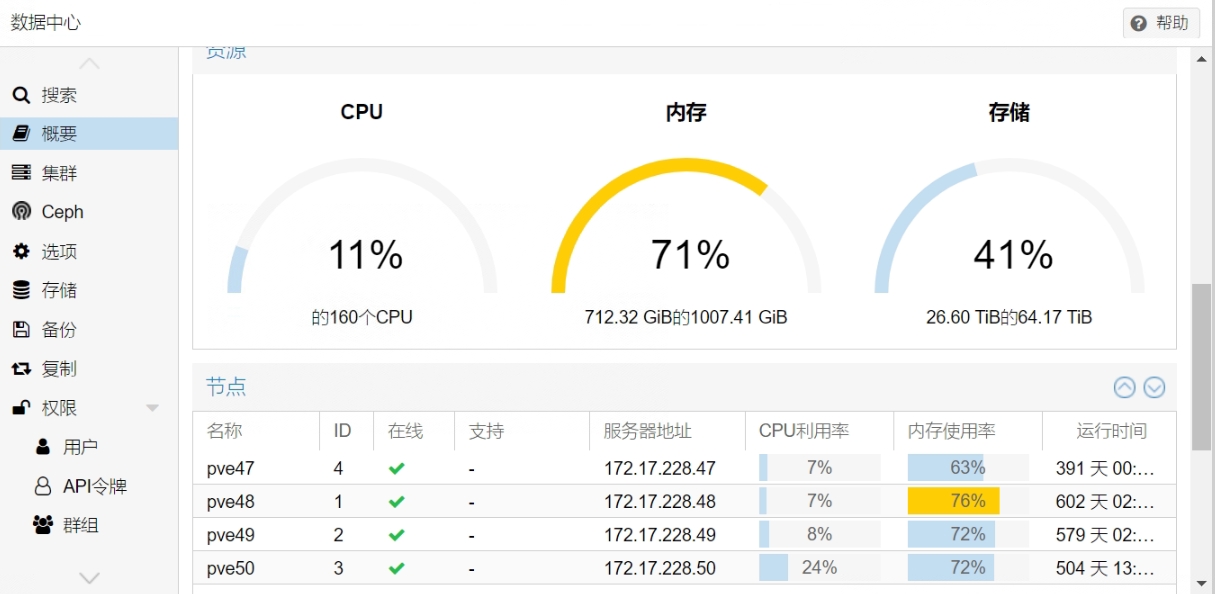

为确保操作是正确的,最好确认一下Ceph集群是否在重新平衡OSD数据。可以在Proxmox VE 集群Web管理后台查看,也可以在任意集群节点用命令行“ceph health detail”查看。如果用Web图形界面查看,正常状况应该是一片绿,如下图所示。

如果是命令行方式,正常情况下的输出应该是“HEALTH_OK”。

- 选中已经“Out”和“Down”状态的OSD磁盘,单击右上方按钮“更多”,再继续单击子菜单“销毁”,如图。

按照上述三个步骤,将所有的OSD机械盘下线并销毁。除了图形操作方式外,还可以用命令行。

![[<span style='color:red;'>超</span><span style='color:red;'>超</span><span style='color:red;'>超</span><span style='color:red;'>超</span><span style='color:red;'>超</span><span style='color:red;'>超</span>详细] Linux Centos7搭建Hadoop<span style='color:red;'>集</span><span style='color:red;'>群</span>及运行MapReduce分布式<span style='color:red;'>集</span><span style='color:red;'>群</span>](https://img-blog.csdnimg.cn/direct/b8806471e833450eb9e4720ffd4ce5fc.png)