ChatGPT是一种基于预训练语言模型的聊天机器人,其原理和技术架构如下:

- 原理

ChatGPT是基于GPT(Generative Pre-trained Transformer)模型进行构建的。GPT模型是OpenAI团队在2018年提出的一种通用的预训练语言模型,其基于Transformer架构,并使用了大量的无标记数据进行训练,可用于各种自然语言生成任务,包括文本摘要、机器翻译和对话生成等。

ChatGPT通过对输入的对话历史进行建模,并预测下一个可能的对话,从而生成一份具有连贯性和合理性的对话回复。

- 技术架构

ChatGPT的技术架构包括以下几个方面:

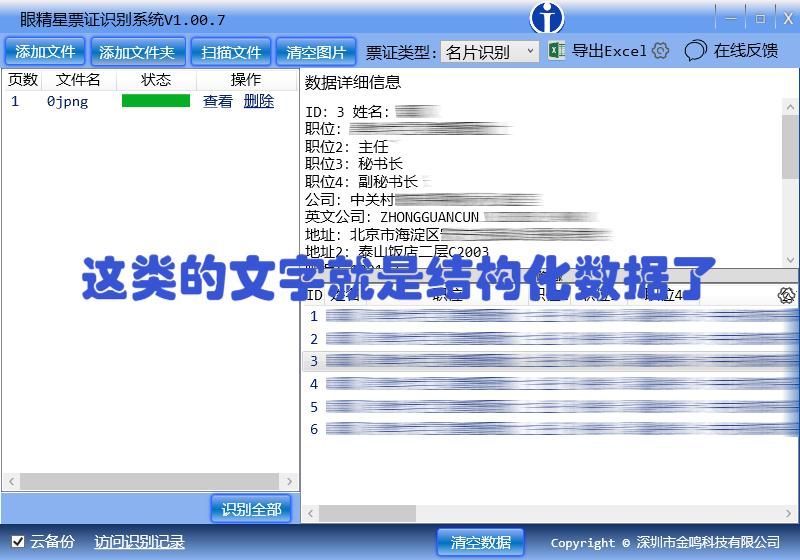

- 数据准备:ChatGPT的训练数据来源于各种公开的聊天记录和对话数据集。这些数据集需要进行清洗和预处理,以便于模型的训练和评估。

- 模型训练:ChatGPT的模型训练采用了Transformers库,并基于Pytorch框架进行实现。训练过程中,模型会对输入的文本进行编码和解码,并输出对话回复的概率分布,从而优化模型参数。

- 模型部署:ChatGPT的模型部署采用了基于Flask框架的Web服务,可以接收HTTP请求,并返回对话回复结果。同时,为了实现更高的并发性和可扩展性,ChatGPT也可以通过Docker容器来进行部署。

- 模型评估:ChatGPT的模型评估采用了BLEU、Perplexity、人工评估等多种指标来评估模型的性能。其中BLEU是一种自动评估指标,主要用于评估生成的对话回复是否与真实回复一致。Perplexity则用于评估模型在训练数据上的困惑度,即模型对数据的拟合程度。人工评估则是基于人类标注数据进行的,可以进一步验证模型的质量和可用性。

综上所述,ChatGPT是一款基于预训练语言模型的聊天机器人,其采用了GPT模型,并基于Transformers和PyTorch实现。通过对输入的对话历史进行建模,并预测下一个可能的对话,从而生成一份具有连贯性和合理性的对话回复。同时,为了实现更高的并发性和可扩展性,ChatGPT采用了Flask框架进行Web服务部署。