深度学习之优化

基本概念

Batch

所有样本一起训练。

Epoch

所有样本一起训练一次叫一个epoch

miniBatch

一次训练的不是全部的样本。

SGD

一次只训练一个样本,然后用这个样本来更新梯度。我们通常说的SGD是指miniSGD

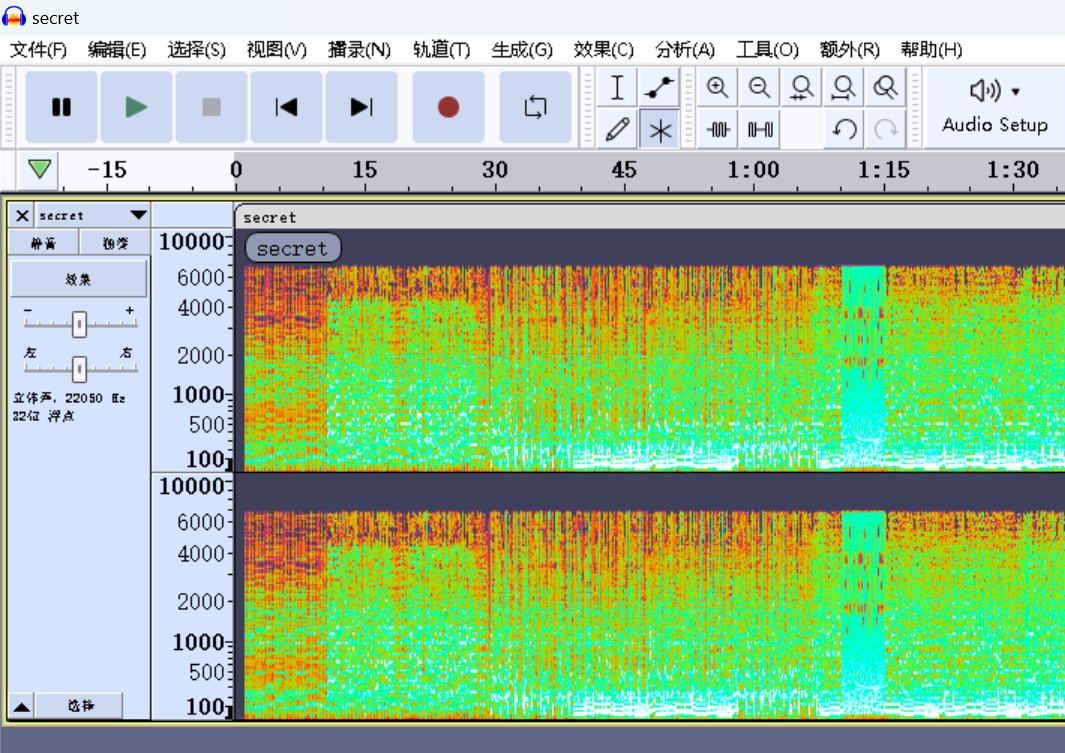

鞍点

如下图所示:

鞍点是一个平的点,在该点处梯度为0,但是并不是我们想要的点。

梯度爆炸

对于复杂的模型,某个点的梯度非常大,以至于下一步不知道往哪走。

对于梯度爆炸通常采用梯度裁剪的方式,即设定一个值,当梯度超过这个值的时候就把梯度设定为该值。

动量

可以理解为惯性。

总结

提示:这里对文章进行总结:

例如:以上就是今天要讲的内容,本文仅仅简单介绍了pandas的使用,而pandas提供了大量能使我们快速便捷地处理数据的函数和方法。

![未来已来:LLMops如何重塑AI-native新范式的运维格局[行业范式]、以及主流LLMops推荐](https://img-blog.csdnimg.cn/img_convert/b48cbc942f87508630054a75698952dc.png)