逻辑回归是一种广义的线性回归模型,用于解决二分类问题。它通过Sigmoid函数将线性回归模型的输出转换为0到1之间的概率值,用于预测二元响应变量的分类概率。在逻辑回归中,我们通过极大化似然函数或最小化损失函数(如对数损失函数)来求解模型参数,并利用梯度下降算法进行参数优化。

案例分析

前进银行搜集了贷款用户的数据,包括用户年龄、欠款额(百元)、月收入(元)和是否逾期的信息,数据在下表中。使用五个用户的数据建立一个逻辑回归模型。通过6号用户的个人信息,判断用户贷款20万元后是否会逾期。

阶段一:建立逻辑回归模型

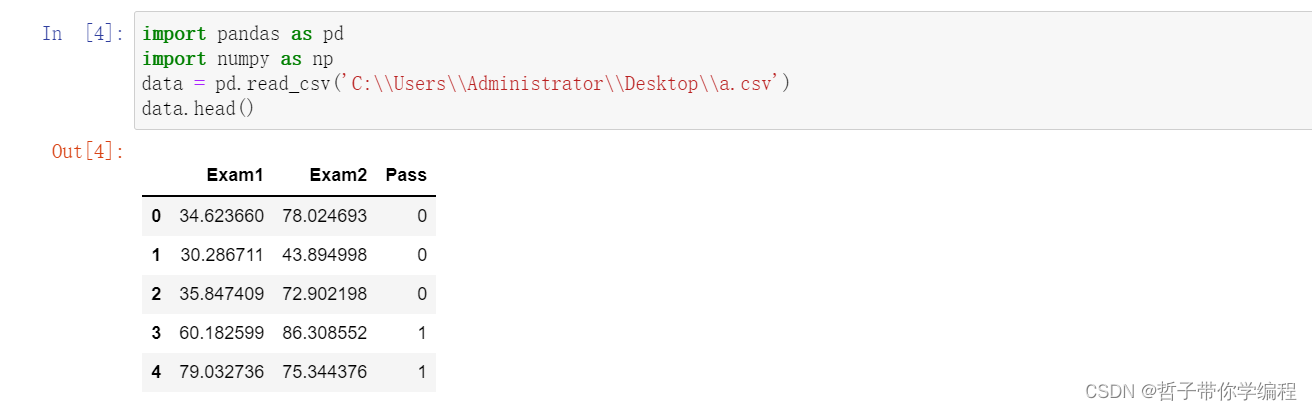

STEP1:加载数据集

import pandas as pd

df = pd.read_csv("exp08credit-overdue.csv", header=0) # 加载数据集

df.head() #查看前5行数据STEP2:绘制数据的散点图,查看数据分布情况

from matplotlib import pyplot as plt

## 在Notebook中内嵌绘图,使得绘制的图形可以直接在Notebook中显示

%matplotlib inline

plt.figure(figsize=(10, 6))

# 定义了一个字典map_size,它将overdue列的值(假设为0或1)映射到一个特定的大小

map_size = {0: 20, 1: 100}

# 使用map函数和一个匿名函数(lambda函数)来根据df['overdue']列中的每个值从map_size字典中获取对应的大小,

# 并将结果转换为列表。这样,我们就得到了一个与df['overdue']列相对应的大小列表。

size = list(map(lambda x: map_size[x], df['overdue']))

# 根据DataFrame df中的三列数据('debt', 'income', 和 'overdue')来绘制一个散点图

# 其中点的大小和颜色都根据'overdue'列的值来确定。

plt.scatter(df['debt'],df['income'], s=size,c=df['overdue'],marker='v')

STEP3:定义Sigmoid函数、损失函数,使用梯度下降确定模型参数

#定义Sigmoid函数,用于将线性回归的输出转换为概率值

#当输入(z)很大时,(σ(z))趋近于1;当输入(z)很小时,(σ(z))趋近于0。

#因此,sigmoid函数能够将任意实数值映射到[0, 1]区间,从而解释为一个概率。

def sigmoid(z):

sigmoid = 1./(1.+np.exp(-z))

return sigmoid

#定义对数损失函数,用于度量模型预测的概率(h)与真实标签(y)之间的差异。

#当真实标签(y)为1时,损失只与(-\log(h))相关;当(y)为0时,损失只与(-\log(1 - h))相关。

#因此,模型会尝试最大化预测正确的概率,从而最小化损失。

def loss(h, y):

loss = (-y * np.log(h) - (1 - y) * np.log(1 - h)).mean()

return loss

#定义梯度下降函数,用于计算损失函数关于模型参数(w)的梯度。

#梯度下降是一种优化算法,通过迭代地更新模型参数来最小化损失函数。

#在每次迭代中,它计算损失函数在当前参数下的梯度,然后沿着梯度的反方向(即损失函数下降最快的方向)更新参数。

def gradient(X, h, y):

# 这里 X 是特征矩阵(包含截距项),h 是模型预测的概率

# y 是真实标签,y.shape[0] 是样本数量。

gradient = np.dot(X.T, (h - y)) / y.shape[0]

return gradient

# 逻辑回归过程

def Logistic_Regression(x, y, lr, num_iter):

intercept = np.ones((x.shape[0], 1)) # 初始化截距为 1

x = np.concatenate((intercept, x), axis=1)

w = np.zeros(x.shape[1]) # 初始化参数为 0

l_list = [] # 保存损失函数值

for i in range(num_iter): # 梯度下降迭代

z = np.dot(x, w) # 线性函数

h = sigmoid(z) # sigmoid 函数

g = gradient(x,h,y) # 计算梯度

w -= lr * g # 通过学习率 lr 计算步长并执行梯度下降

z = np.dot(x, w) # 更新参数到原线性函数中

h = sigmoid(z) # 计算 sigmoid 函数值

l = loss(h,y) # 计算损失函数值

l_list.append(l)

return w,l_list # 返回迭代后的参数和损失值列表STEP4:初始化模型,并对模型进行训练

import numpy as np

x = df[['debt','income']]

y = df['overdue']

lr = 0.01 # 学习率

num_iter = 30000 # 迭代次数

# 模型训练

w_y,l_y = Logistic_Regression(x,y,lr,num_iter)

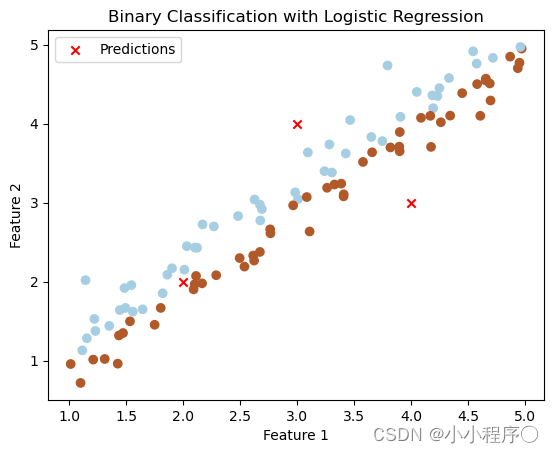

print("回归系数:",w_y)STEP5:根据得到的参数,绘制模型分类线

plt.figure(figsize=(10, 6))

map_size = {0: 20, 1: 100}

size = list(map(lambda x: map_size[x], df['overdue']))

plt.scatter(df['debt'],df['income'], s=size,c=df['overdue'],marker='v')

x1_min, x1_max = df['debt'].min(), df['debt'].max(),

x2_min, x2_max = df['income'].min(), df['income'].max(),

xx1, xx2 = np.meshgrid(np.linspace(x1_min, x1_max), np.linspace(x2_min, x2_max))

grid = np.c_[xx1.ravel(), xx2.ravel()]

probs = (np.dot(grid, np.array([w_y[1:3]]).T) + w_y[0]).reshape(xx1.shape)

plt.contour(xx1, xx2, probs, levels=[0], linewidths=1, colors='red');

STEP6:绘制损失函数变化曲线

plt.figure(figsize=(10, 6))

plt.plot([i for i in range(len(l_y))], l_y)

plt.xlabel("Number of iterations")

plt.ylabel("Loss function")

阶段二:对信用卡逾期进行预判

STEP1:读取数据

import numpy as np

data=np.array([[20,7000,800,1],[35,2000,2500,0],[27,5000,3000,1],[32,4000,4000,0],[45,2000,3800,0]])

data[:,:3] STEP2:绘图显示数据

import matplotlib.pyplot as plt

from mpl_toolkits.mplot3d import Axes3D, axes3d

X1 = data[:,0]#age

X2 = data[:,1] #debt

X3 = data[:,2] #income

Y = data[:,3] #overdue

figure = plt.figure()

ax = figure.add_subplot(111, projection='3d')

mask = 0

ax.scatter(X1[Y==0], X2[Y==0], X3[Y==0], c='b', s=120, edgecolor='k')

ax.scatter(X1[Y==1], X2[Y==1], X3[Y==1], c='r', marker='^',s=120, edgecolor='k')

ax.set_title('Credit data visualization') #设置图表标题

ax.set_xlabel("Age")

ax.set_ylabel("Debt")

ax.set_zlabel("Income")

# 设置新的观察视角

ax.view_init(elev=-152, azim=-26) #elev、azim设置y轴、z轴旋转角度

# 显示图形

plt.show()

STEP3:建立逻辑回归模型

from sklearn import linear_model

lr=linear_model.LogisticRegression()

lr.fit(data[:,:3], data[:,3]) STEP4:返回预测结果

display(lr.coef_)

display(lr.intercept_)STEP5:使用参数绘制分类结果图

coef=lr.coef_[0]

intercept=lr.intercept_[0]

figure = plt.figure()

ax = figure.add_subplot(111, projection='3d')

xx = np.linspace(X1.min() - 0.02, X1.max() +0.02, 50) #生成分类面x样本点

yy = np.linspace(X2.min() - 0.02, X2.max() +0.02, 50) #生成分类面y样本点

XX, YY = np.meshgrid(xx, yy)

ZZ = (coef[0] * XX + coef[1] * YY + intercept) / -coef[2] #生成分类面z样本点

ax.plot_surface(XX, YY, ZZ, rstride=8, cstride=8, alpha=0.3) #生成分类面

ax.scatter(X1[Y==0], X2[Y==0], X3[Y==0], c='b',s=60, edgecolor='k')

ax.scatter(X1[Y==1], X2[Y==1], X3[Y==1], c='r', marker='^',s=60, edgecolor='k')

ax.scatter(30,3500,3500, c='g', marker='s',s=60, edgecolor='k')

ax.set_xlabel("Age")

ax.set_ylabel("Debt")

ax.set_zlabel("Income")

# 设置新的观察视角

ax.view_init(elev=-152, azim=-26) #elev、azim设置y轴、z轴旋转角度

# 显示图形

plt.show()

coef=lr.coef_[0]

intercept=lr.intercept_[0]

figure = plt.figure()

ax = figure.add_subplot(111, projection='3d')

xx = np.linspace(X1.min() - 0.02, X1.max() +0.02, 50) #生成分类面x样本点

yy = np.linspace(X2.min() - 0.02, X2.max() +0.02, 50) #生成分类面y样本点

XX, YY = np.meshgrid(xx, yy)

ZZ = (coef[0] * XX + coef[1] * YY + intercept) / -coef[2] #生成分类面z样本点

ax.plot_surface(XX, YY, ZZ, rstride=8, cstride=8, alpha=0.3) #生成分类面

ax.scatter(X1[Y==0], X2[Y==0], X3[Y==0], c='b',s=60, edgecolor='k')

ax.scatter(X1[Y==1], X2[Y==1], X3[Y==1], c='r', marker='^',s=60, edgecolor='k')

ax.scatter(30,3500,3500, c='g', marker='s',s=60, edgecolor='k')

ax.set_xlabel("Age")

ax.set_ylabel("Debt")

ax.set_zlabel("Income")

# 设置新的观察视角

ax.view_init(elev=152, azim=-26) #elev、azim设置y轴、z轴旋转角度

# 显示图形

plt.show()