{

"assistant_token_id": 196,

"bos_token_id": 1,

"do_sample": true,

"eos_token_id": 2,

"max_new_tokens": 2048,

"pad_token_id": 0,

"repetition_penalty": 1.05,

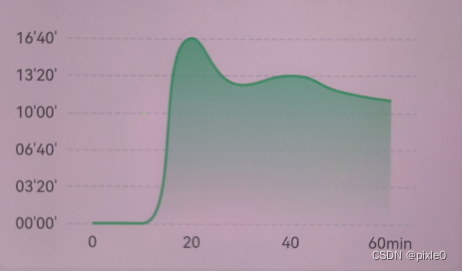

"temperature": 0.3,

"top_k": 5,

"top_p": 0.85,

"transformers_version": "4.32.1",

"user_token_id": 195

}

1.Topk

只考虑概率最大的topk个token

2.Top p

从概率最高的token开始累计,直到累计的概率超过了top p。

3.Temperature

T越大越发散,T越小,越稳定,温度嘛,其实就是在softmax中增加了一个T,常见做法。

4.do_sample

true,模型在生成文本时使用采样方法,而不是直接选择概率最高的下一个token。

5.reptition penalty

防止重复