YOLOv8改进 | 注意力机制 | 添加混合局部通道注意力——MLCA【原理讲解】

💡💡💡本专栏所有程序均经过测试,可成功执行💡💡💡

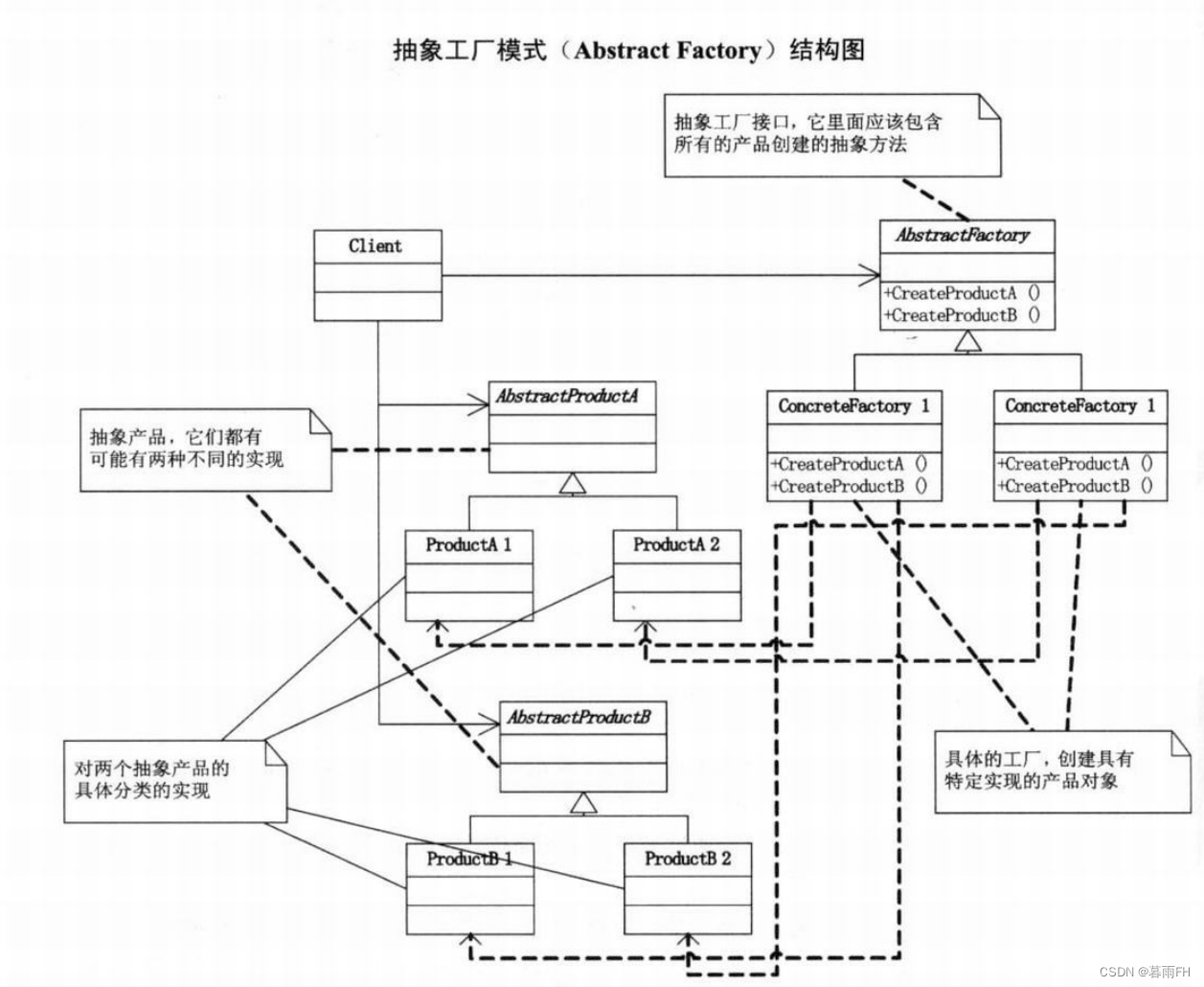

注意力机制是计算机视觉中最广泛使用的组件之一,它可以帮助神经网络强调重要元素并抑制不相关的元素。然而,绝大多数的通道注意力机制只包含通道特征信息而忽略了空间特征信息,这导致了模型表征效果或对象检测性能不佳,而且空间注意力模块通常复杂且成本高昂。为了在性能和复杂性之间取得平衡,研究人员一种轻量级的混合局部通道注意力(MLCA)模块,以提高对象检测网络的性能,并且它能够同时整合通道信息与空间信息,以及局部信息和全局信息,以提高网络的表达效果。文章在介绍主要的原理后,将手把手教学如何进行模块的代码添加和修改,并将修改后的完整代码放在文章的最后,方便大家一键运行,小白也可轻松上手实践。以帮助您更好地学习深度学习目标检测YOLO系列的挑战。

专栏地址:YOLOv8改进——更新各种有效涨点方法——点击即可跳转

目录

1. 原理

2. MLCA代码实现

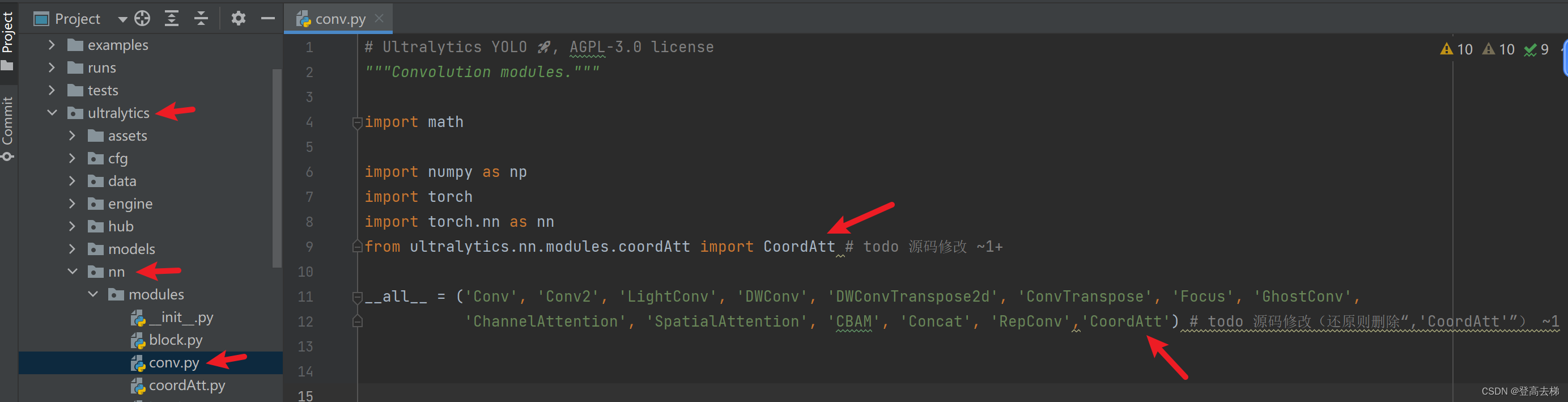

2.1 将MLCA添加到YOLOv8代码中

2.2 更改init.py文件

2.3 添加yaml文件

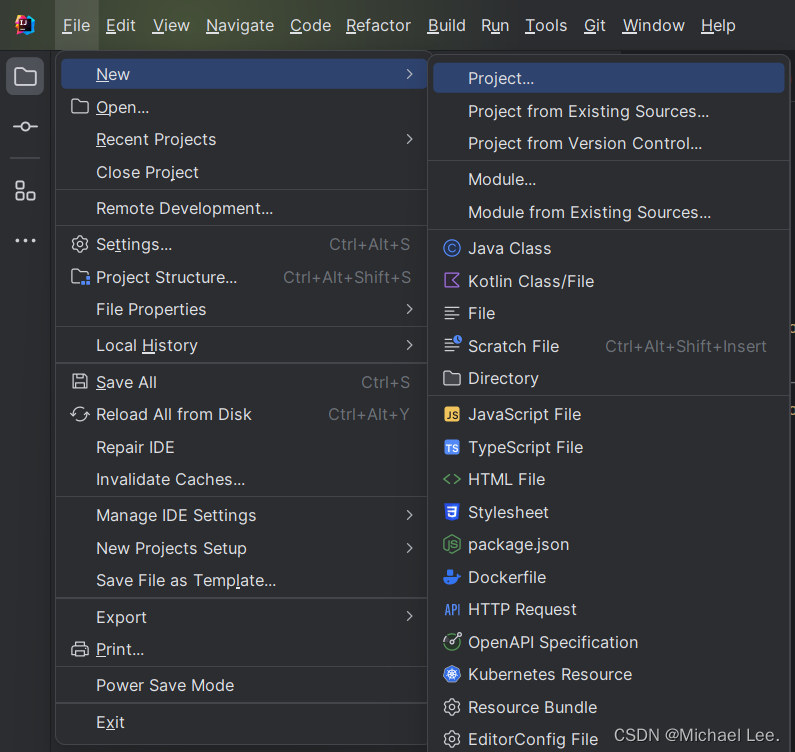

2.4 在task.py中进行注册

2.5 执行程序

3. 完整代码分享

4. GFLOPs

原文地址:https://blog.csdn.net/m0_67647321/article/details/139674397

本文来自互联网用户投稿,该文观点仅代表作者本人,不代表本站立场。

本站仅提供信息存储空间服务,不拥有所有权,不承担相关法律责任。

如若转载,请注明出处:https://www.suanlizi.com/kf/1801997601185337344.html

如若内容造成侵权/违法违规/事实不符,请联系《酸梨子》网邮箱:1419361763@qq.com进行投诉反馈,一经查实,立即删除!

![【<span style='color:red;'>YOLOv</span><span style='color:red;'>8</span><span style='color:red;'>改进</span>[<span style='color:red;'>注意力</span>]】使用<span style='color:red;'>MLCA</span><span style='color:red;'>混合</span><span style='color:red;'>局部</span><span style='color:red;'>通道</span><span style='color:red;'>注意力</span><span style='color:red;'>改进</span>c2f + 含全部代码和详细修改方式 + 手撕结构图](https://img-blog.csdnimg.cn/direct/4fd1c0c2810140eb810f318d32f8f727.png)