运动想象分类学习系列:GITGAN

论文地址:https://www.sciencedirect.com/science/article/abs/pii/S0031320323007124

论文题目:GITGAN: Generative inter-subject transfer for EEG motor imagery analysis

论文代码:https://github.com/Kang1121/GITGAN

0. 引言

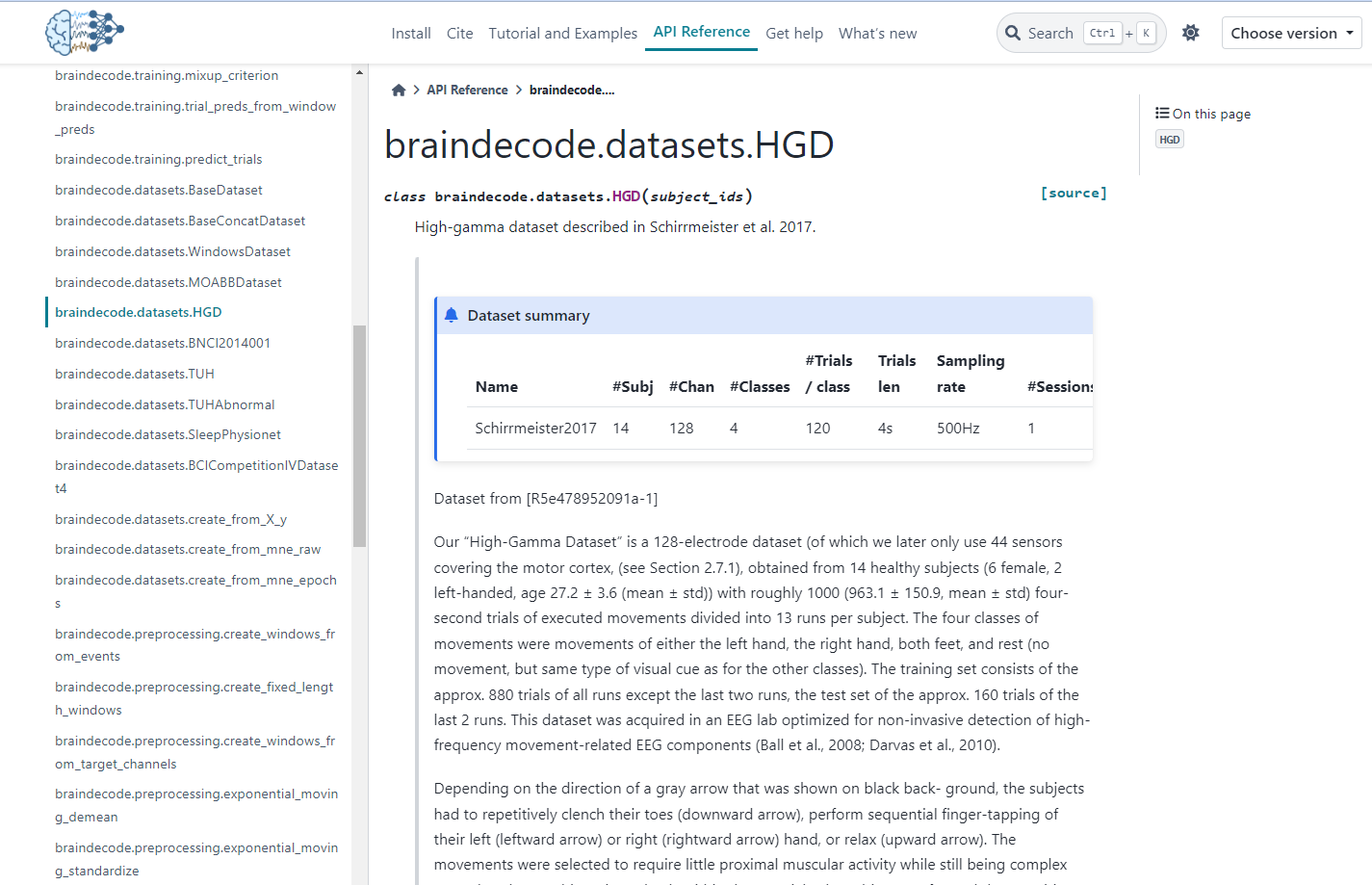

以往的研究主要集中在开发复杂的网络架构设计上,忽视了源数据质量的影响和分布外目标数据问题带来的挑战。为了解决这些局限性,我们认为,以目标数据为中心的空间,加上精心挑选的一组高质量源数据,可以显着增强发展议程。在这项研究中,我们提出了一种称为 GITGAN 的无监督端到端受试者适应方法,这是一种用于脑电图运动图像分析的生成性受试者间转移。我们还提出了一种实用有效的源数据选择方法,进一步提高了性能。我们的方法是非侵入式的,因为它不会修改目标数据分布,从而保持其完整性,以便进行进一步的数值和视觉分析。

总的来说,有代码就证明了文章的优异性和合理性,感兴趣的同学可以在自己的数据上进行测试。 需要注意的是如果选一个比较好的目标数据以及GAN训练如何达到一个很好的生成器、判别器之间的平衡。。。

1. 主要贡献

- 为BCI系统开发了一种创新的

无监督端到端受试者间转移方法 - 提出了一种实用有效的

源数据选择方法

2. 提出的方法

我们的生成式受试者间转移框架概述,该框架结合了异常值去除和数据增强,采用生成式学习进行受试者间转移,并提高了下游脑电图运动想象任务的性能。

2.1 GITGAN框架

测绘网络 f θ f_θ fθ通过编码器-生成器结构 ( f e n c f_{enc} fenc和 f g e n f_{gen} fgen)和预测模型 q φ q_φ qφ由另一个编码器 ( q e n c q_{enc} qenc和 q c l s q_{cls} qcls).首先将源数据编码为高维向量,使用 f e n c f_{enc} fenc并由 f g e n f_{gen} fgen映射过程以对抗方式进行训练,其中判别器 d d d用于评估传输的数据是否属于目标域。

整个框架以端到端的方式进行训练,其中 q e n c q_{enc} qenc 和 q c l s q_{cls} qcls 在训练后立即为测试阶段做好准备。

2.2 异常值去除

虽然以前的研究忽略了适应样本的选择,但承认硬负样本对模型性能的潜在副作用,因此避免使用所有训练样本(用深绿色表示)而只选择高质量样本的子集(用浅绿色表示)至关重要。浅绿色虚线内的样本被认为包含更基本和实质性的类相关模式,而外部的样本可能更容易受到噪声的影响。

从问题的本质上来讲,主要包含以下两个步骤:

- 降维。第一步涉及使用

主成分分析(PCA)来减少原始数据的维度。 - 聚类。为了在

去除异常值后保持每个类别的样本数量的平衡,我们提出了基于原始样本的cbaDBSCAN。它通过对不同类别应用唯一比率来解决数据不平衡的挑战。

2.3 领域适配

作为一种常用的策略,我们利用生成对抗学习来识别和减轻领域差异,目的是弥合源领域和目标领域之间的差距。鉴别器旨在区分潜在空间中的源数据表示和目标数据表示,而生成器则努力将源数据的特征样式传输到目标域,以试图欺骗鉴别器做出错误的分类。

2.4 标签一致性

为了在从源域到目标域的主体间转移过程中保留标签信息,我们引入了一种“内类转移”机制。如图4(b)所示,该机制利用源域中的可用标签信息在传输过程中保持标签一致性。因此,传输的数据保留了领域和类知识。

具体来说,我们直接将源数据的标签作为伪标签,并分配给传输的数据,这在实践中更直接,在概念上也更合理。

3. 结果

3.1 与基线模型的比较

3.2 模型可解释性

逐层相关性传播 (LRP) 是一种事后可解释性技术,旨在解释预训练神经网络的预测。LRP 的原理是为网络每一层的每个神经元分配一个相关性分数。这些相关性分数从输出层向后分布到输入层,从而提供了模型决策过程的详细视图。

基线方法指示了活动区域,尽管方式不太精确。我们的 GITGAN 模型展示了对侧半球的高度激活的信号和运动想象任务的同侧半球上的抑制信号,这与现有的神经科学理解一致。

3.3 消融实验

消融研究的说明性结果:

MixUp数据增强消融性实验结果:

4. 总结

到此,使用 运动想象 (MI) 分类学习系列 (11) :GITGAN 已经介绍完毕了!!! 如果有什么疑问欢迎在评论区提出,对于共性问题可能会后续添加到文章介绍中。

如果觉得这篇文章对你有用,记得点赞、收藏并分享给你的小伙伴们哦😄。

欢迎来稿

欢迎投稿合作,投稿请遵循科学严谨、内容清晰明了的原则!!!! 有意者可以后台私信!!

![[C++基础学习]----03-程序流程结构之循环结构详解](https://img-blog.csdnimg.cn/direct/9efc45baa2d54f0db5f89d888c0772e7.png)