1、写作动机:

直接将LLMs应用于图模态存在独特挑战,因为图和文本模态之间存在差异和不匹配。因此,为了进一步探究LLMs理解图信息的潜力,作者引入了GraphPrompter,这是一个通过软提示将图信息与LLMs对齐的新型框架。

2、主要贡献:

• 这是第一项研究LLMs是否可以通过软提示理解图学习任务的工作。

• 提出了GraphPrompter,这是一个新颖的即插即用框架,首先使用GNN从文本图中获取节点表示。然后,所得到的嵌入与提示指令连接,以指导LLMs进行图学习任务。

3、方法:

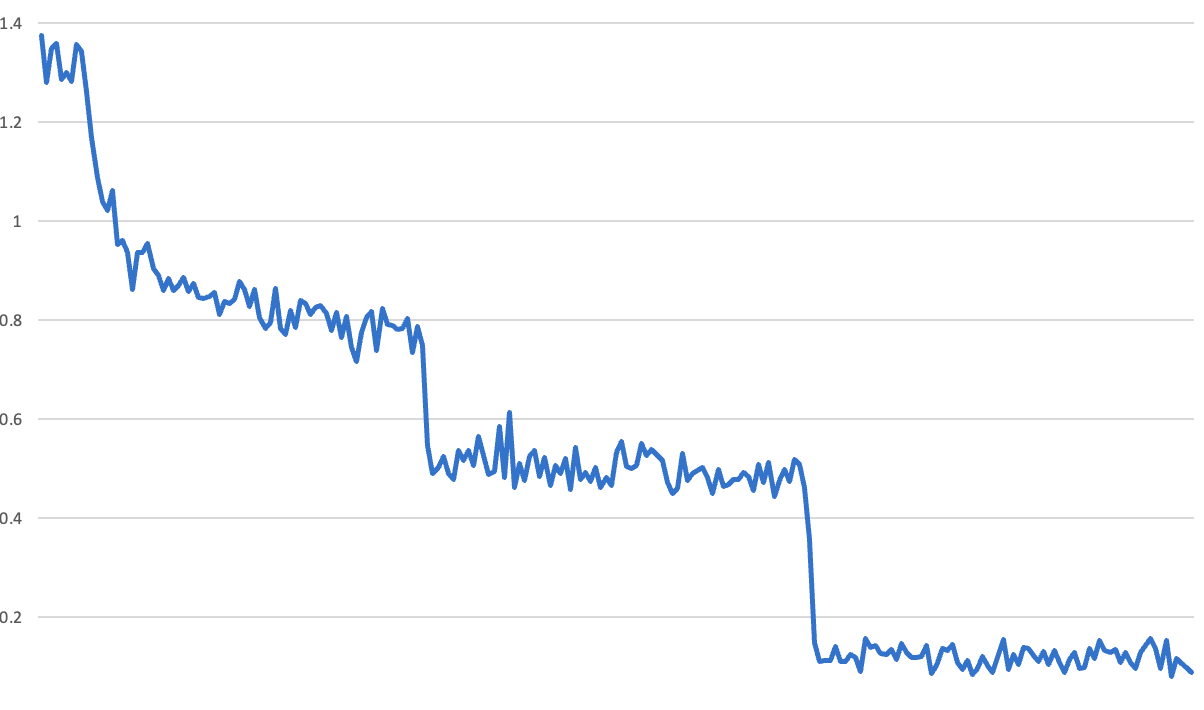

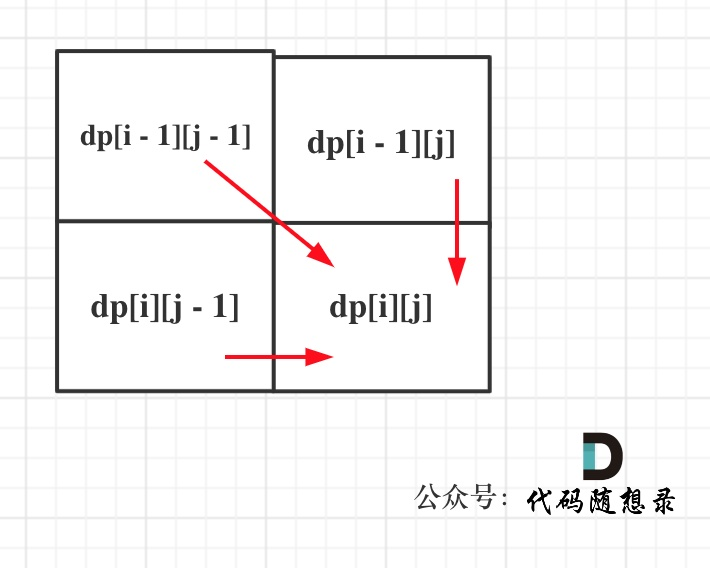

GNN部分:将 3-跳子图 𝐺𝑠𝑖 定义为包含从 𝑣𝑖 开始的所有节点的诱导子图,距离不超过三跳。随后,使用GNN计算每个子图 𝐺𝑠𝑖 的节点嵌入 𝑋𝑖:𝑋𝑖 = GNN(𝐺𝑠𝑖 ),每个嵌入 𝑋𝑖 捕捉了相应子图的结构信息,提供了与 𝑣𝑖 相关的拓扑特征的丰富表示。然后使用一个投影层,具体来说是一个多层感知机(MLP),来将节点嵌入与LLM的向量空间对齐。

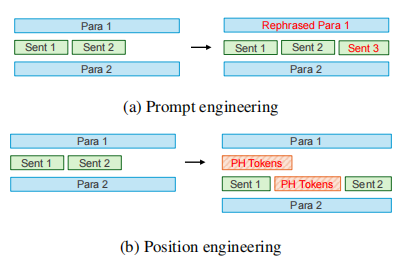

LLM部分:对于每个节点 𝑣𝑖,给定其关联的文本属性 𝑇𝑖,使用LLM的冻结分词器对 𝑇𝑖 进行分词:𝑇tokens = Tokenizer(𝑇𝑖 )。分词器将文本转换为LLM词汇表中的一系列离散标记 okens。随后,这些标记被嵌入到连续空间中:𝑇emb = Embed(𝑇tokens) 这些嵌入被设计为捕捉文本的语义含义,与GNN提供的结构信息相辅相成。接下来,我们将节点嵌入和文本嵌入连接起来,,然后将其传递到LLM中的自注意力层中。