Solr面试题

- 1. Solr 基础概念

- 2. Solr 数据管理

- 3. Solr 索引和搜索

- 4. Solr 运行和维护

- 5. Solr 性能优化

- 6. Solr 和其他搜索平台对比

- 7. Solr 高级特性

- 8. Solr 查询处理

- 9. Solr 问题排查与优化

- 10. Solr 前沿和最佳实践

1. Solr 基础概念

1.1 解释 Solr 是什么以及它的应用场景

Apache Solr 是一个开源的搜索平台,它基于 Apache Lucene 构建。Solr 提供了全面的文本搜索功能,内建分布式搜索和索引复制,并且拥有高度的可扩展性和容错能力。因此,Solr 是企业搜索引擎的不二选择。它被设计用于处理大量的网页内容,提供高效的搜索功能。

Solr 的主要特点包括:

高性能与可伸缩性:

Solr 支持高并发的数据检索和高效地进行索引。强大的索引功能:

Solr 可以处理各种类型的文本内容,表现出色的分词、检索、排序和过滤能力。多样的搜索能力:

提供拼写检查、查询建议、自动完成等搜索相关功能。高度可定制:

可以通过 Solr 的 API 进行高度定制和扩展,以满足特定需求。丰富的数据操作:

支持数据的 JSON, XML, CSV 等多种格式导入。庞大的社区和文档:

由于 Solr 有着庞大的用户基础,网络上有丰富的文档、指南和社区讨论。

应用场景

企业内部的搜索引擎:

Solr 可用于企业内部的文档和数据搜索,提供员工快速找到所需信息的能力。电子商务网站:

在电商平台上,Solr 可以提供商品搜索,支持高级特性如价格过滤、评分排序等。内容管理系统:

对于那些内容丰富的网站,如新闻网站、博客等,Solr 能提供高效的内容检索与管理。社交媒体应用:

在社交媒体或类似的应用中,Solr 可以用于实现快速消息、帖子、评论的搜索。数据分析:

Solr 强大的分面搜索(Faceted Search)能力使其成为数据分析领域的有力工具。科研项目:

在科研工作中,Solr 可以被用于大规模文档集合的组织、搜索和分析。

Apache Solr 的这些特性和应用场景展示了它作为企业级搜索解决方案的实力。无论是从简单的文本搜索到复杂的数据处理需求,Solr 都能以其高度的灵活性和扩展性满足不同规模企业的需求。

1.2 描述 Solr 架构及其核心组件

Apache Solr 是一个高性能,基于 Lucene 的全文搜索服务器,它提供了丰富的搜索功能,包括文本搜索、命中标记、分布式搜索、实时索引等。了解 Solr 的架构和其核心组件对于设置和维护 Solr 实例是非常重要的。

Solr 架构

Solr 可以运行在独立模式或 SolrCloud 模式。在独立模式中,Solr 运行在单个 JVM 实例中。而 SolrCloud 模式提供了分布式架构,支持在多个 Solr 服务器上分布式索引和搜索。

在 SolrCloud 模式下,架构的关键特性包括:

集群(Cluster):

- 集群由多个 Solr 服务器组成,这些服务器相互协作提供全文搜索和索引功能。

分片(Sharding):

- 数据被分为多个部分,称为分片,这可以在多个 Solr 服务器之间平衡数据存储工作负载。

副本(Replication):

- 每个分片可以有多个副本,确保高可用性和负载均衡。副本之一成为领导者(Leader),其余副本作为追随者(Followers)并复制领导者的更新。

ZooKeeper:

- 一个分布式协调服务,用来管理集群状态、配置信息并协调分片和副本操作。

Solr 核心组件

Core(核心):

- 在 Solr 中,

core是一个运行在单个 Solr 服务器上独立索引和配置的实例。每个 Solrcore包含一组配置文件、索引文件和 Solr 的不同组件。

- 在 Solr 中,

Schema(模式):

- 通常被定义为

schema.xml,它描述了索引中文档的结构,包括字段和字段类型等。

- 通常被定义为

Config(配置):

- 在

solrconfig.xml文件中定义了 Solr 实例的配置,包括查询处理器、请求处理器、监听器等。

- 在

Search Components(搜索组件):

- 负责处理查询请求,如搜索组件、请求处理器、响应处理器等。

Update Components(更新组件):

- 负责处理文档的添加、更新和删除操作。

Query Parser(查询解析器):

- 将用户查询转换为 Lucene 查询。

Response Writer(响应写入器):

- 将搜索结果格式化为不同的输出格式(如 XML、JSON)。

Request Handler(请求处理器):

- 解析请求并分派到不同的组件。

Index Writer(索引写入器):

- 负责将文档写入 Lucene 索引。

这些组件共同协作,使得 Solr 能够处理复杂的搜索需求。Solr 提供了强大的 REST 风格的 API,这使得与各种编程语言进行交互成为可能。如果您需要了解更多关于 Solr 的架构细节和核心组件功能,或需要帮助,请随时提问。

1.3 讨论 Solr 的索引过程和原理

Apache Solr 是一个企业级搜索平台,建立在 Apache Lucene 搜索库之上。Solr 提供了全文搜索功能,包括处理文本数据的索引和查询设施。以下是 Solr 中索引的过程和原理的概述。

索引过程

索引是搜索引擎操作的关键部分,是将数据转换为可以快速搜索的结构的过程:

数据摄入(Data Ingestion):

- 数据被提交给 Solr,可能是通过添加文档的 HTTP 请求,或通过 Solr 提供的摄入工具,如 Data Import Handler (DIH)。

- 数据可以是结构化的(例如,来自数据库的数据)或非结构化的(例如,文本文件)。

文档处理(Document Processing):

- Solr 接收到数据后,文档会经历处理管道。

- 文档可以分为多个字段,每个字段对应一个类型,由

schema.xml中的定义决定。

分析和标记化(Analysis and Tokenization):

- 对字段内容进行分析,分析器(Analyzer)通过 Tokenizer 进行文本分割,并可应用多个 TokenFilter 对生成的 Token 进行处理。

- 例如,文本可能会被分成单词,并应用小写化、停止词过滤、词干提取等处理。

建立索引(Indexing):

- 处理好的 Token 被添加到倒排索引中。

- 倒排索引是 Solr 搜索的核心数据结构,它允许通过 Token 快速定位到包含该 Token 的文档。

- 索引将包含关于字段名称、Token 以及 Token 在文档中出现位置的信息。

索引更新和提交(Index Updates and Commits):

- 在文档被索引之后,必须执行提交操作,以使更改永久化到磁盘。

- Solr 支持近实时搜索,也就是说,在提交之前对新索引或更新的索引进行软提交(soft commit)就能够被搜索到。

索引原理

Solr 通过 Lucene 实现了强大的文本分析和索引机制:

全文搜索能力:Solr 利用倒排索引来执行全文搜索,这意味着它是根据文档中的 term(词项)来检索文档的。

扩展性:Solr 设计为可水平扩展,能够构建分布式搜索架构,如 SolrCloud 模式,它支持分片(sharding)、复制(replication)和故障转移(failover)。

高级功能:Solr 提供了许多高级搜索功能,比如 faceting(分面搜索)、highlighting(高亮显示)、spell checking(拼写检查)以及更复杂的查询逻辑。

注意事项

- 索引设计和分析器的选择对搜索结果的相关性、性能以及用户体验有重要影响。

- 索引结构、大小以及更新频率可能影响搜索响应时间和系统资源的使用。

- 索引时需谨慎处理像多值字段、动态字段等复杂的字段结构。

- 索引的维护包括定期优化(比如合并索引段)和清理,以确保搜索服务的最佳性能。

Solr 的索引过程是一个涉及多个步骤的复杂过程,通过配置合适的索引策略能够为用户提供快速、准确的搜索体验。

2. Solr 数据管理

2.1 分析 Solr 中的文档、字段和字段类型概念

Apache Solr 是一个开源的搜索平台,基于 Lucene 库构建。它广泛用于全文搜索、命中标记、分面搜索等。了解 Solr 中的文档、字段和字段类型对于配置索引和实现高效搜索至关重要。

文档(Documents)

在 Solr 中,文档(Document)是搜索和索引的基本单位,可以看作与数据库中的一行记录类似。每个文档表示一个实体或对象,并且包含一系列字段。文档是非结构化的,意味着每个文档可以有不同的字段。

{

"id": "1",

"title": "The Great Gatsby",

"author": "F. Scott Fitzgerald"

}

这个 JSON 对象代表一个包含三个字段的 Solr 文档,字段包括:id、title 和 author。

字段(Fields)

字段是文档的构成元素。每个字段有一个名称和对应的值。字段的特性决定了它如何被索引和搜索。例如,一些字段可能是可搜索的文本字段,而另一些字段可能是整数或是日期字段,用于排序或过滤。

在 Solr 中,你必须在 schema 文件(通常是 schema.xml 或通过 Schema API 定义)中定义字段名称、类型、是否存储或索引等属性。

<field name="title" type="text_general" indexed="true" stored="true"/>

这个 XML 配置定义了一个名称为 title 的字段,它的类型是 text_general,是可索引的并且被存储。

字段类型(Field Types)

字段类型定义了字段的特性,如数据类型、分析器(Tokenizer 和 Filters)等。字段类型决定了字段内容如何被处理和解析,例如,文本字段可能会被拆分成词项(tokens)并被转化为小写,删除停用词,等等。

在 Solr 的 schema 中,字段类型是预先定义的。在 Solr 配置好的默认 schema 中,已经包含了许多基本的字段类型,例如 text_general, string, int 和 date。

<fieldType name="text_general" class="solr.TextField" positionIncrementGap="100">

<analyzer>

<tokenizer class="solr.StandardTokenizerFactory"/>

<filter class="solr.StopFilterFactory" ignoreCase="true" words="stopwords.txt"/>

<!-- 更多的 filter -->

</analyzer>

</fieldType>

这个配置定义了一个 text_general 类型的字段,使用 StandardTokenizerFactory 分析器和 StopFilterFactory 过滤器进行处理。

为什么这些概念重要

- 文档:理解文档是如何被索引和搜索的,可以帮助你设计数据导入过程和搜索界面。

- 字段:正确配置字段是优化搜索精度和性能的关键。例如,你可能希望字段被索引以便可搜索,或存储以在搜索结果中可见。

- 字段类型:了解不同字段类型的分析链可以帮助你更好地控制搜索结果的相关性。

配置文档、字段和字段类型是设置 Solr 索引的根基。根据应用程序的需求,合理地配置这些属性可以显著提升搜索的效率和效果,以及为用户提供更加相关的搜索结果。在实施过程中,Solr 对这些结构提供了高度的可定制性和灵活性,使其能够适应各种不同的数据搜索需求。

2.2 描述如何在 Solr 中配置和管理模式(Schema)

Apache Solr 是一个流行的开源搜索平台,提供全文搜索、高亮显示、分面搜索等功能。Solr 通过定义模式(Schema)来管理索引中字段的类型和行为。模式文件通常称为 schema.xml,存在于 Solr 配置目录中的核心或集合中。

以下是在 Solr 中配置和管理模式的基本步骤:

1. 创建模式文件 schema.xml

对于一个新的 Solr 核心或集合,你需要提供一个 schema.xml 文件,它定义了索引中的字段和字段类型。这个文件位于核心的 conf 文件夹中。

<schema name="example" version="1.5">

<fields>

<field name="id" type="string" indexed="true" stored="true" required="true" />

<field name="name" type="text_general" indexed="true" stored="true"/>

<field name="category" type="string" indexed="true" stored="true"/>

<field name="price" type="float" indexed="true" stored="true"/>

<!-- 更多字段定义 -->

</fields>

<uniqueKey>id</uniqueKey>

<!-- 字段类型定义 -->

</schema>

2. 定义字段类型

在模式文件中定义字段类型,这些类型决定了字段在索引和查询时的行为。Solr 提供了多种内置字段类型,你也可以创建自己的自定义字段类型。

<fieldTypes>

<fieldType name="string" class="solr.StrField" sortMissingLast="true" />

<fieldType name="text_general" class="solr.TextField">

<analyzer>

<!-- 配置分词器和过滤器 -->

</analyzer>

</fieldType>

<!-- 更多字段类型定义 -->

</fieldTypes>

3. 定义字段和动态字段规则

字段(field)定义指定了索引的字段名称、类型等属性。动态字段(dynamicField)允许你指定一组匹配模式,对索引中那些未在模式文件中显式定义的字段进行处理。

<fields>

<!-- 字段定义 -->

</fields>

<dynamicFields>

<dynamicField name="*_s" type="string" indexed="true" stored="true"/>

<dynamicField name="*_i" type="int" indexed="true" stored="true"/>

<!-- 更多动态字段规则 -->

</dynamicFields>

4. 配置默认搜索字段和唯一键

可以指定一个默认的搜索字段,如果在搜索请求中没有指定字段,就会使用这个字段。同时,你需要指定一个唯一的key(通常是ID),用于在Solr中唯一标识每个文档。

<defaultSearchField>name</defaultSearchField>

<uniqueKey>id</uniqueKey>

5. 使用 Solr 的 Schema API

从 Solr 5.x 开始,你可以使用 Schema API 动态地检索和修改模式的定义,而无需直接编辑 schema.xml 文件。例如,以下命令会添加一个新字段:

curl -X POST -H 'Content-type:application/json' --data-binary '{

"add-field":{

"name":"new_field",

"type":"string",

"stored":true }

}' http://localhost:8983/solr/collection/schema

6. 重新加载核心或集合

当你修改了 schema.xml 文件后,你需要重新加载 Solr 核心或集合:

curl "http://localhost:8983/solr/admin/cores?action=RELOAD&core=core_name"

或者,如果你使用 SolrCloud 模式:

curl "http://localhost:8983/solr/admin/collections?action=RELOAD&name=collection_name"

注意事项

- 在生产环境中修改模式可能会导致索引不兼容,因此最好在重新索引数据前仔细规划模式更改。

- 了解并使用 Solr 中支持的各种字段属性,如

indexed、stored和multiValued。 - 在定义字段类型时,确保为特定类型的数据选择合适的分词器和过滤器。

管理 Solr 模式需要仔细考虑数据结构、查询需求和性能优化。合理使用动态字段和 Schema API 可以提高开发效率并适应模式可能的改变。

2.3 讨论 Solr 支持的数据输入和输出格式

Apache Solr 是一款高性能、可扩展的搜索平台,它建立在 Apache Lucene 搜索库上。Solr 提供了广泛的文档输入和输出格式的支持,使得它能够与不同的数据源和客户端应用程序交互。以下是 Solr 支持的几种主要的数据输入和输出格式:

数据输入格式(Data Input Formats)

Solr 接受多种数据输入格式,以便索引和查询:

XML:

XML 是一种常用的输入格式。Solr 预期接收到的 XML 文档与其 schema.xml 文件中定义的结构相匹配。示例 XML 数据:

<add> <doc> <field name="id">1234</field> <field name="title">Example Title</field> </doc> </add>JSON:

JSON(JavaScript Object Notation)是一种轻量级的数据交换格式,易于人阅读和编写,并易于机器解析和生成。示例 JSON 数据:

{ "add": { "doc": { "id": "1234", "title": "Example Title" } } }CSV:

CSV(逗号分隔值)是一种表格数据表示格式,Solr 支持 CSV 格式的数据作为输入进行索引。示例 CSV 数据:

id,title 1234,Example TitleJava Bin:

SolrJ 客户端可以使用 Solr 的 Java 二进制格式(JavaBin)来高效传输数据。其他格式:

通过 Data Import Handler(DIH),Solr 还能处理来自数据库、RSS、文件系统等来源的数据。

数据输出格式(Data Output Formats)

Solr 查询响应可输出为以下几种格式:

XML:

通过 HTTP 参数wt=xml,Solr 可以输出 XML 格式的响应数据。JSON:

使用参数wt=json,Solr 可将查询结果输出为 JSON 格式,适合于前端应用和 JavaScript。CSV:

设置wt=csv参数让 Solr 输出 CSV 格式,方便导出和在表格处理软件中使用。Ruby、PHP、Python:

Solr 支持多种脚本语言的响应格式(wt=ruby,wt=php,wt=python),便于在对应的应用程序中快速解析响应。Java Bin:

使用参数wt=javabin获得 Java 二进制格式的输出,这是 SolrJ 客户端默认使用的格式。

除了通用的数据格式外,Solr 还提供了强大的配置选项,允许开发者通过自定义的 Response Writer 来控制特定的输出格式。

对于Solr的数据输入和输出,开发人员可以根据具体应用场景和技术栈需求选择最适合的数据交换格式。无论是构建互动网站、数据分析工具还是集成到更广泛的数据生态系统,Solr 的灵活性都能提供强有力的支持。

3. Solr 索引和搜索

3.1 讲述 Solr 索引优化的策略和技术

Apache Solr 是一个强大的搜索引擎,其性能很大程度上取决于索引的结构和优化。为了确保高效的查询响应和数据处理,可以采用以下策略和技术来优化 Solr 索引:

1. 文档建模和字段类型选择

- 精心设计文档模型:仔细规划存储在索引中的数据结构。使字段尽可能原子化,这有助于减少索引大小和提高查询效率。

- 选择合适的字段类型:为字段选择正确的类型,以确保存储和查询时的效率。

2. 索引策略

- 使用复制和分片:在 SolrCloud 环境中,通过分片来实现索引的分布存储和通过复制来实现冗余,从而提高查询速度和系统容错能力。

- 定期索引优化:定期执行优化操作可以减少索引段的数量,合并索引文件,提高查询性能,但会消耗较多系统资源,因此需要适时执行。

- 控制字段索引和存储:有选择性地为字段启用索引和存储,避免对不必要查询的字段进行索引。

3. 优化文档添加和更新

- 批量提交:通过批量添加或更新文档而非单个文档,可以显著提高索引性能。

- 自动提交策略:合理设置自动提交的时间间隔,以平衡索引性能和数据实时性的需求。

- 异步索引:在可能的情况下,异步添加文档到索引,避免阻塞主要的用户操作。

4. 索引时的性能调优

- 字段缓存调优:合理设置字段值缓存、查询结果缓存和文档缓存的大小,以便缓存常用查询和结果,但不要耗尽可用内存。

- 配置合理的合并因子:索引合并时的合并因子(merge factor)直接影响提交(commit)的性能,需要根据更新频率和查询负载调整。

5. 评估和调整 JVM 设置

- JVM 堆大小:为 Solr 分配足够的 JVM 堆内存,但避免过多,这样可以确保垃圾回收的高效性。

- 垃圾回收策略:选择正确的垃圾回收器,并对其参数进行调整,以适应特定的工作负载模式。

通过以上策略和技术的合理应用,可以有效提升 Solr 的索引性能,确保快速稳定的搜索体验。为实现最优的性能,应持续监控索引和查询性能,根据监控结果和实际工作负载不断调整优化策略。

3.2 分析 Solr 搜索和排名机制的工作原理

Apache Solr 使用基于 Apache Lucene 的搜索库来执行文本搜索,排名(ranking)则基于诸如文档相关度和查询匹配度的指标来决定。以下是 Solr 搜索和排名机制工作原理的大致概述:

Solr 搜索流程

用户查询:

- 用户输入搜索请求或查询(如关键词、短语或其他搜索条件),通常通过 Solr 的 HTTP API 发送。

查询解析:

- Solr 使用查询解析器(query parser)将用户输入的文本转换成能被搜索引擎理解的查询对象。这一步通常包括词法分析和语法分析,以及可能的查询优化。

搜索索引:

- 解析后的查询对象在索引中搜索,以找到匹配的文档。Lucene 索引由一系列倒排索引(inverted indexes)组成,这些索引提供了从词元(tokens)到文档列表的映射。

计算相关性得分:

- 对于搜索到的文档,Lucene 会计算一个相关性得分,它表示查询与每个文档的匹配程度。这个得分(通常称为

_score)基于几个因素,如词频(term frequency)、逆文档频率(inverse document frequency - IDF)、字段长度(field length)和其他可配置的评分因素。

- 对于搜索到的文档,Lucene 会计算一个相关性得分,它表示查询与每个文档的匹配程度。这个得分(通常称为

排序文档:

- 根据相关性得分和/或其他可能的排序准则(比如文档中的某个字段值),Solr 对结果进行排序。

返回结果:

- Solr 构造响应并返回给用户,包括搜索结果列表、得分、分页信息和可能的其他统计信息。

排名机制

排名通常基于表现模型(如向量空间模型)、概率模型(如 Okapi BM25)等信息检索理论。Apache Lucene 把这些模型中的概念应用到其排名系统中,其中最著名的是基于词频-逆文档频率(TF-IDF)的得分计算:

- 词频(TF): 高频出现在文档中的查询词会增加文档的得分。

- 逆文档频率(IDF): 查询词在所有文档中出现的频率越低,得分越高,表示其在文档中的区分度越高。

- 字段长度归一化: 较短的字段(例如标题)匹配到查询词时,其得分通常会高于较长的字段(例如正文)。

Solr 也支持自定义排名机制,如使用外部功能(external functions)、自定义得分查询或插件来定制或扩展默认的排名模型。

高级特性

Solr 不但支持基础的文本搜索,而且还支持以下高级搜索特性:

- 多种查询解析器:如 DisMax、eDisMax,它们允许更复杂的查询语法和搜索策略。

- 分面搜索(Faceting):提供类似分类的搜索方式,使用户能对搜索结果进行细分。

- 高亮显示:将查询词在搜索结果中高亮显示。

- 超越关键词的搜索:支持正则表达式、模糊搜索、距离查询等更多类型的查询。

Solr 的搜索和排名机制是建立在 Apache Lucene 这个强大的搜索引擎库之上的。了解这些原理对于调整搜索性能和结果的准确度非常重要。如果你需要进一步了解 Solr 或其排名机制的信息,或者需要帮助,请随时提问。

3.3 解释 Solr 查询语法和查询解析器

Apache Solr 提供了丰富的查询语法和多种查询解析器来执行搜索查询,它们是 Solr 高效检索相关数据的关键部分。

Solr 查询语法

1. 标准查询语法(Standard Query Syntax)

- 支持传统的搜索引擎查询语法,类似于 Google 或其他搜索引擎。

- 使用字段名称和搜索词,支持布尔运算符(AND, OR, NOT)和分组(使用括号)。

title:"The Great Gatsby" AND author:Fitzgerald

- 支持通配符搜索(* 代表任意字符,? 代表单个字符)、模糊搜索()和近似搜索( 之后紧跟数字)。

title:Gats* AND author:Fitzgera~1

2. 修饰词查询(Modifier Queries)

- 使用 “+” 表示必须出现,“-” 表示必须不出现。

+title:"The Great Gatsby" -genre:romance

3. 范围查询(Range Queries)

- 使用方括号

[ ]和大括号{ }分别表示闭区间和开区间范围。

pubdate:[1925 TO 1926] AND price:{* TO 20}

4. 逃逸特殊字符

- 特殊字符需要使用反斜杠

\进行转义,比如+,-,&,|,!,(,),{,},[,],^,",~,*,?,:,\,/.

title:"The \\ Great \\ Gatsby"

查询解析器(Query Parsers)

Solr 提供了多种查询解析器,每种解析器都有独特的查询特性和参数:

1. Lucene 解析器(Lucene Parser)

- 默认使用的查询解析器,提供 Solr 标准查询语法的支持。

2. DisMax 解析器(DisMax Parser)

- Disjunction Max Query Parser(DisMax)对用户提出的查询更加宽容。

- 不支持布尔运算符,重点是为短语或关键字搜索优化。

- 常用于简化用户界面的搜索框。

q=apple orange&defType=dismax&qf=title^5.0 content

qf参数指定查询字段和各字段的“权重”。

3. eDisMax 解析器(Extended DisMax)

- DisMax 的扩展,支持更多的查询特性和语法。

- 兼容 DisMax 的所有参数,同时提供对一些标准查询语法的支持。

q=apple orange -name:seed&defType=edismax&qf=title^5.0 content

4. Function Query 解析器

- 允许使用函数进行查询,能够操作数字字段和评分。

5. Spatial 解析器

- 专门用于地理空间搜索和地图相关查询的解析器。

6. Join 解析器

- 基于指定条件进行表之间的“连接”操作(类似于 SQL JOIN 查询)。

注意事项

- 选择合适的查询解析器可以显著影响搜索的准确性和性能。

- 在应用 DisMax 或 eDisMax 查询时,考虑字段权重的设定对结果的相关性有很大影响。

- 使用 Function Query 可以实现复杂的排序和评分策略。

- 查询表达式的编写应该尽量精简,避免复杂的高成本运算。

合理利用 Solr 强大的查询能力可以为用户提供灵活、高效的搜索体验。开发者可以根据具体的搜索需求,选择相应的查询语法和解析器,以获得最佳的搜索效果和性能。在构建搜索应用时,理解和恰当使用这些查询工具是非常重要的。

4. Solr 运行和维护

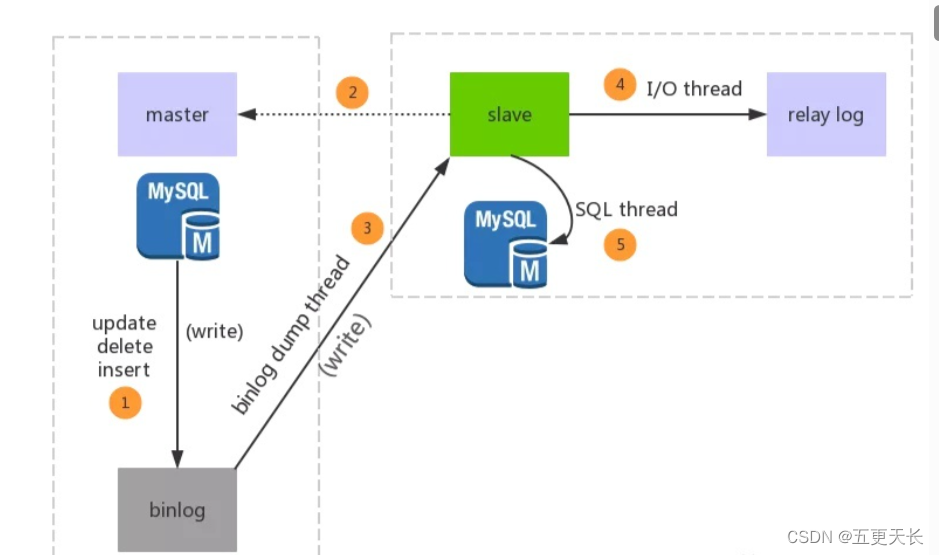

4.1 描述 Solr 集群环境的搭建和维护

搭建和维护 Solr 集群涉及多个层面的工作,从配置基本的 Solr 实例到在此之上构建一个高可用性和容错的环境。以下是搭建 Solr 集群环境的步骤和维护集群的一些策略。

搭建 Solr 集群

Solr 集群通常是指要么一个 SolrCloud 集群,要么是使用传统的主从复制模式(master-slave replication)的配置。SolrCloud 是建立在 Apache ZooKeeper 的协调上,提供了扩展性和容错能力。

安装和配置 ZooKeeper:

- SolrCloud 依靠 ZooKeeper 来管理集群状态和配置。

- 需要启动一个 ZooKeeper 集群,通常至少需要三个节点以提供高可用性。

启动 Solr 实例:

- 集群中的每个 Solr 节点都需要被配置以连接到 ZooKeeper 集群。

- 你可以设置 SOLR_HOME 环境变量指向 Solr 的安装目录,并且传递 ZooKeeper 信息给 Solr 节点。

配置集合(Collections):

- 在 SolrCloud 中,索引被称作集合(collections),你可以通过 Solr 管理界面或 API 创建和配置集合。

- 集合可以配置复制因子(replication factor)、分片数(number of shards)等。

负载均衡和请求分发:

- 为了分发查询请求和更新请求,可以使用内置的负载均衡器,或使用外部负载均衡器,如 HAProxy 或 NGINX。

维护 Solr 集群

集群维护包括监控、备份、故障恢复等活动。

监控集群:

- 使用 Solr 的监控功能以及第三方监控工具(如 Ganglia、Nagios 或 Prometheus)来跟踪集群性能。

备份和恢复:

- 周期性地备份集合(collections)的数据。

- 了解 Solr 集群恢复流程和最佳实践。

扩展和缩容:

- 根据负载增减 Solr 集群节点数。

- 安全地添加或移除节点,确保集合仍然达到所需的复制因子。

软硬件故障处理:

- 准备应对硬件故障或软件故障的策略。

- 比如,配置适当的复制和故障转移策略。

版本升级:

- 规划集群的 Solr 和 ZooKeeper 的升级过程。

索引优化和数据清理:

- 定期运行索引优化命令,并清理不必要的数据。

安全性(Security):

- 配置相关的安全性特性,包括认证、授权和加密传输。

策略和文档:

- 准备全面的操作策略和文档,包括标准操作流程、最佳实践和故障排除手册。

搭建和维护一个 Solr 集群是一个涉及深度技术知识和经验的过程。除了具体的操作和技术外,有效的沟通、团队合作和持续的监控对于确保集群正常运行同样重要。随着业务和数据量的变化,集群的配置和架构也应该适时地被评估和调整。

4.2 分析 Solr 云(SolrCloud)模式的特点和配置

SolrCloud 是 Apache Solr 提供的分布式搜索框架模式,旨在为搜索应用程序提供高可用性和分布式索引功能。SolrCloud 可以灵活地处理大量数据,并支持自动故障转移和恢复。

SolrCloud 的特点

1. 分布式索引和搜索

- SolrCloud 将索引分散在多个节点上,实现了负载平衡以及分片(Sharding)和复制(Replication)。

2. 自动故障转移

- 当某个节点出现故障时,SolrCloud 能够自动将查询请求重定向到其它可用节点,保证服务的持续可用性。

3. 集中式配置

- 使用 ZooKeeper 集中式配置管理,所有 Solr 配置都存储在 ZooKeeper 中,各节点可以自动从中获取更新。

4. 实时索引和查询

- 数据的更新可以实时被索引,并且立即参与查询结果返回。

5. 查询扩展

- 支持跨多个分片的数据搜索,包括分面、高亮、统计和近实时(NRT)搜索。

配置 SolrCloud

配置 SolrCloud 环境通常包括以下步骤:

1. ZooKeeper 集群的搭建

- 要启动 SolrCloud,你需要先部署一个 ZooKeeper 集群,它是分布式协调和配置的中心组件。

# Example: Start ZooKeeper server

zkServer.sh start

2. 启动 Solr 实例

- 启动 Solr 实例时,通过参数指定连接 ZooKeeper 集群。

solr start -c -z <ZOOKEEPER_HOST>:<ZOOKEEPER_PORT>

-c表示在 SolrCloud 模式下运行。

3. 创建集合

- 使用 Solr 提供的命令创建集合(Collection),集合是分布在多个 Solr 进程中的文档的集合体。

# Example: Create a new collection in SolrCloud

solr create -c mycollection -n configName

-c指定集合名称,-n指定存储在 ZooKeeper 中的配置名称。

4. 将配置文件上传到 ZooKeeper

- 配置文件包括

schema.xml和solrconfig.xml。这些文件将在 ZooKeeper 中管理,所有 Solr 节点可以访问。

# Upload configuration to ZooKeeper

solr zk upconfig -n configName -d /path/to/confdir -z <ZOOKEEPER_HOST>:<ZOOKEEPER_PORT>

5. 分片和复制

- 在创建集合时,可以指定所需的分片(shards)数目和每个分片的复制(replicas)数目。

6. 节点和角色

- SolrCloud 环境中的每个 Solr 节点可以有不同的角色,例如,有的节点负责索引数据,有的节点服务查询请求。

注意事项

- 良好的网络连接对于分布式集群非常关键,网络延迟和故障会影响 SolrCloud 的性能和稳定性。

- 需要考虑数据的分片策略,以便在集群中均匀分布数据。

- 配置适当的监控和报警机制,以确保 SolrCloud 集群可靠运行。

维护集群时,要注意更新和升级的管理,特别是在涉及 ZooKeeper 集群的时候。经常对配置和索引进行备份,并实现故障恢复计划。总体而言,SolrCloud 是一个可扩展的平台,适用于复杂的分布式搜索应用。通过遵循 SolrCloud 的最佳实践,你可以确保你的搜索服务既可靠又高效。

4.3 讨论 Solr 的容错性、扩展性和安全性

Apache Solr 是一个高性能、可扩展的开源搜索引擎,由 Apache Lucene 项目支持。Solr 的设计考虑了容错性、扩展性和安全性这三个关键要素,这使得它能够应对大型企业的需求。以下是对这些方面的探讨:

容错性(Fault Tolerance)

在分布式计算环境中,容错性是指系统在面对部分组件失败时仍能继续运行的能力。Solr 通过以下方式提高了容错性:

复制(Replication): Solr 允许创建多个副本(replicas)来存储同样的数据。如果一个副本出现故障,其他副本可以接替其提供服务。

Sharding: 数据可以在多个分片(shards)之间分散存储,分散风险和负载,提高了整个系统的可靠性。

ZooKeeper 集成: SolrCloud 使用 Apache ZooKeeper 来管理集群状态和配置信息,保证集群中的节点能够被准确协调和同步。

自动故障转移: 在节点或副本出现故障时,SolrCloud 可以自动执行故障转移,不影响服务质量。

定期备份: 通过定期备份,即使发生严重故障,也可以恢复数据。

扩展性(Scalability)

随着数据量的增长,对搜索引擎的处理能力要求也在升高。Solr 设计了以下扩展性能力:

水平扩展: 可以通过增加更多的服务器和分片来提升系统的处理能力。

灵活的分片: 可以根据需求调整分片数量,包括后期对已有数据的重新分片。

分布式查询: 对用户来说无需知道数据如何以及在哪里分布,Solr 可以在所有分片上自动执行查询并合并结果。

负载均衡: 可以使用负载均衡器来分发用户请求,均衡各个 Solr 服务器的负载,以满足高流量的情况。

安全性(Security)

为保护敏感数据免受未经授权的访问,Solr 在安全性方面提供了多个功能:

身份验证: 通过基本的身份验证机制或集成 LDAP,确保只有授权用户可以访问 Solr。

授权: 控制用户对特定 Solr 功能的使用权限。

加密: 可采用 SSL/TLS 加密客户端和 Solr 服务器之间的通信。

安全插件: 支持与 Apache Knox 这样的安全网关集成,提供更多的防护措施。

数据权限: 通过文档级别的安全控制(Document-Level Security)来控制数据的访问。

对于任何企业级搜索引擎来说,容错性、扩展性和安全性都是不可或缺的。Solr 提供了广泛的特性来满足这些需求,使其成为一个适合高负载、大数据量且需要安全可靠搜索服务的企业的良好选择。正因为这些特点,Solr 能够被广泛应用于不同行业,处理各种复杂的搜索需求。对这些特性的理解和合理配置有助于搭建一个高效、可靠且安全的 Solr 环境。

5. Solr 性能优化

5.1 讲解 Solr 性能监控的工具和指标

Apache Solr 提供了一系列工具来监控搜索引擎的性能。好的性能监控策略可以帮助你识别潜在的性能问题,并及时做出优化调整。下面是 Solr 性能监控中常用的一些工具和指标:

监控工具

Solr Admin UI:

Solr 自带的 Admin UI 提供了许多关于集群状态、查询性能和其他关键指标的实时信息。JMX(Java Management Extensions):

Solr 支持通过 JMX 将监控数据暴露给外部监控工具,如 JConsole、VisualVM 或企业监控系统。Ganglia 或 Grafana:

可以配置 Solr 与 Ganglia 或 Grafana 集成,实现更丰富的监控视图和图表。Solr Metrics API:

Solr 7.0 以上版本提供了 Metrics API,可以用来获取各个方面的性能指标数据。第三方监控服务:

New Relic、Datadog 或其他应用性能管理 (APM) 工具可以集成到 Solr 中来提供详细的监控和警报服务。

关键性能指标

查询响应时间:

监控搜索查询的平均响应时间,以及最大和最小响应时间。查询次数和吞吐量:

查询的频率和每秒可以处理的查询数量。索引大小和索引时间:

跟踪索引文档的速度和索引的整体大小。缓存性能:

检查 query cache、filter cache 和 document cache 的命中率和大小。系统资源使用情况:

监控 CPU、内存、磁盘 I/O 和网络带宽的使用情况。垃圾回收(GC):

JVM 垃圾回收事件的频率和持续时间,可以反映系统的内存压力。错误率:

监控请求错误和时间超时的比例。线程池状态:

HTTP 请求的线程池状态和大小。文档增长率:

数据库中文档的增长率和现有文档数量。复制和分片状态:

在使用 SolrCloud 模式时,监控复制和分片的状态十分重要。

性能监控的目的不仅是及时发现问题,而且还能够帮助预测潜在问题,并为今后的扩容和升级提供决策支持。通过这些工具和指标,你能够获得关于 Solr 性能的深入洞察,促使持续性能改进。

5.2 描述 Solr 缓存机制以及如何配置缓存

Apache Solr 采用多级缓存机制来提高查询性能和吞吐量。Solr 中的缓存可以存储近期查询的结果、索引中的词条及其位置信息、过滤查询的结果以及其他元数据。了解并正确地配置这些缓存至关重要,因为这会直接影响到 Solr 搜索的速度和集群的可扩展性。

Solr 缓存类型

查询结果缓存(query result cache):

- 存储整个查询结果集。它可以快速返回完全相同的重复查询。

过滤缓存(filter cache):

- 存储过滤查询(通常在

fq参数中指定)的结果。由于过滤结果通常被多个查询共享,过滤缓存可以节省重复计算开销。

- 存储过滤查询(通常在

文档缓存(document cache):

- 存储索引中文档的实际数据。当查询需要返回文档字段数据时,文档缓存可以减少对索引文件的磁盘 I/O。

字段值缓存(field value cache):

- 类似于文档缓存,字段值缓存针对某些需要多次访问的字段值特别有用,如在排序和 facet 计算中。

词条缓存(term cache):

- 存储经常被查询和过滤的字段的词条信息。它有助于加快复杂的词条查询。

配置缓存

缓存通常在 Solr 的 solrconfig.xml 配置文件中定义。以下是一些基本的配置举例:

<solr>

<cache name="filterCache" <!-- 过滤缓存 -->

class="solr.LRUCache"

size="512"

initialSize="512"

autowarmCount="0"/>

<cache name="queryResultCache" <!-- 查询结果缓存 -->

class="solr.LRUCache"

size="512"

initialSize="512"

autowarmCount="0"/>

<cache name="documentCache" <!-- 文档缓存 -->

class="solr.LRUCache"

size="512"

initialSize="512"

autowarmCount="0"/>

<!-- 其他缓存配置 -->

</solr>

class属性定义了缓存实现的类,Solr 提供了LRUCache和其他缓存类。size属性指定缓存中可以存放的最大条目数量。initialSize属性定义了缓存的初始大小,这有助于减少缓存调整大小所需的开销。autowarmCount属性用于指定当 Solr 重启或清空缓存时,将从老的缓存中预填充多少条目到新的缓存中。

自动加热缓存

- 自动加热(autowarming)是在缓存逐出和重新填充时保持查询响应速度的机制。

autowarmCount配置决定加热缓存时复制多少条目。- 自动加热可以基于最近最常使用(LRU)的条目或其他策略执行。

注意事项

- 缓存大小需要根据可用内存、数据大小以及查询负载特点进行调整。

- 过度缓存可能会消耗过多内存,甚至导致频繁的垃圾回收和系统性能下降。

- 测试和监控是评估缓存配置是否合理的关键,可以使用 Solr 管理界面和监控工具来查看缓存的命中率和效果。

正确配置的缓存策略可以显著提高 Solr 的查询性能和用户体验。不过,根据查询模式、可用资源和系统要求灵活地配置和优化这些缓存至关重要。如果你需要更多关于 Solr 缓存机制的信息,或者有关于如何配置缓存的问题,请随时提问。

5.3 分析影响 Solr 性能的常见因素和调优措施

Apache Solr 是一个基于 Apache Lucene 的开源搜索平台,它为用户提供了全文搜索、命中高亮、复杂查询能力等强大特性。然而,Solr 的性能可能受到多个因素的影响,合理的调优措施对于维护其高效运作至关重要。

影响性能的常见因素

- 硬件资源:CPU、内存、磁盘速度以及网络带宽

- Solr 配置:Solr 的配置文件

solrconfig.xml中的各种设置 - 索引设计:文档结构、字段类型定义以及索引大小对性能的影响

- 查询负载:查询的复杂性、查询率和并发查询数

- 数据大小和复杂性:索引中的数据量和数据结构的复杂性

- 高亮、分析器和过滤器:查询时所使用的高亮显示、字段分析器(analyzers)和过滤器(filters)

- 缓存策略:Solr 的查询缓存、结果缓存、过滤缓存等对查询性能影响显著

- 分片和复制:在 SolrCloud 架构中使用分片(sharding)和复制(replication)对性能有影响

性能调优措施

硬件优化:

- 优化磁盘性能,比如通过使用 SSD 来减少 I/O 时延。

- 增加内存,确保大部分索引都能存放在内存中。

配置优化:

- 根据负载配置适当的 JVM 选项,如堆内存大小

-Xms、-Xmx。 - 优化 Solr 服务器的线程池设置以提高并发处理能力。

- 根据负载配置适当的 JVM 选项,如堆内存大小

索引和查询优化:

- 重新设计字段,避免不必要的字段索引,减少索引的大小。

- 优化负载分布,例如通过使用负载均衡器。

- 压缩索引以减小磁盘占用空间。

- 合理使用字段缓存。

查询改进:

- 精简查询语句,减少使用通配符和正则表达式等高成本操作。

- 调整查询相关参数,如

timeAllowed、rows。

缓存策略:

- 通过监控,调整查询缓存和过滤缓存的大小、比例和过期策略。

- 在不影响结果的情况下,避免缓存大型的查询结果。

SolrCloud 调优:

- 合理规划集群的复制因子、分片数量和分片大小。

- 优化 ZooKeeper 的配置以提高其性能。

其它:

- 定期执行数据优化(Optimize)操作来合并索引段,并释放未使用的空间。

- 使用更高效的数据存储格式,如使用 DocValues。

通过监控 Solr 性能并定期审查配置,可以确定调优措施的有效性。监控工具可以帮助发现性能瓶颈并指导进行相应的优化。此外,建议在执行任何重大调整之前在类似生产的测试环境中进行性能测试。

6. Solr 和其他搜索平台对比

6.1 比较 Solr 和 Elasticsearch 的功能特点和应用场景

Solr 和 Elasticsearch 都是基于 Apache Lucene 构建的流行开源搜索引擎,它们提供了全文搜索、多索引搜索、实时索引等功能。尽管两者有相似的底层技术,但它们也有自己独特的特点和最适合的应用场景。

Solr

功能特点

- 成熟稳定:作为较早期的开源搜索引擎之一,Solr 拥有稳定的社区和广泛的应用。

- 复杂查询:Solr 支持非常复杂的查询语法。

- SolrCloud:用于提供分布式索引和搜索的高可用性和容错解决方案。

- 管理界面:提供了一个丰富的管理界面,易于监控和集群管理。

- 文档处理能力:提供了强大的文档处理能力,包括丰富的文本分析器和数据导入工具。

- 可扩展性:支持横向扩展和海量文档的索引。

应用场景

- 企业搜索:适用于在企业环境内搭建文档检索系统。

- 大型搜索应用:擅长协助开发者处理大型索引并执行复杂搜索。

- 集成项目:它可轻松地集成到复杂的大型项目和系统中。

Elasticsearch

功能特点

- 实时搜索:Elasticsearch 被设计为一款分布式的实时搜索引擎。

- 强大的集群管理:它提供了极为强大的集群管理和节点探测功能。

- 分布式特性:数据自动分片和负载均衡,高可用性和伸缩性是内置的。

- Kibana 集成:Elasticsearch 与 Kibana 结合,可以提供可视化的数据分析平台。

- RESTful API:所有任务可以通过使用简单的 RESTful API 来完成。

- 日志和数据分析:Elasticsearch 在日志存储、搜索和分析方面表现卓越,被广泛用于日志和时间序列数据处理。

应用场景

- 日志聚合系统:如 ELK(Elasticsearch, Logstash, Kibana)堆栈用于日志分析和运维监控。

- 实时分析:适用于需要实时分析反馈的场景。

- 地理空间数据处理和搜索:强大的地理信息处理能力使其在地理信息系统(GIS)中得到应用。

- 全文搜索:快速而高效的全文搜索能力,适用于需要实时搜索功能的在线服务。

总结

- 如果你需要的是稳定且成熟的解决方案,能够非常容易地集成到企业环境中,或者需要执行复杂的查询,那么 Solr 是一个非常好的选择。

- 如果你的项目需要快速的实时搜索,具有强大的集群管理,或者需要与 Kibana 进行集成以便进行强大的日志和数据分析,那么 Elasticsearch 可能是更好的选择。

选择 Solr 还是 Elasticsearch 取决于项目的具体要求、团队的技能和经验,以及未来的规模和需求。两种技术各有优势,很多时候选择哪个技术取决于特定的应用场景和偏好。在现实中,许多团队会根据具体项目需求,在两者之间做选择或甚至结合使用两者。

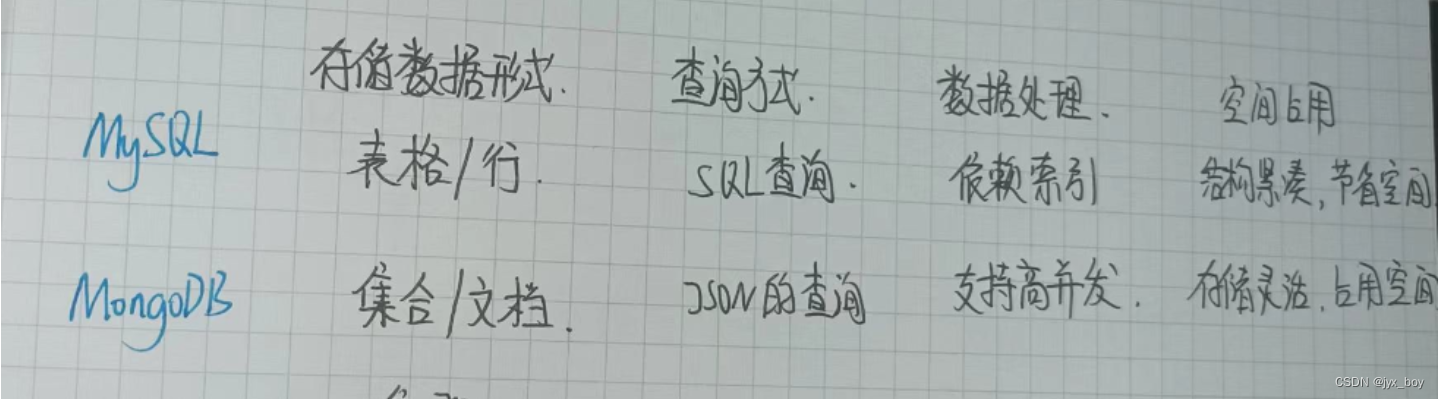

6.2 讨论 Solr 和数据库全文搜索能力的差异

Solr 和数据库(如 PostgreSQL、MySQL)提供的全文搜索功能之间存在一些主要差异。尽管许多现代数据库都包括对全文搜索的支持,但 Solr 这种专门的搜索平台在某些方面通常提供更强大的功能和更高的性能。

Solr(全文搜索平台)

搜索性能:

- Solr 专为搜索优化,提供快速、实时的搜索能力,尤其是在处理大量数据和高吞吐量的搜索请求时。

搜索功能:

- 提供高级搜索功能,包括复杂的查询语法、多字段搜索、分面、高亮显示、拼写检查、同义词/近义词处理、查询加权等。

可扩展性:

- SolrCloud 提供了分布式搜索和索引的能力,易于水平扩展,以处理大型分布式环境。

定制化:

- 提供高度定制化的索引和查询过程,允许开发者根据特定需求定制搜索算法。

文档处理:

- 支持多种文档格式(如 XML、JSON)的处理,并且能够处理富文本内容,例如提取 HTML、PDF 文档中的文本。

生态系统与社区:

- 有着强大的社区支持,提供各种工具和插件,以提高搜索的能力和性能。

数据库全文搜索

集成性:

- 数据库允许全文搜索功能与其他数据库操作更紧密地结合,如事务处理和CRUD(创建、读取、更新和删除)操作。

便利性与一致性:

- 管理数据库时,全文搜索作为其内建功能之一,使用相同的系统和接口管理所有数据。

资源消耗:

- 数据库内置的全文搜索可能对性能有一定影响,特别是在同时执行其他数据库操作时。

功能限制:

- 与专门的搜索平台相比,数据库提供的全文搜索功能通常更为基础,可能在某些功能上有所限制。

扩展性和高可用性:

- 大多数数据库天生不是为搜索而设计的,因此在高可用性和水平扩展上可能比专门的搜索平台更具挑战。

维护和运维考虑:

- 对于数据库管理者来说,还需考虑如何维护索引,在保证性能的同时确保数据的一致性。

综合考量

在选择使用 Solr 或数据库内建全文搜索时,你需要评估以下因素:

数据量和查询吞吐量:

- Solr 更适合处理大规模的数据和高频次的搜索请求。

搜索请求的复杂性:

- 如果需要执行复杂的搜索请求,Solr 提供更灵活和强大的功能。

对实时性的需求:

- Solr 在保持搜索索引的实时性方面表现更好。

基础设施和运维能力:

- 管理一个独立的搜索平台可能需要额外的基础设施支持和专业知识。

综合选择适合的搜索解决方案还需要考虑开发资源、成本、以及是否需要将搜索与其他数据库功能(如交易处理)紧密集成等因素。在许多情况下,结合使用数据库和 Solr 更利于实现系统的高性能和高可用性,数据库负责传统的数据存储和事务处理,而 Solr 专注于提供高级搜索功能。

6.3 分析 Solr 在大数据生态系统中的应用和集成

Apache Solr 是一个高性能、可伸缩的搜索平台,它在大数据生态系统中扮演着搜索和数据分析的维关角色。Solr 在大数据领域的应用广泛,尤其是在处理复杂的搜索需求、实时分析和数据集成方面。以下是 Solr 在大数据生态系统中的一些常见应用场景和集成方式:

应用场景:

全文搜索:

Solr 提供了全文搜索能力,能够处理来自各类大数据应用的大量文本数据。实时分析:

利用 Solr 的实时索引和查询功能,应对需要快速响应的分析需求,如仪表盘、报告和告警。数据可视化:

结合前端数据可视化库(如 D3.js、Highcharts),利用 Solr 强大的聚合查询能力,提供动态和交互式的数据可视化。日志分析:

分析来自应用程序、网络设备和服务器的大量日志数据,进行异常检测、性能监控及安全审计。推荐系统:

利用 Solr 的查询和排序功能,为电商、新闻网站和内容平台提供个性化推荐。数据集成:

作为大数据平台的搜索组件,Solr 能够集成来自 Hadoop、数据库和其他数据源的数据。

集成方式:

Hadoop Integration:

Solr 可以与 Hadoop 生态系统集成,如使用 Apache Flume、Apache NiFi 或 Apache Spark 将数据加载入 Solr 索引。NoSQL Databases:

与 NoSQL 数据库(如 Cassandra、MongoDB)结合,将非结构化数据索引到 Solr 中,提供更丰富的查询能力。Message Queues:

将 Solr 与消息队列系统(如 Apache Kafka)集成,进行流数据的处理和索引。Cloud Services:

与 AWS、Azure 等云服务结合,使用云基础设施进行存储和计算,弹性伸缩 Solr 集群。RESTful API:

Solr 提供了 RESTful 接口,可以轻松地与使用不同编程语言编写的应用程序集成。安全集成:

支持与企业安全基础设施相连接(如 LDAP、Kerberos),确保数据安全。

集成考虑事项:

数据同步:

进行数据同步时要确保数据在系统之间保持一致性,处理好增量更新和删除操作。性能和优化:

考虑对 Solr 的查询性能进行优化,比如使用缓存、选择合理的分片和副本策略。监控和故障恢复:

使用 ZooKeeper 等工具监控 Solr 集群的状态,并准备故障转移和灾难恢复计划。数据安全性:

配置合适的访问控制和数据加密措施,以保护敏感数据不被未经授权访问。

Solr 在大数据生态系统中提供了快速、灵活的搜索能力,是实现数据即服务(Data as a Service, DaaS)架构中不可缺少的组件。通过与其他数据平台和工具的集成,Solr 能够帮助企业挖掘数据的价值,并提升数据分析、搜索和业务决策的能力。

7. Solr 高级特性

7.1 解释 Solr 查询加速器(Query Elevation)的作用

Solr 的查询加速器(Query Elevation Component),也称为结果提升(Result Elevation Component),是一个用于搜索结果相关性优化的组件。它允许事先定义某些文档对特定查询的高优先级,意味着这些文档将被提升到搜索结果的顶部,无论它们的自然排名如何。

查询加速器的作用:

人工干预搜索排名:

通过预先配置,可以确保对于特定的搜索查询,事先选定的文档能显示在搜索结果的顶部。提高特定文档的可见性:

对于促销活动、重要公告或特别推荐的内容,使它们在搜索结果中更受注意。控制品牌关键词搜索结果:

确保当用户搜索品牌特定关键词时,官方或最相关的页面能优先显示。优化用户体验:

根据用户行为和偏好,调整搜索结果,提供更贴合用户需求的信息。顺应搜索引擎优化(SEO)策略:

协助实施网站内容的 SEO 策略,对搜索引擎的表现进行微调。

使用查询加速器,需要在 Solr 的配置文件中开启对应的组件,并定义哪些文档需要被提升。通常,配置信息包括一个或多个查询字符串以及对应这些查询需要被提升的文档 ID 列表。例如:

<searchComponent name="elevator" class="solr.QueryElevationComponent">

<str name="queryFieldType">string</str>

<str name="config-file">elevate.xml</str>

</searchComponent>

<requestHandler name="/search" class="solr.SearchHandler">

...

<arr name="last-components">

<str>elevator</str>

</arr>

</requestHandler>

然后 elevate.xml 文件会包含特定的配置,声明对于不同的用户查询哪些文档应该被置于搜索结果的前列。

<elevate>

<query text="优惠">

<doc id="100" />

<doc id="200" />

</query>

</elevate>

在这个示例中,对于用户查询“优惠”的情况,系统会提升文档 ID 为 100 和 200 的文档排名。

使用查询加速器时需要谨慎,过多的人为干预可能会影响搜索结果的整体相关性和质量。该功能应结合数据分析结果和用户体验需求,精准而合理地进行设置。

7.2 分析 Solr 中的分面搜索(Faceting)和统计信息

Apache Solr 的分面搜索(Faceting)功能允许用户根据查询结果的某个或多个字段对这些结果进行分类统计。它是一种分析搜索输出的强大方式,常用于导航中的分类计数、搜索结果的摘要信息,以及构建用户可以交云控制的搜索细分等场合。

分面搜索(Faceting)

字段分面(Field Faceting):

- 这是最常用的分面类型,它会对指定的字段进行计数和分类。

- 可以用于显示一个字段在结果中出现的可选项及各项的出现次数。

查询分面(Query Faceting):

- 不是对字段值进行分类,而是对一系列查询本身进行计数。

- 搜索可以基于任意查询条件来统计匹配的文档数。

范围分面(Range Faceting):

- 对于日期和数字字段,可以创建一系列的范围,并计算每个范围内匹配的文档数。

- 常用于价格区间、时间间隔等场景。

间隙分面(Interval Faceting):

- 一种特殊类型的范围分面,允许对字段值指定多个不同的间隔。

枢轴(Pivot)分面(Pivot Faceting):

- 又称为维度分面或多层分面,可以在多个字段上进行。

- 例如,你可以先按照"品牌"分面,再在每个品牌下按照"分类"进行分面。

统计(统计信息)分面(Statistical Faceting):

- 计算数值字段的统计信息,如最小值、最大值、平均值、总和、计数等。

配置和使用 Faceting

在 Solr 查询中使用 facet 参数启用分面搜索,并可以指定不同类型的分面:

http://localhost:8983/solr/collection/select?q=*:*&facet=true&facet.field=category

在上面的例子中,facet.field=category 表明对 category 字段进行字段分面。

你也可以对多个字段进行分面:

&facet.field=category&facet.field=manufacturer

对于范围分面,需要指定字段、起始值、结束值和间隔:

&facet=true&facet.range=price&facet.range.start=0&facet.range.end=500&facet.range.gap=100

分面搜索可以使用 Solr 的查询语言 (Solr Query Language, SQL) 来进一步细心地选择和配置。

优化建议

- 考虑到性能开销,仅在需要时使用分面。

- 正确地索引字段以便最高效的分面操作。

- 对于大数据集,考虑使用缓存和预先计算的结果。

- 应用限制来避免返回过多的分面选项,例如,使用

facet.limit限制每个分面分类返回的项数。 - 使用数值字段进行范围或统计分面时,确保字段被正确配置为对应的数值类型。

Solr 分面搜索能够提供深入了解和导航复杂数据集的功能,是许多搜索应用中提供丰富用户体验的关键组件。如果您需要更多关于 Solr 分面搜索和统计信息的详细信息,或者有关于如何实现高级搜索分析的问题,请随时提问。

7.3 讨论 Solr 的自然语言处理和机器学习集成

Apache Solr 是建立在 Apache Lucene 基础上的企业级搜索平台,它提供了强大的全文搜索功能,包括对自然语言处理(NLP)和机器学习(ML)集成的支持。这些功能增强了 Solr 在处理复杂查询、理解用户意图和提供相关搜索结果方面的能力。

自然语言处理 (NLP)

Solr 利用 Lucene 的分析框架和多种分析器(analyzers)、分词器(tokenizers)以及词汇过滤器(token filters)来提供 NLP 功能。这些工具能够处理文本数据,并将其转换为适合索引和查询的格式。

NLP 技术的应用包括:

文本分词和标准化:

- 分词(Tokenization)将长文本切分成个别的词汇或术语。

- 标准化(Normalization)移除标点符号,进行大小写转换。

停用词过滤:

- 删除在文本分析中不重要的常见词汇,如“the”,“is”,“at”,等。

词干提取:

- 将单词转换为其基本形式或词干,以提高搜索结果的相关性。

同义词扩展:

- 在索引时或查询时扩展同义词,以改善对用户查询的响应。

实体识别:

- 识别和索引文本中的专有名词和实体,如人名、地点和组织。

机器学习 (ML) 集成

Solr 与 Apache Mahout、Apache Spark MLlib 以及其他机器学习库相集成,提供了基于机器学习的搜索技术。

ML 技术的应用包括:

基于用户行为的结果排名:

- 利用点击流数据和用户与搜索结果的交互行为来调整和优化结果排名。

智能推荐:

- 使用协同过滤和其他算法为用户提供个性化的推荐。

分类和聚类:

- 为文档自动打标签、分类和聚类,以提供更有组织的搜索结果。

情感分析:

- 分析文本中的情感倾向,识别评论或反馈中的正面或负面意见。

Solr 支持多种机器学习集成,允许开发者实现更精细的搜索优化和用户体验提升。

注意事项

- 集成 NLP 和 ML 技术要求仔细地设计索引策略,以确保既能满足分析需求又不会对搜索性能产生过大影响。

- NLP 和 ML 技术的应用应基于数据量、真实世界的用例和系统性能来考量。

- 管理和调整这些高级功能需要具备深入的数据分析和机器学习知识。

- 评估不同分析器和 ML 集成的效果往往需要通过用户参与的 A/B 测试。

Solr 的自然语言处理和机器学习集成扩展了它在搜索领域的应用,提高了从大量非结构化文本数据中检索准确信息的能力。通过合理利用这些功能,Solr 能够为用户提供高度相关和个性化的搜索体验。

8. Solr 查询处理

8.1 描述 Solr 请求处理器和响应格式化的配置

在 Apache Solr 中,请求处理器(Request Handlers)负责解析客户端发送的请求,执行操作(如搜索、更新等),并返回响应。响应格式化器(Response Writers)定义了请求结果的输出格式。了解如何配置这些组件能够帮助你定制 Solr 的行为,以满足不同的应用需求。

请求处理器(Request Handlers)

请求处理器是由 Solr 的 solrconfig.xml 配置文件定义的端点,处理来自客户端的请求。每个请求处理器都关联了一系列配置参数,定义了如何处理特定类型的请求。以下是一个示例配置:

<requestHandler name="/select" class="solr.SearchHandler">

<!-- 配置默认搜索参数 -->

<lst name="defaults">

<str name="echoParams">explicit</str>

<int name="rows">10</int>

<str name="df">text</str>

</lst>

<!-- 其它配置 -->

</requestHandler>

在上面的示例中,“/select” 请求处理器被配置为 solr.SearchHandler 类,有一些默认的搜索参数。

响应格式化(Response Writers)

响应格式化器定义了 Solr 如何渲染和返回搜索结果。可用的格式化器包括 JSON、XML、CSV 等,它们可以在请求处理器中配置,或者在每次请求中通过 wt 参数指定。以下是一个响应格式化器的配置示例:

<queryResponseWriter name="json" class="solr.JSONResponseWriter">

<!-- 配置 JSON 输出的选项 -->

</queryResponseWriter>

在这个配置中,响应格式化器的名称是 “json”,使用的类是 solr.JSONResponseWriter,搜索响应会被格式化为 JSON 输出。

高级请求处理器配置

Solr 提供了许多内置的请求处理器,支持复杂的搜索策略和功能,例如:

高亮显示:

增强搜索结果的可读性,高亮匹配的关键词。分面搜索(Faceting):

对搜索结果进行分类统计,快速获取结果的摘要信息。拼写检查和建议:

提供拼写检查和修改建议,改进搜索体验。数据导入(Data Import Handler):

为数据导入提供了支持,可以从数据库或其他数据源导入数据。实时获取(Real-Time Get):

允许实时地检索、更新和删除文档。

安全性和访问控制

除了请求处理器和响应格式化器的配置之外,确保安全性也是重要的考虑因素。Solr 提供了身份验证、授权和SSL加密等安全特性,可以在 solrconfig.xml 中相应配置这些特性。

管理和调试

管理和调试功能如日志记录或管理 API 的配置也是请求处理器配置的一部分,这些可以帮助监视和调试 Solr 的行为。

通过调整和优化请求处理器和响应格式化器的配置,你可以实现高度定制化的搜索服务,以满足从简单的全文搜索到复杂数据分析的各种需求。需要注意的是,更改配置时应该谨慎操作,错误的配置可能会影响 Solr 服务器的性能和稳定性。此外,改变配置后通常需要重新启动 Solr 实例以生效。

8.2 分析 Solr 中的多字段搜索和自定义搜索逻辑

在 Solr 中,多字段搜索提供了强大的功能,允许在查询中同时搜索多个字段,这对于构建复杂且用户友好的搜索体验非常重要。同时,Solr 也支持自定义搜索逻辑,使得你可以根据不同的应用场景灵活地调整搜索行为。

多字段搜索

多字段搜索允许用户通过一个查询来搜索多个字段,这可以通过以下方式实现:

1. 复制字段(CopyField)

复制字段功能可用来复制一个字段的值到另一个字段,通常与 defaultSearchField 配合使用。

<field name="search_content" type="text_general" indexed="true" stored="false" multiValued="true" />

<copyField source="field1" dest="search_content"/>

<copyField source="field2" dest="search_content"/>

在上面的配置中,field1 和 field2 的内容被复制到了 search_content 字段中,该字段可以作为搜索时的默认字段。

2. DisMax 和 eDisMax 查询解析器

DisMax(Disjunction Max Query Parser)是 Solr 提供的查询解析器,用于简化复杂的多字段查询需求,并提高对用户输入非结构化文本查询的容错能力。

/select?q=apple&defType=dismax&qf=field1^1.0+field2^0.5

在上面的例子中,使用 qf(Query Fields)参数指定了多字段,并且分配了不同的权重(^1.0、^0.5),这样的权重表示 field1 在搜索中更重要。

3. 使用 eDisMax(Extended DisMax)

eDisMax 是 DisMax 的扩展,提供更多的功能,如支持近义词、通配符等。

/select?q=apple&defType=edismax&qf=field1+field2

自定义搜索逻辑

Solr 支持非常灵活的自定义搜索逻辑。

1. 使用 Function Query 进行自定义打分

Function Queries 允许你使用 Solr 中的函数来修改查询的 relevancy score(相关性得分)。

/select?q={!func}add(1,product(field1,field2))

上面的查询修改了打分逻辑,将 field1 和 field2 内容的乘积与 1 相加作为得分。

2. 使用 Filter Queries 优化性能

Filter Queries (fq 参数)对查询结果进行过滤,但不影响得分,并且由于 Filter Queries 是可缓存的,因此能够提高性能。

/select?q=apple&fq=category:electronics

上面的查询会搜索包含关键词 apple 的文档,但是只返回 category 字段为 electronics 的结果。

3. 使用 Query Time Join

Query Time Join 允许在查询时合并来自不同集合或核心(core)的数据。

4. 使用 Local Parameter

Local Parameters 提供了向查询解析器传递额外参数的能力。

/select?q={!dismax qf=myfield1^20 myfield2^0.5}apple

上面的查询将额外的参数传递给了 DisMax 查询解析器,并指定了字段权重。

5. 构建复杂的布尔查询

使用布尔运算符(AND, OR, NOT 等)来构建复杂的查询逻辑。

注意事项

- 多字段搜索和自定义搜索逻辑需要考虑到查询的性能影响,特别是在大规模数据集上。

- 在优化查询性能时,考虑到缓存和请求代价,避免过于复杂的自定义函数查询。

- 对于复杂的需求,应该在应用层组合 Solr 的能力,以构建复杂且高效的搜索逻辑。

通过这些工具和功能,Solr 提供了非常灵活的方式来执行跨多字段的搜索并自定义搜索逻辑,为各种复杂的搜索和业务需求提供支持。

8.3 讨论 Solr 更复杂查询案例和效率处理

Apache Solr 提供了高效的搜索能力,特别是对于复杂的查询处理。以下是一些复杂查询的案例以及如何优化查询效率的策略:

更复杂查询案例

分面搜索(Faceted Search):

Solr 可以对搜索结果进行分类统计,这是在线购物或内容导航时常见的需求。q=iphone&facet=true&facet.field=category&facet.field=brand多条件筛选(Filter Queries):

通过 filter queries,可以在不影响 relevance scoring 的基础上对搜索结果进行筛选。q=iphone&fq=price:[200 TO *]&fq=category:Electronics复杂的区间查询:

对特定字段进行区间查询,如日期、价格等。q=sale_date:[2020-01-01 TO 2020-12-31]排序和分组(Sorting & Grouping):

对搜索结果进行排序和分组显示。q=iphone&sort=price asc&group=true&group.field=brand高级全文搜索条件:

利用 Lucene 查询语法进行高级全文搜索,包括近义词、通配符、正则表达式等。q=title:"The quick brown fox"~2 q=content:/[mb]oat/多字段查询(Multi-field Query):

同时在多个字段上进行查询,权衡其重要性。q=name:iphone^3 OR description:iphone

效率处理

对于复杂查询,效率尤为重要。以下是一些优化查询效率的策略:

使用缓存:

适当地使用 filter cache、query result cache 以及 document cache,减少重复计算。适当使用 Filter Query:

对于不影响得分的筛选条件使用fq参数,因为 filter query 的结果可被缓存复用。避免高成本操作:

减少使用通配符和正则表达式等高成本操作,特别是在字段开始的位置。字段缩减:

减少搜索面向的字段数量,特别是在有许多字段可供搜索时。使用文档值(DocValues):

对于大数据量的排序和分面,使用 DocValues 优化性能。利用分片:

在多个分片之间分配查询负载,提升并行处理能力。预热查询:

在查询大量数据之前预热索引和缓存,尤其是在重启 Solr 服务器后。查询时性能监控:

使用 Solr 的 Query Profile 功能监控查询性能,找出潜在的问题。

通过上述实践,合理地结合应用场景与 Solr 的功能特性,即可实现更复杂查询的高效执行。应定期审查 Solr 查询模板,确保随着数据体量增长或查询模式变化,查询性能依旧是可接受的。

9. Solr 问题排查与优化

9.1 分析 Solr 中常见问题的诊断和解决方法

在使用 Apache Solr 时,可能会遇到各种问题,包括配置错误、性能瓶颈或者意外的系统行为。以下是分析和解决 Solr 中常见问题的一些策略:

1. 日志文件分析

Solr的日志文件是诊断问题的首要资源。日志文件通常位于Solr安装目录下的 server/logs 或 example/logs 文件夹中。

- 查看错误和异常:检查日志文件中的错误 (

ERROR) 和异常 (Exception) 条目。 - 检查警告信息:有时候解决

WARNING级别的日志信息也能帮助避免未来的问题。

2. Admin UI 的监控

Solr 的 Admin UI 提供了一个监控界面,可帮助查看集群状态、查询性能和其他关键指标。

- 集群状态检查:对于 SolrCloud 环境,确保所有节点健康且处于同步状态。

- 缓存性能评估:查看缓存的命中率和大小,了解是否需要调整。

3. 性能问题

对于与性能相关的问题,需要系统地分析:

- 查询性能:工具如 Solr Query Performance Analysis Plugin 可以帮助理解查询的性能。

- 基准测试:使用 JMeter 或 Solr 的 benchmark 工具进行基准测试,确定性能瓶颈所在。

- 硬件资源监控:使用系统监控工具(如

top、vmstat、iostat等)跟踪 CPU、内存、磁盘和网络使用情况。

4. 配置问题

检查 Solr 配置的常规步骤包括:

- solrconfig.xml:核实所有配置项是否正确设置,比如请求处理器和搜索组件的定义。

- schema.xml 或

managed-schema:确保字段类型和字段属性设置正确无误。

5. Solr Schema 问题

如果遇到与模式相关的问题:

- 字段类型转换:检查字段类型是否正确支持了数据格式和查询需求。

- 动态字段规则:确保动态字段与预期匹配。

6. 数据导入问题

对于数据导入过程中的问题:

- 数据导入处理器(DIH)日志:如果使用 DIH,检查 DIH 日志中是否有错误或警告。

- 索引更新日志:在更新索引时检查返回消息是否显示任何错误。

7. 集群和分布式问题

在 SolrCloud 环境中工作时,注意:

- ZooKeeper 状态:确保 ZooKeeper 集群运行正常且与 Solr 节点通信正常。

- 分片和复制状态:在 SolrCloud UI 部分检查分片和副本的状态。

8. 解决方法建议

- 默认设置回滚:如果做过改动后出现错误,考虑暂时回滚到之前的设置。

- 逐步排除法:逐一排除可能的问题来源,例如先检查网络连接,再检查配置和索引健康状况。

- 论坛和社区支持:Apache Solr 社区非常活跃,当不能自己解决时,可以在相关社区和论坛中寻求帮助。

在遇到问题时,应该保持耐心,系统性地分析和解决问题。在诊断 Solr 问题的过程中,保持良好的记录习惯,详细记录所采取的步骤和观察到的现象,有助于未来排查类似问题。在必要时,升级 Solr 到最新版本也可以解决已知的问题和漏洞。

9.2 描述 Solr 日志分析和异常处理技巧

Solr 提供了详尽的日志功能,这些日志对了解 Solr 实例的运行情况和进行异常处理是非常重要的。下面是分析 Solr 日志和处理异常的一些重要技巧:

日志分析

日志等级

- 配置日志等级:

- Solr 使用

log4j来配置日志记录,你可以通过编辑server/resources/log4j2.xml文件来调整日志等级,例如ERROR,WARN,INFO,DEBUG和TRACE。

- Solr 使用

日志文件

- 审查 Solr 日志文件:

- Solr 的日志文件通常位于

server/logs目录下。检查solr.log和其他相关日志文件,如solr_gc.log(Java 垃圾收集日志)。

- Solr 的日志文件通常位于

搜索具体信息

- 搜索错误和异常:

- 在日志文件中搜索

ERROR或Exception关键字来快速定位错误信息。

- 在日志文件中搜索

日志消息分解

- 分析日志消息:

- 解读日志消息中的时间戳、线程信息、日志等级、组件名称等,以获得有关产生日志的上下文信息。

实时监控

- 实时监控:

- 对日志进行实时监控可以使用

tail -f命令,如:tail -f /path/to/solr/server/logs/solr.log。

- 对日志进行实时监控可以使用

可视化工具

- 使用日志分析工具:

- 日志可视化和分析工具,如 Splunk 或 ELK Stack (Elasticsearch, Logstash, Kibana),可以帮助更有效地分析大量日志数据。

异常处理

异常类型

- 了解常见异常类型:

- Java 异常,如

NullPointerException,NumberFormatException等。 - Solr 异常,如

SolrException来自 Solr 本身的错误。

- Java 异常,如

错误代码

- 检查错误代码:

- Solr 在发生错误时会发送一个错误响应,通常包含 HTTP 状态码和错误消息。

恢复策略

- 准备恢复策略:

- 根据 Solr 的部署模式以及业务要求,预先设计故障恢复计划。

Solr 原因解决

- 根据根本原因解决问题:

- 分析完日志对异常原因有了了解后,针对性地修复问题代码或配置,而不仅仅是表面现象。

监控和警报

- 设置监控和警报:

- 建立监控系统来追踪性能指标和异常事件,配置警报通知来及时响应潜在问题。

测试和验证

- 测试和验证:

- 对所有配置更改和修复进行充分的测试,确认问题已解决且未引入新的问题。

文档和记录

- 记录问题和解决方案:

- 在处理完异常后,记录每个问题的详细信息和采取的解决措施,以建立知识库以便未来参考。

处理 Solr 异常与问题需要对其日志系统有深入的了解。精通这些技巧将大大提高解决问题的效率,并确保 Solr 环境的稳定性。如果您有关于 Solr 日志分析或异常处理的更多问题,或需要帮助,请随时提问。

9.3 讲述 Solr 服务监控和报警策略

监控和报警对于确保 Apache Solr 集群稳定运行和及时响应潜在问题至关重要。监控涉及到收集关于系统健康、性能和资源利用率的数据,而报警则是在检测到特定事件或指标异常时提醒系统管理员采取行动。

Solr 服务监控

监控 Solr 服务通常涉及以下几个方面:

系统健康监控:

- 监控 Solr 实例的可用性和响应时间。

- 确保服务端点,如 Solr Admin UI 或 API,能够正常响应。

性能监控:

- 跟踪查询的性能指标,如平均查询时间、请求等待时间和请求错误等。

- 监测索引过程的性能,如索引速度和索引队列大小。

资源使用情况:

- 监控 CPU、内存、磁盘空间和 I/O 操作。

- 检测网络带宽的使用情况和网络延迟情况。

应用层面的监控:

- 定期检查 Solr 的缓存使用情况,包括查询缓存和过滤器缓存效率。

- 监控 GC(垃圾收集)活动和 Java 堆内存的使用情况。

SolrCloud 特有监控:

- 针对 SolrCloud 部署,监控 ZooKeeper 状态,以及集群状况如分片的健康和复制状态。

日志分析:

- 分析 Solr 的日志信息,包括错误日志和查询日志,提取关键的性能指标和异常信息。

报警策略

定义根据监控到的指标或事件触发报警通知的策略:

阈值和条件:

- 根据过去的性能基线和业务需求设定报警阈值,如响应时间过长或错误率过高。

报警的规模和严重性:

- 根据问题的严重性配置信息级别,从一般通知到紧急警报。

通知方式:

- 使用邮件、短信、电话或集成的报警系统(如 PagerDuty 或 OpsGenie)进行通知。

监控和报警工具

使用合适的工具进行 Solr 服务的监控和报警,包括:

开源和商业工具:

- 如 Nagios、Zabbix、Datadog 和 New Relic 等提供系统层面和应用层面的监控。

Solr 自带工具:

- Solr 自带的埋点和指标报告(metrics reporting)。

日志分析工具:

- 如 ELK Stack (Elasticsearch, Logstash, Kibana) 用以日志的收集、存储和可视化。

注意事项

- 确保监控覆盖到所有关键组件和服务,不仅是 Solr,也包括底层的系统资源和支持服务(如 ZooKeeper)。

- 报警应该为层次化的,应区分实时操作需要的紧急报警和长期趋势监控的非紧急通知。

- 在对报警进行响应时,应有记录和处理事件的流程,确保问题得到解决,并改善未来的监控策略。

合理设置监控和报警系统不仅可以保证问题及时预警和修复,还能够通过性能数据的长期分析帮助优化 Solr 集群的配置和性能。

10. Solr 前沿和最佳实践

10.1 探讨 Solr 开发的最新趋势和未来方向

Apache Solr 是一个成熟的、开源的搜索平台,它被广泛应用于企业级搜索、大数据分析和内容管理系统等领域。随着技术的快速发展,Solr 也在持续演进以适应新的挑战和需求。以下是一些可能影响 Solr 开发未来方向的趋势:

云原生和分布式搜索

随着云计算的普及,越来越多的应用部署在云环境中。Solr 开发的一个关键趋势是其 SolrCloud 特性的进一步优化,它提供了对分布式搜索和索引的原生支持。云原生功能,如改善的缩容(scaling down)和跨云部署支持可能会成为研究的重点。

集成与互操作性

Solr 可能会继续完善其与外部系统和新技术的集成能力,例如容器化技术(如 Docker)、服务网格(如 Istio)和无服务器架构。这将允许 Solr 更好地适配现代化的微服务架构和 DevOps 实践。

人工智能和机器学习集成

搜索引擎正变得更加智能,Solr 可能会集成更多的人工智能和机器学习功能,为搜索和数据分析提供更高层次的见解和优化。这可能包括自然语言处理、增强的相关性算法和自动化数据洞察发掘。

性能和可伸缩性

随着数据规模的不断增长,提升性能和优化资源利用率将继续是 Solr 发展的重要方向。对大数据集和实时搜索需求的支持,以及横向扩展和自动索引管理的改进,都是潜在的发展重点。

安全性增强

随着数据保护法规的实施和安全意识的提升,提高搜索平台的安全性变得尤为重要。Solr 可能会着力加强数据安全性,支持更多的身份验证和授权机制,以及改进的加密和数据脱敏功能。

开源生态和社区合作

作为一个开源项目,Solr 将继续受益于其庞大的社区和合作伙伴的支持。Solr 项目可能会促进更多的社区合作,吸引更多的开发者参与核心功能开发、插件/扩展创新和最佳实践分享。

可观测性和管理工具

Solr 的监控、日志记录和故障排除工具可能会有所增强,提供更好的可观测性和管理便利性。这将有助于系统管理员和开发者更高效地维护和优化 Solr 实例。

尽管 Solr 在搜索引擎领域已经是领导者之一,但软件和技术发展的脚步永不停息。Solr 团队和社区很可能会持续寻找创新方法,将最新技术和市场变化融入到其未来的发展中。

10.2 分析 Solr 在 AI 和数据分析中的应用潜力

Apache Solr 作为一个强大的搜索引擎,除了提供快速、可扩展的搜索功能之外,其在人工智能(AI)和数据分析领域也展现出了巨大的应用潜力。以下是 Solr 在这些领域的应用潜力分析:

数据索引和搜索能力

Solr 能够处理和索引大量数据,并以极高的速度返回复杂查询的结果,这为 AI 和数据分析应用提供了强有力的基础设施。具体表现在:

文本分析:

- Solr 的文本处理能力,包括分词、同义词处理、拼写检查等,为自然语言处理(NLP)任务提供了强力支持。

实时分析:

- Solr 支持近实时(Near Real Time, NRT)索引,可以立即索引新的数据并使其可搜索,为实时数据分析提供支撑。

高级特性和算法支持

Solr 提供的高级特性和内置算法为实施 AI 和数据分析场景提供了可能性:

机器学习集成:

- Solr 可以与 Apache Mahout 或其他机器学习库集成,实现推荐系统和预测分析。

聚类算法:

- Solr 的 Carrot2 插件支持搜索结果聚类,通过分析文本数据自动组织信息,有助于揭示数据潜在的模式和主题。

统计信息和分面搜索:

- 分面搜索功能允许用户根据多维度进行数据聚合和分析,以更直观地理解数据集的分布。

可扩展性和分布式架构

Solr 的可扩展性和分布式架构使其成为大型 AI 和数据分析应用的理想选择:

SolrCloud:

- SolrCloud 提供了高可用性、故障转移和无缝扩展索引的能力,适合大规模数据分析。

数据的分片和复制:

- Solr 支持数据的分片,能够横跨多个节点处理大型数据集,以及利用数据复制保障冗余和可靠性。

定制和灵活性

Solr 的灵活性允许开发人员根据特定需求定制解决方案:

插件架构:

- Solr 的插件架构和可配置的管道使得可以插入自定义处理逻辑,比如添加 AI 算法作为搜索流程的一部分。

API 友好:

- Solr 提供了丰富的 RESTful API,允许开发者轻松地与 AI 应用和数据分析工具接口。

应用案例

推荐系统:

- 利用用户行为和偏好数据与 Solr 结合,提供个性化的商品或内容推荐。

情感分析:

- 分析用户评论和反馈,以获取对品牌和产品的情感倾向。

舆情监控:

- 实时跟踪和分析新闻、博客和社交媒体内容,以洞察公共情绪和趋势。

Solr 强大的索引和搜索功能,搭配其在文本处理、扩展性及 API 方面的优势,使其成为支持 AI 和数据分析应用的有力工具。当然,要充分利用 Solr 在这些领域的潜力,可能需要结合数据科学、机器学习和自然语言处理等领域的专业知识和技术。通过适当的定制和集成,Solr 可以成为驱动新一代智能应用和深入数据洞察的关键组件。

10.3 讨论 Solr 实战案例和最佳实践分享

Apache Solr 是一个高性能、可扩展的全文搜索服务器,广泛用于为各种类型的 Web 应用程序提供搜索功能。以下是一些 Solr 实战案例以及采取的最佳实践分享。

实战案例

企业级网站搜索:

大型公司的官方网站上集成 Solr 来提供对网站内容的全文搜索功能。Solr 通过其高性能的分布式搜索和索引复制功能,确保即使在流量高峰期间也能够快速响应。电子商务平台:

电子商务网站用 Solr 来实现产品的快速搜索和过滤,包括分面搜索、自动完成功能以及个性化的产品推荐。文档管理系统:

一些企业将 Solr 用于文档管理,通过对文档的索引和存储进行优化,快速检索文档,并提供权限管理。社交媒体分析:

利用 Solr 对社交媒体数据流进行实时索引和分析,以跟踪和监测品牌的社会影响力。日志分析平台:

系统管理员和开发人员使用 Solr 来聚合、搜索和分析来自数据中心的大量日志数据,以监控系统健康状态并快速定位问题。

最佳实践

Schema 设计:

仔细设计文档 schema,为字段优化类型,并配置正确的分析器和 Tokenizer,以实现精确的搜索和索引性能。适当的分片和复制:

根据需要合理设置集群的分片数量和每个分片的副本数,以平衡读写负载和系统高可用。缓存配置:

配置查询缓存、filter 缓存和文档缓存以提高反复查询的性能。使用分面和过滤查询:

利用分面(Faceting)和过滤查询(Filter Query)以便快速聚合搜索结果,改善搜索体验。性能监控:

持续监控 Solr 的性能,并针对慢查询优化索引和查询参数。负载均衡:

使用负载均衡器分配请求,确保没有单个服务器被过载。安全性考虑:

使用 Solr 的安全特性(如基于角色的认证和权限控制)保护数据和搜索接口。定期维护:

optimize命令和VACUUM类似,在索引变化不大时定期运行,但要注意它是一个资源密集型操作。丰富查询功能:

利用 Solr 提供的更多查询特性,如高亮、拼写检查和同义词扩展。准备灾难恢复计划:

定期备份索引数据,并实施故障转移策略。

通过实际案例和最佳实践的不断探索和总结,我们可以发现 Solr 在不同环境下的灵活性和强大功能。无论是对于小型企业还是大型企业系统,合理地配置和使用 Solr 都能显著提高数据的可检索性和用户的搜索体验。