深度学习(23):SmoothL1Loss损失函数

1.背景介绍

在深度学习中,损失函数是评估模型预测值与真实值之间差异的关键指标。选择合适的损失函数对于模型的训练至关重要。SmoothL1Loss损失函数是一种常用的损失函数,它结合了平方损失和绝对损失的优点,适用于回归问题。

2.核心概念与联系

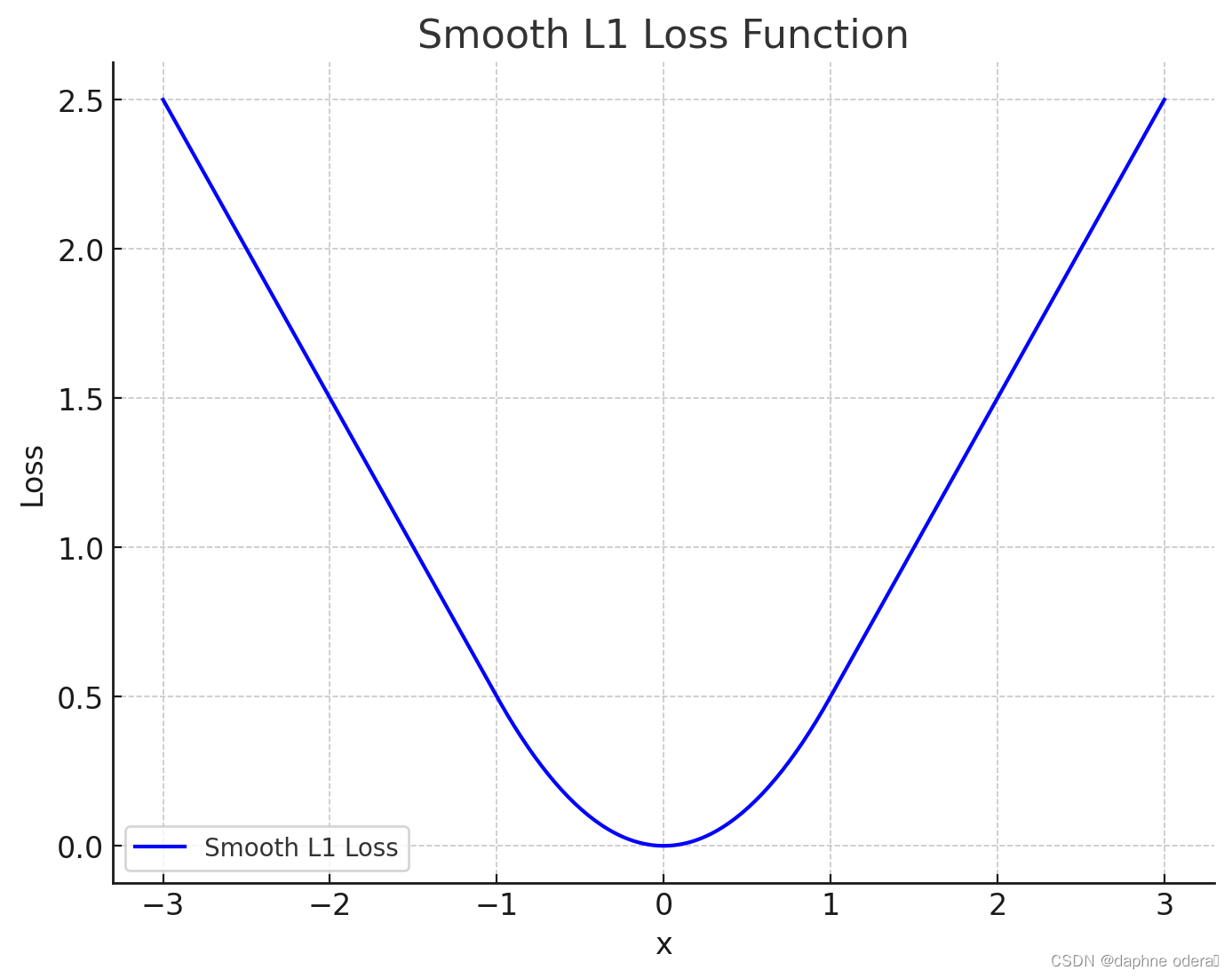

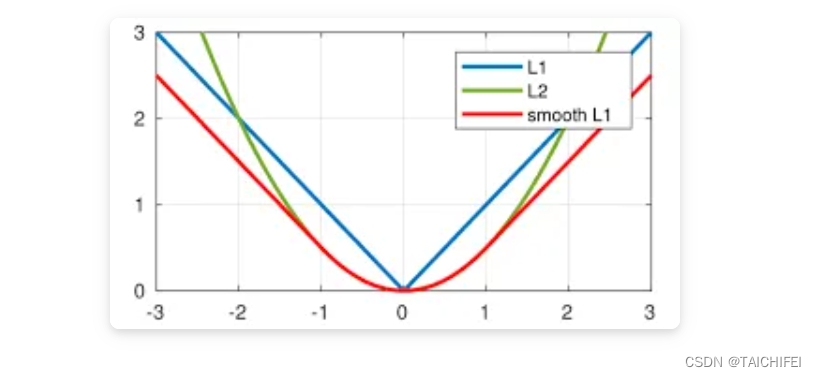

SmoothL1Loss损失函数是一种平滑的L1损失函数,它将平方损失和绝对损失结合起来,以减少在接近零时的数值不稳定性。SmoothL1Loss损失函数的定义为:

L ( x ) = { 1 2 x 2 if ∣ x ∣ ≤ 1 ∣ x ∣ − 1 2 otherwise L(x) = \begin{cases} \frac{1}{2}x^2 & \text{if } |x| \leq 1 \\ |x| - \frac{1}{2} & \text{otherwise} \end{cases} L(x)={21x2∣x∣−21if ∣x∣≤1otherwise

其中, x x x 是预测值与真实值之间的差值。当 ∣ x ∣ ≤ 1 |x| \leq 1 ∣x∣≤1时,SmoothL1Loss损失函数退化为平方损失;当 ∣ x ∣ > 1 |x| > 1 ∣x∣>1时,它退化为绝对损失。

3.核心算法原理和具体操作步骤以及数学模型公式详细讲解

SmoothL1Loss损失函数的计算过程可以分为以下几个步骤:

- 计算预测值与真实值之间的差值 x x x。

- 判断 x x x的绝对值是否小于等于1。

- 如果 ∣ x ∣ ≤ 1 |x| \leq 1 ∣x∣≤1,则使用平方损失公式计算损失值。

- 如果 ∣ x ∣ > 1 |x| > 1 ∣x∣>1,则使用绝对损失公式计算损失值。

4.具体最佳实践:代码实例和详细解释说明

以下是一个使用PyTorch实现的SmoothL1Loss损失函数的代码实例:

import torch

import torch.nn.functional as F

# 假设我们有一个预测值和一个真实值

pred = torch.tensor([0.5, 1.5, 2.5])

true = torch.tensor([0.5, 1.5, 2.5])

# 使用SmoothL1Loss损失函数计算损失

loss = F.smooth_l1_loss(pred, true)

print(loss)

在这个例子中,我们首先导入了PyTorch库和它的函数库torch.nn.functional。然后,我们创建了一个预测值pred和一个真实值true。接着,我们使用F.smooth_l1_loss函数计算损失值,并打印出来。

5.实际应用场景

SmoothL1Loss损失函数常用于回归问题,如物体检测、语音识别等。它能够有效地处理预测值与真实值之间的较大差异,同时避免在接近零时的数值不稳定性。

6.工具和资源推荐

- PyTorch:一个开源的机器学习库,提供了丰富的深度学习功能,包括损失函数的实现。

- TensorFlow:另一个流行的开源机器学习库,也提供了损失函数的实现。

7.总结:未来发展趋势与挑战

SmoothL1Loss损失函数在深度学习中具有广泛的应用,它能够有效地处理回归问题中的预测值与真实值之间的差异。未来的发展趋势可能包括进一步改进损失函数,以适应更复杂的任务和数据集。同时,挑战可能包括如何选择合适的损失函数来优化模型的性能。

8.附录:常见问题与解答

Q: SmoothL1Loss损失函数与平方损失函数有什么区别?

A: SmoothL1Loss损失函数结合了平方损失和绝对损失的优点,能够更好地处理预测值与真实值之间的差异。当预测值与真实值之间的差异较小时,它退化为平方损失;当差异较大时,它退化为绝对损失。

Q: 如何选择合适的损失函数?

A: 选择合适的损失函数取决于具体的应用场景和任务。对于回归问题,SmoothL1Loss损失函数是一个不错的选择。对于分类问题,交叉熵损失函数更为常见。需要根据任务的特点和数据集的特性来选择合适的损失函数。