大模型笔记:最少到最多提示过程 (Least to Most prompting, LtM)

- 开发

- 44

-

LEAST-TO-MOST PROMPTING ENABLES COMPLEX REASONING IN LARGE LANGUAGE MODELS 2023 ICLR

1 概述

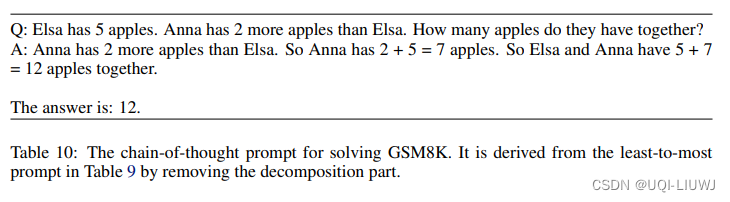

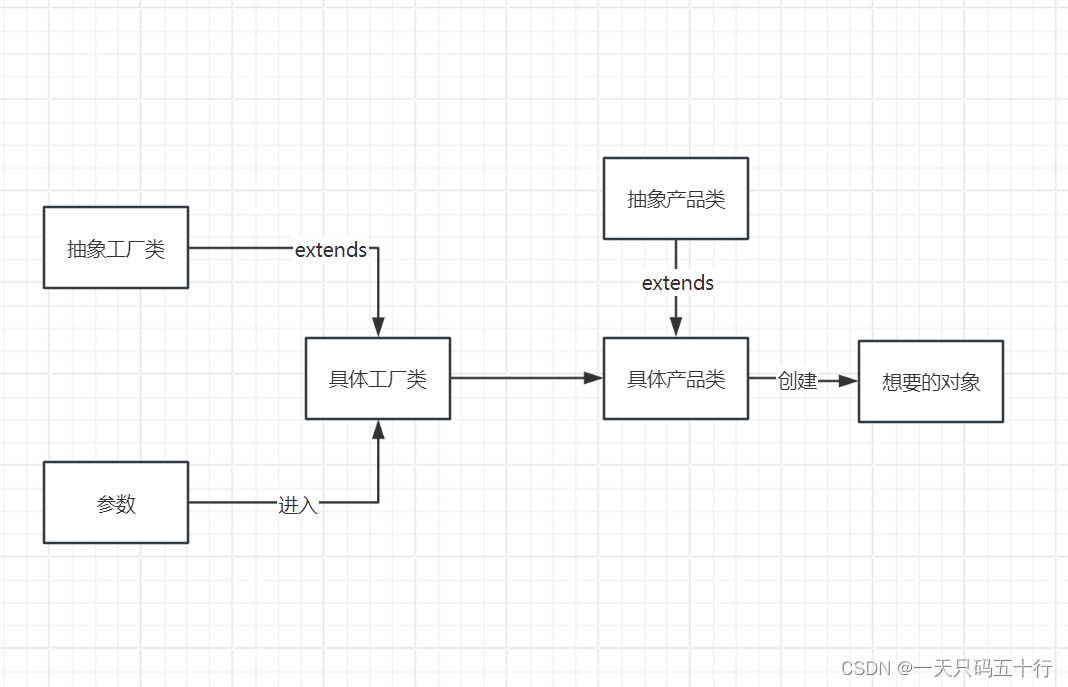

- 进一步发展维链提示过程 (CoT prompting)

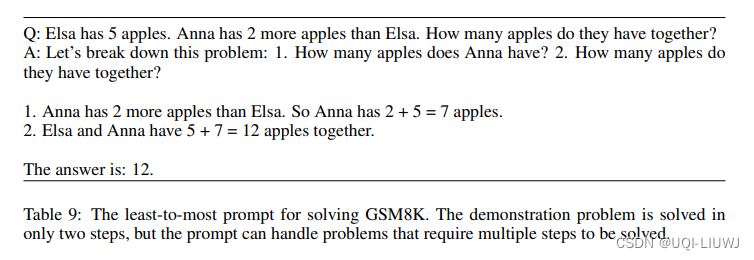

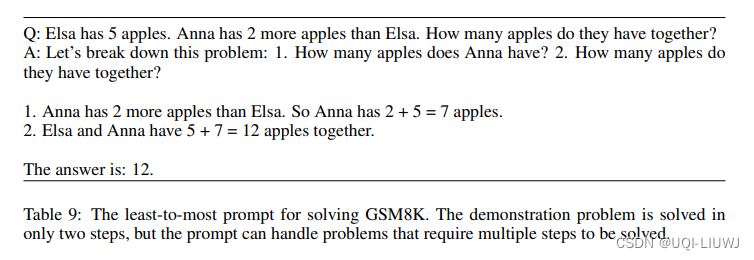

分为两个阶段:

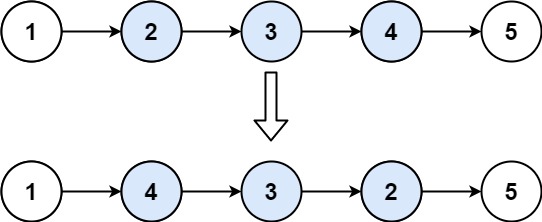

第一阶段:向语言模型提出查询,将问题分解成子问题。- 第二阶段:再次向语言模型提出查询,逐个解决这些子问题。

- 解决第二个子问题的答案建立在第一个子问题的答案之上。

- 原始问题被附加在最后作为最终的子问题。

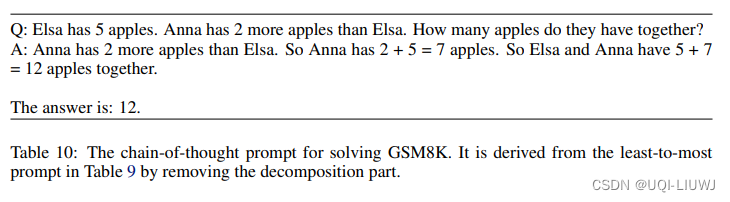

2 和CoT的对比

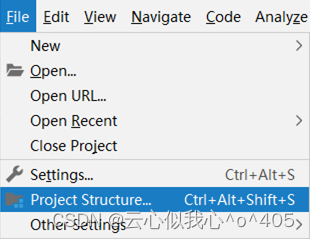

Least to Most prompting:

CoT:

原文地址:https://blog.csdn.net/qq_40206371/article/details/136548500

本文来自互联网用户投稿,该文观点仅代表作者本人,不代表本站立场。

本站仅提供信息存储空间服务,不拥有所有权,不承担相关法律责任。

如若转载,请注明出处:https://www.suanlizi.com/kf/1767144442298503168.html

如若内容造成侵权/违法违规/事实不符,请联系《酸梨子》网邮箱:1419361763@qq.com进行投诉反馈,一经查实,立即删除!