TensorboardX

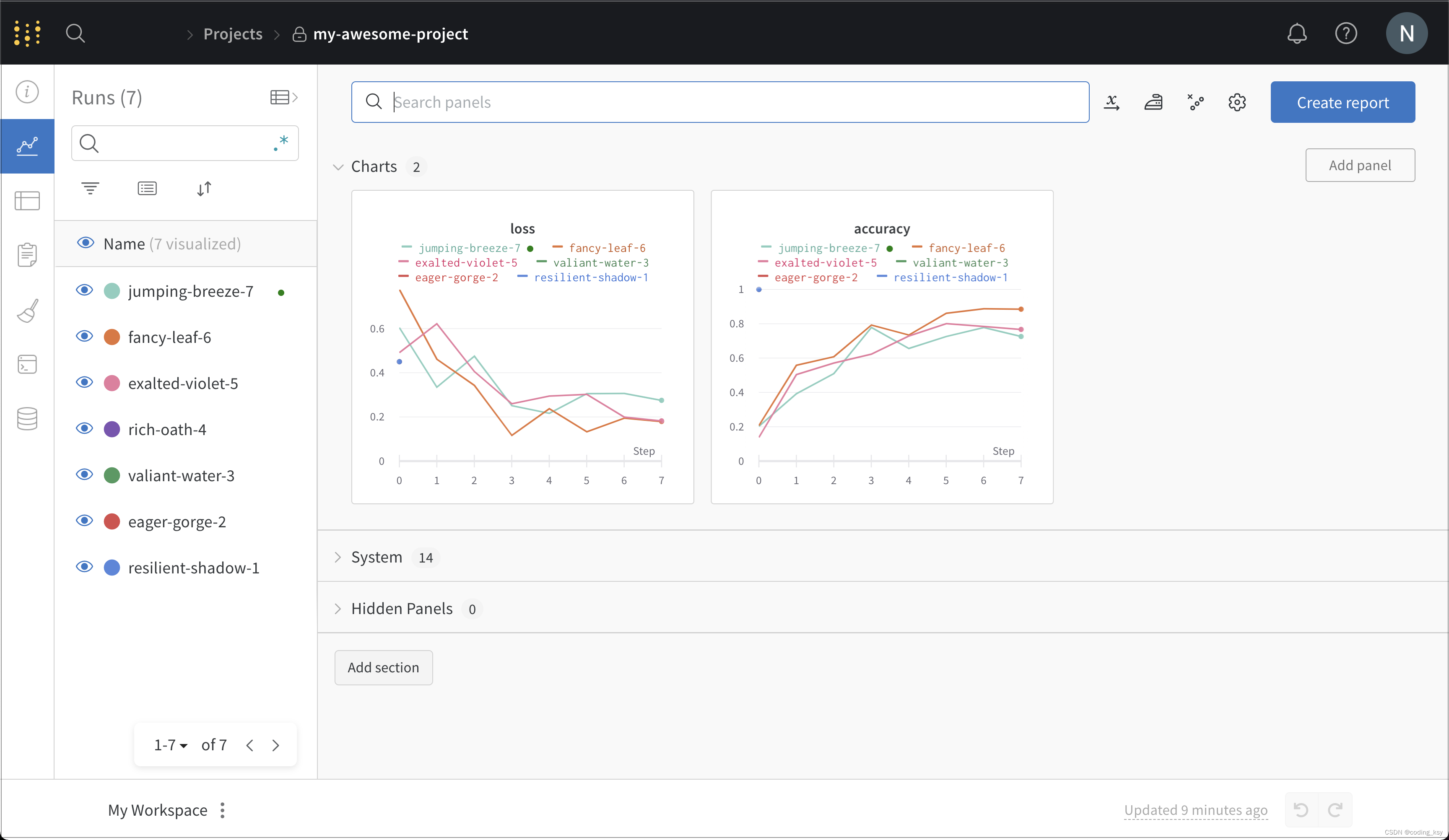

在PyTorch中,模型训练的可视化通常通过TensorBoard或Visdom等工具实现。以下是如何使用TensorBoard进行模型训练可视化的步骤:

使用TensorboardX与PyTorch配合

确保已经安装了tensorboard和tensorboardX库。

pip install tensorboard

pip install tensorboardX

在训练过程中记录损失、准确率等指标:

from torch.utils.tensorboard import SummaryWriter

import torch.nn as nn

# 假设你已经有了模型、优化器、损失函数以及数据加载器

model = ... # 你的模型实例

criterion = nn.CrossEntropyLoss() # 或者其他适合的损失函数

optimizer = torch.optim.Adam(model.parameters())

dataloader = DataLoader(...) # 你的数据加载器

# 创建一个SummaryWriter对象来写入日志文件

writer = SummaryWriter()

num_epochs = 100

for epoch in range(num_epochs):

for inputs, targets in dataloader:

optimizer.zero_grad()

outputs = model(inputs)

loss = criterion(outputs, targets)

loss.backward()

optimizer.step()

# 记录每批次的损失到TensorBoard

writer.add_scalar('Training Loss', loss.item(), epoch * len(dataloader) + len(inputs))

# 在每个epoch结束时记录其他评估指标(例如验证集上的精度)

with torch.no_grad():

val_loss = validate_your_model(model, validation_loader)

writer.add_scalar('Validation Loss', val_loss, epoch)

# 在所有训练完成后关闭writer

writer.close()

# 然后运行tensorboard服务并打开可视化界面

%tensorboard --logdir=runs # Jupyter notebook内

# 或在终端执行

tensorboard --logdir=runs

计算模型参数量和浮点数:

def count_parameters(model):

return sum(p.numel() for p in model.parameters() if p.requires_grad)

total_params = count_parameters(model)

print(f"Total trainable parameters: {total_params}")

评价指标通常根据任务类型有所不同,例如分类任务中的精度、召回率、F1分数等,回归任务中的均方误差(MSE)、平均绝对误差(MAE)等。可以将这些指标也记录到TensorBoard中,就像记录损失那样。

例如,对于分类任务,假设有预测输出和真实标签:

from sklearn.metrics import accuracy_score

# 验证集上的预测

predictions = torch.argmax(model(val_inputs), dim=1)

true_labels = val_targets

accuracy = accuracy_score(true_labels.cpu().numpy(), predictions.cpu().numpy())

writer.add_scalar('Validation Accuracy', accuracy, epoch

Visdom

这是一个Web-based实时数据可视化工具,可以与PyTorch一起使用来监控训练过程。下面是使用Visdom的基本代码示例:

import visdom

vis = visdom.Visdom()

# 记录损失值

vis.line(Y=[loss], X=[epoch], win='Loss', update='append')

# 显示图像等其他类型的数据也类似,需要根据Visdom API操作

- 对于模型参数量的计算,可以通过

torch.nn.Module的子类实例直接统计:

import torch

from your_model_module import YourModelClass

model = YourModelClass()

total_params = sum(p.numel() for p in model.parameters())

print(f"Total number of parameters: {total_params}")

- 浮点数计算通常指的是模型占用的内存大小,可以通过下面的方式来估算(单位为MB):

param_size = sum(torch.prod(torch.tensor(p.size())) * p.element_size() for p in model.parameters())

print(f"Estimated memory usage: {param_size / (1024 ** 2):.2f} MB")