目录

前言

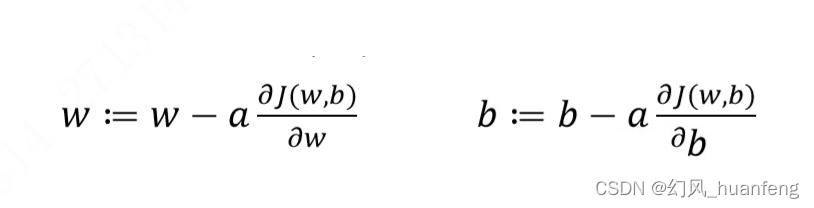

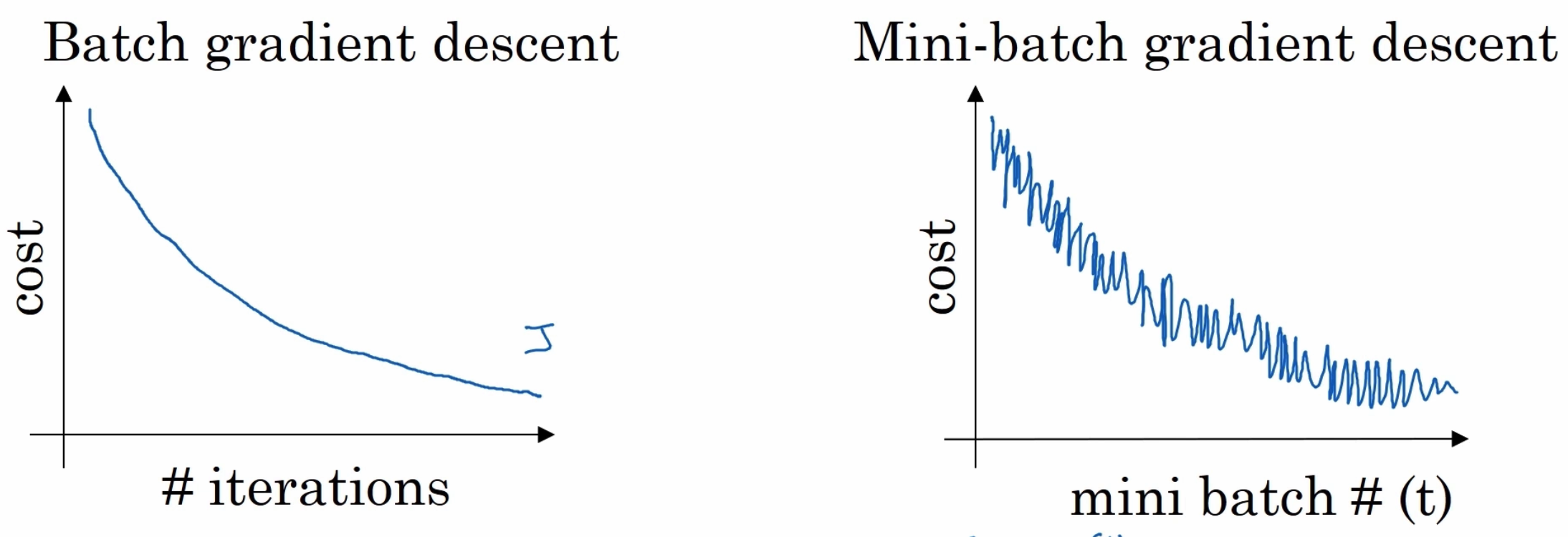

梯度下降是机器学习中常用的优化算法,通过迭代更新模型参数以最小化代价函数。然而,合适的学习率(α)的选择至关重要,它直接影响了算法的收敛性和效率。本文将深入讨论学习率的选择问题,并介绍一种自动收敛测试方法,以确保梯度下降算法能够有效地收敛。

1 学习率的选择

学习率在梯度下降算法中扮演着至关重要的角色,过大或过小都可能导致训练困难。在选择学习率时,我们需要认识到不同范围的取值可能带来的问题。

1.1 过大的问题

选择过大的学习率可能让梯度下降算法失去控制,每次参数更新的步长太大,容易越过代价函数的最小值。这会导致算法发散,代价函数的值不断增大,表明参数更新过程未能找到全局最优解。

1.2 过小的问题

相反,选择过小的学习率会导致收敛速度过慢。算法需要更多的迭代次数才能收敛到最优解,这不仅消耗更多计算资源,还可能延缓模型的训练速度,降低算法的效率。

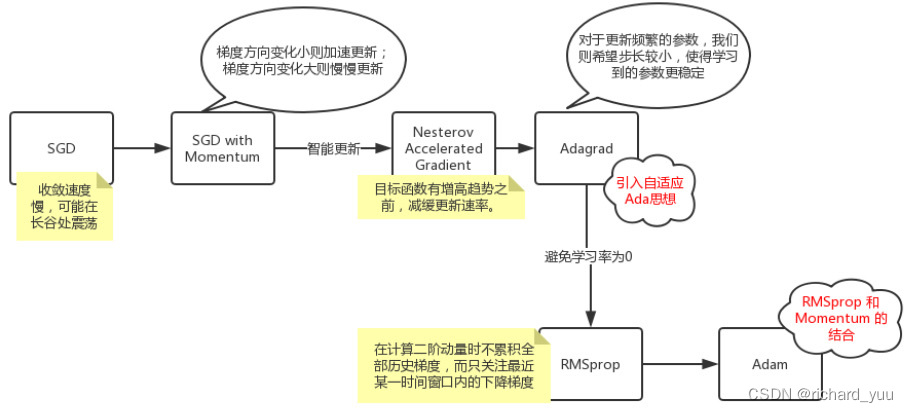

1.3 适当的选择

为解决学习率选择的难题,采用自适应学习率调整策略是一种明智的做法。通过动态调整学习率,可以在不同的训练阶段取得更好的效果。在迭代初期,我们希望快速收敛,因此可以选择较大的学习率;而在接近最优解时,逐渐减小步长,避免错过最小值。

在实际操作中,以3的倍数对学习率进行调整是一种常见的精细调参方法。如果学习率过大,可以将其缩小至当前的1/3;反之,如果学习率过小,可以尝试将其增加至当前的3倍。这种精准调参的策略有助于保持学习过程的稳定性和效率。

通过合理选择学习率,并结合自适应调整的技巧,我们可以更好地引导梯度下降算法向着全局最优解迈进,提高模型训练的效果。

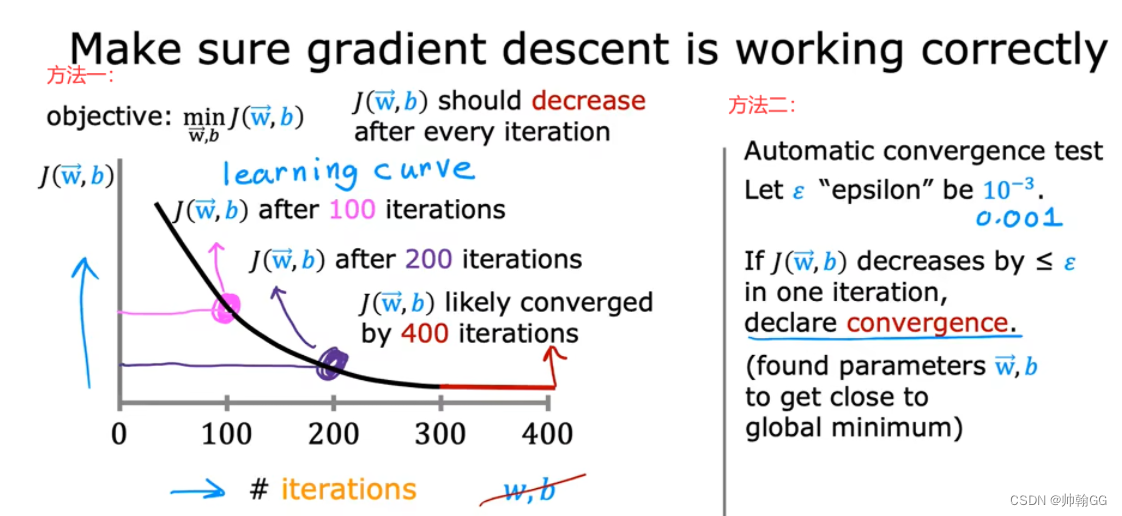

2 自动收敛测试:阈值方法

在梯度下降算法中,学习率的选择直接关系到算法是否能够有效地收敛。为了确保算法的收敛状态更加可靠,采用自动收敛测试是至关重要的。其中,𝜖(epsilon)方法是一种被广泛使用的测试手段,通过设定阈值来监测代价函数的变化。

2.1 𝜖方法的核心思想

该方法的核心思想是设定一个代价函数变化的阈值,通常选择为10的-3次方。每次迭代后,都会检查代价函数的变化是否小于设定的阈值。如果是,算法被认为已经收敛。

2.2 实时监测收敛状态的优势

自动收敛测试通过实时监测算法的收敛状态,确保梯度下降算法每一步都朝着更优的方向前进。这种方法的优势在于它能够在算法运行过程中动态地适应不同的数据和学习率情况,提高算法的稳定性和可靠性。

2.3 避免潜在问题的措施

采用自动收敛测试可以有效避免一些潜在问题,如过大学习率导致算法发散,或者过小学习率导致收敛速度过慢。通过设定阈值,能够及时发现并纠正这些问题,确保梯度下降算法能够在合适的学习率下迅速收敛。

在实际应用中,结合学习率的选择和自动收敛测试,可以使得梯度下降算法更加稳健地适应不同的数据集和模型结构,提高算法的可靠性和实用性。

结论

在梯度下降算法中,学习率的选择是影响算法性能的重要因素之一。过大或过小的学习率都会对算法的收敛性产生负面影响。通过自动收敛测试,特别是伊普西隆方法,我们可以有效地监测梯度下降算法的收敛状态,从而选择合适的学习率,提高算法的效率和稳定性。在实际应用中,对学习率的合理选择和自动收敛测试的应用,将有助于提升机器学习模型的性能和训练效果。