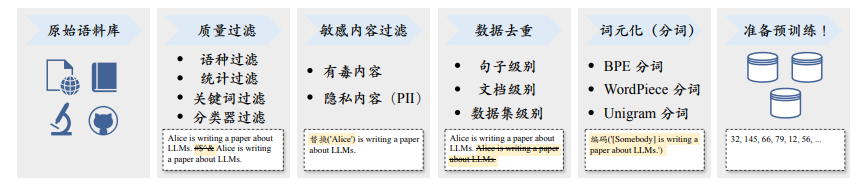

在文本分类中,数据预处理是一个重要的步骤,它帮助将原始的文本数据转换为模型可以处理的格式。数据预处理的步骤包括文本清洗、分词、去除停用词、词干化或词形还原以及构建特征向量等。

以下是对数据进行预处理的示例代码:

import re

import nltk

from nltk.corpus import stopwords

from nltk.stem import PorterStemmer

from nltk.stem import WordNetLemmatizer

# 文本清洗

def clean_text(text):

text = text.lower() # 将文本转换为小写

text = re.sub(r'\d+', '', text) # 去除数字

text = re.sub(r'[^\w\s]', '', text) # 去除标点符号

text = re.sub(r'\s+', ' ', text) # 去除多余空格

return text

# 分词

def tokenize_text(text):

tokens = nltk.word_tokenize(text)

return tokens

# 去除停用词

def remove_stopwords(tokens):

stop_words = set(stopwords.words('english'))

filtered_tokens = [token for token in tokens if token not in stop_words]

return filtered_tokens

# 词干化

def stem_tokens(tokens):

stemmer = PorterStemmer()

stemmed_tokens = [stemmer.stem(token) for token in tokens]

return stemmed_tokens

# 词形还原

def lemmatize_tokens(tokens):

lemmatizer = WordNetLemmatizer()

lemmatized_tokens = [lemmatizer.lemmatize(token) for token in tokens]

return lemmatized_tokens

# 构建特征向量

def build_feature_vector(tokens):

feature_vector = {}

for token in tokens:

feature_vector[token] = feature_vector.get(token, 0) + 1

return feature_vector

# 示例

text = "This is an example sentence."

cleaned_text = clean_text(text)

tokens = tokenize_text(cleaned_text)

filtered_tokens = remove_stopwords(tokens)

stemmed_tokens = stem_tokens(filtered_tokens)

lemmatized_tokens = lemmatize_tokens(stemmed_tokens)

feature_vector = build_feature_vector(lemmatized_tokens)

print(feature_vector)

在这个示例代码中,首先对原始文本进行了清洗操作,包括将文本转换为小写、去除数字和标点符号,以及去除多余空格。然后使用NLTK库对文本进行分词,然后使用停用词列表去除停用词。接下来,对剩余的词进行词干化和词形还原操作,以减少词形的变化对文本分类的影响。最后,构建了一个特征向量,其中每个词的出现次数作为特征值。

这些预处理操作可以根据具体的数据集和任务进行调整和组合。

![[自然语言处理|NLP] <span style='color:red;'>文本</span><span style='color:red;'>分类</span>与情感<span style='color:red;'>分析</span>,<span style='color:red;'>数据</span><span style='color:red;'>预处理</span>流程,包括了同义词替换和拼写纠正,以及使用NLTK库和TextBlob库<span style='color:red;'>进行</span>标记化和情感<span style='color:red;'>分析</span>(附<span style='color:red;'>代码</span>)](https://img-blog.csdnimg.cn/direct/48f1bd6566364ab88ba1f5fb9cb9b583.png)