下面学习一个具体的实例,关于中介根据历史房屋价格,进行房价评估和预测的方法。

大家都知道,中介要给房东和客户报价,一般人是比较有经验的,资深的经纪人,往往会报出更符合市场的价格,再进行一定的微调,管理好买家和卖家的预期,这是非常重要的。

对于一些有实力的中介,可能就要对房价进行一定的预测,例如成交出现下降,或者不太正常的上升,就要进行风险控制和大数据分析了,是经纪人为了成交,把价格报的太低?导致交易量上升,而收入可能受到影响。或者是房价报的太高?导致买家不认可?

这就需要让数据来说话,给出一套房子,比较合理的价格。

这是,由于中介掌握了大量的历史交易数据,就可以进行机器学习和分析了。

任务目标:根据已有的交易数据,训练模型,预测房屋的价格。

步骤:

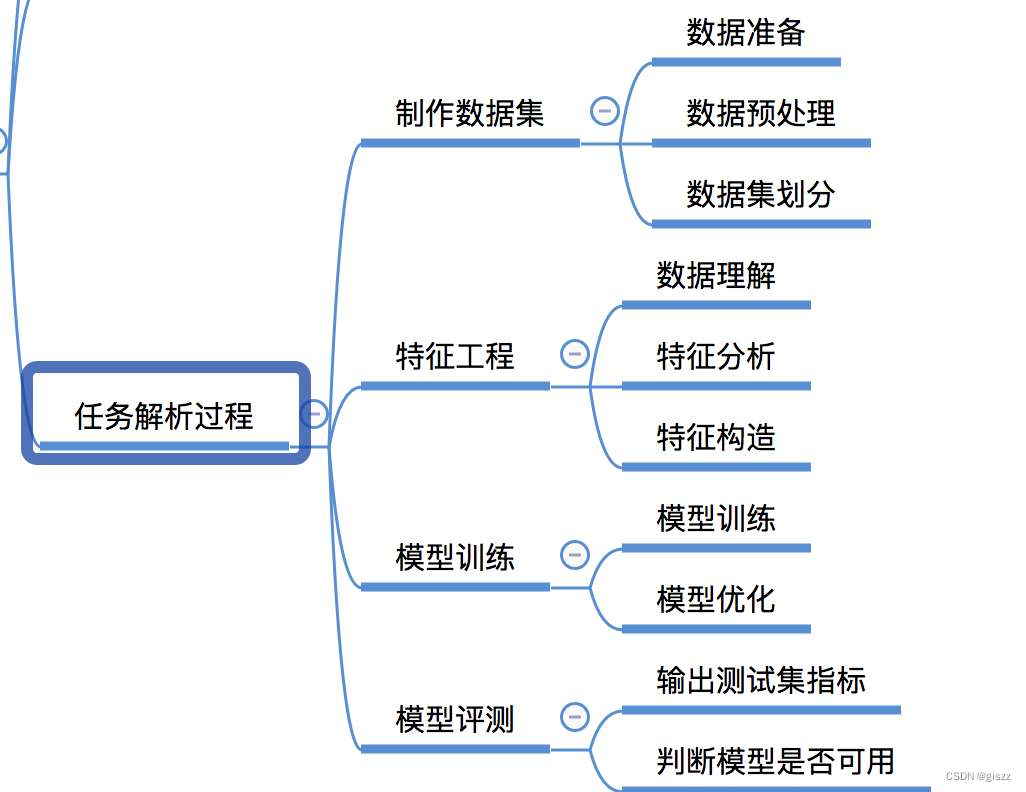

任务解析:

- 制作数据集

- 特征工程

- 模型训练

- 模型评测

延伸学习:

机器学习模型构建:从数据集制作到模型评测

一、数据集制作

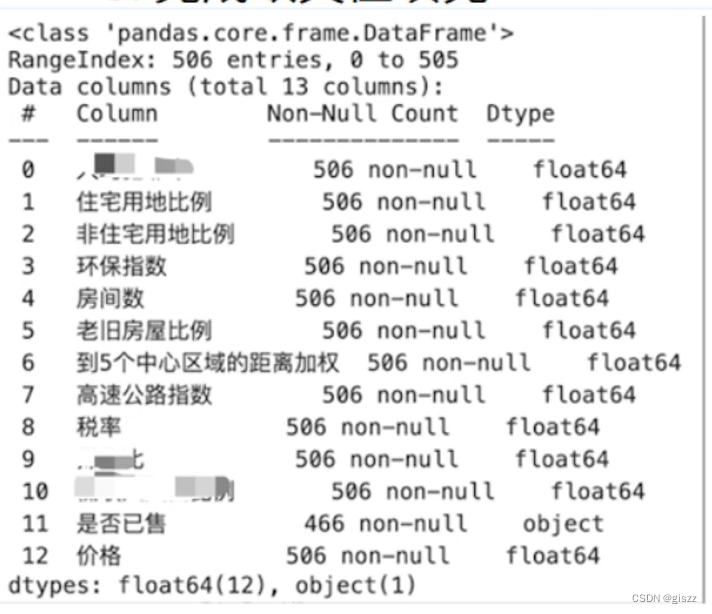

在机器学习中,数据集是训练模型的基石。一个高质量的数据集往往能够决定模型的最终性能。数据集制作包括数据的收集、清洗、标注和划分等步骤。

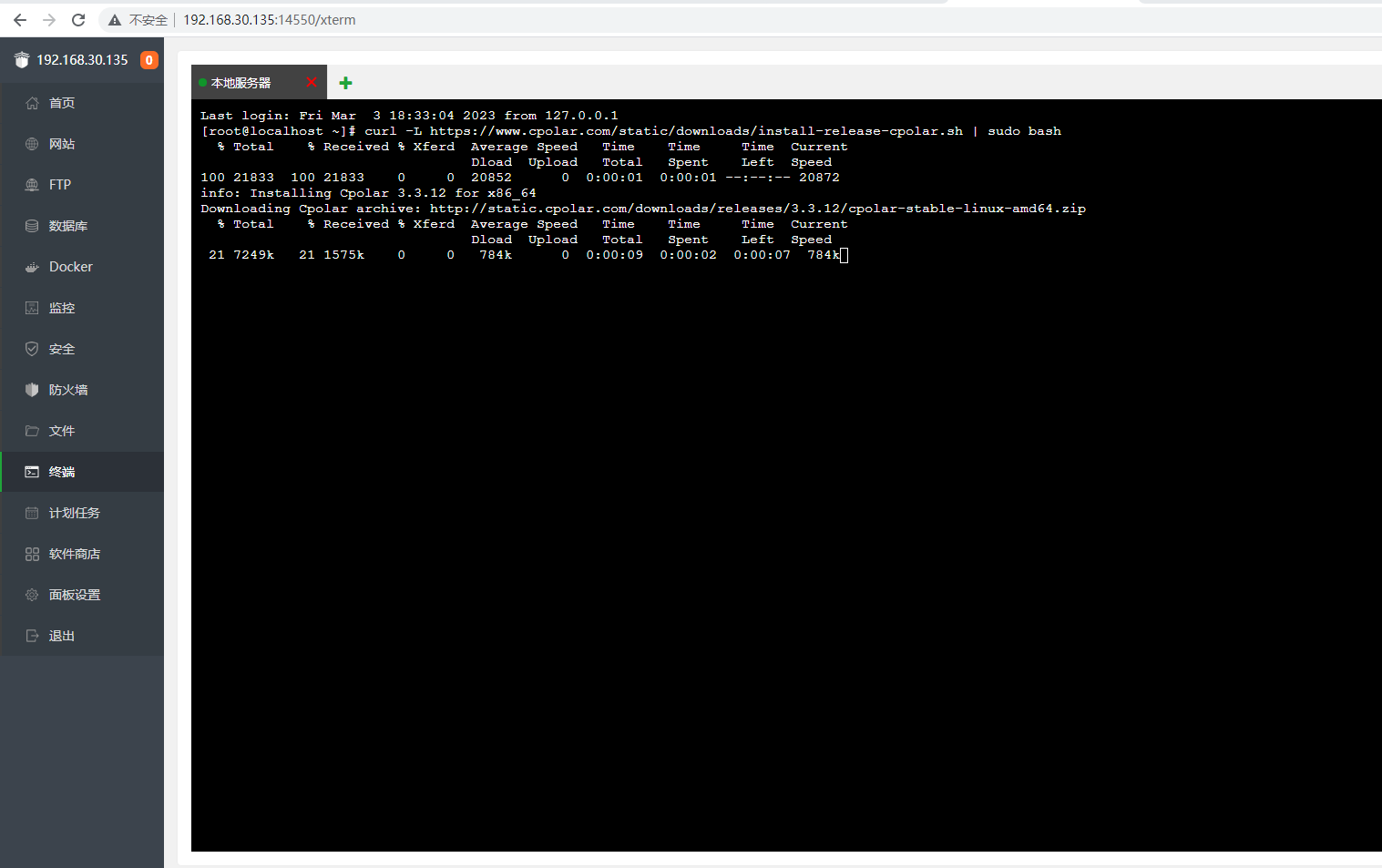

数据收集:这一步骤涉及到从各种来源获取原始数据。数据可以来自公开数据集、API接口、数据库、日志文件、传感器等。关键是要确保收集到的数据具有代表性,能够反映真实世界的情况。

数据清洗:原始数据中往往存在噪声、缺失值、异常值等问题。数据清洗的目的是去除这些不良影响,使得数据更加准确、一致。常见的数据清洗技术包括去除重复值、填充缺失值(如使用均值、中位数、众数等)、平滑噪声数据、识别和处理异常值等。

数据标注:对于监督学习任务,需要对数据进行标注,即为每条数据分配一个或多个标签。标注过程可以是人工的,也可以是半自动的。标注的准确性对模型训练至关重要。

数据划分:在训练模型之前,通常将数据集划分为训练集、验证集和测试集。训练集用于训练模型,验证集用于调整模型参数和超参数,测试集用于评估模型的最终性能。

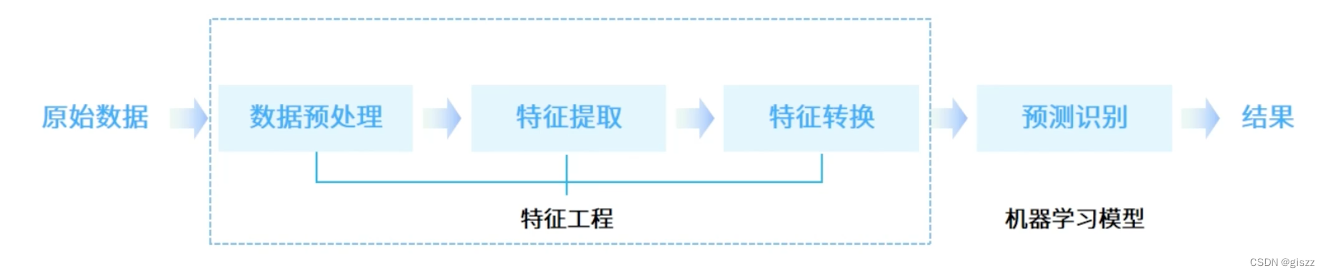

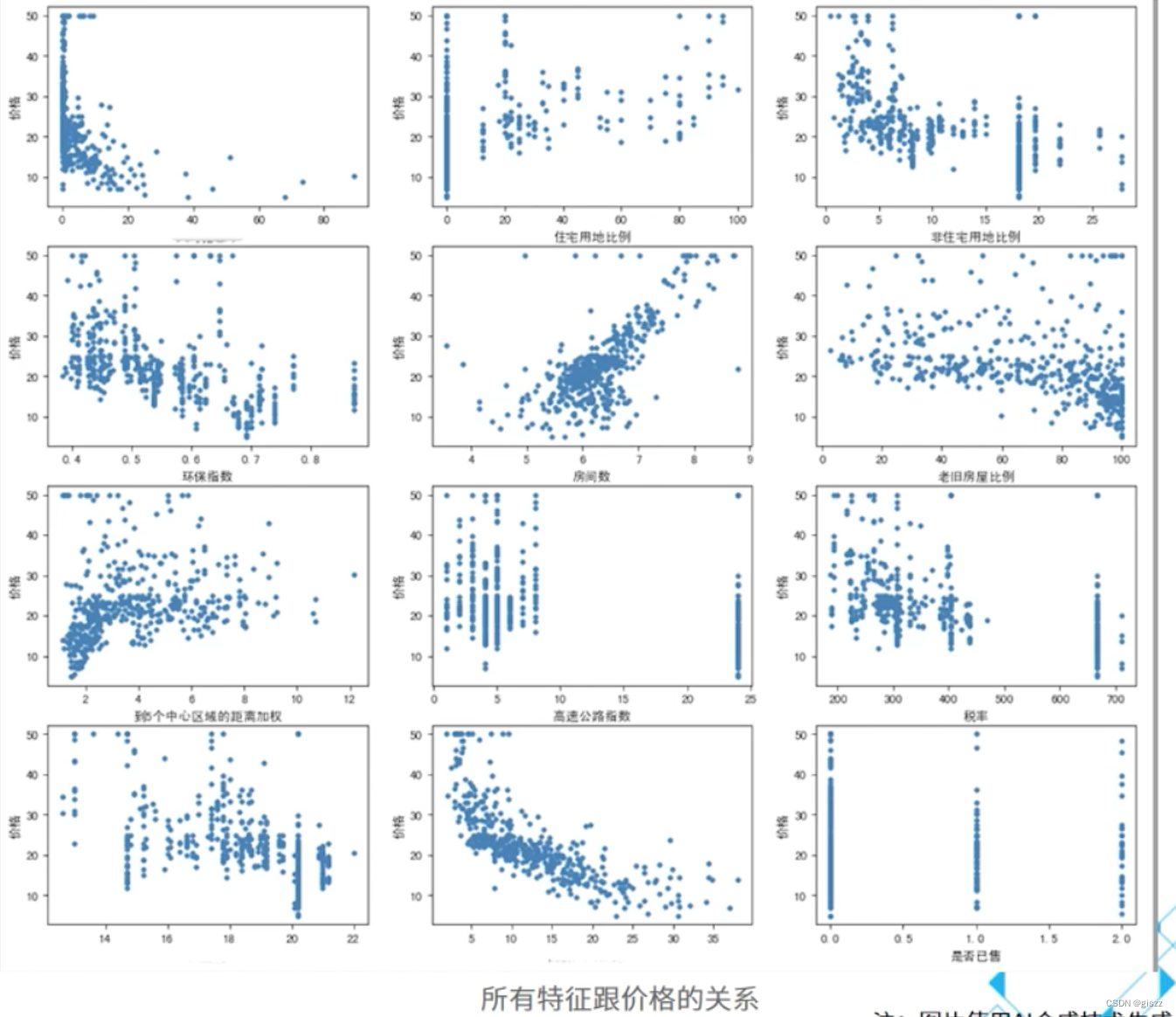

二、特征工程

特征工程是将原始数据转换为机器学习算法能够理解的格式的过程。好的特征能够显著提高模型的性能。

特征选择:从原始特征集中选择出对模型预测最有用的特征。这可以通过相关性分析、互信息、卡方检验等方法实现。特征选择的目的是去除冗余和不相关的特征,减少模型的复杂度,提高模型的泛化能力。

特征构造:根据领域知识和对数据的理解,构造新的特征。这可以包括特征的组合、转换(如对数转换、多项式转换等)和编码(如独热编码、标签编码等)。

特征缩放:将特征值缩放到相同的范围,以消除量纲对模型的影响。常见的特征缩放技术包括标准化和归一化。

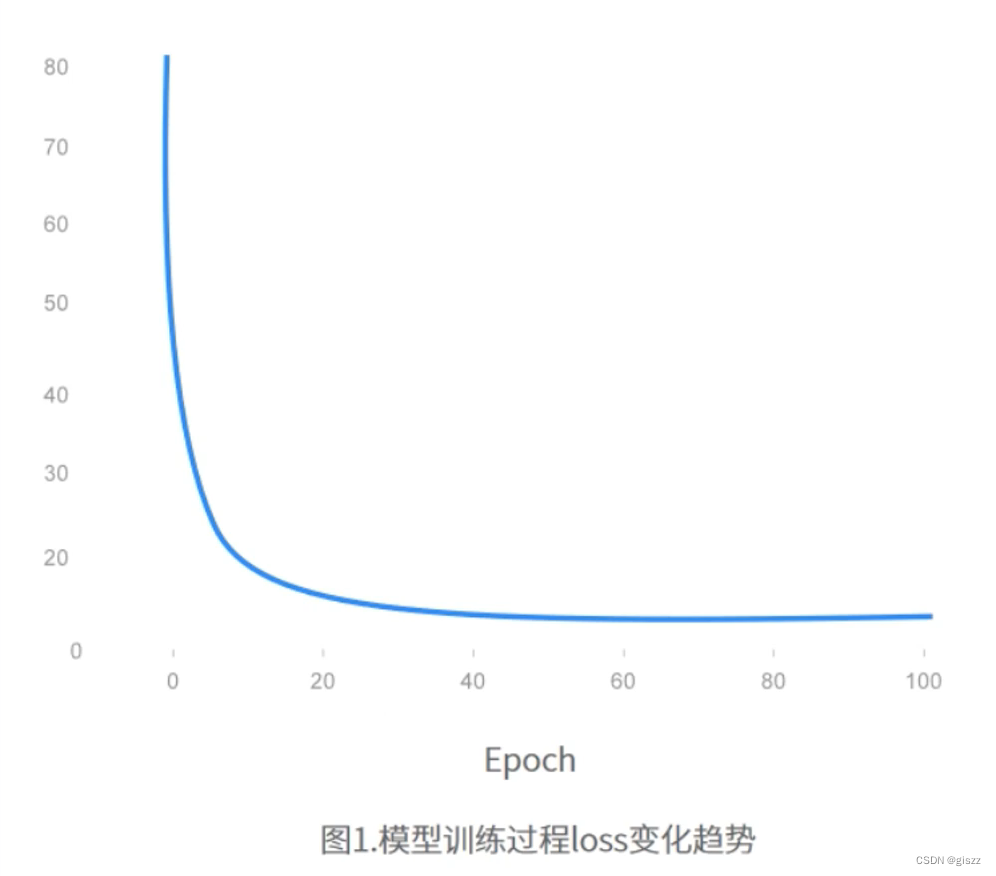

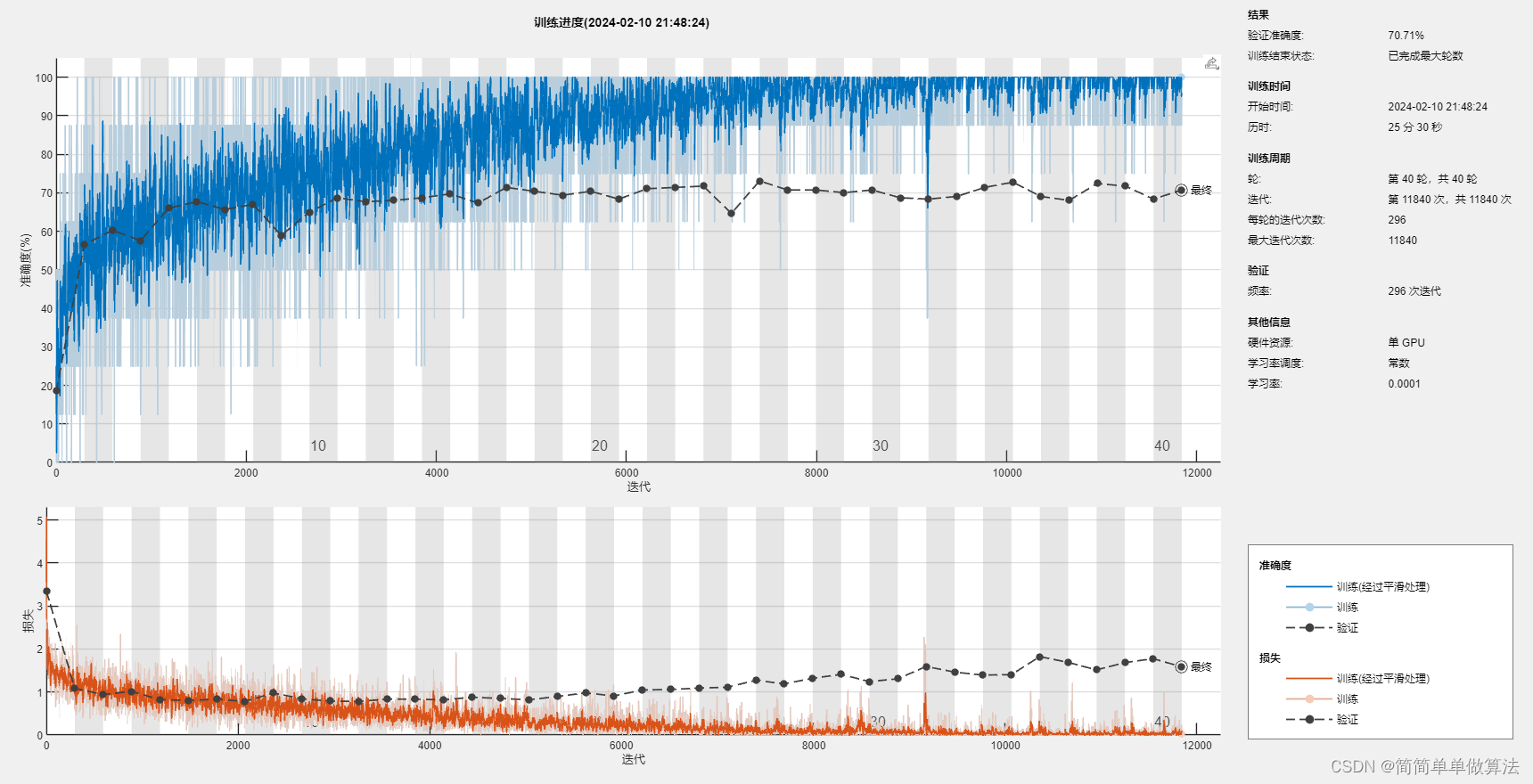

三、模型训练

模型训练是使用训练数据集和相应的算法来拟合模型参数的过程。这一步骤的关键在于选择合适的算法和损失函数,以及优化算法来最小化训练过程中的损失。

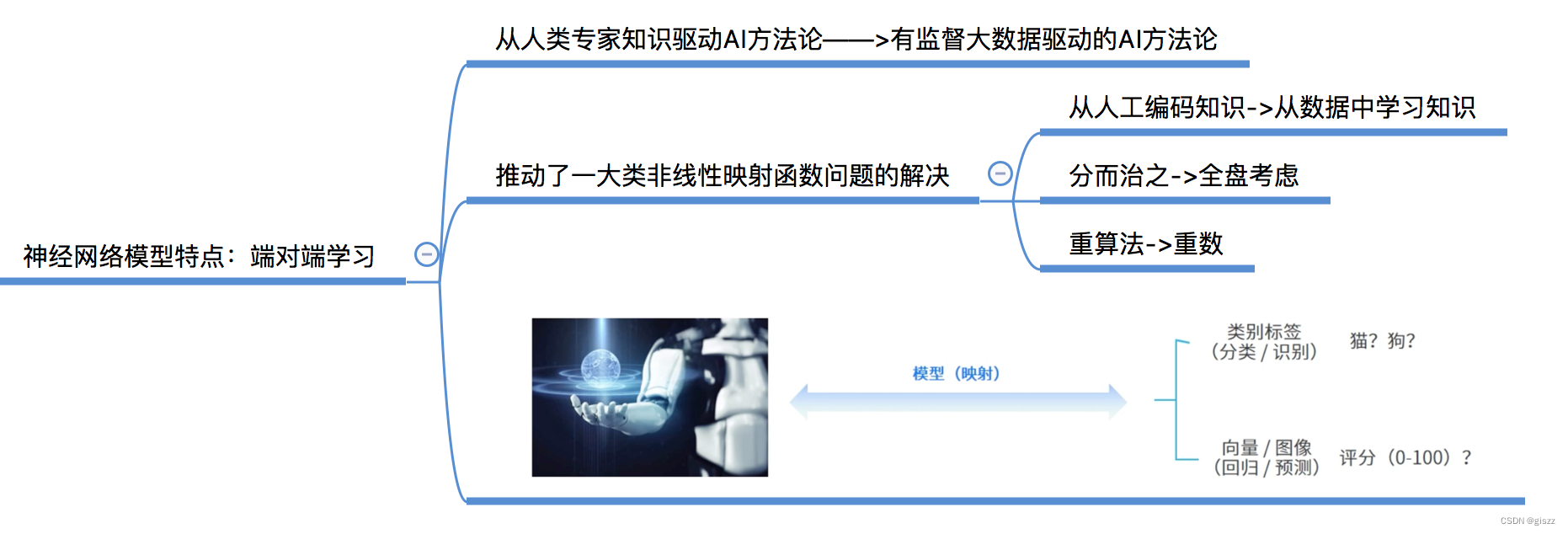

算法选择:根据问题的性质和数据的特点选择合适的机器学习算法。例如,对于分类问题可以选择逻辑回归、支持向量机、决策树等算法;对于回归问题可以选择线性回归、神经网络等算法。

损失函数定义:损失函数用于量化模型预测与实际标签之间的差异。选择合适的损失函数对于模型的训练至关重要。常见的损失函数包括均方误差损失、交叉熵损失等。

优化算法:优化算法用于更新模型的参数以最小化损失函数。常见的优化算法包括梯度下降(如批量梯度下降、随机梯度下降等)、Adam等。这些算法通过迭代地调整模型参数来寻找最优解。

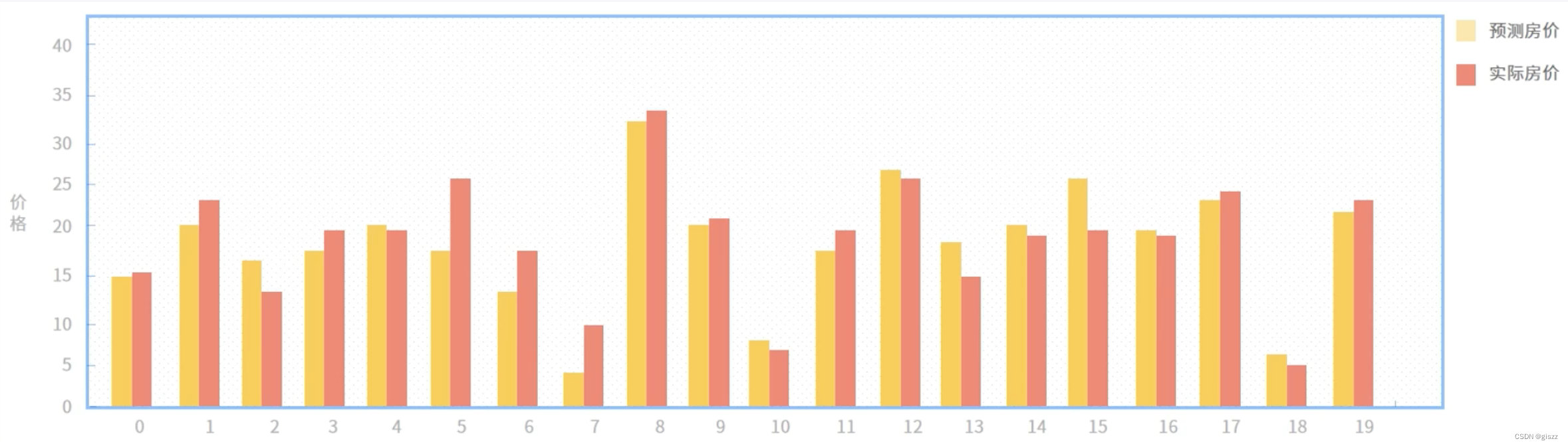

四、模型评测

模型评测是评估训练好的模型在未见过的数据上的性能的过程。这一步骤的关键在于选择合适的评估指标和评测方法。

评估指标:根据问题的性质选择合适的评估指标。对于分类问题,常见的评估指标包括准确率、精确率、召回率、F1分数等;对于回归问题,常见的评估指标包括均方误差、平均绝对误差等。这些指标用于量化模型的性能,便于比较不同模型之间的优劣。

评测方法:常见的评测方法包括留出法、交叉验证法等。留出法是将数据集划分为训练集和测试集,直接在测试集上评估模型的性能。交叉验证法则是将数据集划分为多个子集,每次使用其中一个子集作为测试集,其余子集作为训练集,多次训练并评估模型,最终取平均性能作为评估结果。交叉验证法能够更全面地评估模型的性能,减少数据划分带来的偏差。

关键环节与关键技术

在构建机器学习模型的过程中,以下环节和技术至关重要:

数据质量:高质量的数据是构建优秀模型的基石。因此,在数据集制作阶段,需要投入大量精力进行数据清洗和标注工作,确保数据的准确性和一致性。

特征选择与构造:好的特征能够显著提高模型的性能。因此,在特征工程阶段,需要充分利用领域知识和对数据的理解来选择和构造有用的特征。

算法与损失函数选择:选择合适的算法和损失函数对于模型的训练至关重要。这需要根据问题的性质和数据的特点进行仔细分析和选择。

超参数调优:超参数是影响模型性能的关键因素之一。在模型训练阶段,需要通过实验和调整来找到最佳的超参数组合。常见的超参数调优方法包括网格搜索、随机搜索和贝叶斯优化等。

模型融合与集成学习:通过将多个模型的预测结果进行融合或集成,往往能够获得比单个模型更好的性能。常见的集成学习方法包括装袋(Bagging)、提升(Boosting)和堆叠(Stacking)等。这些方法能够有效地减少模型的方差和偏差,提高模型的泛化能力。