问题描述

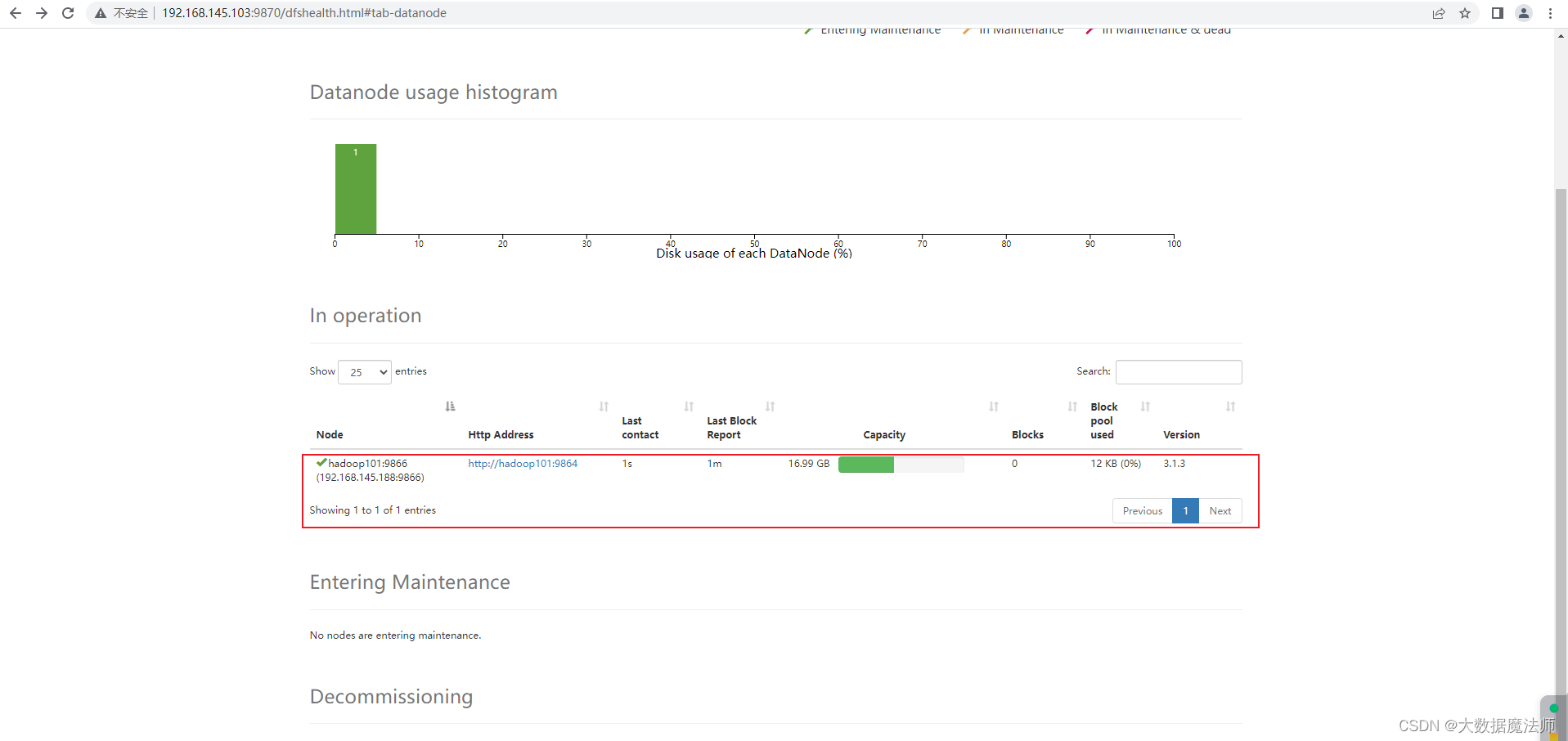

搭建好hadoop集群,然后启动hadoop集群后,发现只有一个datanode,正常应该是3个。

原因分析:

在配置hadoop时,没有设置hadoop的工作节点文件workers,所以默认是localhost。

解决方案:

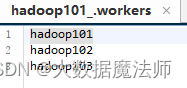

需要修改每个节点/opt/module/hadoop/hadoop-3.1.3/etc/hadoop/workers文件的内容。

vim /opt/module/hadoop/hadoop-3.1.3/etc/hadoop/workers

然后添加hadoop集群的节点,如下图:

再使用scp命令分发到其他两个节点。

点击链接查看scp命令介绍及其使用:linux常用命令-find命令与scp命令详解(超详细)

cd /opt/module/hadoop/hadoop-3.1.3/etc/hadoop

scp workers hadoop102:$pwd

scp workers hadoop103:$pwd

如下图:

然后重启hadoop集群,namenode变为了三个,如下图:

![[最新]CentOS7设置开机自<span style='color:red;'>启动</span><span style='color:red;'>Hadoop</span><span style='color:red;'>集</span><span style='color:red;'>群</span>](https://img-blog.csdnimg.cn/20200809120111313.png?x-oss-process=image/watermark,type_ZmFuZ3poZW5naGVpdGk,shadow_10,text_aHR0cHM6Ly9ibG9nLmNzZG4ubmV0L3FxXzQ0NDkxNzA5,size_16,color_FFFFFF,t_70)