文章目录

前言

增量预训练是一种在现有预训练模型的基础上,通过引入新的数据或任务来进一步训练模型的方法。这种方法的主要目的是在不从头开始训练模型的情况下,利用新数据或特定领域的数据增强模型的能力和性能。

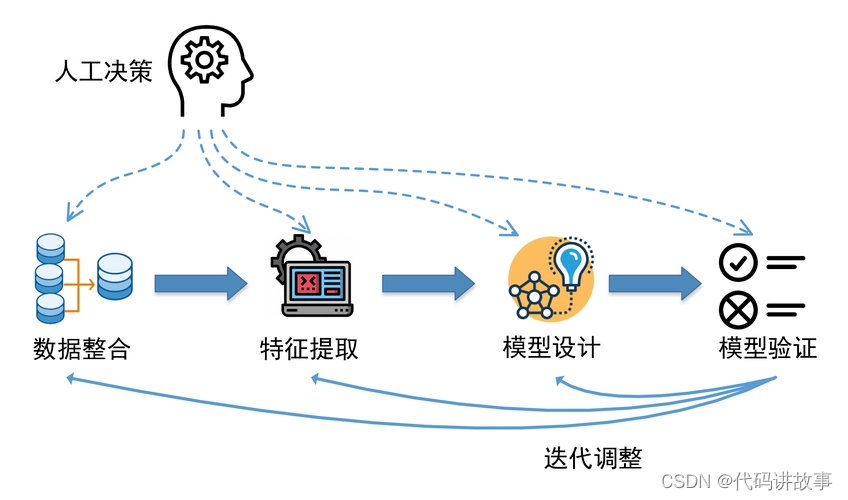

增量预训练的步骤通常包括:

- 选择基础模型:选择一个已经预训练的模型,例如BERT、GPT等。

- 准备新数据:收集和整理新的训练数据,通常是与现有任务相关的数据,或是针对特定领域的数据。

- 继续训练:使用新的数据在基础模型上进行进一步的训练。这一步可以包括全量训练(对所有模型参数进行调整)或部分训练(只调整部分参数,如顶层的几层)。

- 评估与调整:评估模型在新数据上的表现,并根据需要进行调整和优化。

这种方法的好处是能够节省训练时间和计算资源,同时利用预训练模型的已有知识,实现更好的任务性能和泛化能力。

一、增量预训练和微调的区别

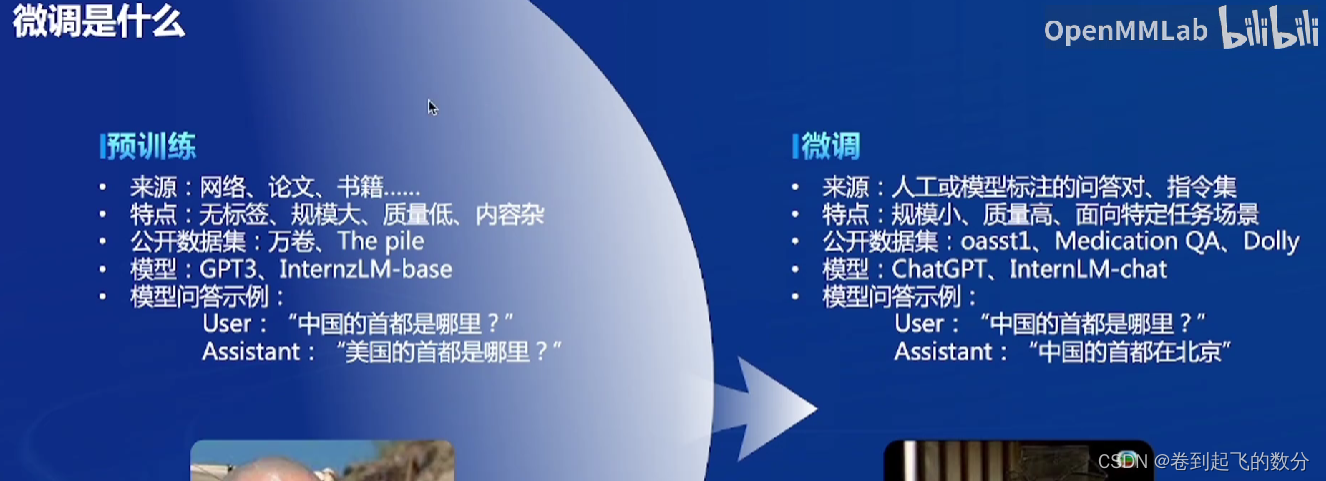

增量预训练和微调(fine-tuning)有相似之处,但它们之间有一些区别:

增量预训练(Incremental Pretraining):

- 目标:在现有预训练模型的基础上,通过引入新的数据或特定领域的数据,进一步增强模型的能力和性能。

- 数据:通常使用大量的新数据,可能与预训练时的数据分布不同,旨在使模型适应新的领域或任务。

- 应用场景:当现有的预训练模型不足以覆盖新的领域或任务时,先进行增量预训练,然后再进行微调。

微调(Fine-tuning):

- 目标:在特定任务的数据上对预训练模型进行进一步训练,使其在特定任务上表现更好。

- 数据:通常使用较小的数据集,专注于某个具体任务的数据,如情感分析、文本分类等。

- 应用场景:预训练模型已经具有足够的通用知识,微调用于在特定任务上调整模型,使其表现最佳。

总结来说,增量预训练更侧重于在更大规模或不同分布的数据上进一步训练模型,以增强其整体能力和适应性。而微调则是在特定任务的数据上对模型进行优化,使其在该任务上达到最佳性能。

二、代码示例

1. 增量预训练示例

from transformers import BertTokenizer, BertForMaskedLM, Trainer, TrainingArguments, LineByLineTextDataset, DataCollatorForLanguageModeling

# 加载预训练模型和分词器

tokenizer = BertTokenizer.from_pretrained('bert-base-uncased')

model = BertForMaskedLM.from_pretrained('bert-base-uncased')

# 创建数据集

dataset = LineByLineTextDataset(

tokenizer=tokenizer,

file_path='path/to/new_data.txt', # 新的数据集

block_size=128

)

# 数据整理器

data_collator = DataCollatorForLanguageModeling(

tokenizer=tokenizer,

mlm=True,

mlm_probability=0.15

)

# 训练参数

training_args = TrainingArguments(

output_dir='./results',

overwrite_output_dir=True,

num_train_epochs=3,

per_device_train_batch_size=16,

save_steps=10_000,

save_total_limit=2,

)

# 创建Trainer

trainer = Trainer(

model=model,

args=training_args,

data_collator=data_collator,

train_dataset=dataset

)

# 开始训练

trainer.train()

2. 微调示例

from transformers import BertTokenizer, BertForSequenceClassification, Trainer, TrainingArguments

from datasets import load_dataset

# 加载预训练模型和分词器

tokenizer = BertTokenizer.from_pretrained('bert-base-uncased')

model = BertForSequenceClassification.from_pretrained('bert-base-uncased', num_labels=2)

# 加载数据集

dataset = load_dataset('csv', data_files={'train': 'path/to/train.csv', 'test': 'path/to/test.csv'})

# 数据预处理

def preprocess_function(examples):

return tokenizer(examples['text'], truncation=True, padding='max_length', max_length=128)

encoded_dataset = dataset.map(preprocess_function, batched=True)

# 训练参数

training_args = TrainingArguments(

output_dir='./results',

num_train_epochs=3,

per_device_train_batch_size=16,

per_device_eval_batch_size=16,

evaluation_strategy="epoch",

save_steps=10_000,

save_total_limit=2,

)

# 创建Trainer

trainer = Trainer(

model=model,

args=training_args,

train_dataset=encoded_dataset['train'],

eval_dataset=encoded_dataset['test']

)

# 开始训练

trainer.train()

3. 代码的区别

模型类型:

- 增量预训练:使用

BertForMaskedLM(用于语言建模的BERT变体)。 - 微调:使用

BertForSequenceClassification(用于文本分类的BERT变体)。

- 增量预训练:使用

数据集类型和处理:

- 增量预训练:数据集是纯文本文件

new_data.txt,使用LineByLineTextDataset类加载,每行一个文本。数据整理器使用DataCollatorForLanguageModeling,用于创建掩码语言模型任务的数据。 - 微调:数据集是CSV文件

train.csv和test.csv,通过load_dataset加载。数据预处理函数将文本进行分词和编码。

- 增量预训练:数据集是纯文本文件

数据处理逻辑:

- 增量预训练:使用

DataCollatorForLanguageModeling创建掩码语言模型任务的数据,mlm_probability=0.15表示有15%的单词将被掩码以供模型预测。 - 微调:使用自定义的预处理函数

preprocess_function将数据进行分词和编码,以适应分类任务的需求。

- 增量预训练:使用

训练目标:

- 增量预训练:目标是继续训练语言模型,让模型在新的大规模数据上学到更多的语言知识。

- 微调:目标是优化模型在特定分类任务上的表现,通过调整模型参数使其在特定任务上达到最佳性能。

通过这些不同之处,可以清楚地看到增量预训练和微调在目标、数据处理和模型使用上的差异。

三、数据格式

在大多数情况下,增量预训练和微调的数据格式需要与基础模型预训练时所使用的数据格式一致,具体原因如下:

1. 增量预训练

数据格式:

- 增量预训练通常使用与基础模型预训练时相同的数据格式。这是因为增量预训练的目的是在新的数据上继续训练模型,以便它能够更好地理解和处理新领域或新的语言现象。

- 例如,如果基础模型是用大规模未标注的文本数据预训练的(如BERT使用的BooksCorpus和Wikipedia),那么增量预训练也会使用类似的未标注文本数据。

基础模型:

- 基础模型在增量预训练中保持一致,继续使用

BertForMaskedLM这样的模型,因为增量预训练的目的是继续改进语言模型本身。

2. 微调

数据格式:

- 微调的数据格式需要与特定任务相匹配。虽然微调通常依赖于基础模型的架构,但数据格式会根据具体任务进行调整。

- 例如,如果基础模型是BERT,而微调任务是文本分类,那么微调时的数据格式需要适应分类任务,即每条数据通常包含一个输入文本和一个标签。

基础模型:

- 基础模型在微调中会根据任务进行适当调整。例如,对于文本分类任务,使用的是

BertForSequenceClassification,因为这个模型已经针对分类任务进行了适配。

3. 示例

增量预训练的数据格式

假设基础模型使用未标注的文本数据预训练,我们的增量预训练数据也应该是未标注的文本格式,如new_data.txt:

This is an example of a line in the dataset.

Here is another line of text for the language model to learn from.

微调的数据格式

假设微调任务是文本分类,数据格式需要包括文本和对应的标签,如train.csv:

text,label

"I love this movie!",1

"This film was terrible.",0

4. 小结

- 增量预训练:使用未标注的文本数据,数据格式与基础模型预训练时一致。

- 微调:使用特定任务的数据格式,如文本分类任务的数据包含文本和标签。

这确保了模型在预训练和微调过程中能够正确处理和理解输入数据。

四、数据量要求

增量预训练的数据量没有固定的比例要求,因为这取决于多个因素,包括基础模型的规模、新数据的质量和多样性,以及特定应用场景的需求。然而,一些通用的指导原则可以帮助决定增量预训练的数据量:

1. 指导原则

数据质量和多样性:

- 高质量和多样性的新数据即使数量较少,也可以显著提升模型性能。如果新数据非常相关且多样性高,20%的新数据可能就能带来显著的改进。

- 如果新数据质量一般且与基础模型预训练数据的分布相似,可能需要更多的数据量(如50%甚至更多)才能显著提升模型性能。

特定领域的数据:

- 如果新数据来自特定领域(如医学、法律、金融等),即使数量较少,也可以显著提升模型在该领域的性能。例如,10%-20%的高质量领域数据可能足以提升模型在该领域的表现。

基础模型规模:

- 基础模型的规模越大(如参数更多的模型),可能需要更多的新数据才能显著影响模型性能。例如,对于BERT-base和BERT-large,后者可能需要更多的新数据来进行有效的增量预训练。

2. 示例

假设基础模型使用了100GB的文本数据进行预训练,以下是一些增量预训练的可能数据量和预期效果:

少量高质量数据(如20GB,约20%):

- 如果新数据是高质量的领域数据,可能已经足够带来显著改进。

- 适用于新领域的专用数据集。

中等量数据(如50GB,约50%):

- 更适合大规模的改进,特别是当新数据质量一般时。

- 可以帮助模型在更广泛的任务和领域上提升性能。

大量数据(如100GB,约100%或更多):

- 适用于大规模的全面改进。

- 可以显著提升模型在多任务、多领域上的性能。

3. 实际操作中的考虑

- 试验和验证:最好的做法是逐步增加数据量,并通过验证集评估模型性能,找到一个最佳的增量预训练数据量。

- 计算资源:增量预训练需要消耗计算资源。根据数据量和模型规模,合理评估计算资源需求。

4. 小结

增量预训练的数据量应根据具体需求和数据质量灵活决定。一般来说,20%-50%的新数据量可以作为起点,但实际效果需要通过实验和验证确定。关键在于新数据的质量和多样性,而不仅仅是数量。

![[GPT概念-02] — <span style='color:red;'>预</span><span style='color:red;'>训练</span>、<span style='color:red;'>微调</span><span style='color:red;'>和</span>不同<span style='color:red;'>的</span>用例应用](https://img-blog.csdnimg.cn/img_convert/7466d3802c6a31cfd2933b43eff3b0ea.png)