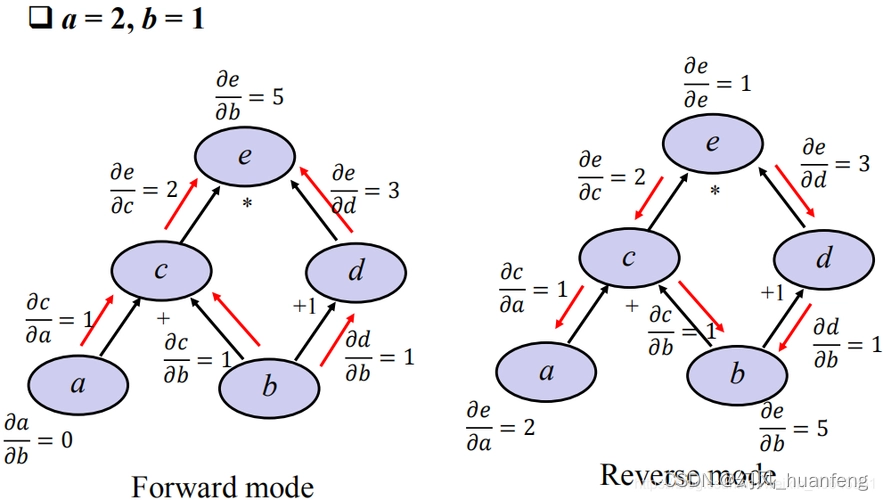

具体来说,以下是前向传播和反向传播中发生的事情:

前向传播(Forward Propagation):

- 在前向传播过程中,网络对输入数据进行一系列的线性变换和非线性激活函数的应用,从输入层传播到输出层。

- 这个过程会计算并存储每个中间层的输出以及每个激活函数的输入,这些信息在反向传播中用于计算梯度。

反向传播(Backpropagation):

- 反向传播开始于计算损失函数关于网络最终输出的梯度。

- 然后,利用链式法则,从输出层开始反向工作,计算损失函数关于每个权重和偏置的梯度。

- 在这个过程中,已经存储的中间层的输出和激活函数的输入被用来计算相对于这些参数的梯度。

- 最终,得到的梯度被用来更新网络的权重和偏置,以减少损失函数的值。

因此,梯度计算是在反向传播阶段,它依赖于前向传播中计算并存储的信息。这个过程是自动微分的一个关键部分,PyTorch和其他深度学习框架提供了自动微分机制,使得梯度计算变得高效和易于实现。