在数据驱动的时代,数据的质量对于企业的决策和业务运营至关重要。为了从各种数据源中提取、清洗和转换数据以满足分析需求,ETL(Extract, Transform, Load)工具成为了不可或缺的工具之一。其中,Kettle作为一款开源的ETL工具,以其强大的功能和易用性在数据清洗与转换中发挥着重要作用。

一、Kettle简介

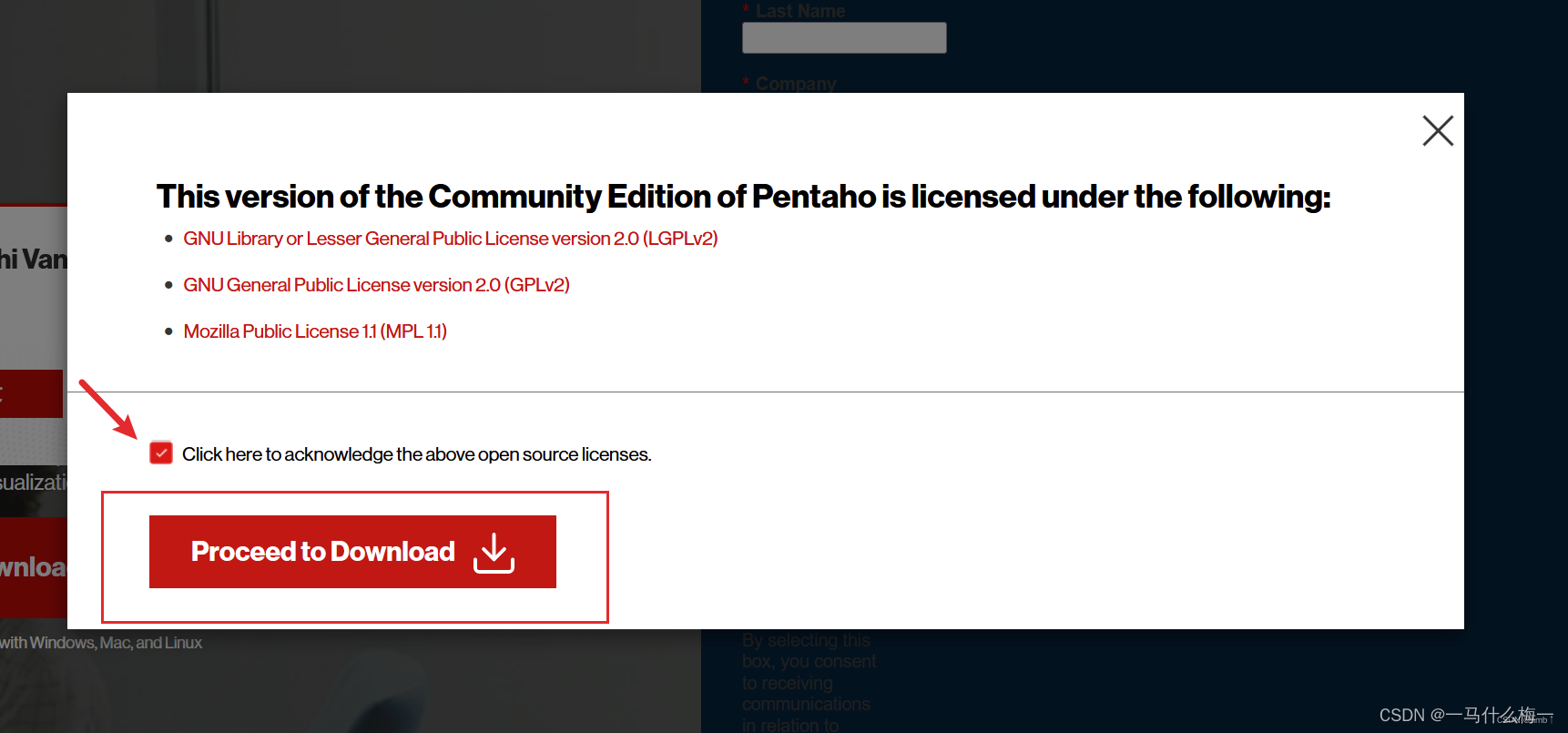

Kettle,全称为KDE Extraction, Transportation, Transformation and Loading Environment,最初是一个独立的开源项目。在2006年,Pentaho公司收购了Kettle项目,并将其作为企业级数据集成及商业智能套件Pentaho的主要组成部分。Kettle以Java开发,支持跨平台运行,具有强大的数据处理能力,是数据仓库建设和数据分析中常用的工具之一。

二、Kettle在数据清洗中的应用

数据清洗是ETL过程中的重要环节,旨在识别和纠正数据中的错误、不一致性和异常值,以确保后续数据处理的准确性和可靠性。Kettle提供了丰富的数据清洗功能,包括但不限于:

1. 缺失值处理

在数据清洗过程中,缺失值是一个常见问题。Kettle可以通过设置默认值、使用统计值填充或删除含有缺失值的记录等方式来处理缺失值,从而保持数据的完整性。

2. 异常值检测与处理

异常值(也称为离群点)是指那些明显偏离其他观测值的数据点。Kettle提供了多种异常值检测方法,如基于统计学的阈值检测、基于聚类的异常点识别等。一旦识别出异常值,Kettle还可以根据业务需求进行删除、替换或标记处理。

3. 数据去重

在数据集成过程中,数据重复是一个常见问题。Kettle提供了数据去重功能,可以基于特定字段(如主键)来识别并删除重复记录,避免数据冗余对分析结果造成干扰。

4. 格式标准化

不同数据源的数据格式可能不一致,如日期格式、货币单位等。Kettle提供了数据格式标准化的功能,可以将不同格式的数据统一转换为标准格式,确保数据的一致性和可比性。

三、Kettle在数据转换中的应用

数据转换是ETL过程中的核心环节,旨在将清洗后的数据转换成适合分析或报告的形式。Kettle提供了多种数据转换操作,包括但不限于:

1. 数据映射

Kettle支持自定义数据映射规则,可以将源数据字段映射到目标数据字段中。用户可以根据业务需求设置映射规则,实现数据的字段级转换。

2. 数据聚合

在数据分析中,经常需要对数据进行汇总和分类。Kettle提供了数据聚合功能,可以根据指定字段对数据进行分组和计算(如求和、平均值等),生成更高级别的数据视图。

3. 数据拆分

有时需要将复杂的数据结构拆分为更简单的部分以便于处理。Kettle提供了数据拆分功能,可以根据特定规则将数据拆分成多个部分进行处理。

4. 数据派生

基于现有数据计算生成新字段是数据转换中的常见需求。Kettle支持数据派生功能,可以根据现有字段计算生成新字段(如计算年龄、总收入等),以满足分析需求。

四、Kettle的优势

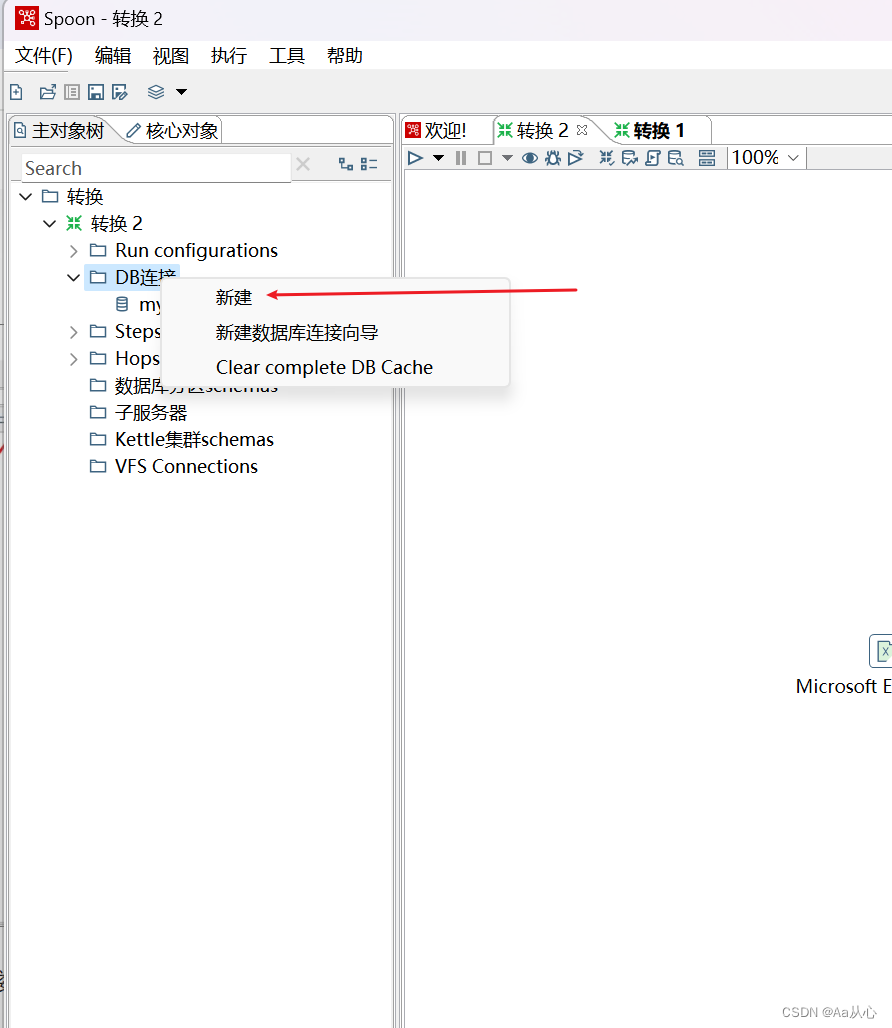

1. 图形化界面

Kettle提供了直观的图形用户界面(GUI),用户可以通过拖放和连接各种组件来设计ETL流程。这种可视化方式简化了作业的设计过程,使用户更容易理解和管理数据流。

2. 丰富的组件库

Kettle内置了丰富的组件库,包括输入组件(如数据库查询、文件读取)、转换组件(如数据清洗、转换、过滤)和输出组件(如数据库写入、文件写入)。这些组件可以根据需求灵活组合,以构建复杂的数据集成流程。

3. 高性能

Kettle以Java开发,支持多线程和分布式处理,能够在大数据量下保持高效的数据处理性能。

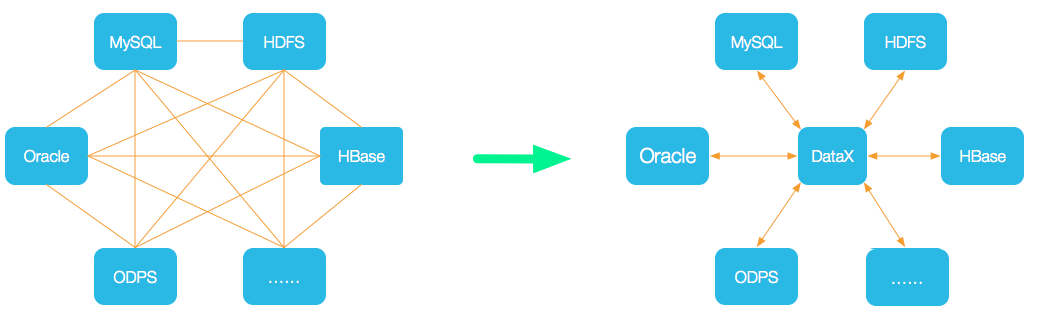

4. 易于集成

Kettle能够轻松集成到现有的数据架构中,与多种数据库、数据仓库和其他ETL工具无缝对接。

五、结论

综上所述,Kettle作为一款开源的ETL工具,在数据清洗与转换中发挥着重要作用。它提供了丰富的数据清洗和转换功能,通过图形化界面和灵活的组件库简化了数据处理流程。同时,Kettle的高性能和易于集成的特点使其成为数据仓库建设和数据分析中的首选工具之一。

![[Yii] 实战开发微信服务号+Yii 2.0构建商城系统全栈应用](https://img-blog.csdnimg.cn/direct/67c64049147741939b85489caefbb597.png)