从统计角度理解AUC:一步步揭开神秘面纱

在机器学习和数据分析领域,AUC(Area Under the Curve)是一个常用的评估指标,但对很多人来说,它的统计意义和计算过程有些晦涩。本文将用通俗易懂的语言,带你一步步从统计角度理解AUC是什么,它是如何计算的,以及如何通过代码实现这一过程。

什么是AUC?

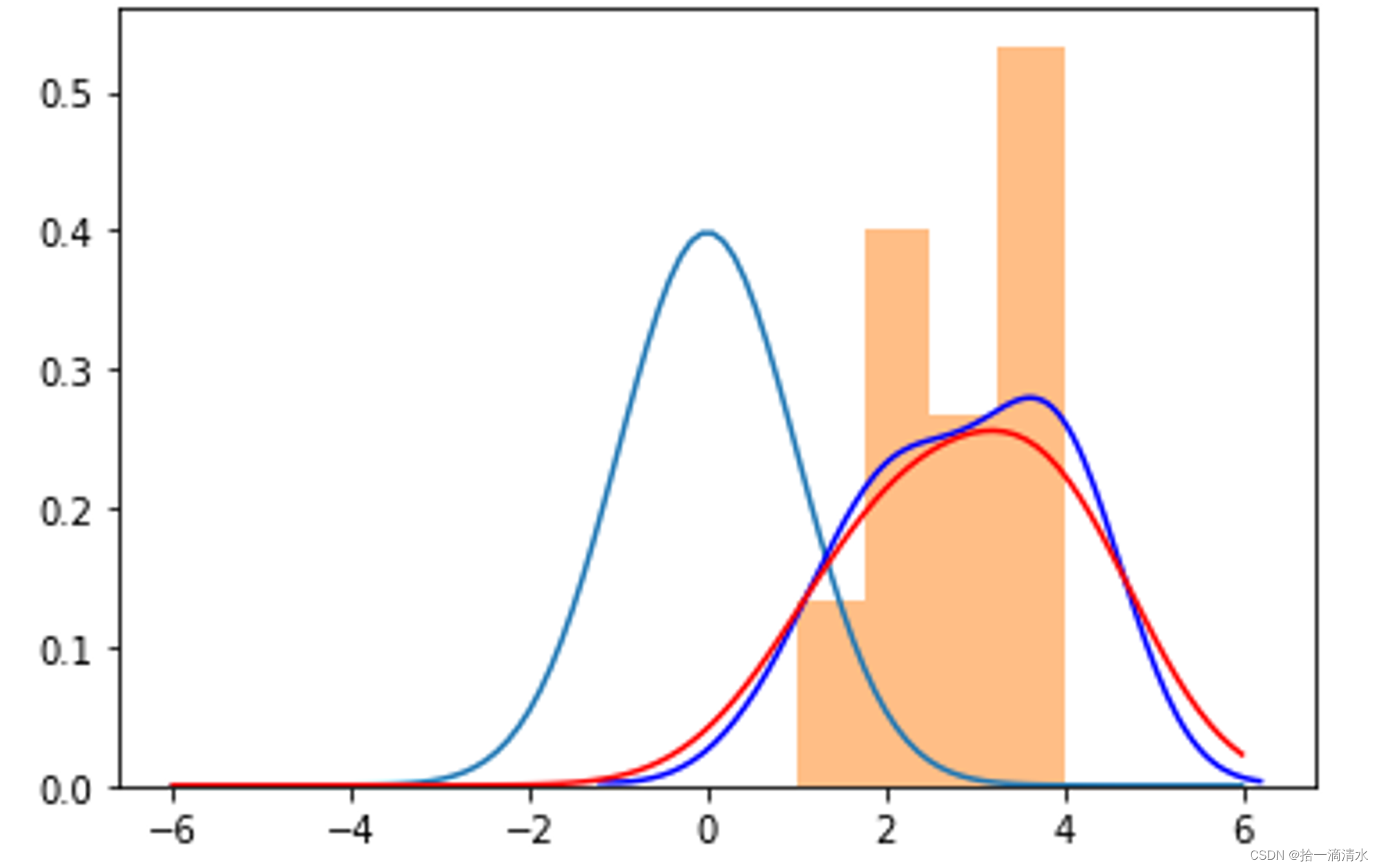

AUC的全称是"Area Under the Receiver Operating Characteristic Curve",即ROC曲线下的面积。简而言之,AUC衡量的是一个分类模型的好坏,数值在0到1之间。AUC的值越接近1,模型的性能越好。具体来说,AUC可以解释为:随机选择一个正样本,它的预测概率大于随机选择的一个负样本的预测概率的概率。

AUC的数学公式

从数学角度看,AUC可以用下面的公式表示:

A U C = 1 n × m ∑ I ( y i > y j ) AUC = \frac{1}{n \times m} \sum I(y_i > y_j) AUC=n×m1∑I(yi>yj)

其中:

- n n n 是正样本的数量

- m m m 是负样本的数量

- ∑ \sum ∑ 表示对所有正负样本对 (i, j) 的求和

- I I I是指示函数,如果 y i y_i yi(正样本的预测概率)大于 y j y_j yj(负样本的预测概率),则 I ( y i > y j ) = 1 I(y_i > y_j) = 1 I(yi>yj)=1,否则 I ( y i > y j ) = 0 I(y_i > y_j) = 0 I(yi>yj)=0

这个公式直观地说明了AUC衡量的是正样本的预测概率大于负样本的预测概率的概率。

AUC的计算步骤

让我们通过一个简单的例子,逐步了解AUC的计算过程。

1. 准备数据

假设我们有100个正样本和100个负样本,每个样本都有一个预测概率。为了简化问题,我们随机生成这些预测概率和标签。

import numpy as np

# 随机生成100个正样本(标签为1)和100个负样本(标签为0)的预测概率

np.random.seed(0)

n = 100

preds = np.concatenate([np.random.rand(n), np.random.rand(n)])

labels = np.concatenate([np.ones(n), np.zeros(n)])

2. 排序

接下来,我们需要对所有样本的预测概率进行排序,并记录对应的标签。

# 得到排序后的索引

sorted_indices = np.argsort(preds)

# 按照这些索引对标签和预测概率进行排序

sorted_labels = labels[sorted_indices]

sorted_preds = preds[sorted_indices]

3. 计算每个正样本的贡献

对于每一个正样本,我们计算它的预测概率大于多少个负样本的预测概率。我们可以通过遍历所有样本来实现这一点。

counts = []

for i in range(2 * n):

# 计算有多少样本的预测概率小于当前样本

count = np.sum(sorted_preds[:i] < sorted_preds[i])

counts.append(count)

counts = np.array(counts)

4. 计算AUC

我们把所有正样本的贡献值加起来,再除以正负样本对的总数,得到AUC。

# 计算AUC

auc = np.mean(counts[sorted_labels == 1]) / n

print('AUC: ', auc)

5. 验证结果

最后,我们可以使用sklearn库的roc_auc_score函数来验证我们的结果是否正确。

from sklearn.metrics import roc_auc_score

# 使用sklearn计算AUC

sklearn_auc = roc_auc_score(labels, preds)

print('sklearn AUC: ', sklearn_auc)

总结

AUC作为分类模型性能的评价指标,其统计意义在于衡量一个随机选择的正样本的预测概率大于一个随机选择的负样本的预测概率的概率。至此,相信你已经对AUC的计算过程有了更清晰的理解。