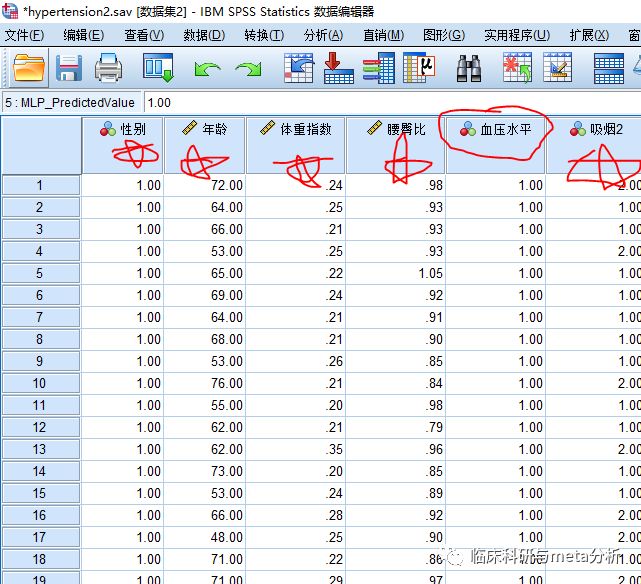

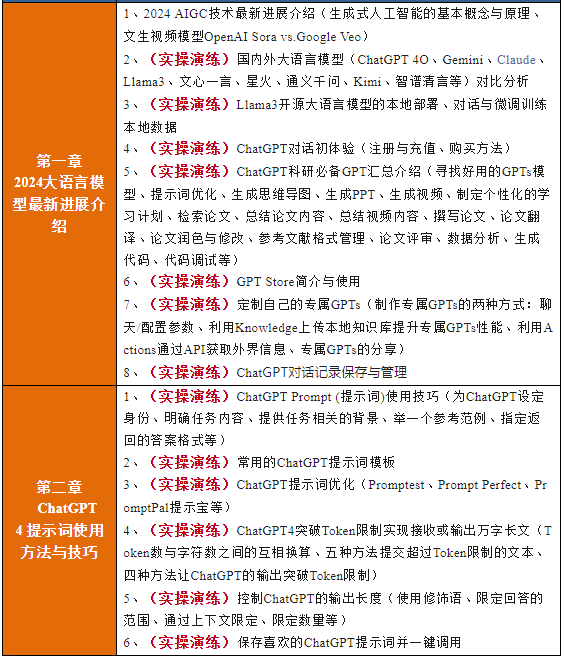

1.可根据Iris特征直接判断

2.神经网络方法,采集大量的Iris特征,分类对应标签,构成数据集。

将数据集喂入搭好的神经网络结构,网络通过反向传播优化参数得到模型。

有新的网络送入到模型里,模型会给出识别结果。

3.具体实现过程。

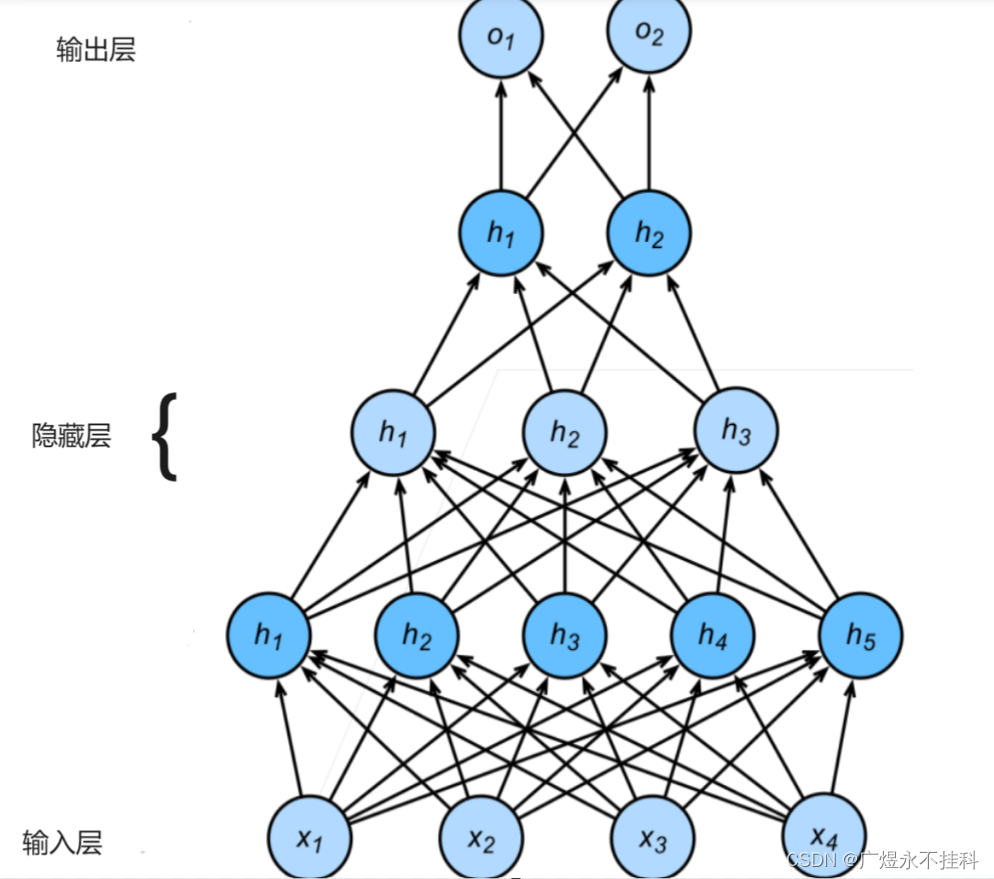

Iris有4个特征,分类总共三种,构成的神经网络如下所示

MP模型

转化为Iris Y(1, 3) = X (1, 4) * W(4, 3) + b(3,) 三个偏置项

此网络为全连接网络

神经网络执行前向传播 y = x * w + b

因为W, B是随机初始化,所以答案不准确

运用损失函数定义预测值(y)与标准答案(y_)之间的差距。

损失函数可以判断当前W和b的优劣,当损失函数值最小时,W和b最优

损失函数的表达方法之一就是:均方误差:MSE(y, y_) =

表示网络前向传播推理与标准答案之间的差距。

目的:找到最优的W和b

梯度:函数对各个参数求偏导后的向量。函数梯度下降方向是函数减小的方向

梯度下降法:沿损失函数梯度下降的方向,寻找损失函数的最小值,得到最优的参数的方法。

学习率:当学习率设置的过小时,收敛过程变得缓慢,过大,会在错过最小值

梯度下降法更新参数的计算。 lr 学习率

求wt+1 = wt - lr*对wt求偏导

这里假设损失函数为(W+1)^2, 对w进行求偏导

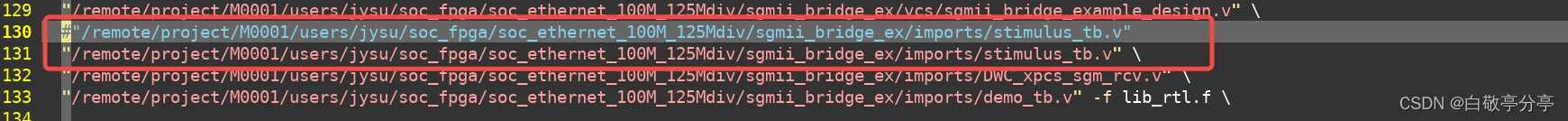

import tensorflow as tf

w = tf.Variable(tf.constant(5, dtype=tf.float32))

lr = 0.2

epoch = 40

for epoch in range(epoch): # for epoch 定义顶层循环,表示对数据集循环epoch次,此例数据集数据仅有1个w,初始化时候constant赋值为5,循环40次迭代。

with tf.GradientTape() as tape: # with结构到grads框起了梯度的计算过程。

loss = tf.square(w + 1)

grads = tape.gradient(loss, w) # .gradient函数告知谁对谁求导

w.assign_sub(lr * grads) # .assign_sub 对变量做自减 即:w -= lr*grads 即 w = w - lr*grads

print("After %s epoch,w is %f,loss is %f" % (epoch, w.numpy(), loss))

# lr初始值:0.2 请自改学习率 0.001 0.999 看收敛过程

# 最终目的:找到 loss 最小 即 w = -1 的最优参数w