52文本预处理

"""

我们将解析文本的常见预处理步骤。

这些步骤通常包括:

1.将文本作为字符串加载到内存中。

2.字符串拆分为词元(如单词和字符)。

3.建立一个词表,将拆分的词元映射到数字索引。

4.将文本转换为数字索引序列,方便模型操作。

"""

import collections

import re

from d2l import torch as d2l

time_machine_dir = '../data/timemachine.txt'

def read_time_machine():

"""将时间机器数据加载到文本行的列表中"""

with open(time_machine_dir, 'r') as f:

lines = f.readlines()

return [

re.sub('[^A-Za-z]+', ' ', line).strip().lower()

for line in lines

]

"""

re.sub 是正则表达式模块 re 中的一个函数,用于替换字符串中的匹配项。

[^A-Za-z] 表示匹配任何不是大写字母(A-Z)或小写字母(a-z)的字符。

+表示匹配一个或多个非字母字符

' ' 是替换字符串,表示将所有匹配的非字母字符替换为空格。

strip() 方法用于移除字符串首尾的空白字符。

lower() 方法将字符串中的所有字符转换为小写。

"""

lines = read_time_machine()

def tokenize(lines, token='word'):

"""将文本行拆分为单词或字符词元"""

if token == 'word':

return [line.split() for line in lines]

elif token == 'char':

return [list(line) for line in lines]

else:

print('错误:未知词元类型:' + token)

tokens = tokenize(lines)

class Vocab:

"""文本词表"""

def __init__(self, tokens=None, min_freq=0, reserved_tokens=None) -> None:

if tokens is None:

tokens = []

if reserved_tokens is None:

reserved_tokens = []

counter = count_corpus(tokens)

self._token_freqs = sorted(counter.items(), key=lambda x: x[1],

reverse=True)

self.idx_to_token = ['<unk>'] + reserved_tokens

"""

这里,self.idx_to_token 是一个列表,包含所有词元及其对应的索引。

'<unk>' 是一个特殊的词元,表示未知词元(unknown token)。

reserved_tokens 是一个列表,包含预留的词元,可以是其他特殊词元,

如 '<pad>'、'<bos>'(句子开始)和 '<eos>'(句子结束)。

['<unk>'] + reserved_tokens 将 '<unk>' 添加到 reserved_tokens 的前面,

创建一个包含未知词元和预留词元的列表。

"""

self.token_to_idx = {token: idx

for idx, token in enumerate(self.idx_to_token)}

for token, freq in self._token_freqs:

if freq < min_freq:

break

if token not in self.token_to_idx:

self.idx_to_token.append(token)

self.token_to_idx[token] = len(self.idx_to_token) - 1

def __len__(self):

return len(self.idx_to_token)

def __getitem__(self, tokens):

if not isinstance(tokens, (list, tuple)):

return self.token_to_idx.get(tokens, self.unk)

return [self.__getitem__(token) for token in tokens]

def to_tokens(self, indices):

if not isinstance(indices, (list, tuple)):

return self.idx_to_token[indices]

return [self.idx_to_token[index] for index in indices]

@property

def unk(self):

return 0

@property

def token_freqs(self):

return self._token_freqs

def count_corpus(tokens):

"""统计词元的频率"""

if len(tokens) == 0 or isinstance(tokens[0], list):

flat_tokens = []

for line in tokens:

for token in line:

flat_tokens.append(token)

tokens = flat_tokens

return collections.Counter(tokens)

vocab = Vocab(tokens)

"""

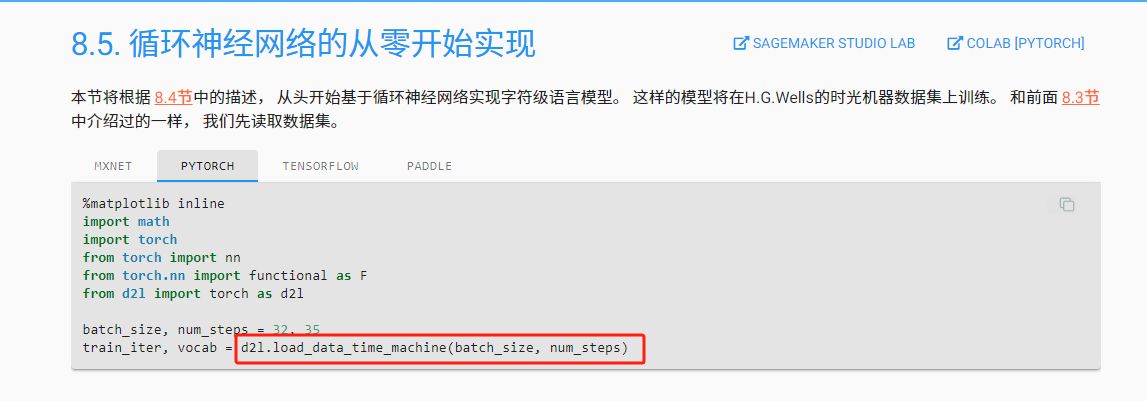

在使用上述函数时,我们将所有功能打包到load_corpus_time_machine函数中,

该函数返回corpus(词元索引列表)和vocab(时光机器语料库的词表)。

我们在这里所做的改变是:

1.为了简化后面章节中的训练,我们使用字符(而不是单词)实现文本词元化;

2.时光机器数据集中的每个文本行不一定是一个句子或一个段落,还可能是一个单词,

因此返回的corpus仅处理为单个列表,而不是使用多词元列表构成的一个列表。

"""

def load_corpus_time_machine(max_tokens=-1):

"""返回时光机器数据集的词元索引列表和词表"""

lines = read_time_machine()

tokens = tokenize(lines, 'char')

vocab = Vocab(tokens)

corpus = [vocab[token] for line in tokens for token in line]

if max_tokens > 0:

corpus = corpus[:max_tokens]

return corpus, vocab

corpus, vocab = load_corpus_time_machine(10)

print(corpus)

print(vocab.token_to_idx)