实验环境

三台虚拟机

master

slave1

slave2

| 服务器集群 | 单节点,机器最低配置:双核 CPU、8GB 内存、100G 硬盘 |

| 运行环境 | CentOS 7.4 |

| 服务和组件 | 服务和组件根据实验需求安装 |

1实验过程

1.1实验任务一:配置 Linux 系统基础环境

1.1.1步骤一:查看服务器的 IP 地址

[root@localhost ~]# ip add show

1: lo: <LOOPBACK,UP,LOWER_UP> mtu 65536 qdisc noqueue state UNKNOWN group default qlen 1000

link/loopback 00:00:00:00:00:00 brd 00:00:00:00:00:00

inet 127.0.0.1/8 scope host lo

valid_lft forever preferred_lft forever

inet6 ::1/128 scope host

valid_lft forever preferred_lft forever

2: eth0: <BROADCAST,MULTICAST,UP,LOWER_UP> mtu 1500 qdisc pfifo_fast state UP group default qlen 1000

link/ether 00:0c:29:ed:e5:78 brd ff:ff:ff:ff:ff:ff

inet 192.168.10.10/24 brd 192.168.10.255 scope global noprefixroute eth0

valid_lft forever preferred_lft forever

inet6 fe80::f5b:c223:8f69:72a4/64 scope link noprefixroute

valid_lft forever preferred_lft forever

3: eth1: <BROADCAST,MULTICAST,UP,LOWER_UP> mtu 1500 qdisc pfifo_fast state UP group default qlen 1000

link/ether 00:0c:29:ed:e5:82 brd ff:ff:ff:ff:ff:ff

inet 192.168.20.10/24 brd 192.168.20.255 scope global noprefixroute eth1

valid_lft forever preferred_lft forever

inet6 fe80::6c8d:f07:f2c8:5650/64 scope link noprefixroute

valid_lft forever preferred_lft forever我们这里是使用了两张网卡,如果自己搭配的话一张网卡就够用了,使用NAT模式

1.1.2步骤二:设置服务器的主机名称

三个节点执行

#master

[root@localhost ~]# hostnamectl set-hostname master

[root@localhost ~]# bash

[root@master ~]# hostname

master

#slave1

[root@localhost ~]# hostnamectl set-hostname slave1

[root@localhost ~]# bash

[root@slave1 ~]# hostname

slave1

#slave2

[root@localhost ~]# hostnamectl set-hostname slave2

[root@localhost ~]# bash

[root@slave2 ~]# hostname

slave21.1.3步骤三:绑定主机名与 IP 地址

三个节点执行

#以master为例

[root@master ~]# vim /etc/hosts

127.0.0.1 localhost localhost.localdomain localhost4 localhost4.localdomain4

::1 localhost localhost.localdomain localhost6 localhost6.localdomain6

#添加下面内容

192.168.10.10 master

192.168.10.20 slave1

192.168.10.30 slave21.1.4步骤四:查看 SSH 服务状态

SSH 为 Secure Shell 的缩写,是专为远程登录会话和其他网络服务提供安全性 的协议。一般的用法是在本地计算机安装 SSH 客服端,在服务器端安装 SSH服 务,然后本地计算机利用 SSH 协议远程登录服务器,对服务器进行管理。这样可 以非常方便地对多台服务器进行管理。同时在 Hadoop 分布式环境下,集群中的 各个节点之间(节点可以看作是一台主机)需要使用 SSH 协议进行通信。因此 Linux 系统必须安装并启用 SSH 服务。

CentOS 7 默认安装 SSH 服务,可以使用如下命令查看 SSH 的状态

同样是三个节点都要查看,是否开启,以免影响后面操作

[root@master ~]# systemctl status sshd

● sshd.service - OpenSSH server daemon

Loaded: loaded (/usr/lib/systemd/system/sshd.service; enabled; vendor preset: enabled)

Active: active (running) since 五 2024-03-22 19:35:33 CST; 2h 42min ago

Docs: man:sshd(8)

man:sshd_config(5)

Main PID: 65265 (sshd)

CGroup: /system.slice/sshd.service

└─65265 /usr/sbin/sshd -D

......1.1.5步骤五:关闭防火墙

三个节点执行

Hadoop 可以使用 Web 页面进行管理,但需要关闭防火墙,否则打不开 Web 页面。 同时不关闭防火墙也会造成 Hadoop 后台运行脚本出现莫名其妙的错误。关闭命令如 下:

systemctl stop firewalld

systemctl disable firewalld关闭防火墙后要查看防火墙的状态,确认一下

systemctl status firewalld

看到 inactive (dead)就表示防火墙已经关闭。不过这样设置后,Linux 系统如 果重启,防火墙仍然会重新启动。执行如下命令可以永久关闭防火墙。

1.1.6步骤六:创建 hadoop 用户

三个节点执行

#master

root@master ~]# useradd hadoop //创建用户

[root@master ~]# echo "1" |passwd --stdin hadoop //给用户设置密码

#slave1

root@slave1 ~]# useradd hadoop

[root@slave1 ~]# echo "1" |passwd --stdin hadoop

#slave2

root@slave2 ~]# useradd hadoop

[root@slave2 ~]# echo "1" |passwd --stdin hadoop

1.2安装 JAVA 环境

1.2.1步骤一:下载 JDK 安装包

JDK 安 装 包 需 要 在 Oracle 官 网 下 载 , 下 载 地 址 为 : 20 https://www.oracle.com/java /technologies /javase-jdk8-downloads.html,本教材采用 的 Hadoop 2.7.1 所需要的 JDK 版本为 JDK7 以上,这里采用的安装包为 jdk-8u152-linuxx64.tar.gz。

1.2.2步骤二:卸载自带 OpenJDK

#如果用户在此之前做过其他服务,可能留有安装包,

但是如果是新的虚拟机,或者是最小化安装,

则没有这些安装包,也就不需要下面的操作

[root@master ~]# rpm -qa | grep java

javapackages-tools-3.4.1-11.el7.noarch

java-1.8.0-openjdk-1.8.0.352.b08-2.el7_9.x86_64

tzdata-java-2022e-1.el7.noarch

python-javapackages-3.4.1-11.el7.noarch

java-1.8.0-openjdk-headless-1.8.0.352.b08-2.el7_9.x86_64

#注意在这里有些虚拟机可能没有这些包,

那么则不需要执行以下操作,如果有相关安装包,

则执行下面的代码

卸载相关服务,键入命令

[root@master ~]# rpm -e --nodeps javapackages-tools-3.4.1-11.el7.noarch

[root@master ~]# rpm -e --nodeps java-1.8.0-openjdk-1.8.0.352.b08-2.el7_9.x86_64

[root@master ~]# rpm -e --nodeps tzdata-java-2022e-1.el7.noarch

[root@master ~]# rpm -e --nodeps python-javapackages-3.4.1-11.el7.noarch

[root@master ~]# rpm -e --nodeps java-1.8.0-openjdk-headless-1.8.0.352.b08-2.el7_9.x86_64

[root@master ~]# rpm -qa | grep java

查看删除结果再次键入命令 java -version 出现以下结果表示删除功

[root@master ~]# java --version

bash: java: 未找到命令 1.2.3步骤三:安装 JDK

Hadoop 2.7.1 要求 JDK 的版本为 1.7 以上,这里安装的是 JDK1.8 版 (即JAVA 8)。

安装命令如下,将安装包解压到/usr/local/src 目录下 ,注意/opt/software目录 下的软件包事先准备好。

[root@master ~]# tar -zxvf /opt/software/jdk-8u152-linux-x64.tar.gz -C /usr/local/src/

[root@master ~]# ls /usr/local/src/

jdk1.8.0_152

#改名,方便后续操作,名字简洁,根据需要,也可不改

[root@master ~]# mv /usr/local/src/jdk1.8.0_152 /usr/local/src/jdk1.2.4步骤四:设置 JAVA 环境变量

在 Linux 中设置环境变量的方法比较多,较常见的有两种:一是配置 /etc/profile 文件,配置结果对整个系统有效,系统所有用户都可以使用;二 21 是配置~/.bashrc 文件,配置结果仅对当前用户有效。这里使用第一种方法。

[root@master ~]# vim /etc/profile

在文件的最后增加如下两行:

export JAVA_HOME=/usr/local/src/jdk

export PATH=$PATH:$JAVA_HOME/bin

执行 source 使设置生效:

[root@master ~]# source /etc/profile

检查 JAVA 是否可用。

[root@master ~]# echo $JAVA_HOME

/usr/local/src/jdk1.8.0_152

[root@master ~]# java -version

java version "1.8.0_152"

Java(TM) SE Runtime Environment (build 1.8.0_152-b16)

Java HotSpot(TM) 64-Bit Server VM (build 25.152-b16, mixed mode)

能够正常显示 Java 版本则说明 JDK 安装并配置成功。2安装 Hadoop 软件

2.1实验任务一:获取 Hadoop 安装包

Apache Hadoop 各 个 版 本 的 下 载 网 址 : https://archive.apache.org/dist/hadoop /common/。本教材选用的是 Hadoop 2.7.1 版本,安装包为 hadoop-2.7.1.tar.gz。需要先下载 Hadoop 安装包,再上传到 Linux 系统的/opt/software 目录。具体的方法见前一节“实验一 Linux 操作系统环境 设置”,这里就不再赘述。

2.2实验任务二:安装 Hadoop 软件

2.2.1步骤一:安装 Hadoop 软件

安装命令如下,将安装包解压到/usr/local/src/目录下

[root@master ~]# tar -zxvf /opt/software/hadoop-2.7.1.tar.gz -C /usr/local/src/

#改名

[root@master ~]# mv /usr/local/src/hadoop-2.7.1 /usr/local/src/hadoop

[root@master ~]# ll /usr/local/src/

总用量 0

drwxr-xr-x. 12 10021 10021 183 3月 22 20:35 hadoop

drwxr-xr-x. 8 10 143 255 9月 14 2017 jdk

[root@master ~]# ll /usr/local/src/hadoop

总用量 28

drwxr-xr-x. 2 10021 10021 194 3月 29 2015 bin

drwxr-xr-x. 3 10021 10021 20 3月 29 2015 etc

drwxr-xr-x. 2 10021 10021 106 3月 29 2015 include

drwxr-xr-x. 3 10021 10021 20 3月 29 2015 lib

drwxr-xr-x. 2 10021 10021 239 3月 29 2015 libexec

-rw-r--r--. 1 10021 10021 15429 3月 29 2015 LICENSE.txt

-rw-r--r--. 1 10021 10021 101 3月 29 2015 NOTICE.txt

-rw-r--r--. 1 10021 10021 1366 3月 29 2015 README.txt

drwxr-xr-x. 2 10021 10021 4096 3月 29 2015 sbin

drwxr-xr-x. 4 10021 10021 31 3月 29 2015 share bin:此目录中存放 Hadoop、HDFS、YARN 和 MapReduce 运行程序和管理 软件。

etc:存放 Hadoop 配置文件。

include: 类似 C 语言的头文件

lib:本地库文件,支持对数据进行压缩和解压。

libexe:同 lib

sbin:Hadoop 集群启动、停止命令

share:说明文档、案例和依赖 jar 包。

2.2.2步骤二:配置 Hadoop 环境变量

和设置 JAVA 环境变量类似,修改/etc/profile 文件

[root@master ~]# vi /etc/profile

在文件的最后增加如下两行:

export HADOOP_HOME=/usr/local/src/hadoop-2.7.1

export PATH=$PATH:$HADOOP_HOME/bin:$HADOOP_HOME/sbin

执行 source 使用设置生效:

[root@master ~]# source /etc/profile

检查设置是否生效:

[root@master ~]# hadoop

Usage: hadoop [--config confdir] [COMMAND | CLASSNAME]

CLASSNAME run the class named CLASSNAME

or

where COMMAND is one of:

fs run a generic filesystem user client

version print the version

jar <jar> run a jar file

note: please use "yarn jar" to launch

YARN applications, not this command.

checknative [-a|-h] check native hadoop and compression libraries

availability

distcp <srcurl> <desturl> copy file or directories recursively

archive -archiveName NAME -p <parent path> <src>* <dest> create a hadoop

archive

classpath prints the class path needed to get the

credential interact with credential providers

Hadoop jar and the required libraries

daemonlog get/set the log level for each daemon

trace view and modify Hadoop tracing settings

Most commands print help when invoked w/o parameters.

[root@master ~]#

出现上述 Hadoop 帮助信息就说明 Hadoop 已经安装好了

2.2.3步骤三:修改目录所有者和所有者组

上述安装完成的 Hadoop 软件只能让 root 用户使用,要让 hadoop 用户能够 运行 Hadoop 软件,需要将目录/usr/local/src 的所有者改为 hadoop 用户。

[root@master ~]# chown -R hadoop:hadoop /usr/local/src/

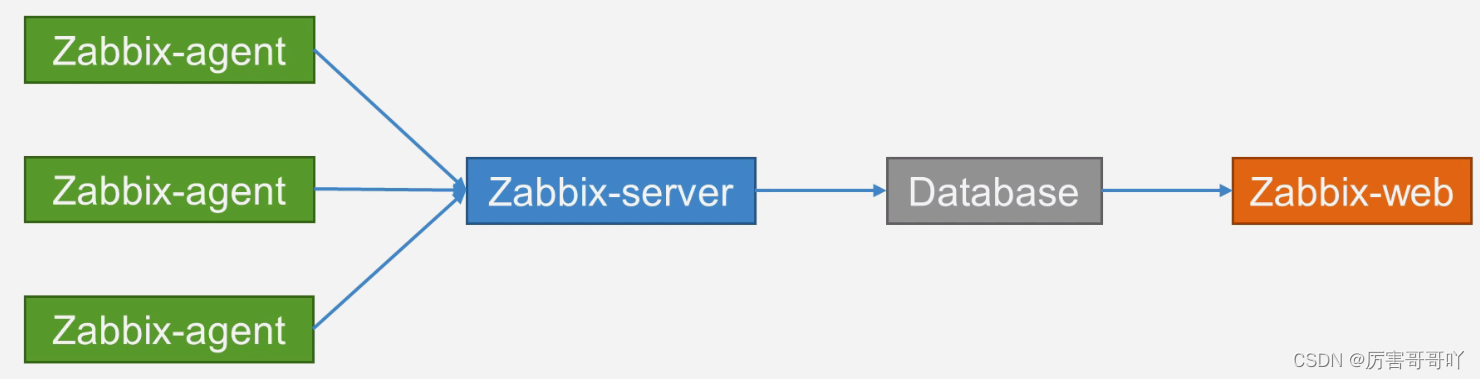

![[zabbix] 分布式应用<span style='color:red;'>之</span>监控<span style='color:red;'>平</span><span style='color:red;'>台</span>zabbix<span style='color:red;'>的</span>认识与<span style='color:red;'>搭</span><span style='color:red;'>建</span>](https://img-blog.csdnimg.cn/direct/fff1d695608b413c84fca578470c826d.png)