文章链接:[2403.10131] RAFT: Adapting Language Model to Domain Specific RAG (arxiv.org)

摘要

本文由加州大学伯克利分校计算机科学系的Tianjun Zhang等人撰写,介绍了Retrieval Augmented Fine Tuning(RAFT)这一新型训练技术。RAFT旨在提高大型语言模型(LLMs)在特定领域内回答“开放书”问题的能力。该技术通过结合相关文档的检索和模型的微调,让模型学会忽略与问题无关的分心文档,从而提升模型在特定领域内的推理能力。本文在PubMed、HotpotQA和Gorilla等多个数据集上验证了RAFT的效果,并展示了其作为一种后训练技术,如何有效改善预训练LLMs在领域特定RAG(Retrieval-Augmented Generation)任务中的表现。

背景介绍

近年来,大型语言模型(LLMs)如GPT系列、BERT等在自然语言处理领域取得了显著的进展。然而,这些模型在应用到具体领域时,往往面临知识偏差、数据稀疏等问题,导致性能下降。为了解决这一问题,研究者们提出了多种方法,如基于RAG的提示(prompting)和微调(finetuning)。然而,如何有效地将领域特定知识融入预训练模型,仍然是一个开放的研究问题。

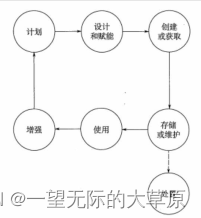

大模型在回答问题的时候可以分为两种模式,如下图:

- 利用大模型本身自带的source domain 进行**“闭卷式”*