正则化技术详解:L1、L2正则化与权重衰减

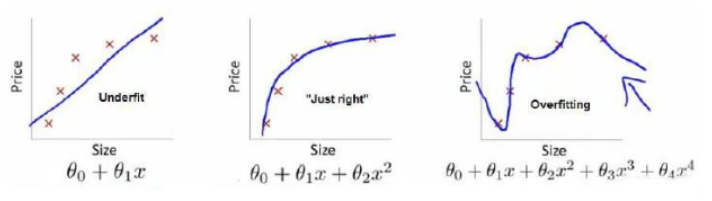

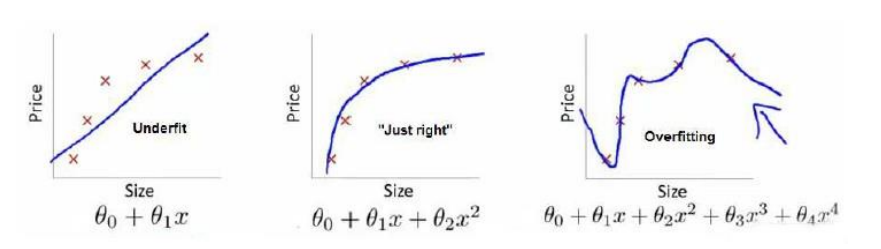

在机器学习和深度学习的领域中,正则化技术是一种至关重要的策略,用于防止模型过拟合并提高模型的泛化能力。本文将详细介绍L1正则化、L2正则化以及它们之间的区别,同时还会探讨与L2正则化密切相关的权重衰减(Weight Decay)技术。

正则化的基本概念

正则化是一种减少模型复杂度或防止过拟合的技术。在训练模型时,我们通常会遇到这样的问题:模型在训练数据上表现良好,但在未见过的测试数据上表现较差。这通常是由于模型过于复杂,过度拟合了训练数据的噪声和细节,而不是学习到了数据的本质特征。正则化技术通过引入额外的约束或惩罚项来限制模型的复杂度,从而提高模型的泛化能力。

L1正则化与L2正则化

L1正则化(Lasso Regression)

L1正则化通过在损失函数中添加模型参数绝对值的和作为惩罚项来限制模型的复杂度。具体地,假设原始损失函数为J(W),其中W是模型的权重参数,那么添加L1正则化后的损失函数可以表示为:

J′(W)=J(W)+λi∑∣wi∣

其中,λ是正则化系数,用于控制正则化的强度。L1正则化倾向于产生稀疏的权重矩阵,即许多权重为零。这是因为绝对值函数在零点处不可导,导致优化算法在更新权重时更容易将某些权重置为零。这种稀疏性有助于特征选择,因为它可以自动地选择对模型贡献最大的特征,并忽略其他不相关的特征。

L2正则化(Ridge Regression)

L2正则化通过在损失函数中添加模型参数平方和作为惩罚项来限制模型的复杂度。具体地,添加L2正则化后的损失函数可以表示为:

J′(W)=J(W)+2λi∑wi2

与L1正则化类似,λ是正则化系数。L2正则化倾向于产生较小但非零的权重,使权重矩阵更平滑。这是因为平方项在零点处可导,且导数随权重值的增大而增大,从而鼓励优化算法将权重值缩小到接近零但非零的值。这种平滑性有助于防止模型过于依赖某些特定的特征,从而提高模型的鲁棒性和泛化能力。

L1与L2正则化的区别

L1正则化和L2正则化在以下方面存在差异:

- 稀疏性:L1正则化倾向于产生稀疏的权重矩阵,而L2正则化则倾向于产生平滑的权重矩阵。

- 优化难度:由于L1正则化在零点处不可导,优化算法在更新权重时可能会遇到一些困难。而L2正则化在零点处可导,优化过程相对更容易。

- 鲁棒性:L2正则化通过平滑权重矩阵提高了模型的鲁棒性,使其对噪声和异常值更不敏感。而L1正则化则可能更容易受到噪声和异常值的影响。

权重衰减(Weight Decay)

权重衰减,作为L2正则化的一个实践应用,在深度学习的优化过程中扮演着重要角色。当我们说“权重衰减”时,实际上是在每次参数更新时,除了应用梯度下降的结果外,还对权重进行了一定程度的“衰减”,即乘以一个小于1的因子。

权重衰减的数学表达

在标准的梯度下降算法中,权重的更新公式如下:

wi←wi−η∂wi∂J(W)

其中,wi 是第 i 个权重,η 是学习率,∂wi∂J(W) 是损失函数 J(W) 关于 wi 的梯度。

而在添加了权重衰减的情况下,更新公式变为:

wi←(1−λη)wi−η∂wi∂J(W)

其中,λ 是权重衰减系数,通常与L2正则化中的正则化系数相对应。从上面的公式可以看出,权重衰减实际上是在梯度下降的基础上,对权重进行了一个额外的“缩小”操作。

权重衰减与L2正则化的关系

权重衰减与L2正则化在数学上是等效的。具体来说,当我们在损失函数中添加L2正则化项时,其梯度会贡献一个额外的项,该项与权重本身成正比。在梯度下降的过程中,这个额外的梯度项会导致权重在每次迭代时都进行一定程度的缩小,从而实现了权重衰减的效果。

权重衰减的作用

权重衰减的作用主要体现在以下几个方面:

- 防止过拟合:通过限制权重的大小,权重衰减有助于防止模型过于复杂,从而避免过拟合。

- 提高模型泛化能力:较小的权重值意味着模型对输入数据的依赖程度较低,从而提高了模型在未见数据上的泛化能力。

- 加速优化过程:在某些情况下,权重衰减可以加速优化过程,使模型更快地收敛到最优解。

如何选择合适的权重衰减系数

选择合适的权重衰减系数是一个需要根据具体任务进行调参的过程。一般来说,较小的权重衰减系数可能不足以防止过拟合,而较大的权重衰减系数则可能导致模型欠拟合。因此,我们需要通过交叉验证等方法来选择最适合当前任务的权重衰减系数。

结论

权重衰减作为一种与L2正则化密切相关的技术,在深度学习中具有广泛的应用。通过限制权重的大小,它可以有效地防止模型过拟合,并提高模型的泛化能力。同时,权重衰减还可以加速优化过程,使模型更快地收敛到最优解。在实际应用中,我们需要根据具体任务选择合适的权重衰减系数,以达到最佳的效果。