法国人工智能初创公司 Mistral 正在通过其新的 AI 模型定制选项(包括付费计划)撼动整个行业,允许开发人员和企业针对特定用例微调其生成模型。

引入新的 AI 模型自定义选项

自服务微调

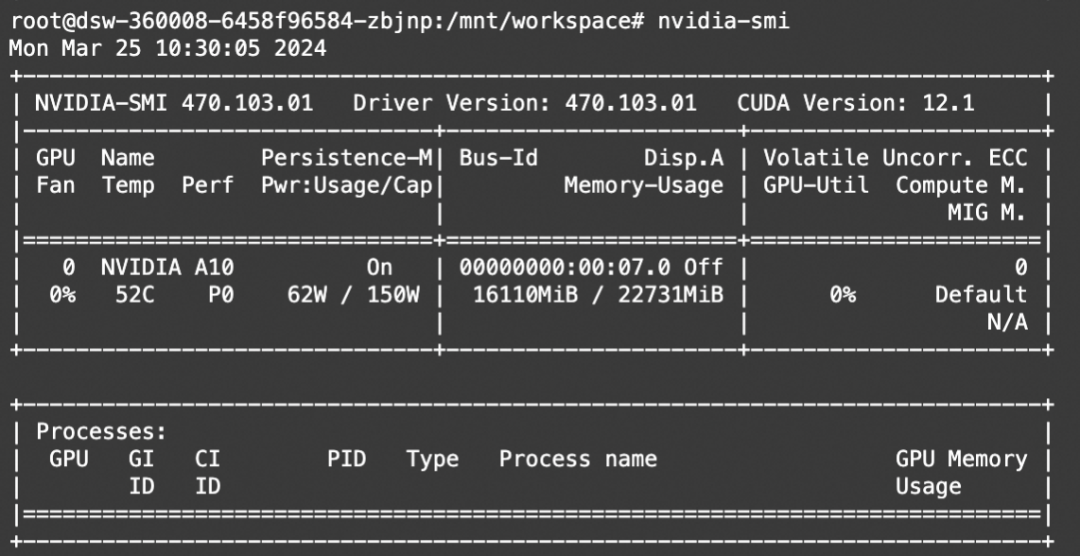

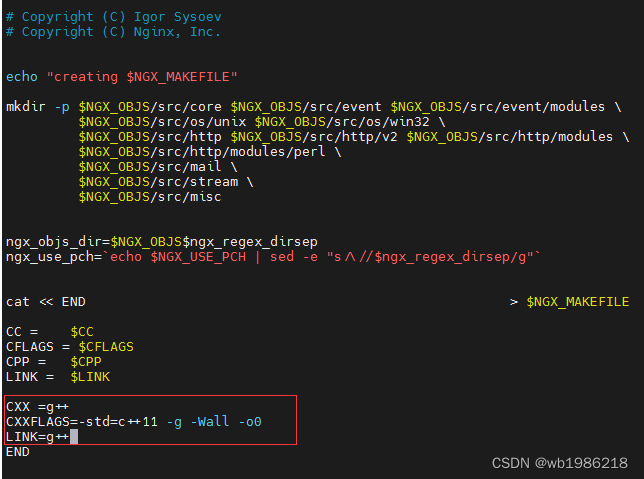

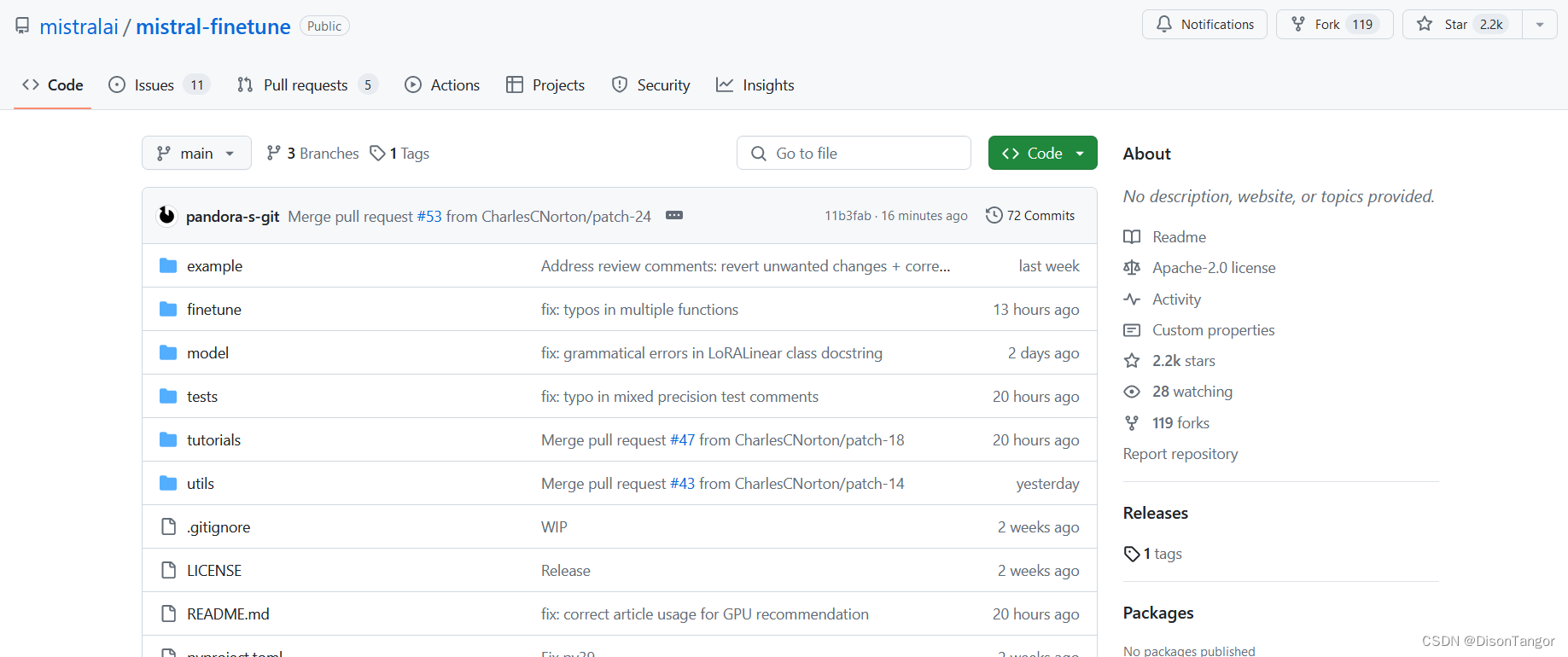

Mistral推出了一款名为Mistral-Finetune的软件开发工具包(SDK),旨在在各种设置(包括工作站、服务器和小型数据中心节点)上微调其模型。根据 SDK 的 GitHub 存储库的自述文件,它针对多 GPU 设置进行了优化,但可以缩减到单个 Nvidia A100 或 H100 GPU,以微调 Mistral 7B 等小型型号。Mistral 声称,在 8 个 H100 GPU 上使用 Mistral-Finetune 可以在大约半小时内完成对 UltraChat 等数据集的微调,该数据集包含与 OpenAI 的 ChatGPT 的 140 万次对话。

托管微调服务

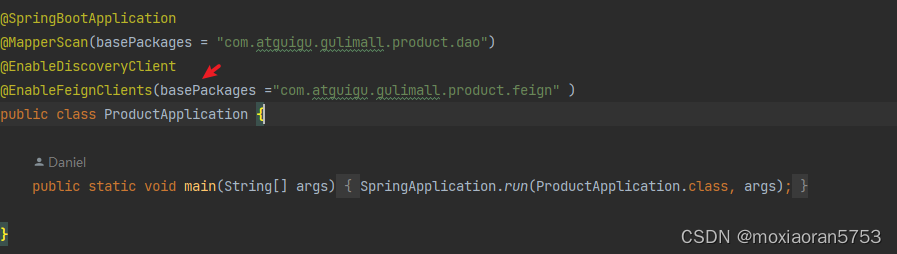

对于寻求更托管解决方案的开发人员和公司,Mistral 提供可通过其 API 访问的微调服务。这些服务目前与Mistral的两款型号Mistral Small和Mistral 7B兼容,很快将支持更多型号。这种托管方法简化了微调过程,使组织能够为其特定领域创建高度专业化和优化的模型。

定制培训服务

Mistral 还推出了定制培训服务,可供特定客户使用,从而能够使用组织的数据对组织应用程序的任何 Mistral 模型进行微调。这种方法允许创建针对特定领域需求量身定制的高度专业化和优化的模型。

微调的重要性

微调对于改进大型语言模型 (LLM) 输出和自定义它们以满足特定的企业需求至关重要。如果操作得当,微调可以带来更准确、更有用的模型响应,使组织能够从其生成式 AI 应用程序中获得更大的价值和精度。然而,微调可能代价高昂,给一些企业带来了挑战。

Mistral 的微调方法

Mistral 是开源 AI 模型领域的佼佼者,在其 AI 开发人员平台 La Plateforme 上提供了新的定制功能。这些工具旨在降低培训成本并降低进入门槛。

定制 Mistral 模型

Mistral 的新工具可实现高效微调,降低部署成本并提高应用程序速度。客户可以通过 Mistral 在 GitHub 上提供的开源代码或通过自定义培训服务使用自己的基础设施,在 La Plateforme 上定制 Mistral 模型。

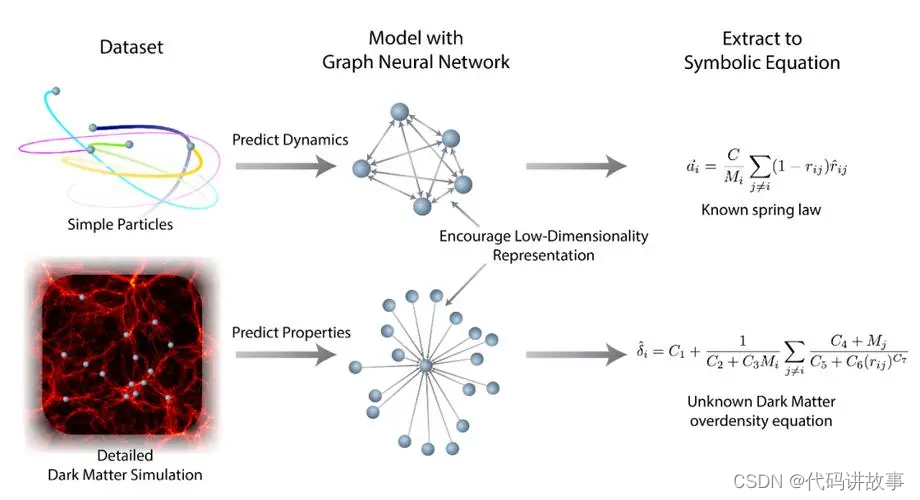

对于那些希望在基础设施上工作的人,Mistral 发布了基于 LoRA 范式的轻量级代码库 mistral-finetune,它减少了模型所需的可训练参数的数量。

对于无服务器微调,Mistral 通过研发使用精细的技术提供新服务。

AI 微调黑客马拉松

作为对此次发布的补充,Mistral 启动了一场 AI 微调黑客马拉松,持续到 6 月 30 日,允许开发人员试用这家初创公司的新微调 API。

Mistral 的迅速崛起

Mistral 由前 Google DeepMind 和 Meta 员工 Arthur Mensch、Guillaume Lample 和 Timothée Lacroix 于 14 个月前创立,经历了前所未有的增长。该公司获得了创纪录的 1.18 亿美元种子轮融资,并与 IBM 和其他公司建立了合作伙伴关系。今年 2 月,它通过与 Microsoft 达成协议,通过 Azure 云发布了 Mistral Large。

最近,SAP和思科宣布支持Mistral,该公司推出了Codestral,这是其有史以来第一个以代码为中心的LLM。据报道,Mistral即将完成一轮6亿美元的融资,目标是60亿美元的估值。

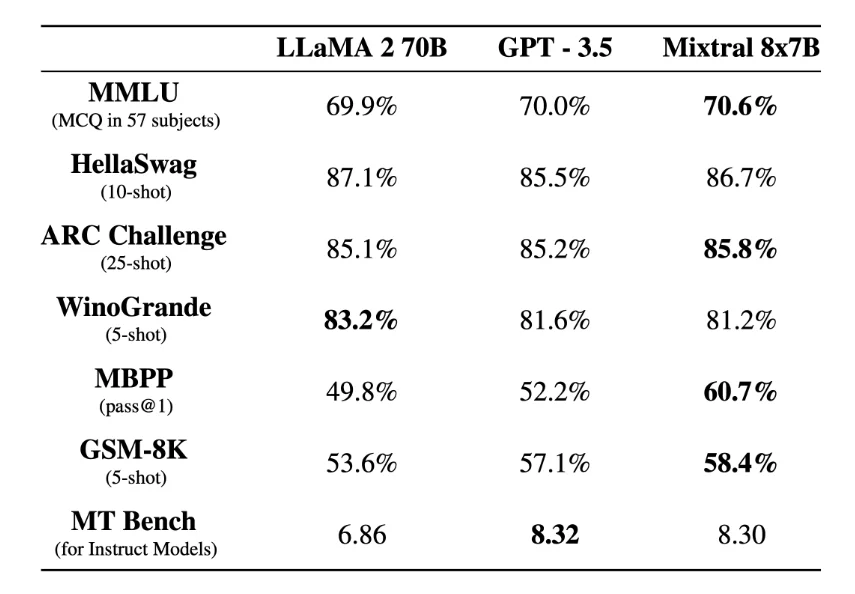

Mistral Large 是 OpenAI 和 Meta 的 Llama 3 的直接竞争对手,它被认为是仅次于 OpenAI 的 GPT-4 的全球第二大商业语言模型。Mistral 7B 于 2023 年 9 月推出,在许多基准测试中优于 Llama,并在代码上接近 CodeLlama 7B 的性能。