在当今信息爆炸的时代,网络爬虫(Web Scraping)成为了获取网络数据的重要工具。Python语言因其简洁的语法和强大的库支持,成为了编写网络爬虫的首选语言。本文将介绍网络爬虫的基本概念、工作原理,并提供部分Python爬虫的源码示例。

网络爬虫概述

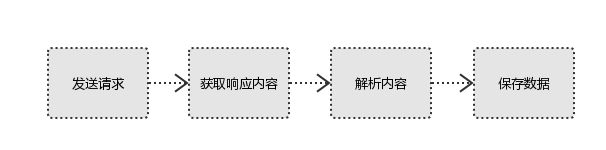

网络爬虫是一种自动获取网页内容的程序,它按照一定的算法顺序抓取互联网上的网页。爬虫的基本工作流程包括:发送请求、接收响应、解析内容、存储数据。

网络爬虫的工作原理

- 发送请求:爬虫向目标网站发送HTTP请求,请求特定的网页。

- 接收响应:服务器响应请求,返回网页内容。

- 解析内容:爬虫解析网页内容,提取所需数据。

- 存储数据:将提取的数据存储到数据库或文件中。

网络爬虫的分类

- 通用爬虫:如Google、Bing等搜索引擎的爬虫,用于抓取整个互联网。

- 聚焦爬虫:专注于特定主题或领域的爬虫,如学术文献爬虫。

Python爬虫开发工具

- Requests:用于发送HTTP请求。

- BeautifulSoup:用于解析HTML和XML文档。

- Scrapy:一个强大的爬虫框架。

- Selenium:用于自动化测试,可以模拟浏览器行为。

Python爬虫实战理论

- 遵守Robots协议:尊重网站所有者的意愿,不爬取禁止爬取的内容。

- 设置User-Agent:模拟浏览器,避免被网站识别为爬虫。

- 处理Cookies:处理需要登录的网站。

- 使用代理:避免IP被封。

- 异步请求:提高爬取效率。

- 数据清洗:对爬取的数据进行格式化和清洗。

Python爬虫源码示例

以下是一个简单的Python爬虫示例,使用Requests和BeautifulSoup库来抓取网页标题。

import requests

from bs4 import BeautifulSoup

def fetch_page(url):

# 发送HTTP请求

response = requests.get(url)

return response.text

def parse_page(html):

# 解析HTML内容

soup = BeautifulSoup(html, 'html.parser')

title = soup.find('title').get_text()

return title

def main():

url = 'http://example.com'

html = fetch_page(url)

title = parse_page(html)

print(f'网页标题: {title}')

if __name__ == '__main__':

main()

请注意,实际开发中需要根据目标网站的具体情况调整爬虫策略,并严格遵守相关法律法规。

![<span style='color:red;'>基于</span><span style='color:red;'>python</span>+<span style='color:red;'>爬虫</span><span style='color:red;'>实现</span>招聘职位数据分析[<span style='color:red;'>源</span><span style='color:red;'>码</span>+LW+部署讲解视频]](https://i-blog.csdnimg.cn/direct/fa6e75ac696d4d0bb74008eec1de52ee.jpeg)

![Paper速读-[Visual Prompt Multi-Modal Tracking]-Dlut.edu-CVPR2023](https://img-blog.csdnimg.cn/direct/137dc32d7e3d4195ae92d52c66255928.png)