目录

FunClip的核心特色

Paraformer-Large模型,中文语音识别

模型下载,在魔塔社区下载,800多m

使用示例:

from modelscope.pipelines import pipeline

from modelscope.utils.constant import Tasks

inference_pipeline = pipeline(

task=Tasks.auto_speech_recognition,

model='iic/speech_paraformer-large_asr_nat-zh-cn-16k-common-vocab8404-pytorch', model_revision="v2.0.4")

rec_result = inference_pipeline(input='https://isv-data.oss-cn-hangzhou.aliyuncs.com/ics/MaaS/ASR/test_audio/asr_example_zh.wav')

print(rec_result)2. 热词定制化功能:通过SeACo-Paraformer模型,FunClip允许用户在语音识别过程中指定热词,如特定实体词、人名等,进一步提升识别效果,满足个性化编辑需求。

3. 说话人识别技术:集成的CAM++说话人识别模型,使用户能够根据自动识别出的说话人ID进行裁剪,轻松提取特定说话人的视频段落。

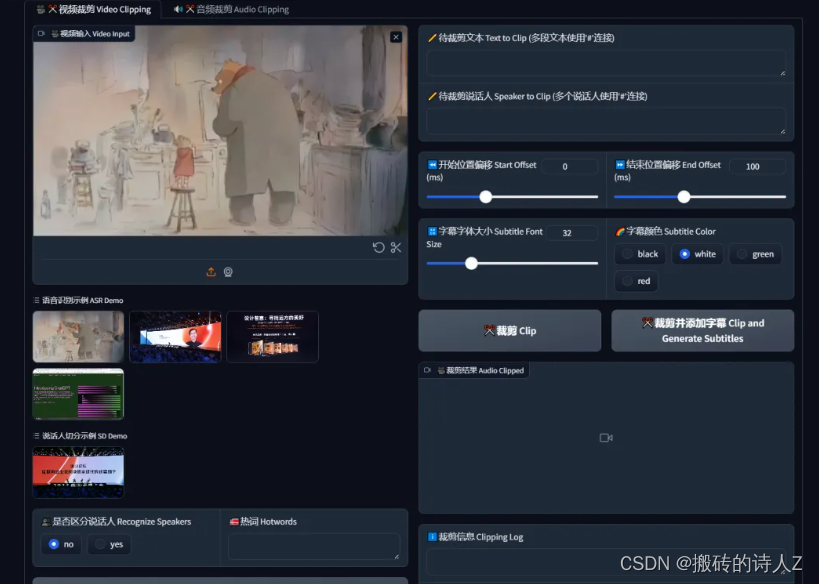

4. 便捷的交互体验:利用Gradio构建的交互界面,FunClip提供了简单易用的安装和操作流程,支持在服务端搭建,通过浏览器即可进行视频剪辑。

5. 多段自由剪辑与字幕生成:FunClip支持用户自由选择视频片段进行剪辑,自动生成全视频及目标片段的SRT字幕文件,简化了整个编辑流程。

FunClip的使用流程

1. 安装与启动:通过简单的pip命令安装FunClip及其依赖,一键启动Gradio服务。

2. 视频上传与编辑:在Web界面上传视频,设置热词和说话人识别,点击识别后选择需要的片段进行裁剪。

3. 字幕与剪辑结果:剪辑完成后,FunClip将自动提供SRT字幕文件,方便用户进一步使用或分享。

FunClip的推出,不仅极大地简化了视频剪辑工作,还为教育、媒体、企业培训等多个领域提供了强有力的技术支持,让每个人都能轻松成为视频编辑的高手。

FunClip,这款AI驱动的视频剪辑工具,正以其高效、智能、易用的特点,引领视频编辑的新潮流。让我们拭目以待,看它如何继续以技术的力量,激发创意,丰富我们的生活。

项目链接:https://github.com/alibaba-damo-academy/FunClip