#urllib的爬虫案例-通过最原始的爬虫方式 爬虫之前如果抓包工具Fiddler证书安装失败,采用以下方法

1、打开cmd 2、进入fillder的目录 如下: 里面的路径改成你自己的安装路径

cd /d "D:\Program Files (x86)\Fiddler2"

然后再执行下面命令

makecert.exe -r -ss my -n "CN=DO_NOT_TRUST_FiddlerRoot, O=DO_NOT_TRUST, OU=Created by http://www.fiddler2.com" -sky signature -eku 1.3.6.1.5.5.7.3.1 -h 1 -cy authority -a sha1 -m 120 -b

1.爬取百度贴吧数据

import urllib #用于进行中文编码

import urllib2 #用于进行爬虫核心处理

#定义一个函数,用于爬取对应的数据

def load_url(url,file_name):

print('开始爬取%s的内容'%file_name)

#爬取程序

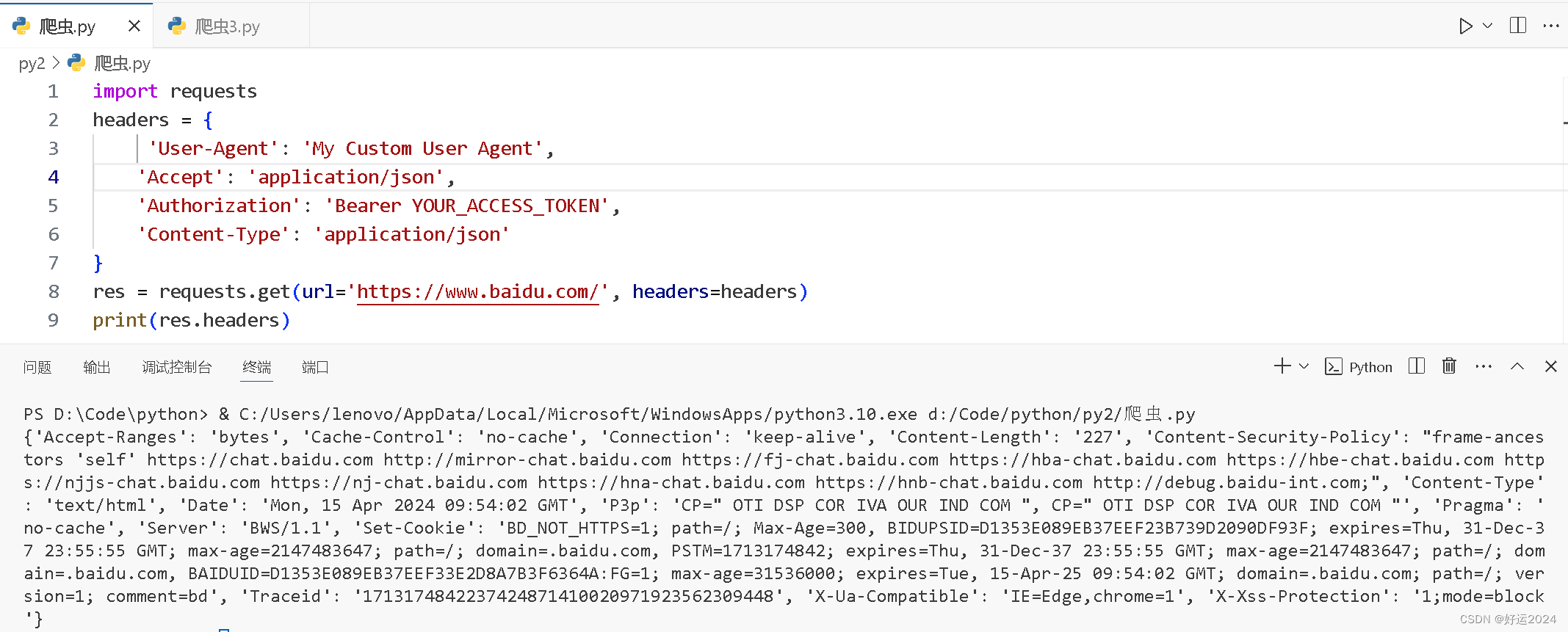

my_headers={

'User-Agent': 'Mozilla/5.0 (Windows NT 6.1; WOW64) AppleWebKit/537.36 (KHTML, like Gecko) Chrome/59.0.3071.104 Safari/537.36',

}

request = urllib2.Request(url,headers=my_headers)

content = urllib2.urlopen(request).read()

print('爬取%s的内容完成!'%file_name)

return content

#定义一个函数,用于保存数据

def save_data(data,file_name):

print('开始保存%s的内容'%file_name)

with open(file_name,'w') as f:

f.write(data)

print('保存%s的内容完成!'%file_name)

#定义函数,进行爬虫的核心处理功能

def spider(url,kw,begin,end):

for page in range(begin,end+1):

#计算需要的页码

pn = (page-1)*50

#进行kw参数的编码

kw = urllib.urlencode({'kw':kw})

#拼接url地址

full_url = url + kw +'&pn=' +str(pn)

#定义一个保存文件的名称

file_name = '网页'+str(page) +'.html'

#开始爬取数据

html=load_url(full_url,file_name)

#保存数据到文件

save_data(html,file_name)

#主程序运行入口

if __name__ == '__main__':

#用户输入相关数据

url='http://tieba.baidu.com/f?'

kw = raw_input('请输入要爬取的贴吧名称:')

begin = int(raw_input('请输入开始页码:'))

end = int(raw_input('请输入结束页码:'))

#调用爬虫开始执行

spider(url,kw,begin,end)

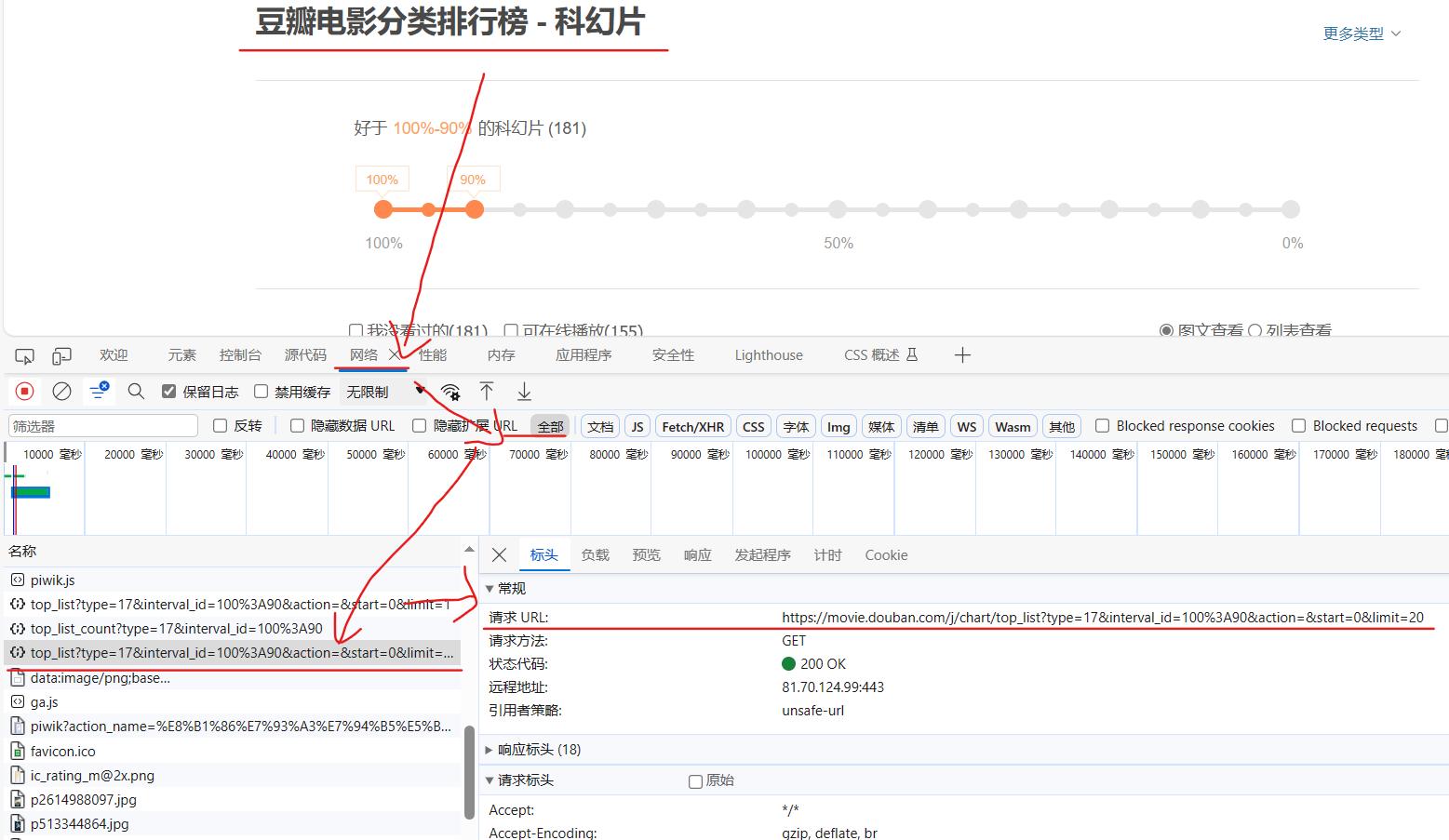

2.爬取豆瓣电影数据

import urllib

import urllib2

url = 'https://movie.douban.com/j/new_search_subjects?sort=T&range=0,10'

#要传递的post方式嗯对数据,有可能会有多组数据

submit_data = {

'start':20,

'tags':'喜剧'

}

#编码

data = urllib.urlencode(submit_data)

#构造请求头,创建请求对象

headers = {

"Accept" : "application/json, text/plain, */*",

"User-Agent" : "Mozilla/5.0 (Windows NT 10.0; Win64; x64) AppleWebKit/537.36 (KHTML, like Gecko) Chrome/60.0.3112.7 Safari/537.36",

"Accept-Language" : "zh-CN,zh;q=0.8"

}

request = urllib2.Request(url,data,headers)

#发送请求,获取服务器响应数据

response = urllib2.urlopen(request)

#获取爬取到的数据

content = response.read()

#保存数据

with open('movies.json','w') as f:

f.write(content)